前天,智算领域迎来一则令人振奋的消息:Meta 正式发布了备受期待的开源大模型——Llama 3。

Llama 3 的卓越性能

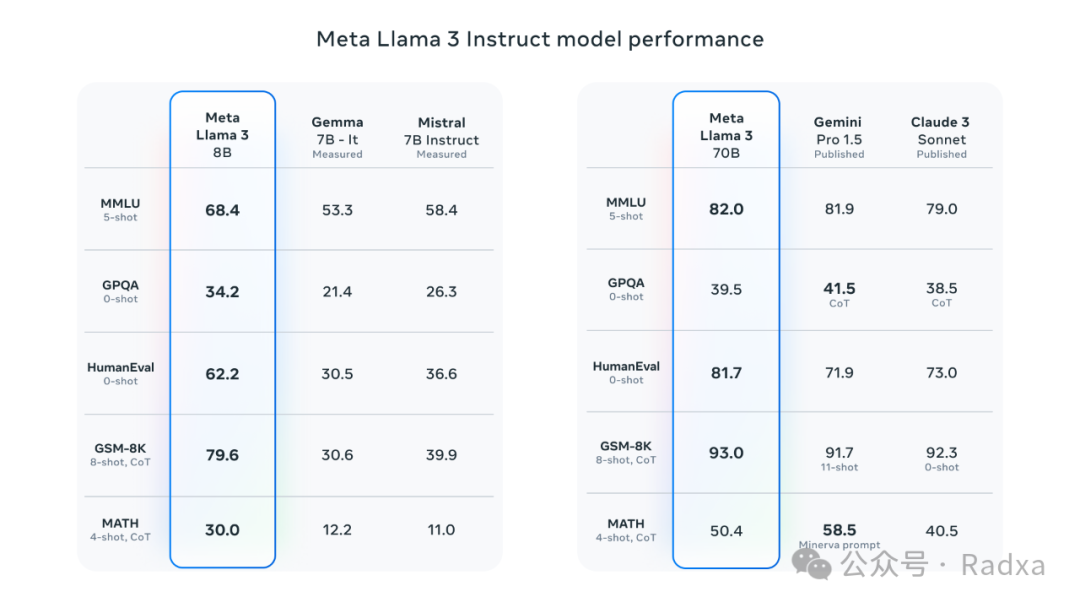

Meta 表示,Llama 3 在多个关键基准测试中展现出卓越性能,超越了业内先进的同类模型。无论是在代码生成、复杂推理,还是在遵循指令和可视化想法方面,Llama 3 都实现了全面领先。该模型在以下五个基准测试中均表现出色:

MMLU(学科知识理解)

GPQA(一般问题解答)

HumanEval(代码能力)

GSM-8K(数学能力)

MATH(高难度数学问题)

无论是 8B 规格的 Llama3 还是 70B 规格,它们都较市场上其他优秀大模型表现更佳。

纵向对比显示,Llama 3 的性能大幅领先于前代产品 Llama 2,尤其是在 8B 规格上,远超过 Llama 2 时代的 13B 和 70B 规格;新的 70B 规格更是展现出与 GPT-4 早期版本相媲美的能力。

指令调优模型

| Benchmark | Llama 3 8B | Llama 2 7B | Llama 2 13B | Llama 3 70B | Llama 2 70B |

MMLU (5-shot) | 68.4 | 34.1 | 47.8 | 82 | 52.9 |

GPQA (0-shot) | 34.2 | 21.7 | 22.3 | 39.5 | 21 |

HumanEval (0-shot) | 62.2 | 7.9 | 14 | 81.7 | 25.6 |

GSM-8K (8-shot, CoT) | 79.6 | 25.7 | 77.4 | 93 | 57.5 |

MATH (4-shot, CoT) | 30 | 3.8 | 6.7 | 50.4 | 11.6 |

瑞莎 Airbox 快速支持 Llama 3

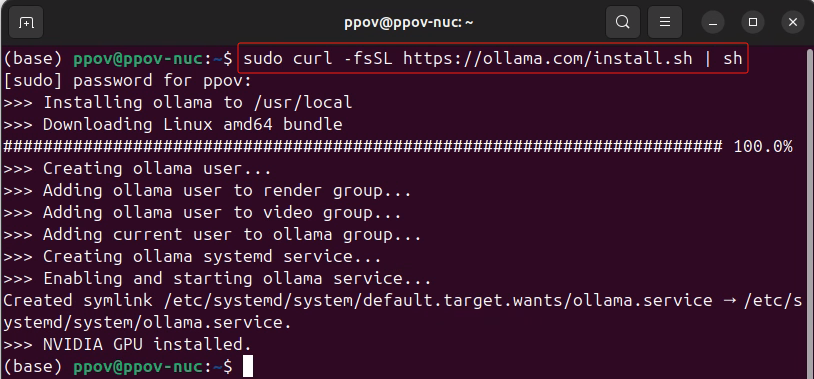

面对 Llama 3 如此激动人心的性能,Airbox 团队积极响应,快速将 Llama 8B 移植并成功在 Airbox 上运行。以下视频展示了 Llama 8B 在 Airbox 上的运行情况:

(注:Llama 3 8B 知识更新到 2023 年 3 月)

可以看到,Llama 3 8B 在 Airbox 上的运行表现极为流畅,达到了 9.6 token/s 的处理速度,已充分展现出其实用价值。与其他应用结合使用时,更开辟了广阔的应用前景和创新可能性。Airbox 团队后续会对 Llama 3 8B 做更多测试并公布结果。

关于瑞莎 Fogwise Airbox

瑞莎智算盒子 Fogwise Airbox 是一款面向侧端生成式智算的边缘计算微型服务器,基于算能最新专为生成式智算打造的 SG2300X 处理器设计,具有开箱即用,本地离线部署,注重数据隐私,多精度支持,高能效比,高性价比,系统/文档/工具链开源等特点,是当前为数不多甚至是唯一的低成本在边缘侧部署生成式智算的方案。

瑞莎 Fogwise Airbox 现已准备就绪,即将在近期发售,敬请期待。

-

基准测试

+关注

关注

0文章

19浏览量

7587 -

开源

+关注

关注

3文章

3309浏览量

42471 -

大模型

+关注

关注

2文章

2423浏览量

2643

发布评论请先 登录

相关推荐

用Ollama轻松搞定Llama 3.2 Vision模型本地部署

Llama 3 的未来发展趋势

Llama 3 性能评测与分析

Llama 3 适合的行业应用

Llama 3 与 GPT-4 比较

Llama 3 语言模型应用

使用OpenVINO 2024.4在算力魔方上部署Llama-3.2-1B-Instruct模型

Llama 3 王者归来,Airbox 率先支持部署

Llama 3 王者归来,Airbox 率先支持部署

评论