智能驾驶大模型是近年来人工智能领域和自动驾驶领域最为前沿的研究方向之一,它融合了深度学习、多模态融合、世界模型构建等多种技术,有望显著提升自动驾驶系统的性能和鲁棒性。

01 Transformer架构和端到端

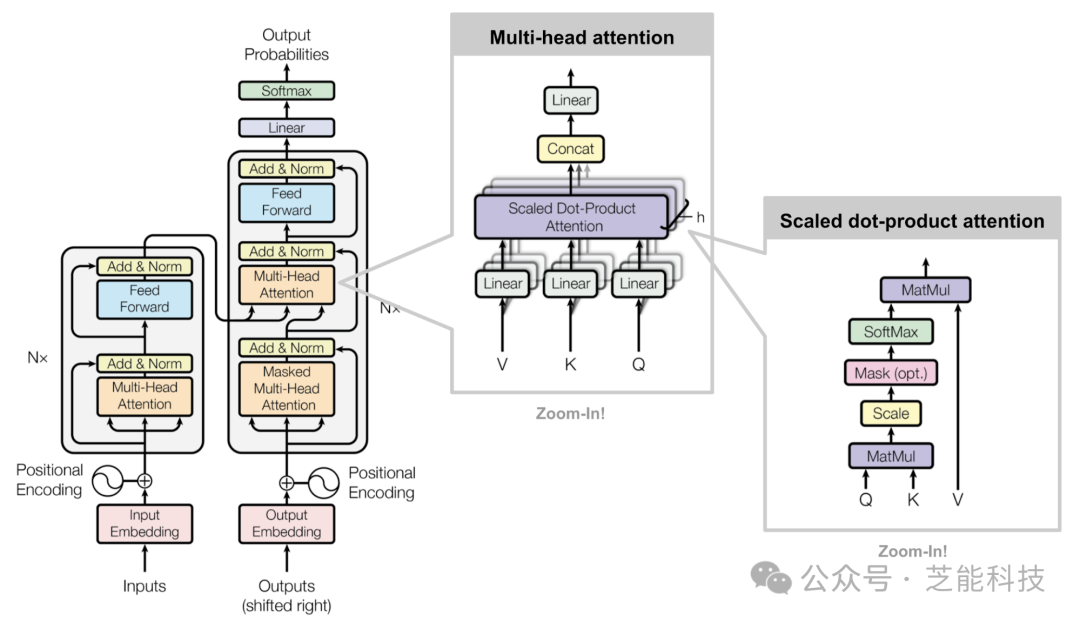

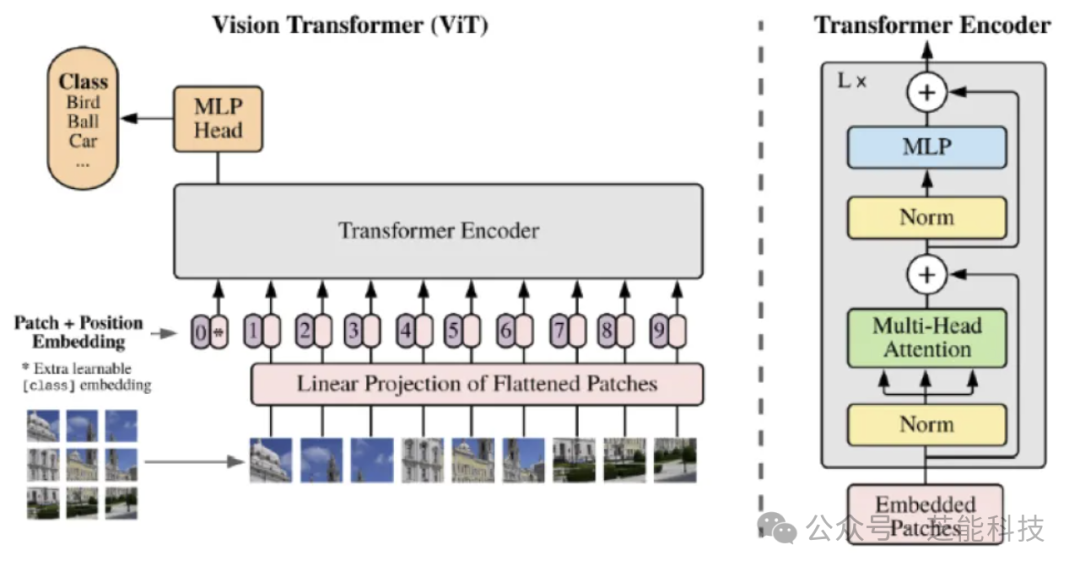

Transformer架构是近年来神经网络领域最具突破性的成果之一,它在自然语言处理、计算机视觉等领域取得了巨大成功。

Transformer架构擅长建模远距离依赖关系,能够有效关联多种模态的信息并合成为统一形式的信号,且其性能通常随着参数量的扩大而大幅提升。

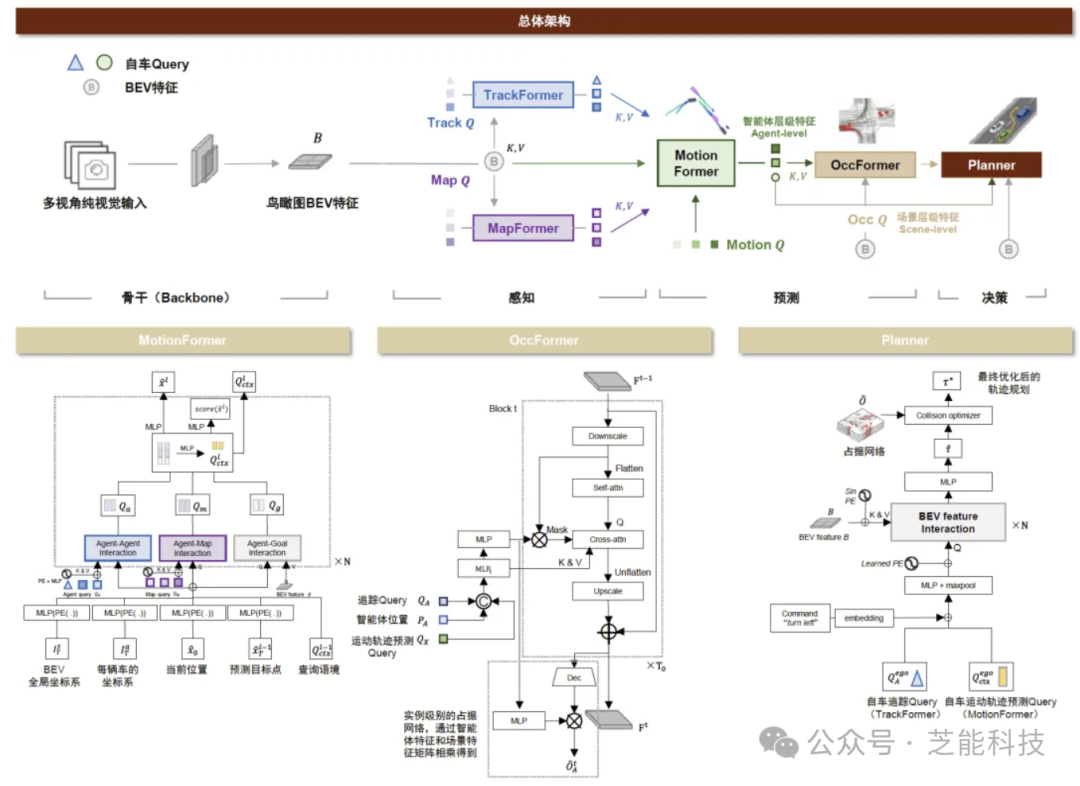

●在智能驾驶领域,Transformer架构被广泛应用于感知、预测和决策等各个环节。

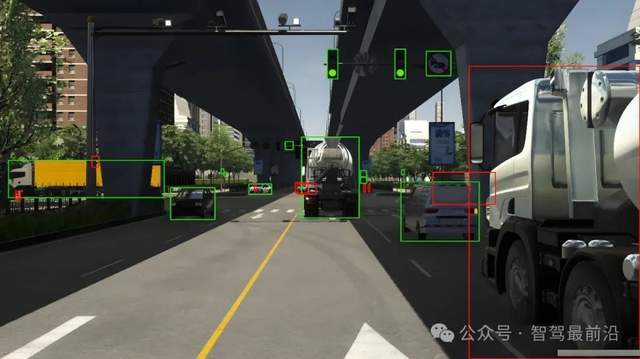

●在感知环节,Transformer架构可以用于构建多模态融合的感知模型,将摄像头、雷达、激光雷达等传感器获取的感知信息进行融合,以获得更加完整和准确的环境感知结果;

●在预测环节,Transformer架构可以用于构建时空预测模型,预测未来道路上的行人和车辆运动轨迹,以帮助自动驾驶系统提前规划行驶路径;

●在决策环节,Transformer架构可以用于构建多模态决策模型,综合考虑环境感知、交通规则和驾驶策略等因素,做出最优的控制决策。

什么是端到端智能驾驶?

端到端智能驾驶致力于将独立的感知、预测、决策等模块融合成一个统一的模型,使信息能够在模型的各个部分进行流动,从而实现更优化的决策。端到端智能驾驶具有以下优势:

●提升效率: 端到端模型可以避免中间结果的存储和传输,减少计算冗余,提高整体效率。

●增强鲁棒性: 端到端模型可以使各个模块之间相互协作,共同应对复杂场景,提高系统的鲁棒性。

●降低成本: 端到端模型可以减少模型的数量和复杂度,降低软硬件成本。

然而,端到端智能驾驶也面临着以下挑战:

●可解释性: 端到端模型的内部结构较为复杂,难以解释其决策过程,这可能会导致安全隐患。

●鲁棒性: 端到端模型对训练数据的依赖性较大,如果训练数据存在偏差或不足,可能会导致模型泛化能力差,在实际应用中表现不佳。

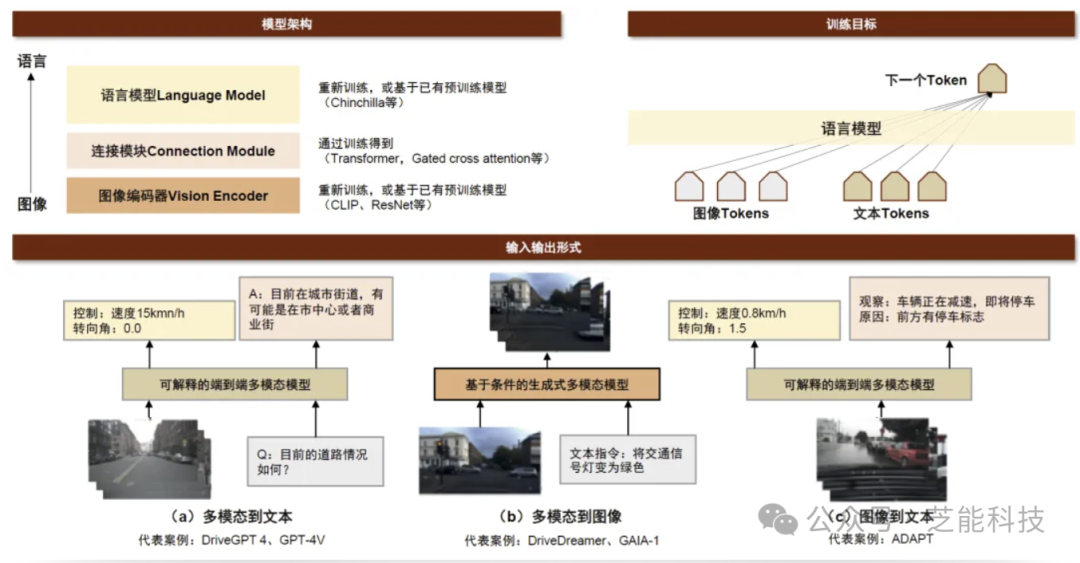

02 什么是多模态智能驾驶

多模态智能驾驶旨在融合视觉、听觉、语言等多种传感器信息,以提升感知和决策的鲁棒性。

多模态智能驾驶可以克服单一传感器感知信息不足、鲁棒性差等缺点,为自动驾驶系统提供更加全面和可靠的环境感知。

多模态大模型可以嫁接大语言模型已涌现的上下文学习、零样本学习、逻辑推理、常识判断等能力,提高智能驾驶面对复杂场景的泛化性与可解释性。

例如,通过视觉和激光雷达传感器可以获取车辆周围的静态环境信息,通过听觉传感器可以获取周围车辆的喇叭声、引擎声等动态信息,通过语言传感器可以理解交通指示牌、语音导航指令等信息。

这些信息经过多模态大模型的融合处理,可以使自动驾驶系统更加准确地理解周围环境,并做出更合理的决策。

什么是世界模型?

世界模型是一种用于描述和预测驾驶环境的模型,它可以帮助自动驾驶系统提前规划行驶路径,并应对突发情况。

世界模型通常包含以下要素:

●静态地图: 静态地图描述了道路的结构、车道线、交通标志等信息。

●动态信息: 动态信息描述了道路上行驶的车辆、行人、障碍物等信息。

●交通规则: 交通规则描述了道路行驶的基本规则,例如红灯停绿灯行、限速等。

世界模型的构建通常需要大量的驾驶数据和先进的模型训练方法。例如,可以利用来自摄像头、雷达、激光雷达等传感器的感知数据,以及来自高精度地图、交通信息等数据,来训练世界模型。

还有哪些前沿技术?

除了上述几项主要方向之外,还有SAM、NeRF等其他前沿技术也被应用于智能驾驶大模型中,这些技术有望进一步提升智能驾驶系统的性能和能力。

●SAM(Self-Attention Mapping):SAM是一种基于自注意力机制的时空感知模型,可以有效地捕捉环境中的动态变化,并预测未来环境的演化趋势。

●NeRF(Neurual Radiance Fields):NeRF是一种基于神经网络的渲染技术,可以利用稀疏的观测数据生成逼真的三维场景重建,为自动驾驶系统提供更加沉浸式的环境感知。

小结

智能驾驶大模型是智能驾驶领域近年来最具前瞻性的研究方向之一,智能驾驶大模型也面临着一些挑战,例如模型的复杂度、训练数据的需求量、伦理问题等。 智能驾驶大模型代表了自动驾驶技术发展的未来趋势。

-

人工智能

+关注

关注

1821文章

50485浏览量

267632 -

智能驾驶

+关注

关注

5文章

3073浏览量

51410 -

深度学习

+关注

关注

73文章

5613浏览量

124728 -

自动驾驶系统

+关注

关注

0文章

70浏览量

7346 -

大模型

+关注

关注

2文章

3857浏览量

5289

原文标题:芝能智驾 | 什么是智能驾驶大模型?

文章出处:【微信号:QCDZSJ,微信公众号:汽车电子设计】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

如何构建适合自动驾驶的世界模型?

自动驾驶BEV Camera数据采集系统:高精度时间同步解决方案

端到端自动驾驶相较传统自动驾驶到底有何提升?

如何确保自动驾驶汽车感知的准确性?

决定自动驾驶激光雷达感知质量的因素有哪些?

自动驾驶感知系统如何设计才能确保足够安全?

低速自动驾驶与乘用车自动驾驶在技术要求上有何不同?

自动驾驶中常提的世界模型是个啥?

智能驾驶大模型:有望显著提升自动驾驶系统的性能和鲁棒性

智能驾驶大模型:有望显著提升自动驾驶系统的性能和鲁棒性

评论