电子发烧友网报道(文/李弯弯)当地时间5月13日,OpenAI举行春季发布会,宣布将推出桌面版ChatGPT,并发布全新旗舰AI模型GPT-4o。

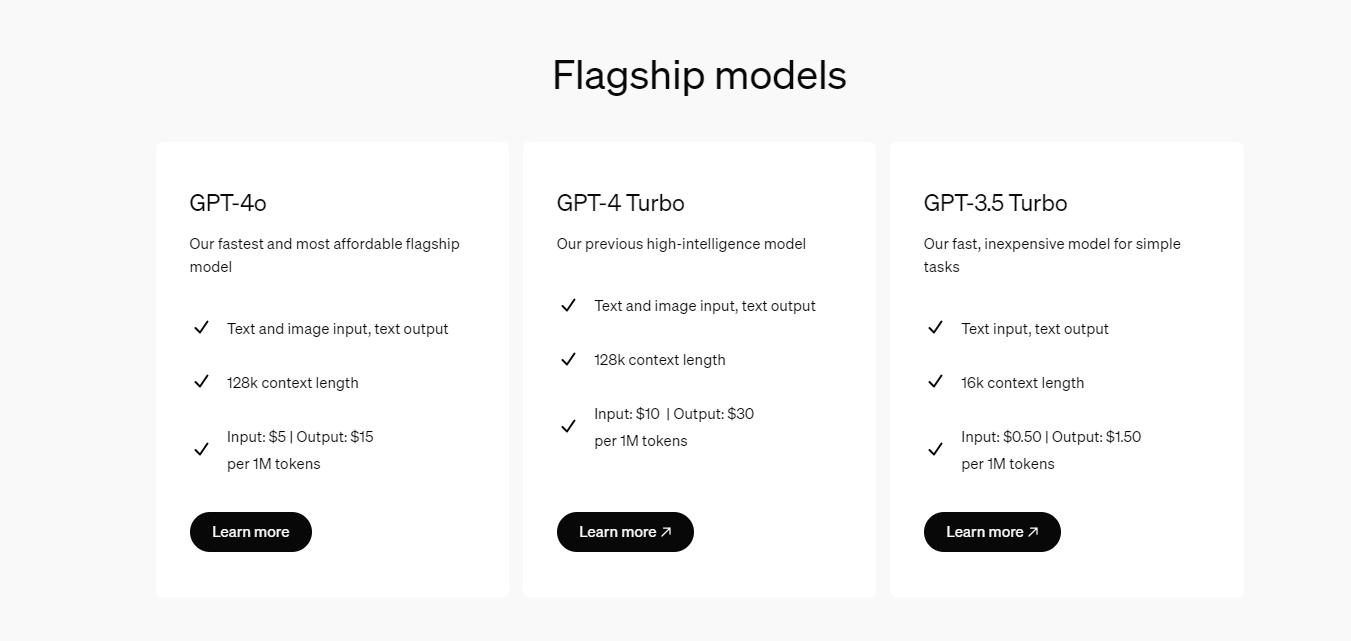

根据OpenAI官方网站介绍,GPT-4o中的“o”代表Omni,也就是“全能”的意思。GPT-4o文本、推理、编码能力达到GPT-4 Turbo水平,速度是上一代AI大模型GPT-4 Turbo的两倍,但成本仅为GPT-4 Turbo的一半,视频、音频功能得到改善。

GPT-4o速度更快,且能感知用户情绪

根据OpenAI介绍,GPT-4o与GPT-3.5、GPT-4的语音对谈机制不同。GPT-3.5和GPT-4会先将音频转换为文本,再接收文本生成文本,最后将文本转换为音频,经历这三个过程,音频中的情感表达等信息会被折损,而GPT-4o是跨文本、视觉和音频的端到端模型,是OpenAI第一个综合了这些维度的模型,可更好进行对谈。

OpenAI技术负责人Mira Murati表示:“这是我们第一次在易用性方面真正迈出的一大步。”OpenAI研究员Mark Chen表示,新模型具有“感知情绪”的能力,能输出笑声、歌唱或表达情感,还可以处理用户打断它的情况。

GPT-4o极大地改进了OpenAI的AI聊天机器人ChatGPT的体验。在发布会上,OpenAI研究主管Mark Chen和OpenAI的后训练团队负责人Barret Zoph通过现场演示展示出了新模型GPT-4o的强大。

如在演示对话中,Mark Chen表现得有点紧张,然后开始急促地呼吸。当GPT-4o听到Chen过度呼气时,它似乎从中察觉到了他的紧张,并说到:别紧张,你喘得像个吸尘器,深呼吸,再吐气。接着GPT开始指导Chen怎么深吸慢呼平复心情。

在另一段对话演示中,Chen让GPT给Zoph讲个睡前故事哄他入睡,Chen反复打断GPT的讲述,问它能不能讲得更刺激点,最后GPT用非常迪士尼的方式唱出了一个故事。

GPT-4o还可以通过视觉识别检测人的情绪。在一个演示中,Zoph将手机举到自己面前正对着脸,要求ChatGPT告诉他自己长什么样子。GPT-4o注意到了Zoph脸上的微笑,对他说:“看起来你感觉非常快乐,喜笑颜开。”

GPT-4o也能够进行实时快速翻译,OpenAI技术负责人Mira Murati在现场对ChatGPT说起了意大利语,GPT则将她的话翻译成英语。

OpenAI首席执行官山姆·奥特曼(Sam Altman)表示,新的语音和视频模式是他用过的最好的电脑界面,感觉就像电影里的AI。达到人类水平的反应时间和表达能力是一个很大的变化。

Sam Altman谈到:“对我来说,与电脑交谈从来都不是一件很自然的事,现在它做到了。随着我们增加(可选的)个性化、访问你的信息、代表你采取行动的能力等等,我真的可以看到一个令人兴奋的未来,我们能够使用计算机做比以往任何时候都多的事情。”

GPT-4o功能未来将会进一步发展

自发布之日,GPT-4o可在ChatGPT的免费版本中使用,并提供给OpenAI的高级ChatGPT Plus和Team计划订户,具有“5倍更高”的消息限制。OpenAI指出,当用户达到速率限制时,ChatGPT将自动切换到GPT-3.5。

OpenAI称,基于GPT-4o的ChatGPT文本和图像输入功能将于本周一上线,语音和视频选项将在未来几周内推出。另外,OpenAI将在未来1个月左右向Plus用户推出基于GPT-4o改进的语音体验,目前GPT-4o的API并不包含语音功能。

OpenAI指出,在API使用方面,相比去年11月发布的GPT-4-turbo,GPT-4o价格降低一半。成本下降对于大模型的调用至关重要。OpenAI开始致力于将大模型推向市场。

另外据Murati介绍,GPT-4o的功能在未来将会进一步发展。比如,尽管目前GPT-4o可以查看不同语言的菜单照片并进行翻译,但未来,该模型可能使ChatGPT能够观看直播的体育比赛并向您解释规则。

Murati表示:“我们知道这些模型变得越来越复杂,但我们希望交互体验实际上变得更加自然、简单,您不需要关注UI,而只需专注于与ChatGPT的合作。”

对于大家一直关注的安全性问题,OpenAI也重点提及。据称,通过过滤训练数据和训练后改进模型行为等技术,GPT-4o在设计中内置了跨模式的安全性,并创建了新的安全系统,为语音输出提供护栏。

GPT-4o还与来自社会心理学、偏见和公平、错误信息等领域的70多名外部专家开展广泛的外部合作,以识别新增加的模式引入或放大的风险,提高与GPT-4o互动的安全性。

OpenAI表示,将继续减少新发现的风险。由于认识到GPT-4o的音频模式存在各种新的风险,目前公开的是文本和图像输入以及文本输出,在接下来的几周和几个月里将围绕技术基础设施、训练后的可用性、发布其他模式所需的安全性开展工作,例如音频输出将仅限于选定的预设声音,并将遵守现有安全政策。

写在最后

可以看到,大模型技术正在快速发展,而OpenAI新模型GPT-4o无疑又将大模型技术和应用推向了一个新高度。目前全球科技厂商都在积极角逐,微软、谷歌等头部企业都纷纷召开发布会,密集推出大模型产品,苹果传言也已与OpenAI达成协议,在 iPhone使用其技术。不难看到,接下来大模型无论是在技术升级还是应用落地上都将会呈现一番新景象。

-

GPT

+关注

关注

0文章

352浏览量

15342 -

OpenAI

+关注

关注

9文章

1079浏览量

6480 -

ChatGPT

+关注

关注

29文章

1558浏览量

7593 -

AI大模型

+关注

关注

0文章

315浏览量

305

发布评论请先 登录

相关推荐

解锁 GPT-4o!2024 ChatGPT Plus 代升级全攻略(附国内支付方法)

OpenAI解锁GPT-4o定制功能,助力企业精准优化AI应用

OpenAI提前解锁GPT-4o语音模式,引领对话新纪元

OpenAI 推出 GPT-4o mini 取代GPT 3.5 性能超越GPT 4 而且更快 API KEY更便宜

OpenAI发布高性价比小型AI模型GPT-4o mini

国内直联使用ChatGPT 4.0 API Key使用和多模态GPT4o API调用开发教程!

OpenAI 深夜抛出王炸 “ChatGPT- 4o”, “她” 来了

GPT-4o更像“人”,AI“疾步”走向商业化应用

OpenAI发布全新GPT-4o模型

OpenAI正式推出GPT-4o模型,支持实时音频、视觉和文本推理处理

OpenAI推出面向所有用户的AI模型GPT-4o

GPT-4o深夜炸场!AI实时视频通话丝滑如人类,Plus功能免费可用

OpenAI全新GPT-4o能力炸场!速度快/成本低,能读懂人类情绪

OpenAI全新GPT-4o能力炸场!速度快/成本低,能读懂人类情绪

评论