5 月 28 日,微软在 Build 2024 大会上推出了最新的 Phi-3 系列成员——Phi-3-vision。这一工具主打视觉应用,能有效处理图片文字信息,且在移动设备上也能运行自如。

Phi-3-vision 是一种小型多模式语言模型(SLM),主要适用于本地人工智能场景。其模型参数高达 42 亿,上下文序列包含 128k 个符号,可满足各种视觉推理和其他任务需求。

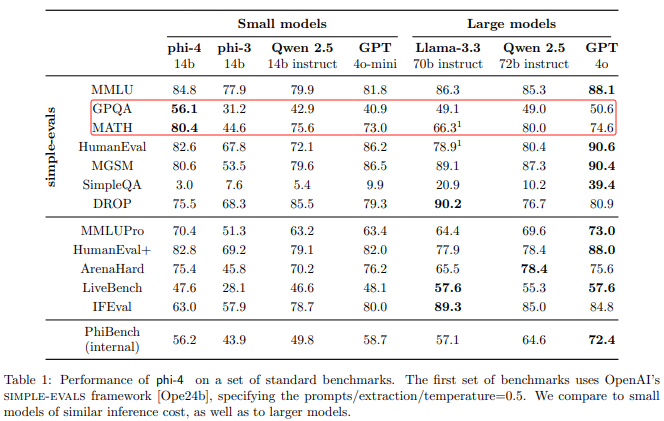

Microsoft 通过一篇新发表的论文[PDF]展示了 Phi-3-vision 的强大实力。与其他模型如 Claude 3-haiku、Gemini 1.0 Pro 相比,Phi-3-vision 毫不逊色。

此外,Microsoft 还对 Phi-3-vision 进行了多项测试,并将其与其他竞品模型进行了比较,包括字节跳动的 Llama3-Llava-Next(8B)、微软研究院与威斯康星大学、哥伦比亚大学联合开发的 LlaVA-1.6(7B)以及阿里巴巴通义千问 QWEN-VL-Chat 模型等。结果表明,Phi-3-vision 在多个项目中的表现均十分出色。

-

微软

+关注

关注

4文章

6642浏览量

104804 -

人工智能

+关注

关注

1800文章

48062浏览量

242004 -

语言模型

+关注

关注

0文章

550浏览量

10410

发布评论请先 登录

相关推荐

字节跳动发布豆包大模型1.5 Pro

虹软AI视觉赋能雷鸟V3 AI拍摄眼镜发布

Meta发布新AI模型Meta Motivo,旨在提升元宇宙体验

微软预览版Copilot Vision AI功能上线

AI干货补给站04 | 工业AI视觉检测项目实施第三步:模型构建

微软发布Azure AI Foundry,推动云服务增长

在英特尔酷睿Ultra7处理器上优化和部署Phi-3-min模型

微软发布PhI-3-Vision模型,提升视觉AI效率

微软发布PhI-3-Vision模型,提升视觉AI效率

评论