作者:Bob Siller,Achronix半导体产品营销总监

摘要:本文根据完整的基准测试,将Achronix Semiconductor公司推出的Speedster7t FPGA与GPU解决方案进行比较,在运行同一个Llama2 70B参数模型时,该项基于FPGA的解决方案实现了超越性的LLM推理处理。

采用 FPGA器件来加速LLM性能,在运行 Llama2 70B参数模型时,Speedster7t FPGA如何与 GPU解决方案相媲美?证据是令人信服的——Achronix Speedster7t FPGA通过提供计算能力、内存带宽和卓越能效的最佳组合,在处理大型语言模型(LLM)方面表现出色,这是当今LLM复杂需求的基本要求。

像 Llama2这样的 LLM的快速发展正在为自然语言处理(NLP)开辟一条新路线,有望提供比以往任何时候都更像人类的交互和理解。这些复杂的 LLM是创新的催化剂,推动了对先进硬件解决方案的需求,以满足其密集处理需求。

我们的基准测试突出了 Speedster7t系列处理 Llama2 70B模型复杂性的能力,重点关注 FPGA和 LLM性能。这些测试(可根据要求提供结果)显示了Achronix FPGA对于希望将LLM的强大功能用于其NLP应用程序的开发人员和企业的潜力。这些基准测试展示了 Speedster7t FPGA如何超越市场,提供无与伦比的性能,同时降低运营成本和环境影响。

Llama2 70B LLM运行在 Speedster7t FPGA上

2023年 7月,Microsoft和 Meta推出了他们的开源 LLM,Llama2开创了 AI驱动语言处理的新先例。Llama2采用多种配置设计,以满足各种计算需求,包括 700亿、130亿和 700亿个参数,使其处于 LLM创新的最前沿。Achronix和我们的合作伙伴 Myrtle.ai对700亿参数的Llama2模型进行了深入的基准分析,展示了使用Speedster7t FPGA进行LLM加速的优势。

基准测试结果:Speedster7t FPGA与业界领先的 GPU对比

我们在 Speedster7t FPGA上测试了 Llama2 70B模型的推理性能,并将其与领先的 GPU进行了比较。该基准测试是通过对输入、输出序列长度(1,128)和批处理大小 =1进行建模来完成的。结果表明,Speedster7t AC7t1500在LLM处理中的有效性。

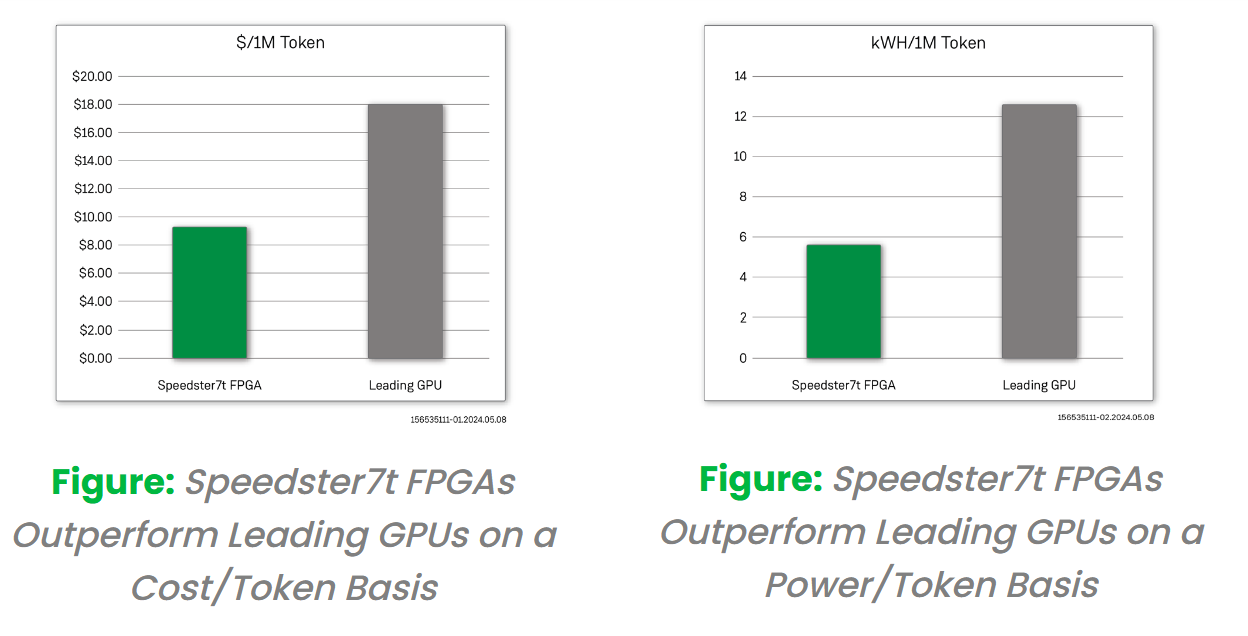

FPGA成本基于由 Speedster7t FPGA提供支持的 VectorPath加速卡的标价。同样,我们在此分析中使用了可比GPU卡的标价。使用这些成本信息和每秒产生的输出令牌数量,我们计算出基于 FPGA的解决方案的 $/token提高了 200%。除了成本优势外,在比较 FPGA和 GPU卡的相对功耗时,我们观察到与基于 GPU的解决方案相比,产生的 kWh/token提高了 200%。这些优势表明 FPGA如何成为一种经济且能效高效的 LLM解决方案。

面向 LLM的 FPGA:Speedster7t的优势

Achronix Speedster7t系列FPGA旨在优化LLM操作,平衡LLM硬件的关键要求,包括:

高性能计算 –具有高性能计算能力的尖端硬件对于管理 LLM推理核心的复杂矩阵计算至关重要。

高带宽内存 –高效的 LLM推理依赖于高带宽内存,通过模型的网络参数快速馈送数据,而不会出现瓶颈。

扩展和适应能力 –现代 LLM推理需要能够随着模型规模的增长而扩展并灵活适应 LLM架构的持续进步的硬件。

高能效处理 –可持续的 LLM推理需要硬件能够最大限度地提高计算输出,同时最大限度地降低能耗,从而降低运营成本和环境影响。

Speedster7t FPGA提供以下功能,以应对实施现代 LLM处理解决方案的挑战:

计算性能–通过其灵活的机器学习处理器(MLP)模块支持复杂的 LLM任务。

高 GDDR6 DRAM带宽 –确保以 4 Tbps的内存带宽快速处理大型 LLM数据集。

大量的 GDDR6 DRAM容量 –可容纳 Llama2等扩展的 LLM,每个 FPGA的容量为 32 GB。

用于 LLM的集成 SRAM –提供低延迟、高带宽的存储,具有 190 Mb的 SRAM,非常适合存储激活和模型权重。

多种本机数字格式 –适应 LLM需求,支持块浮点(BFP)、FP16、bfloat16等。

高效的片上数据传输 – 2D NoC超过 20 Tbps,简化片上数据流量。

扩展横向扩展带宽 –支持多达32个112 Gbps SerDes满足 LLM需求,增强连接性。

自适应逻辑级可编程性 –使用 690K 6输入 LUT为 LLM的快速发展做好准备。

针对 LLM推理优化的 FPGA

在快速变化的人工智能和自然语言处理领域,使用 FPGA而不是 GPU来加速 LLM是一个相当新的想法。该基准测试展示了设计人员如何从使用Achronix的FPGA技术中受益。Achronix Speedster7t系列FPGA是这一变化的关键技术,在高性能、高带宽存储器、易于扩展和电源效率之间实现了出色的平衡。

基于详细的基准分析,将 Speedster7t FPGA与领先的 GPU在处理 Llama2 70B模型方面的能力进行比较,结果表明 Speedster7t FPGA能够提供高水平的性能,同时大大降低运营成本和环境影响,突出了它在未来 LLM创建和使用中的重要作用。

如果希望进一步了解如何使用FPGA器件来加速您的LLM程序,以及 FPGA加速 LLM解决方案的未来发展机遇。请联系Achronix,获取详细的基准测试结果,并帮助您确定Achronix FPGA技术如何加速您的LLM设计。

审核编辑 黄宇

-

FPG

+关注

关注

1文章

54浏览量

79970 -

大模型

+关注

关注

2文章

2439浏览量

2676

发布评论请先 登录

相关推荐

FPGA和ASIC在大模型推理加速中的应用

李开复:中国擅长打造经济实惠的AI推理引擎

解决方案丨EasyGo新能源系统实时仿真应用

AMD助力HyperAccel开发全新AI推理服务器

【《大语言模型应用指南》阅读体验】+ 基础知识学习

基于瑞萨RZ/V2H AI微处理器的解决方案:高性能视觉AI系统

STM32如何诠释电机控制创新 如何更高效更智能

Simcenter 车辆能量管理解决方案——使用虚拟原型设计加速创新

采用创新的FPGA 器件来实现更经济且更高能效的大模型推理解决方案

采用创新的FPGA 器件来实现更经济且更高能效的大模型推理解决方案

评论