- 引言

神经网络是一种模拟人脑神经元结构的计算模型,广泛应用于图像识别、自然语言处理、语音识别等领域。在神经网络中,激活函数起着至关重要的作用,它决定了神经元的输出值,进而影响整个网络的性能。本文将详细介绍激活函数的定义、类型。

- 激活函数的定义和基本功能

2.1 定义

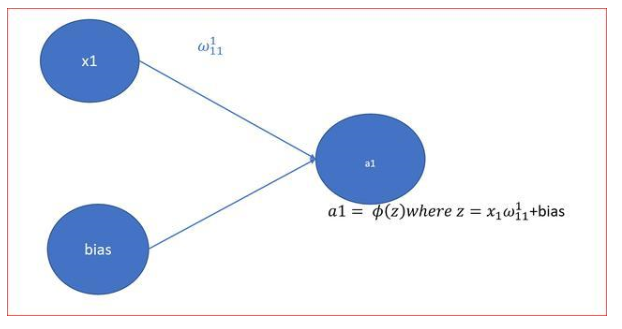

激活函数(Activation Function)是神经网络中的一种非线性函数,用于将输入信号转换为输出信号。在神经网络中,每个神经元的输出都是通过激活函数计算得到的。激活函数的引入使得神经网络能够模拟复杂的非线性关系,从而提高网络的表达能力和性能。

2.2 基本功能

激活函数的基本功能包括以下几点:

(1)引入非线性:激活函数将神经元的线性输出转换为非线性输出,使得神经网络能够模拟复杂的非线性关系。

(2)控制神经元的激活状态:激活函数可以控制神经元的激活状态,即决定神经元是否对输入信号产生响应。

(3)加速收敛:合适的激活函数可以加速神经网络的训练过程,提高收敛速度。

(4)防止梯度消失或爆炸:在神经网络的训练过程中,激活函数可以防止梯度消失或爆炸,从而保证网络的稳定性。

- 常见的激活函数类型

3.1 Sigmoid函数

Sigmoid函数是一种常见的激活函数,其数学表达式为:

f(x) = 1 / (1 + exp(-x))

Sigmoid函数的输出范围在(0, 1)之间,具有S形曲线的特点。Sigmoid函数的优点是平滑且连续,但其缺点是存在梯度消失问题,即当输入值非常大或非常小时,梯度接近于0,导致网络训练速度变慢。

3.2 Tanh函数

Tanh函数(双曲正切函数)是Sigmoid函数的一种变体,其数学表达式为:

f(x) = (exp(x) - exp(-x)) / (exp(x) + exp(-x))

Tanh函数的输出范围在(-1, 1)之间,其形状与Sigmoid函数相似,但中心点在0。Tanh函数的优点是输出值以0为中心,可以减少学习过程中的对称性问题。然而,Tanh函数同样存在梯度消失问题。

3.3 ReLU函数

ReLU函数(Rectified Linear Unit,线性整流单元)是一种常用的激活函数,其数学表达式为:

f(x) = max(0, x)

ReLU函数的优点是计算简单,训练速度快,且在实践中表现出较好的性能。然而,ReLU函数存在“死亡ReLU”问题,即当输入值为负时,梯度为0,导致部分神经元不再更新。

3.4 Leaky ReLU函数

Leaky ReLU函数是对ReLU函数的一种改进,其数学表达式为:

f(x) = max(αx, x)

其中α是一个小于1的常数。Leaky ReLU函数在输入值为负时,仍然有一定的梯度,从而解决了ReLU函数的“死亡ReLU”问题。

3.5 ELU函数

ELU函数(Exponential Linear Unit,指数线性单元)是一种自归一化激活函数,其数学表达式为:

f(x) = x if x > 0 else α(exp(x) - 1)

ELU函数在输入值为正时与线性函数相同,而在输入值为负时,输出值在(-α, 0)之间。ELU函数的优点是可以自动调节神经元的输出值,使得网络在训练过程中更加稳定。

3.6 Softmax函数

Softmax函数常用于多分类问题中,其数学表达式为:

f(x_i) = exp(x_i) / Σ(exp(x_j))

其中x_i和x_j分别表示输入向量的第i个和第j个元素。Softmax函数将输入向量转换为概率分布,使得每个类别的输出值在(0, 1)之间,且所有类别的输出值之和为1。

-

神经网络

+关注

关注

42文章

4785浏览量

101276 -

函数

+关注

关注

3文章

4350浏览量

63051 -

计算模型

+关注

关注

0文章

29浏览量

9876 -

自然语言处理

+关注

关注

1文章

620浏览量

13665

发布评论请先 登录

相关推荐

【PYNQ-Z2试用体验】神经网络基础知识

神经网络移植到STM32的方法

ReLU到Sinc的26种神经网络激活函数可视化大盘点

神经网络初学者的激活函数指南

神经网络初学者的激活函数指南

神经网络中激活函数的定义及类型

神经网络中激活函数的定义及类型

评论