RNN(Recurrent Neural Network,循环神经网络)是一种具有循环结构的神经网络模型,它能够处理序列数据,并对序列中的元素进行建模。RNN在自然语言处理、语音识别、时间序列预测等领域有着广泛的应用。

- RNN的基本概念

1.1 神经网络的基本概念

神经网络是一种受生物神经网络启发的数学模型,它由多个神经元(或称为节点)组成,这些神经元通过权重连接在一起。每个神经元接收输入信号,对其进行加权求和,然后通过激活函数进行非线性变换,生成输出信号。神经网络通过调整神经元之间的权重,学习输入数据与输出数据之间的映射关系。

1.2 RNN的基本概念

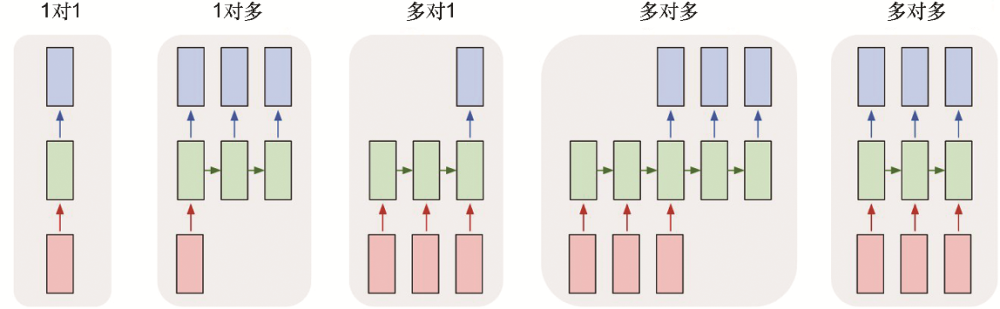

RNN是一种特殊的神经网络,它在网络中引入了循环结构,使得网络能够在时间上传递信息。RNN的每个神经元不仅接收来自前一个神经元的输入,还接收来自自身上一个时间步的输出。这种循环结构使得RNN能够处理序列数据,并对序列中的元素进行建模。

- RNN的工作原理

2.1 循环结构

RNN的循环结构是指网络中的神经元在时间上存在反馈连接。在RNN中,每个神经元的输出不仅作为下一个神经元的输入,还作为自身下一个时间步的输入。这种结构使得RNN能够在时间上传递信息,捕捉序列数据中的动态特征。

2.2 时间步

在RNN中,序列数据被划分为多个时间步,每个时间步对应序列中的一个元素。RNN在每个时间步上进行一次前向传播,计算当前时间步的输出。通过这种方式,RNN能够逐个处理序列中的元素,并在时间上传递信息。

2.3 参数共享

RNN在处理序列数据时,对每个时间步都使用相同的参数集合。这意味着RNN在不同时间步上的权重是共享的,这有助于减少模型的参数数量,提高模型的泛化能力。

2.4 激活函数

RNN中的激活函数用于对神经元的输入进行非线性变换。常用的激活函数包括Sigmoid、Tanh和ReLU等。激活函数的选择对RNN的性能和稳定性具有重要影响。

- RNN的变体

3.1 长短期记忆网络(LSTM)

LSTM是一种改进的RNN模型,它通过引入门控机制解决了RNN在处理长序列数据时的梯度消失问题。LSTM包含三个门:输入门、遗忘门和输出门。输入门控制当前时间步的输入信息;遗忘门控制上一个时间步的信息保留多少;输出门控制当前时间步的输出信息。

3.2 门控循环单元(GRU)

GRU是另一种改进的RNN模型,它简化了LSTM的结构,将LSTM中的遗忘门和输入门合并为一个更新门。GRU通过更新门控制信息的流动,解决了梯度消失问题,同时减少了模型的参数数量。

3.3 双向循环神经网络(Bi-LSTM)

Bi-LSTM是一种双向的RNN模型,它在前向和后向两个方向上处理序列数据。Bi-LSTM在每个时间步上分别计算前向和后向的隐藏状态,然后将这两个隐藏状态合并,作为当前时间步的输出。Bi-LSTM能够捕捉序列数据中的前后依赖关系,提高模型的表达能力。

- RNN的优缺点

4.1 优点

(1)能够处理序列数据,捕捉序列中的动态特征。

(2)具有循环结构,能够在时间上传递信息。

(3)参数共享,减少了模型的参数数量,提高了泛化能力。

(4)存在多种变体,如LSTM和GRU,能够解决梯度消失问题,提高模型性能。

4.2 缺点

(1)训练困难,容易出现梯度消失或梯度爆炸问题。

(2)计算复杂度高,尤其是在处理长序列数据时。

(3)对序列数据的依赖性强,对噪声和异常值敏感。

(4)模型的解释性较差,难以理解模型的决策过程。

- RNN的应用场景

5.1 自然语言处理

RNN在自然语言处理领域有着广泛的应用,如语言模型、机器翻译、文本分类、情感分析等。RNN能够捕捉文本中的语义信息和语法结构,提高自然语言处理任务的性能。

5.2 语音识别

RNN在语音识别领域也取得了显著的成果。通过将语音信号转换为序列数据,RNN能够识别语音中的音素和词汇,实现语音到文本的转换。

-

数据

+关注

关注

8文章

7067浏览量

89127 -

数学模型

+关注

关注

0文章

83浏览量

11945 -

神经网络模型

+关注

关注

0文章

24浏览量

5621 -

rnn

+关注

关注

0文章

89浏览量

6895

发布评论请先 登录

相关推荐

递归神经网络(RNN)原理和模型概述

什么是RNN (循环神经网络)?

rnn是什么神经网络模型

rnn是什么神经网络模型

评论