公共安全,就像是我们这个社会的“免疫力”,可能平时很少注意到它,一旦发生事故,说明危险已至,轻则“感冒”,重则“要命”。

近期发生的一些公共安全事件反映出,安检作为公共安全的防御屏障,是不够的。

比如7月19日,温州医科大学附属第一医院心血管内科的李晟医生,在门诊诊疗过程中,突然遭到一名持刀男子的袭击,经抢救无效不幸去世。更早时候,上海地铁轨交9号线合川路站内的持刀伤人案,则是在过了安检之后的出站验票处发生的。山西临汾铁路侯马西站候车室的水果刀伤人案,同样在站内捅伤两人。

事发之后,有人说,想要杜绝危险物品,安检要做到机场的严格程度,做不到就是形式主义。也有人说,地铁、医院、高铁站的安检进一步加强,通行效率会很低,基本要瘫痪了,还要投入大量安保资源,属于劳民伤财。

种种事件说明,安检可以检测有形的有害物品,却很难检测无形的有害情绪。这些有害情绪,比如极端仇恨、矛盾冲突、报复社会心理等,就像不定时炸弹,一旦爆发就会造成无辜伤亡。

因此,公共安全,不能止于检物。

AI情绪检测,就是一道提升公共安全“免疫力”的无形屏障。

根据科技媒体WIRED报道,目前英国火车站的摄像头,正在使用亚马逊的情绪检测系统,监控火车站内情况。一旦发现情绪异常人员,就会通知工作人员进一步查看。

情绪检测能在对个人隐私数据保护堪称严苛的欧洲国家落地,或许足以说明一些东西。

本文来聊聊,能让一贯保守的英国接受,AI情绪检测究竟做对了什么?必要性又在哪里?

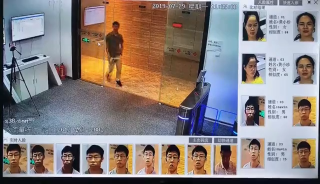

据报道,采用了情绪识别算法的智能摄像头,会被用来检测火车乘客的情绪,通过面部扫描来预测潜在情绪,从而发现盗窃、闯入者等异常行为。

这件事最难的地方,并不是技术,而是如何在人脸识别限制法规最严苛的欧洲国家,接受对公众开展面部检测?

欧洲对面部识别技术在公共场所的应用,经历了一个变化显著的过程:

全面禁止。自2017深度学习技术爆火以来,CV领域的人脸识别成为主流应用之一,而欧洲对此严格监管,在2019年12月出台的《人工智能白皮书(草案)》中,表示在公共场所使用人脸识别技术将被禁止3至5年。

反复摇摆。号称史上最严苛的AI和数据法规颁布之后,就有大量分析师和科技人士表示,这些限制极大地阻碍了欧洲人工智能技术的进步和应用的落地,导致AI产业发展阻滞。但欧洲对此的态度一直比较摇摆,2021年2月的《欧盟数据战略》等文件态度缓和,说会严格限制,但不会全面禁止,到了当年10月又通过决议,禁止警方在公共场所使用面部识别技术。

暂时缓和。最终在今年2024年3月13日,欧洲通过了具有里程碑意义的《人工智能法案》,对面部识别技术的态度有所缓和,禁止了“基于敏感生物特征(如面部识别)进行无目的的大规模监控的应用”,也对该技术的合理使用放了一马。

为什么会对AI情绪检测“特殊对待”呢?

这就要提到公共安全的“不可能三角”:成本、收益、体验。

公共安全“事前预防大于事后补救”。高风险事件一旦发生,“亡羊补牢”的代价往往是人的生命,所以应当采取更严格的事前监管。一般来说,就是安检。

但安检存在一个“不可能三角”,需要在投入成本、安全收益、公众体验之间进行复杂的权衡。

如果安检流程不够敏感,出现“漏检”,会给有害“病毒”可乘之机。而危险群体会对安检系统产生“耐药性”,就像病毒对药物的抵抗能力增强一样,找到安检流程的漏洞进行规避。

但我们也很清楚,在任何场所无差别地采用机场级别的安检水平,进行搜身式的违禁品查验,不仅会影响通行效率和民众出行体验,而且需要更为庞大的安检人员,带来高昂的成本支出,边际收益是很低的。

特别是欧洲的地铁、火车高铁站、景区,此前普遍没有安检,等于向危险品、恐怖威胁“大开方便之门”。而从头推行常态化安检,要从头开始部署安检人员、设备等成本,并教育公众改变长久以来的出行习惯,几乎是不可能被广泛接受的。

这种背景下,AI情绪检测的应用,有望为传统安检的“不可能三角”,找到一种新的解法。

AI情绪检测并不是一项新技术,为什么此时却成了欧洲公共安全的救命稻草?

这要从几个变化说起:

变化一是算法的进步,极大地增加了安全收益。

英国高铁站所采用的情绪检测系统,是亚马逊已经在电商、医疗、公共安全、营销等领域探索多年的Rekognition系统,可以识别包括快乐、悲伤、愤怒、惊讶、厌恶、平静、困惑在内的多种情绪,2023年迭代之后,还可以识别“恐惧”。

比如在电商场景中,通过门店摄像头来判断消费者的情绪,以优化产品陈设;在个人娱乐场景中,亚马逊的Alexa等智能设备可以及时感知用户情绪,当用户处于愤怒或悲伤等负面情绪时,提供安慰或建议。

可以说,目前情感分析和情绪识别的算法已经相当成熟,准确度和检测精度可以达到在公共场所兼顾效率、安全和体验的复杂要求。

变化二是数字社会的持续推进,让AI情绪识别的成本可控。

智慧城市在全球多个国家和区域不断完善,用于城市安防的智能摄像头经过多年迭代,目前技术和产品已经相当成熟。其中,“软件定义”的智能摄像头可以在线加载不同的算法,来实现垂直的智能应用,无需更换硬件就能实现AI情绪检测的更新和升级,也不会带来过高的成本压力。

变化三是近年来,人们对公共安全的担忧和对隐私顾虑的下降,因此对情绪检测的接纳度较好。

随着世界政治局势和经济环境的动荡,很多国家的公众对公共安全的担忧有所增长,尤其是在非法移民增多的欧洲,跨国犯罪和矛盾冲突给公共安全带来了不少威胁。

这种背景下,AI情绪识别不仅能提前检测出潜在的紧张氛围和冲突迹象,避免情绪失控导致的公共安全事件,而且不像暴露面部隐私那样,让人感觉到不舒服。

这是因为,情绪检测所采集的数据并不具有“强识别性”。

正如《隐私的权利》中所说的,隐私是“不被打扰的权利(the right to be left alone)”。相比“强识别性”的人脸识别,公众场所的AI情绪检测并不会在危机尚未暴露时打扰到公众、涉足个人隐私信息,也就是说并不能通过情绪,对自然人进行唯一识别和认证,不会因此知道你姓甚名谁。这就极大地减少了公众的被监视感。

从这个角度说,AI情绪检测在成本、收益、体验上都达到了比较好的平衡,应该成为传统安检之外,一道公共安全的无形屏障。

AI情绪检测,防止恶性极端安全事件,对于整个社会来说,绝对利大于弊。那么,咱们什么时候也能搞起来呢?

坦率地说,目前国内大中型城市的智能安防系统已经做得很不错了,想上线情绪检测算法并不难,难就难在,算法的国产化之路,还得走一阵。

其中最大的障碍,是数据集不够多、不够好。

我采访过一位山东某高校的老师,对方利用深度学习技术,进行微表情的识别算法开发。微表情的特点是持续的时间非常短、运动幅度的变化较小、难以掩饰和抑制,所以很适合用来进行潜在危险人员的情绪检测。

微表情需要心理学实验来采集,再通过计算机进行分析处理。需要先给受试者看一些心理学家论证好的刺激源,诱发微表情的产生,用一个高速摄像机对着待测者的脸,让计算机把图像一帧一帧存储起来。收集好数据之后,还要进行标注,打上情绪标签,以及时空域特征,就是该表情发生的开始时刻、结束时刻以及高潮时刻。

该老师提到,在其团队建立MMEW数据库之前,针对微表情的研究,缺乏一些特别大的公开数据库,最大的数据库也仅有247个样本,而且图像分辨率不高。

既需要心理学实验,又要计算机工程,既然微表情数据集这么难,为什么要从头开始自己构建呢?

我们知道,情绪表达会受到文化、社会生活等背景的影响。而国际上的情绪图片,大多是基于外国人脸采集的数据,在识别中国面孔的情绪状态、意图和行为时,未必会很准确。所以,AI情绪检测在公共安防领域的真正应用,还需要从扎实构建国产高质量数据集做起。

另一个问题就是,有了算法,谁来卖?

更准确的说法是,谁来提供算力和一系列配套服务。情绪识别是一个复杂的过程,需要强大的计算能力来快速分析海量数据,并实时反馈情绪识别结果,对算力有着极高的需求。此外,AI是一个持续演进的技术,情绪检测模型需要不断学习和优化,以提高识别的准确性和泛化能力。以英国高铁站落地的Rekognition系统为例,是亚马逊AWS推出的云服务之一,在云端进行学习、分析和功能性改进。

而在国内,因为涉及公众信息数据,一定是私有化本地部署,最终核心竞争力的还是算法技术和ToB服务能力。所以,国内CV算法公司会比云厂商在该市场更具竞争力,但如何解决算力的成本问题、服务的人效问题,是算法公司长期存在的难题,需要更精巧合理的商业设计。

九层之台,起于垒土。尽管AI情绪检测的国产化之路,还有待从数据、算法、商业等层面一点点夯实,但用技术来提升公共安全“免疫力”,避免恶性安全事故,取得成本、效益、体验的平衡,应该逐步成为整个社会的共识和目标。

人是目的,而技术是手段。

捍卫人们生命权的技术,理应获得发展权,即使是对新技术极尽严苛的欧洲,这或许是AI情绪检测落地带给我们的最大启示。

审核编辑 黄宇

-

AI

+关注

关注

87文章

30728浏览量

268886 -

人脸识别

+关注

关注

76文章

4011浏览量

81859

发布评论请先 登录

相关推荐

带阻滤波器在人脸识别中的应用

人脸识别技术的可行性在于矛盾具有什么性

人脸识别模型训练是什么意思

人脸检测和人脸识别的区别是什么

人脸检测与识别的方法有哪些

人脸识别门禁方案:轻松实现刷脸开门、闸机及考勤管理

无形的安检:当全面禁止人脸识别的欧洲开始“由脸观心”

无形的安检:当全面禁止人脸识别的欧洲开始“由脸观心”

评论