电子发烧友网报道(文/李弯弯)7月30日消息,苹果公司周一在一篇技术论文中表示,支撑其人工智能系统Apple Intelligence的两个人工智能模型是在谷歌设计的云端芯片上进行预训练的。这表明,在训练尖端人工智能方面,大型科技公司正在寻找英伟达以外的替代品。

不断迭代的谷歌TPU芯片

随着机器学习算法,特别是深度学习算法在各个领域的广泛应用,对于高效、低功耗的AI计算硬件需求日益增长。传统的CPU和GPU在处理这些算法时存在效率较低的问题,促使谷歌等科技巨头开始探索专用AI加速芯片的研发。

谷歌在2015年左右开始规划开发新的专用架构处理器,旨在优化机器学习算法中的张量运算执行过程。经过快速迭代和研发,谷歌于2016年发布了首个TPU版本(TPU v1),专门用于大规模机器学习加速。

TPU v1部署于数据中心,用于加速神经网络的推理阶段。拥有65536个8-bit MAC(矩阵乘单元),峰值性能为92 TOPS(每秒万亿次操作),以及28 MiB的片上内存空间。相比于CPU和GPU,TPU v1在响应时间和能效比上表现出色,能够显著提升神经网络的推理速度。

随着技术的不断进步,谷歌相继推出了多个TPU版本,不断提升性能和功能。例如,TPU v2和TPU v3被设计为服务端AI推理和训练芯片,支持更复杂的AI任务。TPU v4则进一步增强了扩展性和灵活性,支持大规模AI计算集群的构建。

在面对争议和质疑后,谷歌推出了TPU v5e版本。TPU v5e在架构上进行了调整,采用单TensorCore架构,并在INT8峰值算力上有所提升。尽管在BF16峰值算力上略低于前代版本,但TPU v5e更适用于推理任务,并体现了谷歌在AI算力服务市场的战略选择。

在今年5月的I/O开发者大会上,谷歌又发布了第六代张量处理单元 (TPU) ,称为Trillium。Trillium TPU 可以更快地训练下一波基础模型,并以更少的延迟和更低的成本为这些模型提供服务。至关重要的是,Trillium TPU 的能效比 TPU v5e 高出 67% 以上。

值得一提的是,Trillium 可以在单个高带宽、低延迟 Pod 中扩展到多达 256 个 TPU。除了这种 Pod 级可扩展性之外,借助多切片技术和Titanium 智能处理单元 (IPU ),Trillium TPU 还可以扩展到数百个 Pod,从而连接建筑物级超级计算机中的数万个芯片,这些芯片通过每秒数 PB 的速度互连数据中心网络。

谷歌表示,Trillium TPU 将为下一波 AI 模型和代理提供动力,包括自动驾驶汽车公司Nuro、药物发现公司Deep Genomics、德勤等企业也采用其TPU产品进行应用。

越来越多企业使用谷歌TPU芯片满足AI计算

据谷歌官方信息,其最新TPU的运行成本每小时不足2美元,但客户需提前三年预订以确保使用。自2015年专为内部工作负载设计的TPU问世以来,谷歌于2017年将其向公众开放,如今,TPU已成为人工智能领域最为成熟和先进的定制芯片之一。

谷歌在其多个设施中使用了自研的TPU(Tensor Processing Unit)芯片。谷歌云平台广泛使用了TPU芯片来支持其AI基础设施。这些芯片被用于加速机器学习模型的训练和推理过程,提供高性能和高效的计算能力。通过谷歌云平台,用户可以访问到基于TPU芯片的虚拟机实例(VM),用于训练和部署自己的机器学习模型。

除此之外,已经有多家公司使用谷歌的TPU芯片,如苹果,苹果在最新发表的技术论文中承认,公司采用了谷歌张量处理单元(TPU)训练其人工智能模型。

在周一发布的技术论文中,苹果详细介绍为支持苹果个人智能化系统Apple Intelligence而开发了一些基础语言模型,包括一个用于在设备上高效运行的约30亿参数模型——端侧“苹果基础模型”(AFM),以及一个为苹果云端AI架构“私有云计算”(Private Cloud Compute)而设计的大型服务器语言模型——服务器AFM。

苹果披露,训练模型采用了谷歌研发的第四代AI ASIC芯片TPUv4和更新一代的芯片TPUv5。苹果在8192块TPUv4 芯片上从无到有训练服务器AFM,使用4096的序列长度和4096个序列的批量大小,进行6.3万亿token训练。端侧AFM在2048块TPUv5p芯片上进行训练。

此外,Anthropic这家被誉为“OpenAI劲敌”的人工智能初创公司,据悉是谷歌TPU芯片的早期用户之一。Anthropic使用谷歌Cloud TPU v5e芯片为其大语言模型(LLM)Claude提供硬件支持,以加速模型的训练和推理过程。Hugging Face和AssemblyAI这两家同样在人工智能领域备受瞩目的初创公司也在大规模使用谷歌TPU芯片来支持其AI应用。

另外,许多科研机构也在使用谷歌TPU芯片来支持其AI相关的研究项目。这些机构可以利用TPU芯片的高性能计算能力来加速实验过程,推动科研进展。一些教育机构也将谷歌TPU芯片用于教学和培训目的,帮助学生和研究人员学习和掌握机器学习技术。

写在最后

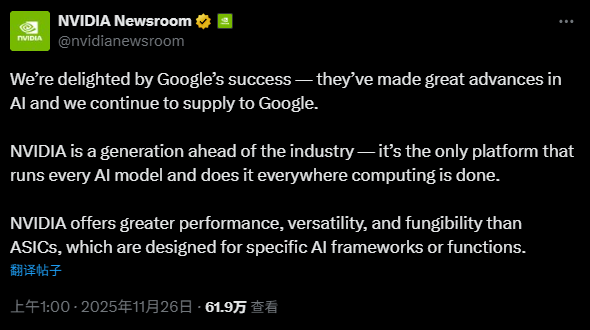

长期以来,英伟达的高性能GPU在高端人工智能模型训练市场占据主导地位,包括OpenAI、微软、Anthropic在内的多家科技公司纷纷采用其GPU来加速模型训练。但在过去几年里,英伟达GPU始终供不应求,为此谷歌、Meta、甲骨文及特斯拉等企业都在自研芯片,以满足各自人工智能系统与产品开发的需求。

不仅如此,如谷歌,虽然TPU最初是为内部工作负载而创建,而其凭借着诸多优势,现在正得到更广泛的应用。随着人工智能技术的不断发展和市场的不断扩大,未来可能会有更多的企业选择使用谷歌TPU芯片来满足其AI计算需求。

-

谷歌

+关注

关注

27文章

6259浏览量

111969 -

苹果

+关注

关注

61文章

24613浏览量

208739 -

TPU

+关注

关注

0文章

173浏览量

21716

发布评论请先 登录

谷歌发布第八代TPU,训练推理分离,搭载自研CPU

什么是TPU?万协通带你看懂AI算力的“变形金刚”

AI芯片大单!Anthropic从博通采购100万颗TPU v7p芯片

AI硬件全景解析:CPU、GPU、NPU、TPU的差异化之路,一文看懂!

谷歌云发布最强自研TPU,性能比前代提升4倍

拥抱DeepSeek开源生态| 算能TPU接入TileLang,集结北大复旦山大顶尖团队!

TPU无人机油囊:轻量化燃油存储的革命性突破

轻量化革命:TPU油囊为无人机续航解锁30%+减重空间

高分子材料创新应用:TPU油囊技术原理与性能特征全面解读

《AI芯片:科技探索与AGI愿景》—— 深入硬件核心的AGI指南

基于碳纳米材料的TPU导电长丝制备与性能研究

TPU编程竞赛系列|2025中国国际大学生创新大赛产业命题赛道,算能11项命题入选!

智算加速卡是什么东西?它真能在AI战场上干掉GPU和TPU!

从TPU v1到Trillium TPU,苹果等科技公司使用谷歌TPU进行AI计算

从TPU v1到Trillium TPU,苹果等科技公司使用谷歌TPU进行AI计算

评论