“中美AI差距究竟有几年?”这个问题困扰了不少人,也有很多声音尝试将中美AI实力进行比较。其中,算法,一定是评判的首要标准。

中美AI算法究竟是什么水平?我们可以用“第七个烧饼”来理解。

ChatGPT就是AI的“第七个烧饼”。深度学习算法的热潮持续了十多年,终于在LLM(大语言模型)智能涌现之后,看到了实现通用人工智能的曙光。就像一个饥饿的人,连续吃了六个烧饼都没吃饱,直到吃完了第七个烧饼,终于觉得饱了。

OpenAI为代表的美国企业,在底层研发和核心算法上占据领先地位,率先吃到了LLM的“第七个烧饼”。随后,中国也极速跟进了这个领域,很快推出了对标ChatGPT、GPT-4水平的算法模型。

对此,有人欣慰:咱们虽然晚了一步,但也吃到了“第七块烧饼”(中国没有错过大模型的机会)。

有人愤怒:这一次技术突破又是美国公司主导,它们肚子里可比我们多好几块烧饼呢(美国领先我们至少十年)。

有人迷惑:早知道吃第七个烧饼就能饱,前面六个都不应该买(大模型之前的智能化探索全都白干了)。

还有人质疑:中国根本没有能力做烧饼,能吃上是因为别的摊主公开了做烧饼配方(谷歌Transformer、OpenAI GPT-1/GPT-2都是开源的)。

以上不同的情绪,有各自的道理,源于对算法的认知不同。

《终极算法》一书的作者写道:在农业中,人类进行播种,确保种子有足够的水分和营养,然后收割成熟的作物,而这也是机器学习的承诺。算法是种子,数据是土壤,程序是成熟的作物。

算法,就是将大规模数据转换成更合理、更智能决策的复杂程序,模型是它的软件形态。算法模型,是AI产学界最重要的“收成”。

从这个角度看,简单对比中美谁先拿下ChatGPT,其实并没有太大意义。大众真正关心的,是中国有没有让算法这颗“种子”播种、生根、成长、结果的能力,能不能确保中国接下来吃到新算法的第八块、第九块……乃至第N块 “烧饼”,持续满足各行各业享用AI的需求?

要搞清楚这个问题,我们得回到第三次AI浪潮的肇始,回到深度学习算法这颗“种子”刚刚萌芽的时候,看它是如何在中国落地生根的。

今天我们已经知道,深度学习是联结学派的主算法,主导了第三次AI浪潮。

可问题是,深度学习并不是在2011年才横空出世的概念。早在20世纪40-60年代,深度学习的雏形就出现在控制论中。训练多层神经网络的关键技术反向传播算法,是1986年提出的。联结学派,在2006年开始复兴。

那为什么,深度学习在2011年左右,才正式掀起了AI的新高潮呢?

背后有三个要素,构成了深度学习“种子萌芽”的土壤:

- 越来越多的数据量。深度学习算法的中心思想,就是将大量计算单元连接在一起来实现智能行为,这个多层神经网络就类似于大脑的神经元,依靠大数据进行学习和训练,而互联网、智能手机提供了较好的数据基础,2011年谷歌大脑成功识别了一只猫,2012年苹果推出了Siri,成为深度学习算法的先行者。

2.越来越低的错误率,或者说越来越好的模型效果。2012年,多层神经网络Alex Net在ImageNet 大型视觉识别挑战(ILSVRC)中获得冠军,并大幅超越了使用传统机器学习算法的第二名,此后,深度学习每年都赢,证明了该算法的有效性。

3.越来越多的成功应用,深度学习这逐步成为主导算法,被工业界用来解决很多实际问题,与上一代智能产品和应用相结合,让一度停滞不前的语音识别、图像识别、NLP等任务都得到了提高。

大数据、技术能力、智能产品,当时在中国,具备让深度学习萌芽的条件吗?有两股力量可以。一是以BAT为代表的互联网公司,一是科大讯飞为代表的早期AI公司。

BAT为代表的中国互联网公司,拥有海量数据以及国际化视野与人才团队,同时有搜索、语音、电商等数字化业务与应用,拥抱深度学习这一新算法是必然。

2010年,百度成立自然语言处理部,由现任CTO王海峰带领,开始在语言与知识技术上布局,提出了“自然语言立足中国、面向世界一流水平”的定位。2012年,百度积极关注并接触深度学习领域的领军人物Geoffrey Hinton,并于2013年建立了IDL深度学习研究院,2014年又成立了大数据实验室BDL、硅谷人工智能实验室SVAIL。除此之外,腾讯也在2012年成立了优图实验室,阿里巴巴成立了iDST(数据科学与技术研究院)。

另一支探索路线,则是科大讯飞为代表的早期AI公司。

这些公司大多是中国在智能领域的早期探索者,比如科大讯飞成立于1999年,创始人团队主要来自中科大电子工程系人机语音通信实验室。

在2011年之前,科大讯飞就以智能语音技术为核心,进行了一系列技术、产品探索,比如科大讯飞联合高校开发的复杂语音合成、语音识别引擎,就打破了海外厂商的垄断,其语音软件在教育、电信、金融、学习机等领域都有商用。随着深度学习算法在国际上崭露锋芒,科大讯飞有意愿、有能力、有场景,将深度学习与原有的智能语音业务相融合。在2011年上线了中文语音识别DNN系统,2014年启动了“讯飞超脑计划”,探索让“计算机能理解会思考”的感知智能和认知智能。

2023年,面对“中国何时能有类ChatGPT”“中美AI技术代差十年、三十年”的焦虑情绪, BAT、科大讯飞等企业作为中国大模型的第一梯队,很快带来了文心、混元、通义、星火等基础大模型。当然不是靠摘开源的“果子”,而是深度学习算法的“种子”,萌芽之初,就扎根在中国AI的土地上,并持续生长。

深度卷积神经网络(CNN)在图像识别和其他视觉任务中的突出表现,拉开了AI 1.0阶段的帷幕。

具体来说,此前传统的机器学习算法,虽然识别的精度和准确率也在提升,但始终无法同时保证准确率和识别效率,难以达到应用规模。而卷积神经网络CNN由于参数共享和稀疏连接,非常适合处理图像数据,在大规模图像数据上训练得到的深度卷积神经网络模型,可以不断从底层特征中提取更高层的特征(机器看得懂),最终更好地进行下游任务的处理(机器看得到)。

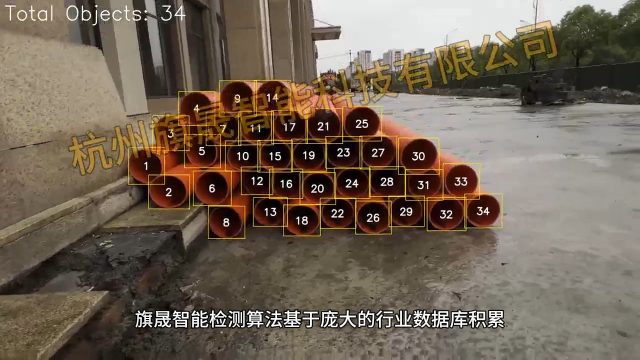

CNN为核心技术,在图像识别、目标检测、图像分割、图像生成等算法方面,带来了极大的进步。2014年,香港中文大学团队让机器在人脸识别任务上的表现第一次超越了人类,被认为AI 1.0阶段的里程碑事件。

叠加智慧城市、智能安防等概念的兴趣,CV计算机视觉飞速发展,成为深度学习最成功的应用领域。

这一阶段,沐浴在新算法春风中茁壮成长的,自然就是CV企业。

2014-2017三年间,旷视科技、商汤科技、依图科技、云从科技相继成立,依托于领先的计算机视觉技术,成为行业领导者和资本市场的宠儿,估值迅速上升,成为大家熟知的“CV四小龙”。它们的算法模型,被广泛应用在城市、安防、医疗影像、工业质检等领域。

当然,除CV之外,我们也不能忽略深度学习算法在NLP、语音、自动驾驶等多个领域中的进展,给许多行业带来了发展动力。

比如长短期记忆网络LSTM大幅提高了语音识别的准确性,智能助手在这一时期内得到了显著的性能提升,海外的苹果Siri、谷歌Google Assistant、亚马逊Alexa、微软Cortana等,国内的百度小度、阿里天猫精灵等,被集成到多种智能终端软硬件当中,并开启了以语音交互为核心的智能家居元年。

自然语言处理方面,循环神经网络(RNN)和LSTM被应用于语言模型、情感分析、机器翻译等NLP任务。比如,这一阶段的机器翻译,就从统计机器翻译(SMT)进入到NWT神经机器翻译时代,可以说是翻天覆地,中国的BAT(百度、阿里、腾讯)、科大讯飞、搜狗等公司,都在各自的产品中部署了NWT,大幅提升了在线翻译的连贯性、准确性和语感。

同时,深度学习还可以在感知和决策方面,为自动驾驶汽车提供支持,吸引了很多投资基金的兴趣,进入了快速发展的黄金时期。百度在2013年启动了自动驾驶汽车项目,2017年推出了Apollo平台,并出现了小马智行等一批面向L4自动驾驶技术的初创公司。

总的来看,AI 1.0阶段,深度学习算法取代了传统机器学习算法,成为这一阶段的主算法,为很多领域的AI任务带来了跨越式发展。

但这一阶段的算法模型开发,仍是“手工作坊模式”,坊间戏称“有多少人工就有多少智能”。依靠对大量数据的依赖,需要组建庞大的标注团队,模型泛化性不足,专为某个特定任务而设计,需要投入开发人员进行大量重复开发和手工迭代优化等。

从“手工业作坊”到“工业化AI工厂”,算法仍需一场嬗变。

凯文凯利说过,技术带来的问题,只能靠技术进步来解决,算法也不例外。

从AI开发,从过去的手工作坊式向工业化升级,预训练模型就是一条可以规模化生产高性能AI模型的“工业生产线”。

2017年,谷歌在论文《Attenlion is All You Needs》提出了Transformer架构。没有使用上一阶段流行的卷积神经网络CNN、循环神经网络RNN、长短期记忆网络LSTM、GRU等结构,仅使用了自注意(Self-attention)特性,引入了注意力机制和预训练模型(PTM)。在机器翻译、机器阅读、自动问答、情绪分析、自动摘要、语言建模等场景,显现出了前所未有的能力。2018年,基于Transformer架构的预训练语言模型BERT,刷新了11项 NLP任务的最优性能纪录。同年,OpenAI推出了GPT-1。

基于Transformer架构的预训练模型,可以通过模型的预先训练,带来效果更好、质量更高的算法模型,下游只需要任务微调就能应用。这种“预制菜”一样的“工业化模式”,一改小模型定制的积弊,让大规模、可复制的AI应用成为可能,成为AI去往下一个时代的必经之路。

迈向预训练模型的这条路上,中国几乎与世界一流水平同步,得益于一个关键变化:云智合流。

打造预训练模型,最困难的一项,就是专用算力不足,有的学校甚至买不起GPU卡,没有AI算力用。同时,这一阶段很多政企用户加速上云,也希望智能化升级,以更便捷的方式获取算法能力。

幸好,在这个算法更迭的关键窗口期,云+AI的融合基础设施,已经在建设中。

2017年,将AI技术作为核心能力的华为云诞生。2018年,百度云更名为百度智能云,阿里云升级为阿里云智能。将AI引入公有云的能力版图,成为主流。

云智合流,让AI开发从“手工业”迈入到“工业化”,将原本散落在算法全生命周期中的各类需求,进行了“融合”:

1.算力融合。预训练模型不仅需要庞大规模的异构算力,而且需要高度的灵活性,从训练到推理的每个步骤,所需要的算力是差异巨大的。通过云厂商的基础设施,企业可以弹性、灵活、按需取用地接入多样、充沛的AI算力。获取算力的方式变得简单、高效、低门槛了,这就让更多人参与到AI算法模型的开发中来,进入大规模生产阶段。

2.流程融合。借助云厂商提供完整、全栈的AI能力和开发工具,包括预制数据集、模型库、算子库等,让企业和开发者可以在云上完成从训练-开发-推理-部署的全部环节。比如百度智能云的EasyDLBML平台、华为云的AI开发生产线ModelArts等。

3.产品融合。时间来到2018年,智慧城市、智慧园区等都开始追求整体智能,希望构建一体化、解决方案式的“AI大脑”,整合算法、芯片、云端算力、框架、网络、IoT等软硬件,实现智慧决策能力的质变。这种情况下,云厂商和AI企业都要把自己变成一个“AI超市”,集成并供应丰富的AI技术能力与应用,让行业用户和开发者可以体系化、轻松地,获取到所需要的AI能力。

比如百度智能云率先在业界提出了“云智一体,深入产业”的主张,发布了200多款产品和数十个解决方案,将百度AI技术释放到金融、物流、工业、农业等多个行业。华为云在2021年启动盘古大模型,并在2022年聚焦行业应用落地,基于盘古大模型的通用能力,打造了盘古气象大模型、盘古矿山大模型、盘古电力大模型、盘古药物分子大模型等。

可以说,云智合流,为中国AI跟上ChatGPT的大模型路线,奠定了基础。

2023年以来,在海外算力形势愈发严峻的背景下,国产预训练大模型依然实现了“井喷”,在文本处理、图像生成、音视频生成、多模态等各个任务中,都完成了占位。放眼全球,唯有中美这两棵繁茂的AI“榕树”。

让深度学习算法的这颗“种子”,在中国扎根、生长、成熟,这本身就是一种能力的自证。

回顾深度学习的十多年历程,或许某一种具体的算法会被更新更好的算法所取代,但这个雨打风吹、反复更替的过程,也让中国AI在时光中变得愈发坚韧,积蓄了经验、汇聚了人才、释放了信心。

只要根深蒂固,任尔东西南北风,中国AI都能在每一次技术趋势中,生长出新的枝丫,结出产业期待的果实。

-

算法

+关注

关注

23文章

4606浏览量

92800 -

AI

+关注

关注

87文章

30639浏览量

268821 -

自然语言处理

+关注

关注

1文章

618浏览量

13545 -

OpenAI

+关注

关注

9文章

1074浏览量

6470 -

ChatGPT

+关注

关注

29文章

1558浏览量

7585

发布评论请先 登录

相关推荐

城西科创大走廊打造“中国AI+”产业地标 “中国云谷”正式启动建设

平衡创新与伦理:AI时代的隐私保护和算法公平

ai大模型和算法有什么区别

AI 大模型,中国如何赢,Haivivi尝试给出答案

主流边缘AI算法,在安防、零售、交通等领域的应用

risc-v多核芯片在AI方面的应用

炬芯科技赵新中:无线音频SoC的AI算法未来和应用

NanoEdge AI的技术原理、应用场景及优势

中国AI长卷(三):算法生根

中国AI长卷(三):算法生根

评论