随着人工智能生成内容(AIGC)的跨越式发展,算力需求呈爆炸式增长,带动了数据中心的功耗和热管理需求的飞速上升。AI模型训练和推理过程中的高计算资源需求,导致服务器发热量大幅增加,对散热技术提出了更高的要求。根据Colocation America发布的数据,2020年全球数据中心单机柜平均功率已经达到16.5kW,比2008年增加了175%。液冷技术因此成为数据中心散热技术的新热点。

在今年的GTC大会上,英伟达不仅展示了B200和GB200芯片,还重点介绍了与其配套的液冷技术。同时,在2024年SIEPR经济峰会上,英伟达CEO黄仁勋透露,下一代DGX GPU服务器将全面采用液冷散热。英伟达的选择也成为行业内的一个风向标,为液冷技术的发展注入了新的动力。

随着AI技术的不断进步,液冷技术的重要性也愈加凸显。液冷技术不仅能够有效降低数据中心的能耗,还能够提高服务器的运行效率,延长设备的使用寿命。因此,液冷技术正逐步成为数据中心散热解决方案的首选。

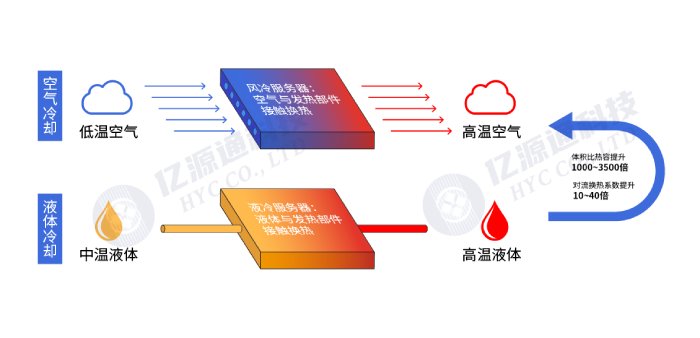

数据中心冷却方式的比较

目前数据中心基础设施的制冷方式主要有风冷和液冷两种方式。液冷技术是指利用液体取代空气作为冷却介质,与服务器发热元器件进行热交换,将服务器元器件产生的热量带走,以保证服务器工作在安全温度范围内的一种冷却方法。风冷技术依赖于风扇和空调系统,通过空气流动带走热量。液冷技术通过液体直接冷却发热器件,液体的导热能力是空气的25倍,液体的体积比热容是空气的1000~3500倍,液体的对流换热系数是空气的10~40倍,同等情况下,液冷的冷却能力远高于空气。

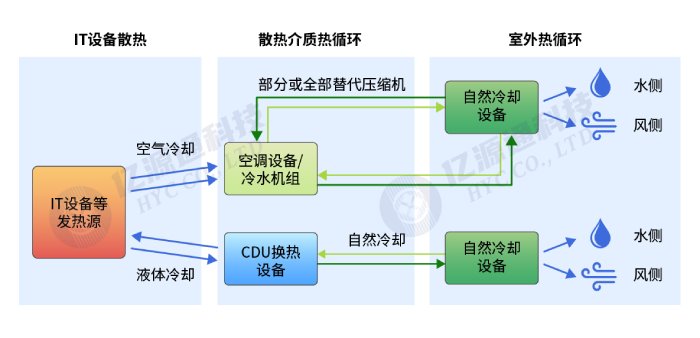

数据中心散热架构图

数据中心散热架构图  数据中心液冷VS风冷

数据中心液冷VS风冷

相比风冷技术,液冷技术具有更高的冷却效率和更低的能耗。在高密度计算环境中,风冷系统往往无法满足散热需求,而液冷技术则能够有效解决这一问题。此外,液冷技术还具有噪音低、占地面积小等优点,非常适合现代数据中心的高密度布局和绿色节能需求。

AI时代下,液冷发展有哪些推动力?

①算力芯片热功率不断攀升,风冷单点散热已达极限

随着AI技术的快速发展,算力需求不断攀升,芯片发热量和热流密度也在不断增加。当芯片长时间处于高温运行状态,会影响其性能及使用寿命,增加故障率。研究表明,当芯片的工作温度接近70-80℃时,温度每升高10℃,芯片性能会降低约50%。当前,Intel多款CPU的TDP已达350W,英伟达的H100达到700W,未来B100或将达到1000W,这已逼近风冷单点散热极限800W。未来计算芯片功耗或将持续增长,而CPU和GPU的整体功耗在AI服务器总功耗中占比达到80%左右,继续采用风冷散热,将导致行间空调需求数量陡增,高密度散热场景下液冷方案成本和性能优势显著。

除了芯片侧,在机柜侧,数据中心单机柜功率密度也在持续上升。传统风冷技术通常可以解决12KW~15KW以内的机柜制冷极限需求,根据 UptimeInstitute 发布的《2022 年全球数据中心调查报告》,英伟达DGX A100服务器的单体最大功率为6.5KW,一个标准的 42U 高度的机柜大约可以放置 5个 5U 高度的 AI 服务器,单机柜总功率超过 20KW。传统的风冷远远无法满足AI服务器机柜的散热需求。

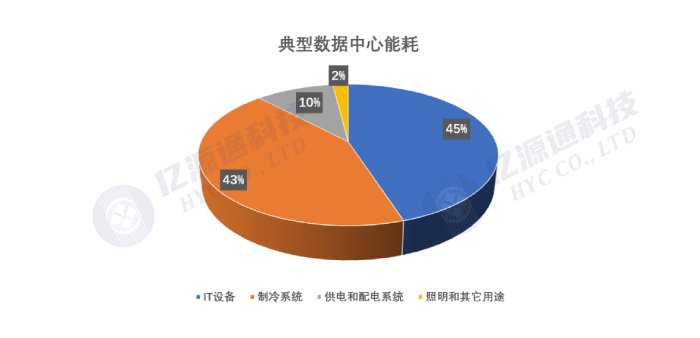

②数据中心节能需求驱动,PUE更高要求

PUE(Power Usage Effectiveness)是评价数据中心能源效率的核心指标,计算公式为 PUE = 数据中心总能耗/IT设备能耗,数值越接近1,数据中心能效越高,PUE的值越高,数据中心的整体效率越低。

数据中心的电能消耗主要由IT设备(45%)、制冷设备(43%)、供配电系统(10%)、照明等(2%)构成。空调系统在数据中心能耗占比仅次于IT设备,在无法升级IT系统时,降低空调系统能耗是重要环节。国内在“双碳” “东数西算” 政策的导向下,可以从近期国家有关部门发布的《绿色数据中心政府采购需求标准(试行)》的通知要求看出对于PUE的要求越来越高,其通知要求采购人采购数据中心相关设备、运维服务时,从2023年6月起数据中心PUE不高于1.4,2025年起数据中心PUE不高于1.3。 根据CDCC与浪潮信息,风冷方案数据中心PUE一般在1.4-1.5左右,而液冷数据中心PUE可降低至1.2以下,采用更加节能、效率较高的液冷散热技术是大势所趋。

数据中心的能源消耗一直是行业关注的焦点,尤其是在全球能源资源紧张和环保意识增强的背景下,提升数据中心的能效显得尤为重要。液冷技术通过更高效的散热方式,减少了空调系统的能耗,从而显著降低了数据中心的PUE值。这不仅有助于降低运营成本,还能够减少碳排放,符合可持续发展的要求。

典型数据中心能耗占比

典型数据中心能耗占比

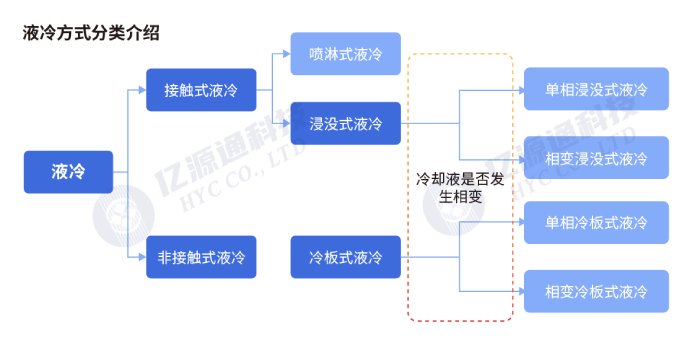

液冷技术的分类

液冷系统根据液体与硬件直接的接触方式分为直接液冷和间接液冷,直接液冷就是液体与需要冷却的硬件组件直接接触达到冷却的目的,又可分为浸没式和喷淋式;间接液冷是指液体不与硬件直接接触,通过一个中介组件(散热器或冷却板)将热量带走达到冷却,一般常见的为冷板式液冷,根据冷却介质是否发生相变又可分为单相冷板式和两相冷板式。

液冷技术的分类

液冷技术的分类

①从冷板到浸没式

冷板式液冷是通过冷板把发热器件的热量传递到冷却液体,通过冷却液体本身的制冷特性将产生的热量带走。工作液体不与电子器件直接接触,该技术对计算机系统改动不大,仅需将原风冷散热片替换为液冷散热套件并将冷媒管路引出机箱即可。适用于中高热流密度散热。

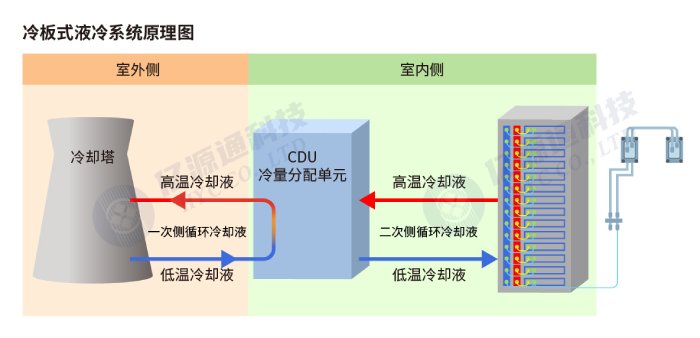

冷板式液冷系统主要由冷却塔、冷量分配单元(CDU)、一次侧&二次侧液冷管路、冷却介质、液冷机柜组成。一次侧是指将二次侧的热量排至室外环境或其他热回收单元的环路;二次侧是指从服务器带走热量并在一次侧进行散热的环路,两个部分中间通过CDU即冷量分配单元来进行换热。

冷板式液冷系统的工作原理相对简单,但在实际应用中,需要考虑冷板的设计、冷却液的选择以及系统的维护等问题。此外,冷板式液冷系统在高热流密度环境中表现出色,非常适合现代数据中心的高密度布局需求。

冷板式液冷系统工作原理

冷板式液冷系统工作原理

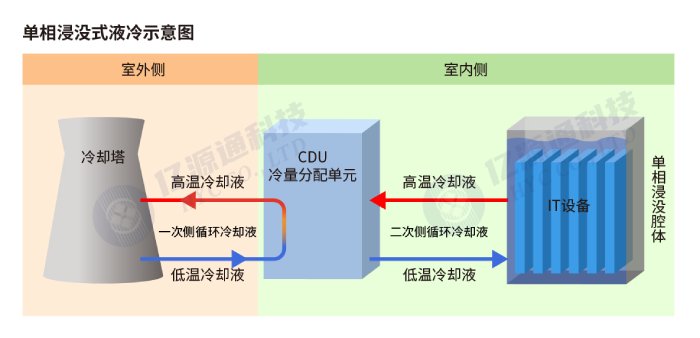

浸没式液冷系统通过直接将发热器件浸入不导电的冷却液中实现高效散热。按照冷却液在循环散热过程中是否发生相变,可以分为单相浸没式液冷和双相浸没式液冷。

单相浸没式液冷技术在交换过程中冷却液温度发生变化而不存在相态转变,过程中完全依靠物质的显热变化传递热量,即利用液体受热后体积膨胀密度减小,较热的冷却液会自然上浮,通过外部冷却回路的热交换器冷却,冷却后的液体在重力作用下自然下沉,以此来完成循环散热。这是其中一个方式,冷却液在循环散热过程中始终保持液态。 双相浸没式液冷的散热过程中冷却液会发生从液态到气态再从气态到液态的相变过程。

浸没式液冷系统包括室内侧与室外侧,室外侧包含冷却塔、一次侧管网、一次侧冷却液;室内侧包含冷量分配单元(CDU)、浸没腔体(Tank机柜)、IT设备、二次侧管网和二次侧冷却液。使用过程中IT设备完全浸没在冷却液中,因此冷却的选择需要考虑不导电液体,例如硅油、氟化液等。

浸没式液冷系统工作原理

浸没式液冷系统工作原理

此外,还有喷淋式液冷,现阶段落地应用较少,不适合高密度服务器和大规模数据中心。短期内,冷板式液冷因技术成熟、与现有系统兼容性好、维护方便和改造成本较低,非常适合AI时代对散热的需求和数据中心从风冷向液冷的过渡阶段。长期看,浸没式液冷凭借其良好的导热性能、高效的余热回收能力和支持更高机柜功率的优势,会更适合未来数据中心冷却需求的演变,尤其是在机柜单元功率不断增加的情况下,浸没式液冷可以提供更高效的冷却解决方案,并且助力降低数据中心的总体能源使用效率(PUE)。

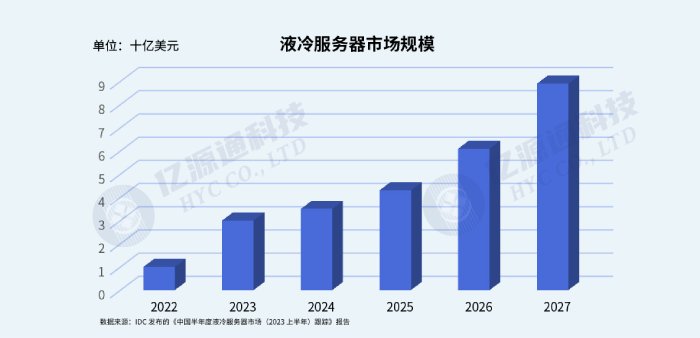

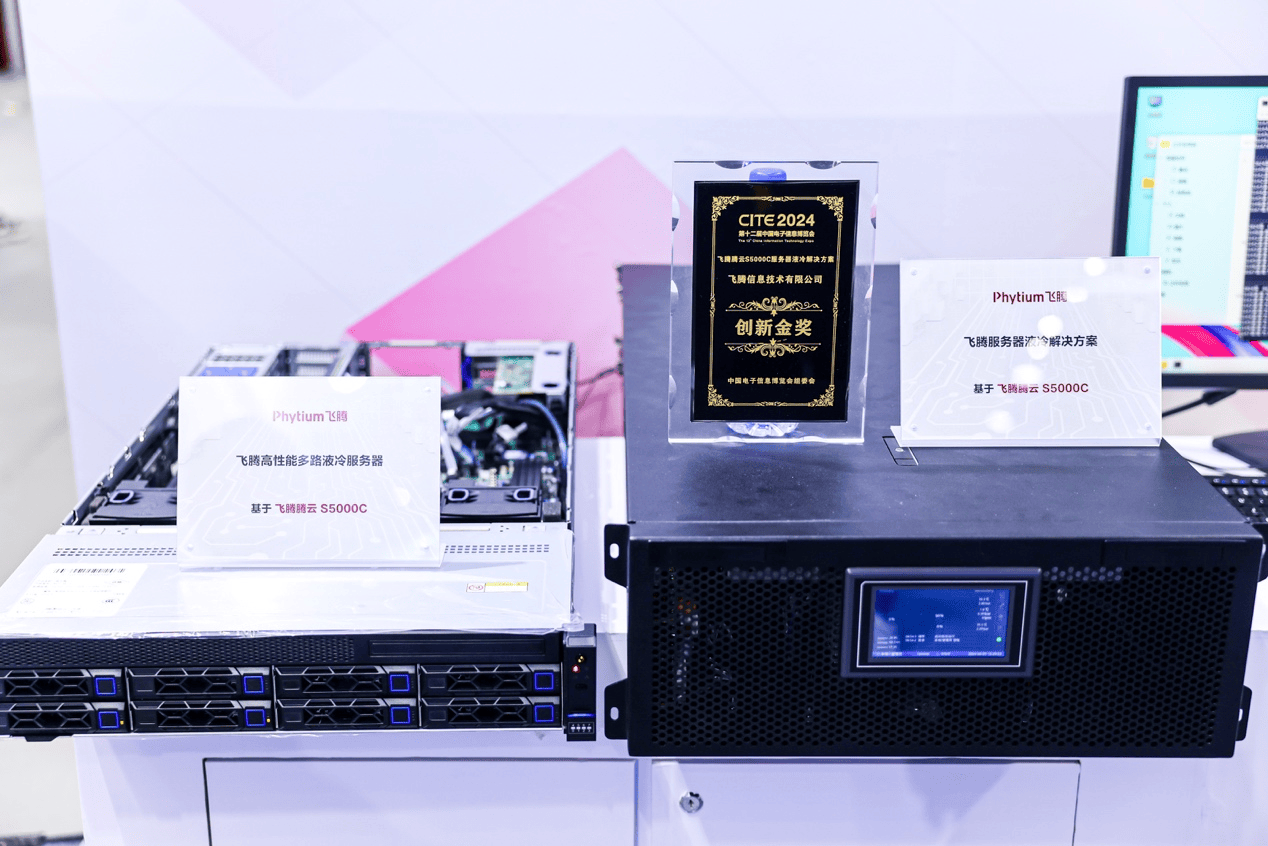

②智算中心首选 – 液冷

随着功率密度的提升,采用液冷方案成为更多新建 GPU 算力中心的选择。根据 IDC 发布的《中国半年度液冷服务器市场(2023 上半年)跟踪》报告数据显示, 2023 中国液冷服务器市场规模达到 15.1 亿美元。 IDC 预计,2022-2027 年,中国液冷服务器市场年复合增长率将达到 54.7%,2027 年市场 规模将达到 89 亿美元。

液冷技术在智算中心的应用,不仅提升了计算性能,还显著降低了能耗和运营成本。液冷技术的推广,将推动数据中心向更加高效、绿色和智能的方向发展,为AI时代的数据处理需求提供坚实的基础。

液冷服务器市场规模

液冷服务器市场规模

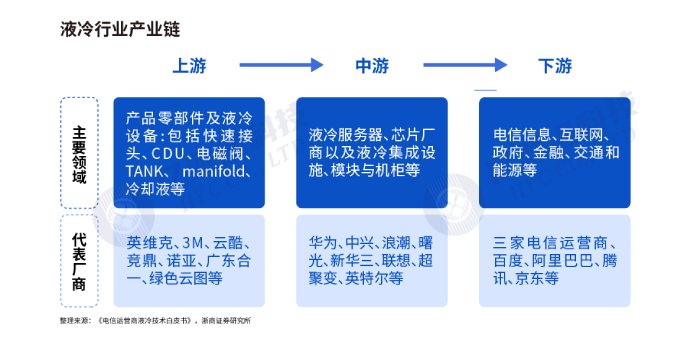

液冷产业链

液冷产业链包括上游的产品零部件提供商、中游的液冷服务器提供商、下游的算力使用者。目前下游的用户,国内用户阿里巴巴以单相浸没式液冷为主要发展方向,其他如百度、腾讯、京东等互联网企业更多的以冷板式液冷应用居多。海外用户浸没式发展优于冷板式,以美国公司为首,如英特尔、Google、Meta等互联网大公司在AI加持下更多的推动浸没式液冷的快速发展。

液冷产业链

液冷产业链

浸没式液冷技术可能面临的问题

冷却液选择

冷却液是液冷技术的关键原材料之一,具备较高技术壁垒。在浸没式液冷技术中,冷却液需要与电子产品直接接触,因此对冷却液的性能具有较高的要求,需要具备优异的导热性、良好的绝缘性、材料相容性等,此外对于气味、毒性、降解难易等环境方面特性也是有一定要求,应尽可能的易于操作及环境又好型。目前应用最为广泛的浸没式冷却液主要有碳氢及有机硅类(俗称“油类”,如矿物油等)和碳氟化合物类(如氟化液等)。氟化液综合性能较好,是比较理想的液冷材料。但氟化液目前的痛点在于成本较高。随着愈发严格的环境保护要求,硅油拥有更高的导热系数与更低的密度,同时对于环境更友好。冷却介质选择的差异主要由于冷却过程的不同。

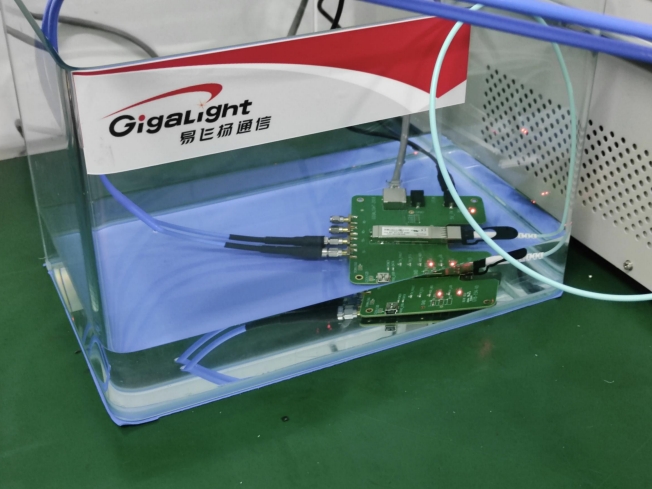

光路密封性问题

冷却液如氟化液或硅油等具有良好的绝缘性,能够有效防止电路短路。在低频信号条件下,冷却液对信号的影响几乎可以忽略不计。然而,在高频信号的情况下,冷却液对信号传输的影响则需要谨慎评估和控制。但整体而言,对电路的影响是可控的。

而对于光路来说,数据中心的光模块多数采用“非气密”封装设计,这意味着如果不进行相应的改进,冷却液可能会进入光学腔体,影响光学性能。即便是采用气密封装的光模块,仍有部分无源光路处于气密腔之外,例如透镜等光学元件。

光路的设计通常基于空气的折射率(约为1.0),当光学元件浸没在冷却液中时,冷却液的折射率不同于空气,会导致光的焦点和耦合效率发生变化。例如,氟油的折射率通常在1.3左右,这种折射率的变化会引起光路设计参数的调整。

为应对浸没式液冷对光路和电路的潜在影响,业界正在采取多种措施。例如,开发适应冷却液环境的新型光模块封装技术,优化高频信号的电路设计,以及研究更适合浸没冷却的光学材料和结构。

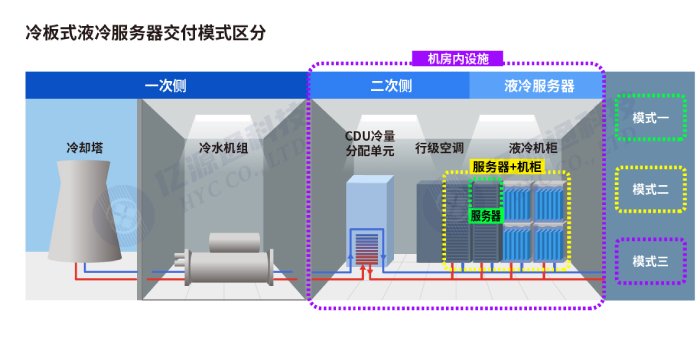

一体化交付还是解耦式交付

目前冷板式液冷服务器有三种交付模式,①IT设备侧仅交付液冷服务器;②IT侧交付“液冷服务器+液冷机柜”;③IT侧交付“液冷服务器+液冷机柜+CDU+二次侧管路”。当下应用较为广泛的为第三种交付模式,即一体化交付,整体机柜由同一厂商一体化交付,由厂商自定义标准进行集成化设计开发。解耦交付是液冷机柜与液冷服务器之间遵循用户统一制定的接口设计规范,机柜与服务器解耦,由不同厂家交付,基础设施和服务器厂家需协调合作。解耦式交付易于规模化推广与灵活部署。

冷板式液冷服务器交付模式

冷板式液冷服务器交付模式

目前国内液冷技术规划化程度较低,各家服务器设备、冷却液、制冷管路、供配电等产品形态各异,尚无统一接口标准,面临着难以标准化、规模化推广应用的问题。国内三大运营商发表液冷技术白皮书中提出液冷三年愿景,逐步开展液冷技术的验证、实验,将于2025年开展液冷技术的大规模应用,预计应用于50%以上数据项目,推动形成标准统一化、规模化,助推液冷解耦式交付。

HYC可提供定制化液冷光互联方案

基于二十多年的光互联关键技术积累,HYC具有高精度机械设计、模具、注塑设计与精密制造能力,以及光学设计、模拟仿真等技术平台,能够配合客户做一系列的应用于液冷数据中心的布线系统ODM/JDM服务。

审核编辑 黄宇

-

数据中心

+关注

关注

16文章

4769浏览量

72106 -

AIGC

+关注

关注

1文章

361浏览量

1542

发布评论请先 登录

相关推荐

伟创力收购数据中心液冷公司JetCool Technologies

龙蟠科技:以安全为核心树立数据中心液冷技术新标杆

当今数据中心新技术趋势

ALDC 2024第四届数据中心液冷产业大会圆满举办

数据中心的AI时代转型:挑战与机遇

兰洋科技为联通部署浸没式液冷高密度绿色数据中心投入使用,运行稳定

英特尔发布G-Flow浸没式液冷解决方案

英特尔与埃克森美孚联手打造高效数据中心浸没式液冷解决方案

3案例研究力证:液冷将引领下一代数据中心革新

AI算力竞赛加速散热技术变革,液冷方案获行业青睐

液冷——高效节能的散热先锋

液冷技术:迎接AIGC时代数据中心的散热挑战

液冷技术:迎接AIGC时代数据中心的散热挑战

评论