看点:随着语音交互走向爆发,一个新兴行业、数十家芯片公司宣告语音芯片的崛起。

▲注以上为不完全统计

综述:语音芯片发展三阶段

本文所讲的语音芯片侧重于智能语音设备兴起后,专门为语音交互场景打造的SoC芯片(芯片级系统,System on Chip),它兼具运算力和低功耗,支持多通道麦克风阵列接口,支持信号处理算法等。

通过对目前市面上语音芯片的观察,我们发现语音芯片有以下特点:其一兼具运算能力和低功耗的考量,采用最适合做语音处理的CPU(中央处理器);其二是具备高度整合性的语音SoC,支持多通道的麦克风阵列接口,集成Codec(多媒体数字信号编解码器)模块/DSP(数字信号处理)模块,并且集成WiFi/蓝牙模块等;其三在语音算法上支持回声消除、噪声抑制、声源定位、语音增强等技术,或具备良好的音值调节功能;其四端智能化,集成神经网络单元将部分云端训练好的智能本地化工作。

通过小编近期对产业链的采访以及梳理,根据语音交互的发展状况,将语音芯片的发展归纳为三个阶段,第一个阶段为语音芯片过渡期,采用通用芯片组合方案;第二个阶段为崛起期,语音芯片兴起;第三个阶段为语音芯片进化期,语音AI芯片涌现。

第一阶段,大约2015年以前尽管智能语音设备,包括智能音箱、远场交互的智能电视等都已出现,但在市场尚未起量的情况下,语音设备采用的多是通用芯片+Codec芯片/DSP芯片等相结合的方式实现语音处理,如全志的R16芯片。

2015年到2017年之间,随着智能语音设备市场规模进一步发展,专门用于智能家居或智能音箱的语音芯片开始陆续亮相,包括联发科推出的MT8516芯片、科胜讯的CX20924/CX20921、Amlogic的A113、瑞芯微的RK3036/RK3229等。

此外,随着智能语音设备的迅速发展,对于端智能的需求也在显现,语音AI芯片应运而生。端智能是近两年来AI领域大火的概念之一,指的是数据的采集、计算、决策都在前端设备进行,优势在于稳定、时延小、同时能够保护用户隐私等。如杭州国芯推出的GX8010和启英泰伦推出的CI1006都属于语音AI芯片。

前期:通用芯片组合搭配

在智能语音设备的市场早期阶段,由于芯片研发漫长的周期(一般需要18~24个月),高昂的研发投入,因此在市场规模尚不大的情况下,市场并没有专门的语音芯片应用到智能语音设备中。

▲德州仪器DM3725芯片

后来或许是处于成本以及其他考虑,亚马逊的一些产品开始使用联发科MT8563芯片,这款芯片同样不是语音专用芯片。直到今年Q2季度,联发科推出了MT8516才算真正意义上的语音芯片。

另外一个例子是国内早期智能音箱的代表叮咚音箱,最初国内也没有专用语音芯片,采用的是全志科技R16芯片+科胜讯Codec芯片的方式进行语音处理,而全志R16之前则是用于平板的芯片。

在语音交互场景的早期,智能设备并无太多销量,即使看到了这一潜在机会,研发一款专用芯片的时间成本、投资成本都决定了在最初一段时间,智能设备需要使用通用芯片或其他芯片作为过渡期。

中小语音芯片厂商涌现

随着智能语音设备销量不断增长,典型的就是2016年以来,以亚马逊Echo为代表的智能音箱市场规模的不断扩大,专用的语音芯片也开始出现,2016年又刚好是语音芯片兴起最集中的一年。

其实早在2013年7月国内首颗专用语音芯片就诞生了,它由四川长虹和中科院声学所付强(现为先声互联创始人)团队共同研发。新研发出的长虹语音芯片的优势是在语音识别的基础上,融合了多方面的语音增强功能,包括语音降噪、回声消除、波束形成等,支持低功耗唤醒,能够实现远场语音采集。可能因为四川长虹的一些原因,这款芯片在研发出后并没有投入生产,之后就不了了之。

2015年以后语音芯片就开始陆续兴起,包括联发科MT8516、科胜讯CX20924、晶晨半导体A113、瑞芯微RK3036、北京君正X1000等公司,如联发科推出了MT8516应用在了阿里天猫精灵上,晶晨A113应用在了小米AI音箱上。

▲阿里天猫精灵主控板上使用的联发科MT8516芯片

整体来说,这些语音芯片都是面向智能音箱以及智能家居场景打造的专用芯片,支持多通道麦克风阵列接口,采用适合做语音处理的CPU;在语音算法上支持回声消除、噪声抑制、声源定位、语音增强等技术,并兼具运算能力和低功耗的考量。

目前无论是智能音箱还是其他智能设备,更多的智能都是在云端来实现,但云端存在着语音交互“时延”的问题,对网络的需求限制了设备的使用空间,以及由此带来的数据与隐私危机。为了让设备使用场景不受局限,用户体验更好,端侧智能以成为一种趋势,语音AI芯片也随之而来。

2016年以来,语音AI芯片也开始走进大家的视野。成都启英泰伦在去年推出CI1006,杭州国芯在今年10月底推出GX8010,都是语音AI芯片。

▲杭州国芯GX8010芯片

对比语音芯片,语音AI芯片具备以下特点:首先语音AI芯片中集成了专用的AI处理器模块,用以对本地的机器学习算法进行加速;其二高度集成,语音AI芯片不但集成CPU、AI处理器,还会将DSP信号处理、WiFi/蓝牙等模块集成进去;其三能够实现端侧智能,将一些常用或者简单的功能直接集成到本地,通过AI芯片进行本地计算,从而设备可以在端侧离线完成如听音乐、日常问答及闲聊等任务,实现更快的交互能力。

再考虑到用户体验以及数据隐私等问题,更快的交互体验以及更多本地计算会是一种趋势,随着智能语音场景的爆发, 语音AI芯片也会迅速发展。

但目前的AI芯片更多的在于手机和视觉应用领域,一方面手机市场体量足够庞大,另一方面视觉应用技术也相对成熟。而在语音领域,一方面语义理解技术短期内很难突破,另外智能语音是一个新兴市场,智能音箱作为典型爆款产品,今年全球整体市场规模也不过2500万~3000万台之间,而这些都导致了语音AI芯片进展相对缓慢。

联发科副总经理暨家庭娱乐产品事业群总经理游人杰曾对智能语音的发展提出一个三阶段论的观点,他认为智能语音的第一阶段是智能音箱的普及,第二阶段是更多智能语音设备的出现,语音成为人机交互的界面,第三阶段就是端侧智能,通过语音AI芯片来实现更多本地计算,提供用户更好的交互体验。

不难看出,我们目前还处于第一阶段,需要推动智能音箱的普及以及更多智能设备的出现,从而推动语音交互界面的到来。只有当语音成为一种交互界面,才意味着整个智能语音市场的爆发,才会有更多的巨头芯片厂商以及中小芯片商涌入其中。

而针对当下智能语音设备所需的智能化,游人杰谈到,CPU本身可以做一些“轻”AI的功能,如果本地需要很强的AI能力,目前则会在语音芯片的基础上外置一个AI处理器来实现。此外游人杰也透露,联发科语音AI芯片的推出尚需1~2年时间。

相比一款新型芯片研发的高昂成本,在对算力有很大需求的产品上,通过添加一个独立的AI处理器模块,确实可以快速满足产品端对AI能力的需求,并且缓解了芯片产品漫长的研发周期(一般18~24个月)。从时间来看,随着智能语音的兴起,未来1~2年后可能将会是语音芯片爆发的高峰期。

语音芯片带动新兴行业

有分析认为,到2020年AI芯片市场规模将达到146.16亿美元,约占全球人工智能市场规模12.18%。随着人工智能的火热,以GPU(图形处理器) 、FPGA(现场可编程门阵列) 、ASIC(为专门目的而设计的集成电路)为代表的AI芯片类别均将获得快速发展,语音芯片/语音AI芯片也会在这个过程中受益并爆发,在此过程中会诞生一个新兴的语音芯片行业,以及一波语音芯片公司。

根据游人杰智能语音发展的三阶段论,目前我们还处于第一阶段的智能音箱普及期,先通过一款爆款产品来引爆整个语音交互行业,并由此推动家庭场景、办公场景等的语音智能化,使语音成为人机交互的一个界面,才能真正推动语音芯片的爆发,以及演进到语音AI芯片。

仅仅是今年全球智能音箱市场销量预计有望达到3000万台,随着语音交互进一步爆发,场景进一步开拓,智能语音设备将快速进入亿级规模市场,可见无论是当下的语音芯片还是即将到来的语音AI芯片,都将有广阔的市场空间。

由于当下智能语音市场规模相对较小,相比芯片研发的高成本投入,像高通、英伟达、英特尔等芯片巨头或是并不看好这块市场或是语音芯片研发进展缓慢,给予了更多中小芯片厂商发展的机会。

目前在语音芯片行业已涌现出数十家公司在这一领域“开疆扩土”,包括联发科、杭州国芯、全志科技、晶晨半导体、启英泰伦等,既有芯片领域的大公司,面向智能家居、消费电子领域的国有芯片品牌,还有新兴的创业公司。正是语音交互的兴起,为他们在既有业务之外,提供了一个新的经济增长点,并且随着语音交互的爆发,这一领域甚至会诞生下一个巨头芯片公司。

可以预见的是,2018年会有更多语音芯片的诞生,在未来1~2年,语音AI芯片也将进一步发展迎来爆发期。

结语:语音芯片的崛起

随着语音交互设备的诞生发展,芯片也经历着从通用组合芯片到语音芯片再到语音AI芯片的演进。随着语音交互的爆发,语音真正成为人机交互的界面,语音芯片也将成爆发之态。

但与此同时,语音与视觉也将会走向融合,毕竟多元的交互方式才更符合人性的体验。在语音芯片崛起后,“语音+屏幕”相结合的交互方式也是业界更加认可的一种趋势。

-

语音芯片

+关注

关注

12文章

1829浏览量

37066

原文标题:千万销量百亿市场 语音芯片崛起!

文章出处:【微信号:WW_CGQJS,微信公众号:传感器技术】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

相关推荐

最新2024年全球激光加工市场规模将增至240.2亿美元

2035年Chiplet市场规模将超4110亿美元

全球半导体市场回暖:预计2024年市场规模将达6000亿美元

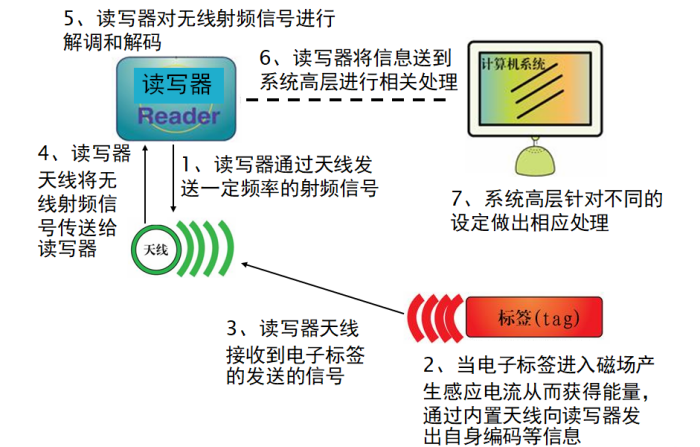

RFID电子标签预计在2030年全球市场规模将达到75.1亿美元

SoC芯片市场前景广阔,2029年规模将超2000亿美元

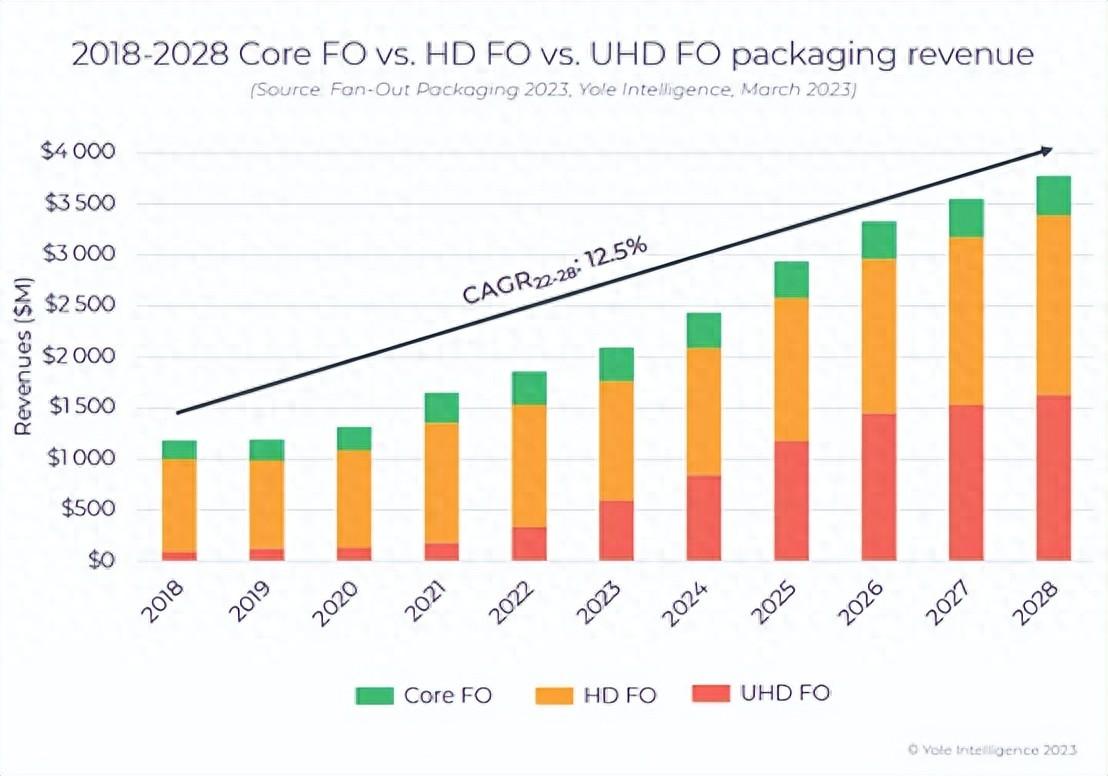

扇出型 (Fan-Out)封装市场规模到2028 年将达到38 亿美元

语音芯片市场行业报告,2020年AI芯片市场规模将达到146.16亿美元

语音芯片市场行业报告,2020年AI芯片市场规模将达到146.16亿美元

评论