BERT是如何做情感分类的呢?今天,让我们一起揭开BERT模型的神秘面纱,看看它是如何巧妙地进行情感分类的!

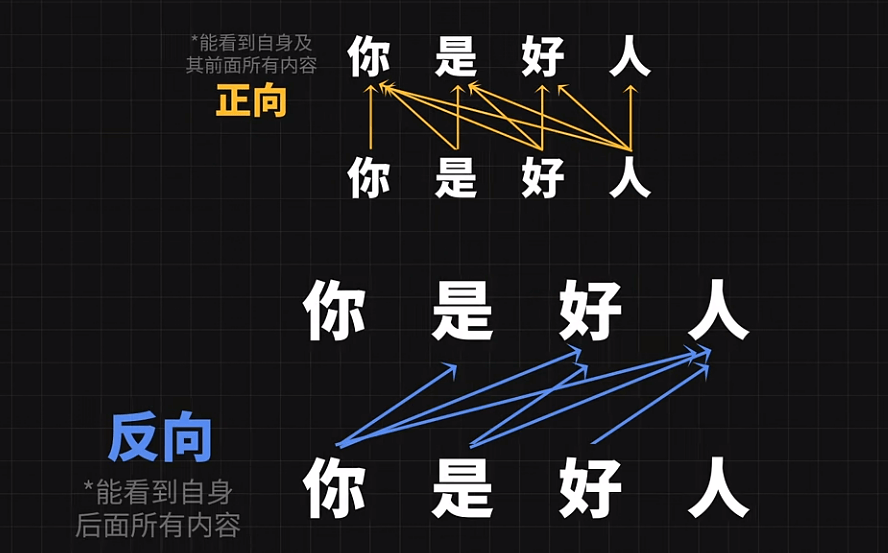

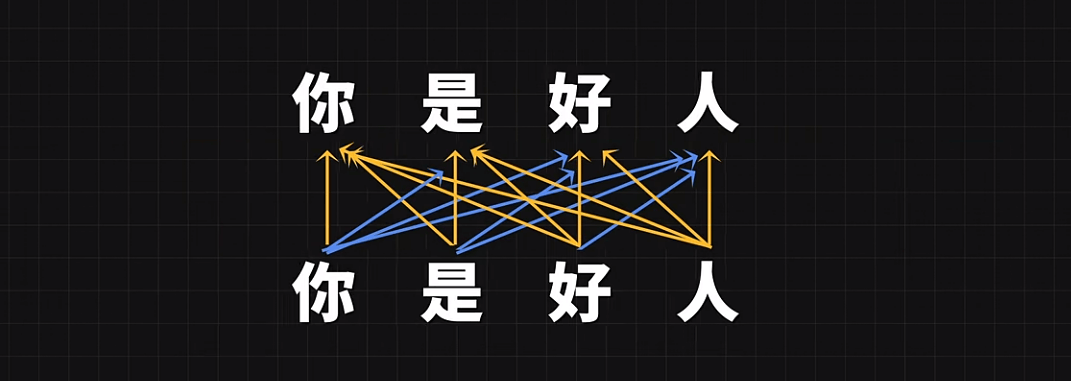

BERT,作为一个双向编码器模型,它的独特之处在于能够全面吸收一段文本或句子的精髓。

通过tokenizer,文本被转换成一段段token,通过自注意力机制每个token都像拥有超能力一样,能够感受到其他token的情感波动。这样的设计让每个token都蕴含了整句话的丰富信息。

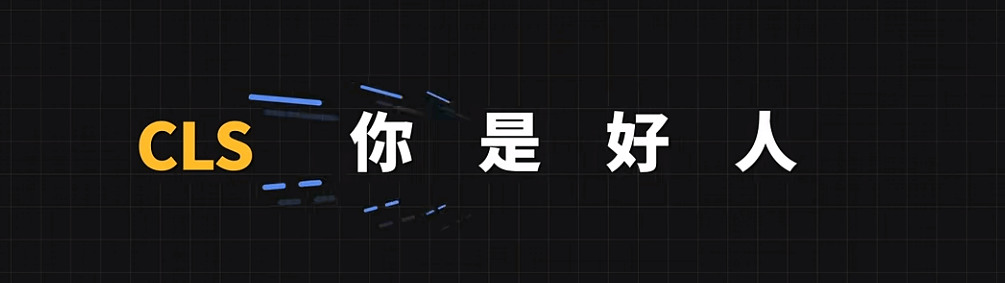

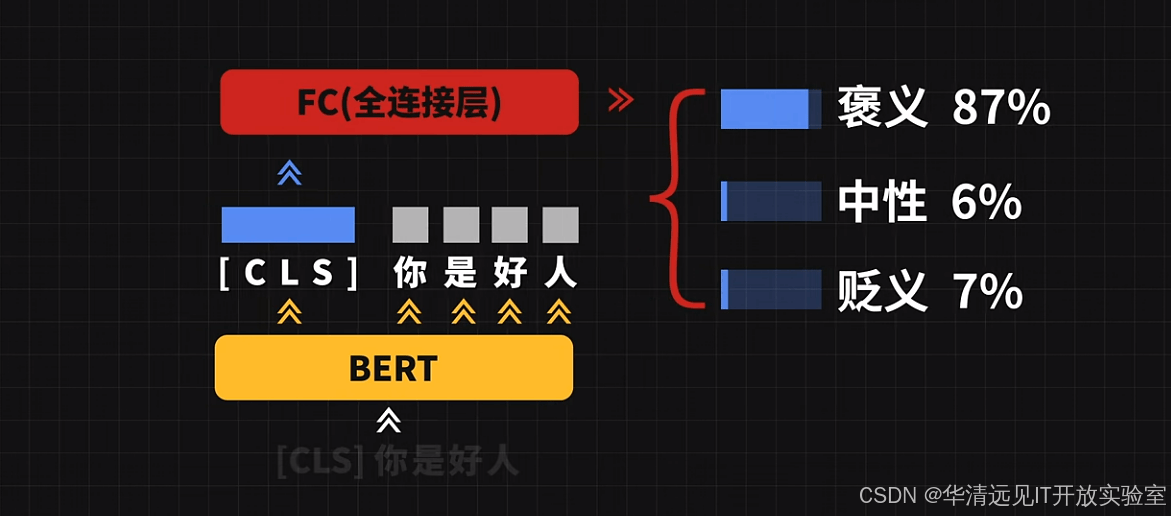

在BERT的世界里,有一个特殊的标记——CLS,它被拼接于句子的起点,扮演着聚集整个句子全局信息的重要角色。当BERT处理一个句子时,它会特别关注CLS标记,因为它浓缩了整个句子的核心情感。

在情感分类的任务中,我们巧妙地利用CLS标记的输出向量来预测句子的情感倾向。这个向量就像是一篇情感的“摘要”,它蕴含了判断情感所需的所有关键信息。

所以,BERT是这样实现的:经过BERT的所有神经网络层,CLS标记最终也变成了一种embedding向量。在最后的关键一步,我们只需将这个向量提取出来,通过全连接层的转换,就能轻松实现情感分类的任务!

AI体系化学习路线

学习资料免费领

【后台私信】AI全体系学习路线超详版+100余讲AI视频课程 +AI实验平台体验权限

全体系课程详情

-

AI

+关注

关注

87文章

30998浏览量

269328 -

人工智能

+关注

关注

1791文章

47352浏览量

238791 -

大模型

+关注

关注

2文章

2476浏览量

2811 -

AI大模型

+关注

关注

0文章

316浏览量

315

发布评论请先 登录

相关推荐

ADC128S022的驱动架构参考 ti-adc128s052.c,要如何做移位生成12bit结果呢?

请问HD3SS215 aux_sel需要如何做设定?是只需要将电压设定为1/2即可使用吗?

ADS1120接的PT100三线,校准应该如何做?

基于LSTM神经网络的情感分析方法

【每天学点AI】KNN算法:简单有效的机器学习分类器

如何做才能使TAS5631处于准备状态呢?

TL494制作BOOST升压电路,如何做可以继续让占空比随着负载增大而增大?

硬件工程师如何做元器件变更的决策

【每天学点AI】大模型如何做情感分类?BERT是如何做情感分类的?

【每天学点AI】大模型如何做情感分类?BERT是如何做情感分类的?

评论