在人工智能领域,LLM(Large Language Models,大型语言模型)和传统机器学习是两种不同的技术路径,它们在处理数据、模型结构、应用场景等方面有着显著的差异。

1. 模型结构和训练方法

LLM:

- 预训练和微调: LLM通常采用预训练(Pre-training)和微调(Fine-tuning)的方法。预训练阶段,模型在大规模的文本数据上学习语言的通用特征,微调阶段则针对特定任务进行调整。

- Transformer架构: LLM多基于Transformer架构,这种架构特别适合处理序列数据,能够有效捕捉长距离依赖关系。

- 自注意力机制: Transformer架构中的自注意力机制使得模型能够同时关注输入序列中的所有位置,这对于理解上下文信息至关重要。

传统机器学习:

- 特征工程: 传统机器学习模型通常需要人工进行特征提取和特征选择,这是一个耗时且需要专业知识的过程。

- 模型多样性: 传统机器学习包括多种模型,如决策树、支持向量机、随机森林等,每种模型都有其特定的应用场景和优势。

- 监督学习: 许多传统机器学习模型依赖于监督学习,需要大量的标注数据来训练。

2. 数据依赖性

LLM:

- 数据驱动: LLM极度依赖于大量的数据进行预训练,这些数据通常是未标注的,模型通过自监督学习来理解语言结构和语义。

- 多模态数据: 一些LLM也开始尝试整合多模态数据(如图像、声音)来增强模型的理解和生成能力。

传统机器学习:

- 标注数据依赖: 传统机器学习模型,尤其是监督学习模型,严重依赖于高质量的标注数据。

- 数据量要求: 传统机器学习模型对数据量的要求不如LLM那么高,但数据的质量和多样性对模型性能有直接影响。

3. 应用场景

LLM:

- 自然语言处理: LLM在自然语言处理(NLP)领域表现出色,包括文本生成、翻译、问答系统等。

- 对话系统: LLM能够构建更加自然和流畅的对话系统,理解用户的意图并生成合适的回应。

- 内容创作: LLM可以用于自动生成文章、故事、诗歌等内容,展现出强大的创造性。

传统机器学习:

- 预测和分类: 传统机器学习模型广泛应用于预测和分类任务,如股票价格预测、图像识别等。

- 推荐系统: 在推荐系统中,传统机器学习模型能够根据用户的历史行为推荐个性化内容。

- 异常检测: 传统机器学习在异常检测领域也有广泛应用,如信用卡欺诈检测、网络安全等。

4. 可解释性和透明度

LLM:

- 黑箱问题: LLM通常被认为是“黑箱”,因为它们的决策过程不透明,难以解释模型是如何做出特定预测的。

- 可解释性研究: 尽管存在挑战,但研究者正在探索各种方法来提高LLM的可解释性,如注意力可视化、模型解释等。

传统机器学习:

- 模型可解释性: 传统机器学习模型,尤其是决策树和线性模型,通常具有较好的可解释性。

- 特征重要性: 一些模型(如随机森林)能够提供特征重要性评分,帮助理解模型的决策依据。

5. 计算资源需求

LLM:

- 高计算需求: LLM需要大量的计算资源进行训练和推理,这通常涉及到高性能的GPU和TPU。

- 能源消耗: LLM的训练和运行对能源消耗巨大,这也引发了对环境影响的担忧。

传统机器学习:

- 资源需求较低: 相比LLM,传统机器学习模型通常需要较少的计算资源,尤其是在模型训练阶段。

- 可扩展性: 传统机器学习模型更容易在不同的硬件和平台上部署,具有较好的可扩展性。

6. 伦理和社会影响

LLM:

- 偏见和歧视: LLM可能会从训练数据中学习并放大偏见和歧视,这需要通过数据清洗和模型调整来缓解。

- 隐私问题: LLM可能会无意中泄露训练数据中的敏感信息,需要采取隐私保护措施。

传统机器学习:

- 数据隐私: 传统机器学习模型同样面临数据隐私问题,尤其是在处理个人数据时。

- 模型滥用: 任何强大的技术都可能被滥用,传统机器学习模型也不例外,需要制定相应的伦理准则和监管措施。

声明:本文内容及配图由入驻作者撰写或者入驻合作网站授权转载。文章观点仅代表作者本人,不代表电子发烧友网立场。文章及其配图仅供工程师学习之用,如有内容侵权或者其他违规问题,请联系本站处理。

举报投诉

-

人工智能

+关注

关注

1820文章

50364浏览量

267016 -

模型

+关注

关注

1文章

3831浏览量

52281 -

机器学习

+关注

关注

67文章

8567浏览量

137235 -

LLM

+关注

关注

1文章

350浏览量

1397

发布评论请先 登录

相关推荐

热点推荐

Google正式发布LLM评测基准Android Bench

LLM 在 Android 开发任务中的表现。现在,我们发布了 Android Bench 的首个版本,这是 Google 官方专门针对 Android 开发打造的 LLM 排行榜。

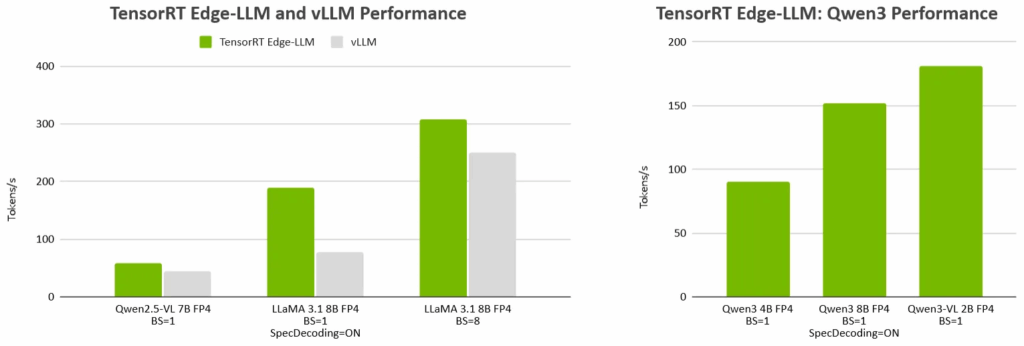

NVIDIA TensorRT Edge-LLM在汽车与机器人行业的落地应用

大语言模型(LLM)与多模态推理系统正迅速突破数据中心的局限。越来越多的汽车与机器人领域的开发者希望将对话式 AI 智能体、多模态感知系统和高级规划功能直接部署在端侧,因为在这些场景中,低延迟、高可靠性以及离线运行能力至关重要。

机器学习和深度学习中需避免的 7 个常见错误与局限性

无论你是刚入门还是已经从事人工智能模型相关工作一段时间,机器学习和深度学习中都存在一些我们需要时刻关注并铭记的常见错误。如果对这些错误置之不理,日后可能会引发诸多麻烦!只要我们密切关注数据、模型架构

【CIE全国RISC-V创新应用大赛】+ 一种基于LLM的可通过图像语音控制的元件库管理工具

一种基于LLM的可通过图像语音控制的元件库管理工具

项目概述

库存管理在我们的生活中几乎无处不在,在许多小型的库存当中,比如实验室中的库存管理,往往没有人去专职维护,这就会导致在日积月累中逐渐

发表于 11-12 19:32

NVIDIA TensorRT LLM 1.0推理框架正式上线

TensorRT LLM 作为 NVIDIA 为大规模 LLM 推理打造的推理框架,核心目标是突破 NVIDIA 平台上的推理性能瓶颈。为实现这一目标,其构建了多维度的核心实现路径:一方面,针对需

DeepSeek R1 MTP在TensorRT-LLM中的实现与优化

TensorRT-LLM 在 NVIDIA Blackwell GPU 上创下了 DeepSeek-R1 推理性能的世界纪录,Multi-Token Prediction (MTP) 实现了大幅提速

FPGA在机器学习中的具体应用

随着机器学习和人工智能技术的迅猛发展,传统的中央处理单元(CPU)和图形处理单元(GPU)已经无法满足高效处理大规模数据和复杂模型的需求。FPGA(现场可编程门阵列)作为一种灵活且高效的硬件加速平台

如何在魔搭社区使用TensorRT-LLM加速优化Qwen3系列模型推理部署

TensorRT-LLM 作为 NVIDIA 专为 LLM 推理部署加速优化的开源库,可帮助开发者快速利用最新 LLM 完成应用原型验证与产品部署。

Qualys TotalAI 降低 Gen AI 和 LLM 工作负载的风险

,为陈旧系统构建的传统安全方法根本无法应对。 如今,企业面临着知识产权被盗、数据泄露、违反隐私法规等风险。在这种情况下,就更需要了解 LLM 的所在位置、漏洞以及暴露程度。这正是 Qualys TotalAI 发挥作用的地方。 Qualys TotalAI 为企业提供针对

使用 llm-agent-rag-llamaindex 笔记本时收到的 NPU 错误怎么解决?

使用 conda create -n ov-nb-demos python=3.11 创建运行 llm-agent-rag-llamaindex notebook 的环境。

执行“创建

发表于 06-23 06:26

使用NVIDIA Triton和TensorRT-LLM部署TTS应用的最佳实践

针对基于 Diffusion 和 LLM 类别的 TTS 模型,NVIDIA Triton 和 TensorRT-LLM 方案能显著提升推理速度。在单张 NVIDIA Ada Lovelace

PCBA 加工必备知识:选择性波峰焊和传统波峰焊区别大揭秘

一站式PCBA加工厂家今天为大家讲讲PCBA加工选择性波峰焊与传统波峰焊有什么区别?选择性波峰焊与传统波峰焊的区别及应用。在PCBA加工中,DIP插件焊接是确保产品连接可靠性的重要工序

LLM和传统机器学习的区别

LLM和传统机器学习的区别

评论