随着人工智能技术的飞速发展,深度学习作为AI领域的核心驱动力,对计算能力的需求日益增长。NPU技术应运而生,为AI性能的提升提供了强大的硬件支持。

NPU技术概述

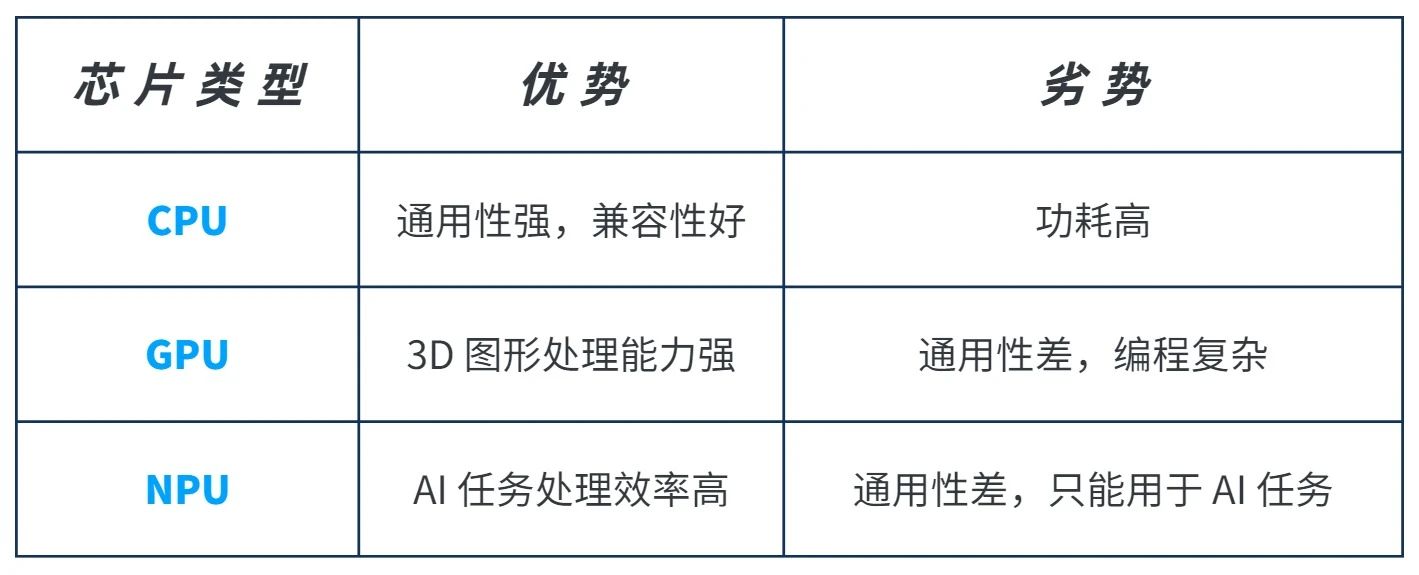

NPU是一种专门为深度学习算法设计的处理器,与传统的CPU和GPU相比,它在执行深度学习任务时具有更高的效率和更低的能耗。NPU通过专门优化的硬件结构和指令集,能够更快地处理神经网络中的大量并行计算任务。

1. 优化硬件架构

NPU技术通过优化硬件架构来提升AI性能。以下是几个关键点:

- 专用计算单元 :NPU包含大量专用的计算单元,这些单元专为深度学习中的矩阵运算和数据并行处理设计,能够高效执行这些操作。

- 内存层次结构 :NPU通常具有优化的内存层次结构,包括高速缓存和片上存储,以减少数据访问延迟,提高数据处理速度。

- 并行处理能力 :NPU支持大规模并行处理,这意味着它可以同时处理多个深度学习任务,从而提高整体的计算效率。

2. 提高能效比

NPU技术通过提高能效比来提升AI性能。以下是几个关键点:

- 低功耗设计 :NPU采用低功耗设计,通过优化电路和使用先进的制程技术,减少能耗。

- 动态调整频率和电压 :NPU可以根据工作负载动态调整频率和电压,以实现最佳的能效比。

- 专用指令集 :NPU拥有专用的指令集,这些指令集针对深度学习算法进行了优化,减少了不必要的计算和能量消耗。

3. 加速数据处理

NPU技术通过加速数据处理来提升AI性能。以下是几个关键点:

- 数据预处理 :NPU可以加速数据预处理步骤,如归一化和特征提取,这些步骤对于深度学习模型的训练和推理至关重要。

- 批量处理 :NPU支持批量处理,这意味着它可以同时处理多个数据样本,从而提高吞吐量。

- 异构计算 :NPU可以与其他类型的处理器(如CPU和GPU)协同工作,实现异构计算,以充分利用不同处理器的优势。

4. 支持多种深度学习框架

NPU技术通过支持多种深度学习框架来提升AI性能。以下是几个关键点:

- 框架兼容性 :NPU支持主流的深度学习框架,如TensorFlow、PyTorch等,使得开发者可以无缝迁移现有的模型和算法。

- 自动优化 :NPU可以自动优化深度学习模型的执行,通过分析模型结构和数据流,动态调整计算资源。

- 硬件抽象层 :NPU提供了硬件抽象层,使得开发者可以专注于算法开发,而不必关心底层硬件细节。

5. 实时AI应用

NPU技术通过支持实时AI应用来提升AI性能。以下是几个关键点:

- 低延迟 :NPU可以实现低延迟的AI推理,这对于需要快速响应的应用(如自动驾驶、实时语音识别)至关重要。

- 高吞吐量 :NPU的高吞吐量使得它可以同时处理大量AI任务,满足高并发的需求。

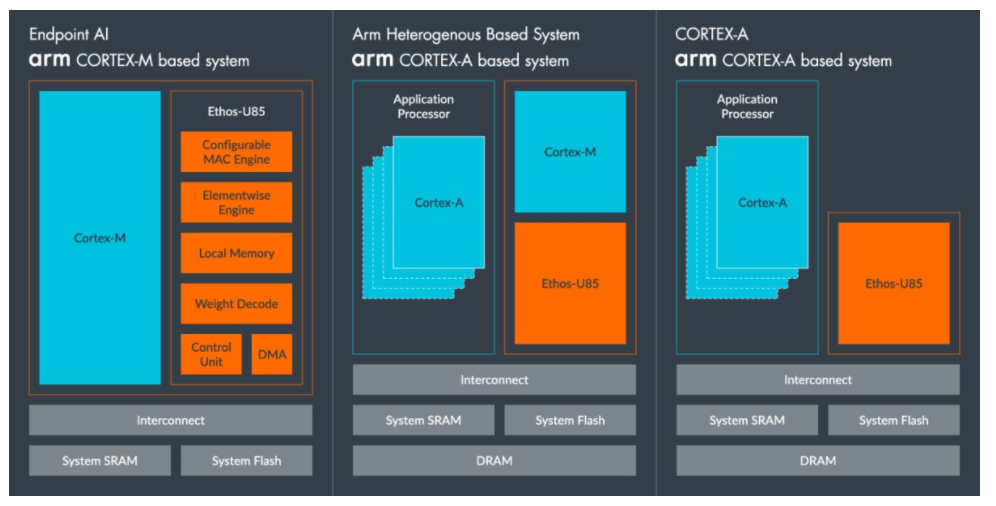

- 边缘计算 :NPU适合部署在边缘设备上,实现数据的本地处理,减少对云端的依赖,降低延迟。

结论

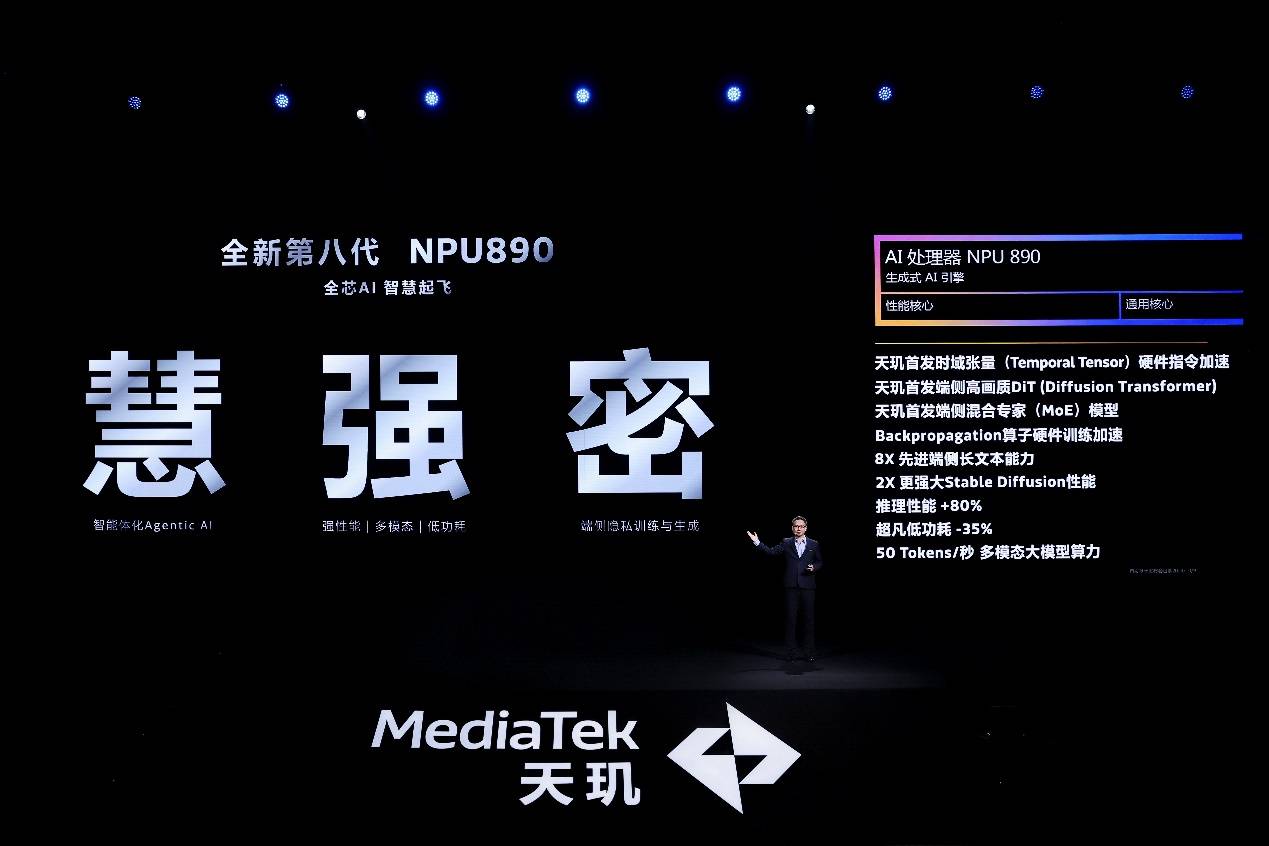

NPU技术通过优化硬件架构、提高能效比、加速数据处理、支持多种深度学习框架和支持实时AI应用等方面,显著提升了AI性能。随着技术的不断进步,NPU将继续在AI领域扮演越来越重要的角色,推动人工智能技术的发展。

声明:本文内容及配图由入驻作者撰写或者入驻合作网站授权转载。文章观点仅代表作者本人,不代表电子发烧友网立场。文章及其配图仅供工程师学习之用,如有内容侵权或者其他违规问题,请联系本站处理。

举报投诉

-

处理器

+关注

关注

68文章

19242浏览量

229593 -

AI

+关注

关注

87文章

30643浏览量

268825 -

人工智能

+关注

关注

1791文章

47137浏览量

238115 -

NPU

+关注

关注

2文章

277浏览量

18581

发布评论请先 登录

相关推荐

NPU的市场前景与发展趋势

随着人工智能技术的快速发展,神经网络处理器(Neural Processing Unit,简称NPU)作为AI领域的关键硬件,其市场前景和发展趋势备受关注。 一、NPU市场前景分析 市

什么是NPU芯片及其功能

在人工智能(AI)技术迅猛发展的今天,NPU芯片已经成为推动这一领域进步的关键技术之一。NPU芯片,即神经网络处理单元,是一种专门为深度学习

NPU与GPU的性能对比

NPU(Neural Processing Unit,神经网络处理单元)与GPU(Graphics Processing Unit,图形处理单元)在性能上各有千秋,它们各自的设计初衷和优化方向决定了

RK3588 技术分享 | 在Android系统中使用NPU实现Yolov5分类检测

NPU。

应用领域

图像识别: NPU能够迅速对图像进行分类、检测和分割等操作,大大提升了处理效率。

语音识别: NPU实现了实时语音转换和语音合成功能,为语音交互提供了更自然的体验。

发表于 10-24 10:13

什么是NPU?什么场景需要配置NPU?

在人工智能(AI)技术如火如荼的今天,NPU神经处理单元(Neural Processing Unit)作为一种新兴的硬件加速器,正在成为ARM主板配置中的新宠。与传统的CPU和GPU相比,N

NXP推出集成NPU的MCU,支持AI边缘设备!MCU实现AI功能的多种方式

可扩展的硬件加速器架构,专为AI和ML应用而设计。NPU的引入大幅提升了设备的AI工作负载性能和能效,使得本

名单公布!【书籍评测活动NO.43】 算力芯片 | 高性能 CPU/GPU/NPU 微架构分析

力,在全球范围内,对于推动科技进步、经济发展及社会整体的运作具有至关重要的作用。随着信息技术的高速发展,高性能计算(HPC)和人工智能(AI)等技术在多个领域的应用变得日益广泛,芯片算

发表于 09-02 10:09

刷新AI PC NPU算力,AMD锐龙AI 9 HX 375领衔55 TOPS

NPU性能第一梯队。而此次推出的Ryzen AI 9 HX 375算力进一步提升至55 TOPS。在NPU算力这条路上AMD甚是积极。

芯品# 物联网市场性能最高的 NPU

提高数据隐私和安全性。 Arm 的 Ethos NPU 如何增强边缘和端点的 AI 性能? 多年来,Arm 一直在开发边缘 AI 加速器,以支持对边缘和端点推理工作负载日益增长的需求。

NPU和AI TOPS是什么?它们有哪些性能?

在当今快速发展的技术环境中,AI正在变革各行各业并推动创新,理解AI性能指标的复杂性至关重要。过去许多AI模型需要在云端运行。当我们走向由终

Lunar Lake:NPU性能全面提升,能耗也大幅降低,综合AI算力提升至120TOPS

英特尔CEO帕特·基辛格在COMPUTEX 2024上发表主题演讲,正式公布了下一代面向AI PC的移动处理器Lunar Lake,不仅CPU、GPU、NPU性能全面提升,能耗也大幅降

AI PC引发的NPU大战?英特尔:仅30%开发者选择NPU

随着COMPUTEX 2024的日益临近,关于人工智能(AI)个人计算机(PC)的话题开始变得愈发热门和受关注。据微软公司近期发布的相关技术规范要求,所有运行Windows操作系统的AI PC必须配备本地运行Copilot的功能

高通NPU和异构计算提升生成式AI性能

异构计算的重要性不可忽视。根据生成式AI的独特需求和计算负担,需要配备不同的处理器,如专注于AI工作负载的定制设计的NPU、CPU和GPU。

微软画图即将支持NPU,Windows内置应用AI功能持续优化

神经网络处理单元(NPU),作为一款Win11笔记本上的专属硬件组件,主要承担AI及机器学习任务处置。相较于云服务或通CPU,NPU能有效提升本地设备的

NPU技术如何提升AI性能

NPU技术如何提升AI性能

评论