RNN(循环神经网络)与LSTM(长短期记忆网络)模型在深度学习领域都具有处理序列数据的能力,但它们在结构、功能和应用上存在显著的差异。以下是对RNN与LSTM模型的比较分析:

一、基本原理与结构

- RNN

- 基本原理 :RNN通过引入循环连接,使网络能够捕捉序列数据中的时间依赖性。每个时间步的输入都会通过一个循环结构传递到下一个时间步,使得网络能够保持对之前信息的记忆。

- 结构 :RNN的核心是一个递归神经网络单元,它接收当前输入和前一时间步的隐藏状态,通过非线性函数计算当前时间步的隐藏状态和输出。

- LSTM

- 基本原理 :LSTM是RNN的一种变体,它通过引入门控机制(遗忘门、输入门和输出门)和一个细胞状态来解决RNN在处理长序列时容易出现的梯度消失问题。

- 结构 :LSTM的结构比RNN更为复杂,它包含四个交互的神经网络层,这些层以一种特殊的方式交互,共同控制信息的流动。遗忘门决定哪些信息应该被遗忘,输入门决定哪些新信息应该被存储,输出门决定哪些信息应该被输出。细胞状态是LSTM中存储信息的核心,它允许信息跨越多个时间步长时间保留。

二、性能与优势

- RNN

- 性能 :RNN在处理短序列数据时表现良好,能够捕捉序列中的短期依赖性。然而,在处理长序列数据时,RNN容易出现梯度消失问题,导致难以学习到长期依赖性。

- 优势 :RNN的结构相对简单,训练速度较快,适用于处理短序列数据或需要快速响应的场景。

- LSTM

- 性能 :LSTM通过引入门控机制和细胞状态,能够有效地处理长序列数据,捕捉序列中的长期依赖性。这使得LSTM在自然语言处理、语音识别、视频分析等领域具有广泛的应用前景。

- 优势 :LSTM的结构更为复杂,但能够更好地处理长序列数据,捕捉长期依赖性。此外,LSTM还具有更高的鲁棒性和泛化能力,能够在不同领域和任务中表现出色。

三、应用场景

- RNN

- 应用场景 :RNN适用于处理短序列数据或需要快速响应的场景,如文本分类、情感分析、时间序列预测等。

- LSTM

- 应用场景 :LSTM适用于处理长序列数据或需要捕捉长期依赖性的场景,如机器翻译、语音识别、视频分析、文本生成等。

四、总结

RNN与LSTM模型在处理序列数据方面都具有各自的优势和局限性。RNN结构简单,训练速度快,适用于处理短序列数据;而LSTM通过引入门控机制和细胞状态,能够更好地处理长序列数据,捕捉长期依赖性。在实际应用中,应根据具体任务和数据特点选择合适的模型。

声明:本文内容及配图由入驻作者撰写或者入驻合作网站授权转载。文章观点仅代表作者本人,不代表电子发烧友网立场。文章及其配图仅供工程师学习之用,如有内容侵权或者其他违规问题,请联系本站处理。

举报投诉

-

模型

+关注

关注

1文章

3816浏览量

52265 -

rnn

+关注

关注

0文章

92浏览量

7374 -

LSTM

+关注

关注

0文章

63浏览量

4443

发布评论请先 登录

相关推荐

热点推荐

Firefly-RK1828 赋能视频大模型:多目标+全场景,引领智能分析新风向

如今,在视频分析领域,传统检测模型存在这一局限:单个模型只能聚焦单一目标检测,面对复杂场景中多样的检测需求时,往往需要多套模型叠加部署才能满足。这不仅增加开发成本,还会有响应延迟、兼容

算法工程师需要具备哪些技能?

ResNet、VGG)。RNN/LSTM:序列建模(如时间序列预测、NLP中的文本生成)。Transformer:自注意力机制(如BERT、GPT)。

模型调优正则化:L1/L2正则化防止过拟合。超参数

发表于 02-27 10:53

大模型 ai coding 比较

序

我主要用途是 ai coding,从各种渠道获取到了很多 不同的大模型排序 最多的是 opus 4.6 > k2.5 > glm5 >

发表于 02-19 13:43

星地数据大模型融合分析与应用分系统平台的应用与未来发展

星地数据大模型融合分析与应用分系统 北京华盛恒辉星地数据大模型融合分析与应用分系统,是一套整合卫星通信与地面网络数据,依托大模型

一文读懂LSTM与RNN:从原理到实战,掌握序列建模核心技术

在AI领域,文本翻译、语音识别、股价预测等场景都离不开序列数据处理。循环神经网络(RNN)作为最早的序列建模工具,开创了“记忆历史信息”的先河;而长短期记忆网络(LSTM)则通过创新设计,突破

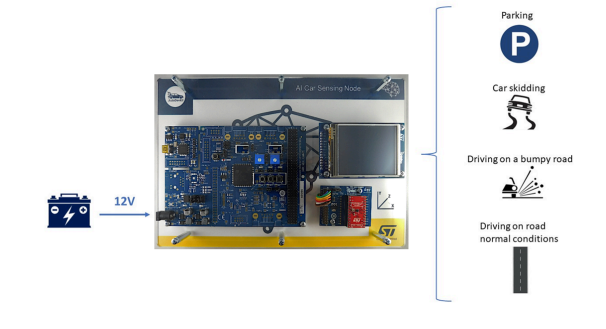

ST AEKD-AICAR1:基于边缘AI的汽车状态分类开发套件解析

STMicroelectronics AEKD-AICAR1车用AI套件基于长短期记忆 (LSTM) 循环神经网络 (RNN)。该套件提供汽车状态分类:汽车停车、普通道路行车、崎岖道路行车、汽车打滑或转弯。AEKD-AICAR1中的创新想法是定义具有嵌入式人工智能处理功能

知识分享 | 使用MXAM进行AUTOSAR模型的静态分析:Embedded Coder与TargetLink模型

分析:EmbeddedCoder与TargetLink模型文章内容来源:MES模赛思官方网站AUTOSAR(AUTomotiveOpenSystemARchite

大模型推理显存和计算量估计方法研究

GPU、FPGA等硬件加速。通过分析硬件加速器的性能参数,可以估算模型在硬件加速下的计算量。

四、实验与分析

为了验证上述估计方法的有效性,我们选取了几个具有代表性的深度学习模型,在多

发表于 07-03 19:43

大模型在半导体行业的应用可行性分析

的应用,比如使用机器学习分析数据,提升良率。

这一些大模型是否真的有帮助 能够在解决工程师的知识断层问题

本人纯小白,不知道如何涉足这方面 应该问什么大模型比较好,或者是看什么视频能够

发表于 06-24 15:10

双伺服电机驱动的钻床齿隙模型仿真分析

的电枢电压,是大齿轮的角速度,是大齿轮的转动惯量。

纯分享帖,需要者可点击附件免费获取完整资料~~~*附件:双伺服电机驱动的钻床齿隙模型仿真分析.pdf【免责声明】本文系网络转载,版权归原作者所有。本文所用视频、图片、文字如涉及作品版权问题,请第一时间告知,删除内容!

发表于 06-18 16:26

十字形多自由度超声电机接触分析模型研究

摘 要:十字形多自由度超声电机其动子绕X、Y轴旋转与绕Z轴旋转的驱动机理是不同的,根据弹性接触理论,对其进行了分别考虑,并建立了电机摩擦接触分析模型。利用建立的模型,对多自由度电机机械特性进行了估算

发表于 06-17 09:04

FA模型卡片和Stage模型卡片切换

卡片切换

卡片切换主要包含如下三部分:

卡片页面布局:FA模型卡片和Stage模型卡片的布局都采用类web范式开发可以直接复用。

卡片配置文件:FA模型的卡片配置在config.json中

发表于 06-06 08:10

IGBT模块吸收回路分析模型

尽管开关器件内部工作机理不同,但对于吸收电路的分析而言,则只需考虑器件的外特性,IGBT关断时模型可以等效为电压控制的电流源,开通时可以等效为电压控制的电压源。下面以下图所示的斩波器为例提出一般

KaihongOS操作系统FA模型与Stage模型介绍

FA模型与Stage模型介绍

KaihongOS操作系统中,FA模型(Feature Ability)和Stage模型是两种不同的应用模型

发表于 04-24 07:27

RNN与LSTM模型的比较分析

RNN与LSTM模型的比较分析

评论