本文提出了一种将视觉语言模型(VLM)转换为端到端导航策略的具体框架。不依赖于感知、规划和控制之间的分离,而是使用VLM在一步中直接选择动作。惊讶的是,我们发现VLM可以作为一种无需任何微调或导航数据的端到端策略来使用。这使得该方法具有开放性和可适用于任何下游导航任务的通用性。

01本文核心内容

导航问题的很大一部分涉及到与回答长上下文图像和视频问题所需的类似认知过程,这正是当代视觉语言模型(VLMs)擅长的领域。然而,当这些模型被直接应用于导航任务时,局限性便显现出来。具体而言,当给定一个与观察-动作历史相结合的任务描述时,VLMs 常常难以生成精细的空间输出以避开障碍物,并且无法有效利用其长上下文推理能力来支持有效的导航。

为应对这些挑战,先前的工作将VLMs作为模块化系统的一个组成部分,以执行高级推理和识别任务。这些系统通常包含一个明确的3D映射模块和一个规划器来处理任务中更具实体性的部分,例如运动和探索。虽然模块化具有让每个组件仅用于其擅长的子任务的优势,但也带来了系统复杂性和任务专业化的劣势。

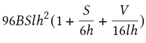

在本研究中,我们表明,现成的VLM可用作零样本和端到端的语言条件导航策略。实现这一目标的关键思路是将导航问题转化为VLM擅长的事情:回答有关图像的问题。

为此,我们开发了一种新颖的提示策略,使VLM能够明确考虑探索和避障问题。这种提示具有通用性,即它可用于任何基于视觉的导航任务。

与先前的方法相比,我们未使用特定模态的experts,未训练任何特定领域的模型,也未假定能够获取模型的概率。

我们在已确立的具身导航基准上对我们的方法进行了评估,结果表明,与现有的提示方法相比,我们的方法显著提高了导航性能。

02相关工作

最常见的学习端到端导航策略的方法是利用离线数据集从头训练模型。然而,大规模导航数据的收集颇具挑战,以致这些模型在推广至新任务或分布外环境时往往表现不佳。

另一种增强泛化能力的途径是利用机器人特定数据对现有的视觉语言模型进行微调。尽管此方法能生成更稳健的端到端策略,但微调可能会破坏微调数据集中未涵盖的特征,最终限制模型的泛化能力。

还有一种研究方向侧重于零样本使用这些模型,通过提示使模型的响应与任务规范相符。例如,使用CLIP或DETIC特征将视觉观测与语言目标对齐,构建环境的语义地图,并采用传统方法进行规划。其他研究工作设计了特定模块来处理探索任务。这些系统通常需要对置信度进行估计,以知晓何时停止探索,这通常通过使用令牌或对象概率来实现。此外,许多此类方法还采用了低级导航模块,将动作选择抽象为诸如快速行进法之类的预训练点到点策略。

视觉提示方法:为了提升VLMs的任务特定性能,近期的工作包括在将图像传递给VLMs之前对其进行物理修改。

为具身导航提示VLMs:CoNVOI在图像上覆盖数字标记,并提示VLMs输出与上下文线索(例如,留在人行道上)一致的这些标记序列,将其用作导航路径。与我们的工作不同,它们(i)依赖低级规划器来避开障碍物,而非直接将VLMs的输出作为导航动作;(ii)未利用VLMs引导代理朝向特定目标位置。PIVOT引入了一种与我们最为相似的视觉提示方法。他们通过将单步动作表示为指向图像上带标签圆圈的箭头来处理导航问题。在每个步骤中,从各向同性的高斯分布中采样动作,其均值和方差根据VLMs的反馈迭代更新。在优化分布后选择最终动作。虽然PIVOT能够处理各种现实世界的导航和操作任务,但它有两个显著缺陷:(i)未纳入深度信息来评估动作提议的可行性,导致移动效率较低;(ii)选择单个动作需要多次调用VLMs,导致较高的计算成本和延迟。

03方法架构

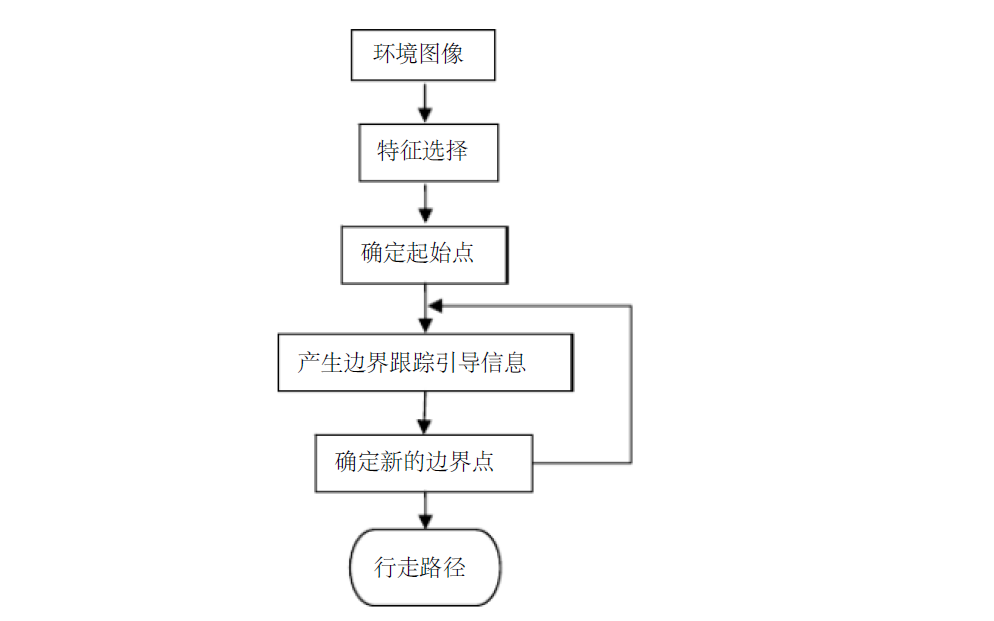

我们提出了VLMnav,这一导航系统将目标G(可以用语言或图像来指定)、RGB-D图像I、姿态ξ作为输入,并随后输出动作a。动作空间由机器人框架中绕偏航轴的旋转和沿前轴的位移组成,使得所有动作都能以极坐标来表示。由于已知VLM在处理连续坐标时存在困难,我们转而将导航问题转换为从一组离散选项中选择动作。我们的核心思路是以避免障碍物碰撞并促进探索的方式来选择这些动作选项。

我们首先通过使用深度图像来估计障碍物的距离,从而确定局部区域的可通行性。我们利用深度图像和姿态信息来维持场景的自上而下的体素地图,并显著地将体素标记为已探索或未探索。这样的地图由动作提议器使用,以确定一组避免障碍物并促进探索的动作。然后,通过投影组件将这组可能的动作投影到第一人称视角的RGB图像上。最后,VLM接收此图像和精心设计的提示作为输入,以选择一个动作,由代理执行。为确定情节的终止,我们使用一个单独的VLM调用。

04实验

我们在两个广受欢迎的具身导航基准测试ObjectNav和GoatBench上对我们的方法进行了评估,这两个基准测试均使用了来自Habitat-Matterport3D数据集的场景。此外,我们还分析了端到端VLM智能体的性能如何随设计参数的变化而改变,例如视场、用于提示模型的上下文历史长度以及深度感知的质量。

设置:智能体采用半径为0.17米、高度为1.5米的圆柱体形状。我们为智能体配备了一个以自我为中心的RGB-D传感器,其分辨率为(1080,1920),水平视场角(FOV)为131°。摄像头像中那样向下倾斜25°,有助于确定可导航性。考虑到其成本低且效果好,我们在所有实验中均使用GeminiFlash作为VLM。

指标:与之前的工作相同,我们使用以下指标:(i)成功率(SR):成功完成的情节所占的比例;(ii)成功率加权逆路径长度(SPL):路径效率的衡量指标。

基线:我们使用PIVOT作为基线,因为它与我们的方法最为相似。为研究我们的动作选择方法的影响,我们将其剔除,评估“Oursw/onav”:与我们的方法相同,但不含可导航性和动作提议器组件。此基线的动作选择是一组静态的、等距分布的动作选择,包括转身动作。值得注意的是,这些动作未考虑可导航性或探索。为进一步评估视觉注释的影响,我们还评估了基线“PromptOnly”,它能看到以文本描述的动作(“转身”、“向右转”、“向前移动”等),但没有视觉注释。这些不同的提示基线可在图5中可视化。

05总结

在这项工作中,我们提出了VLMnav,这是一种新颖的视觉提示工程方法,能够使现成的VLM充当端到端的导航策略。该方法背后的主要思路是精心挑选动作提议并将其投射到图像上,有效地将导航问题转化为问答问题。通过在ObjectNav和GOAT基准上的评估,我们发现其性能相较于迭代基线PIVOT(在视觉导航提示工程方面先前的最先进水平)有了显著提升。我们的设计研究进一步凸显了宽视场的重要性以及仅使用RGB图像来部署我们的方法的可能性。

我们的方法存在一些局限性。禁用“允许滑动”参数后性能的大幅下降表明存在多次与障碍物的碰撞,这在实际部署中可能会成为问题。此外,我们发现像[A benchmark for multi-modal lifelongnavigation]这样的专用系统表现优于我们的工作。然而,随着VLM能力的不断提高,该方法或能够帮助未来的VLM在具身任务中达到或超越专用系统的性能。

-

导航

+关注

关注

7文章

531浏览量

42458 -

语言模型

+关注

关注

0文章

530浏览量

10299 -

深度图像

+关注

关注

0文章

19浏览量

3515

原文标题:实现端到端导航!基于视觉语言模型的导航框架VLMnav

文章出处:【微信号:gh_c87a2bc99401,微信公众号:INDEMIND】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

相关推荐

【大语言模型:原理与工程实践】大语言模型的基础技术

【大语言模型:原理与工程实践】大语言模型的评测

视觉导航关键技术及应用

基于视觉自动导航车的物资搬运系统设计

视觉信号辅助的自然语言文法学习

微软视觉语言模型有显著超越人类的表现

可同步目标导向行为和记忆空间结构的视觉导航方法

超大Transformer语言模型的分布式训练框架

探究超大Transformer语言模型的分布式训练框架

视觉语言导航领域任务、方法和未来方向的综述

机器人基于开源的多模态语言视觉大模型

基于视觉语言模型的导航框架VLMnav

基于视觉语言模型的导航框架VLMnav

评论