本文提出了一种新方法,通过使用点到平面匹配将VIO/VSLAM系统生成的稀疏3D点云与数字孪生体进行对齐,从而实现精确且全球一致的定位,无需视觉数据关联。所提方法为VIO/VSLAM系统提供了紧密集成的6自由度全局测量。在高保真GPS模拟器上进行的实验以及从无人机收集的真实世界数据表明,我们的方法优于最先进的VIO-GPS系统,并且与最先进的视觉SLAM系统相比,在应对视点变化方面具有更出色的鲁棒性。

01 本文核心内容

在复杂环境中实现精确且全球一致的位姿估计对于诸如自动驾驶车辆和无人机之类的自主系统,以及视障人士的辅助技术而言,是一项关键需求。相机和惯性测量单元(IMU)通常被用于解决位姿估计问题,这得益于它们成本低、设计轻巧以及具有互补的测量能力——相机能提供丰富但数据率低且依赖于环境的数据,而IMU可提供高数据率、低维度且不受环境影响的数据。视觉惯性里程计(VIO)和视觉SLAM算法融合相机和IMU的测量结果,并在局部坐标系中输出位姿估计值。局部坐标系通常在算法初始化时被设定为单位位姿。由于相机和IMU提供的是局部测量,加之存在噪声和建模简化,这些算法会随时间累积漂移。

为了在全局固定坐标系(例如,东-北-上(ENU)参考坐标系)中获取位姿估计值并减少漂移,会在位姿估计过程中纳入全局测量。最常使用的全局测量是GPS。然而,GPS测量在室内无法获取,在城市峡谷等区域通常存在噪声且不可靠,因为在这些地方信号反射和阻塞现象很常见。结果,GPS测量有时可能比VIO/VSLAM系统自身生成的位姿估计更不确定。

VSLAM系统通过使用视觉测量结果将自身定位到预先构建的地图来补偿漂移。定位问题通过匹配当前相机视图和地图之间的视觉特征来解决。标准技术会匹配特征描述符。而较新的研究工作则用神经网络替代了特征描述符。无论采用何种匹配技术,所有基于视觉的定位方法都依赖于当前相机视图与参考地图中视图的相似性,这在许多情况下限制了它们的有效性,例如将无人机拍摄的航拍图像定位到白天和夜间由地面车辆记录的地图上,或者将基于其他光谱相机(例如红外相机)的VIO/VSLAM系统定位到由标准相机记录的地图上。

尽管在VIO-GPS算法和视觉定位技术方面有了不少进展,但现有的方法仍难以完全应对在城市环境中实现全球一致、低漂移位姿估计的挑战,这是由于它们所依赖的全局测量存在固有的噪声、稀疏性或视点依赖性。

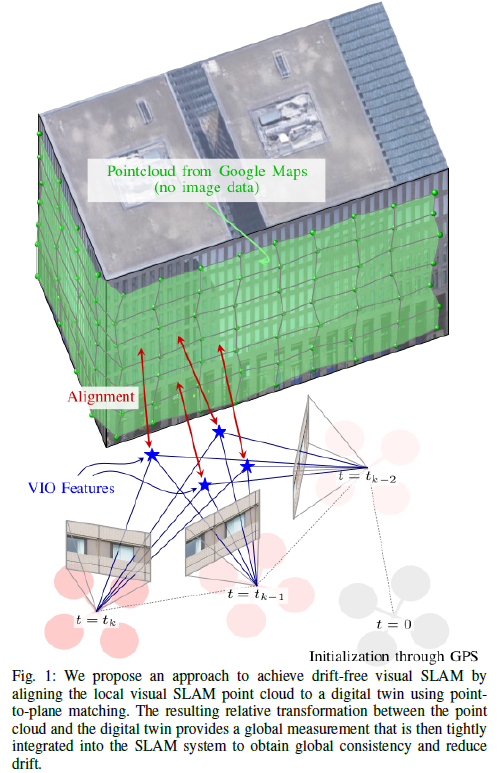

为应对这些挑战,我们提议使用几何信息(例如3D点云、网格)来定位数字孪生体。特别地,我们引入了一种新颖的方法,将VIO/VSLAM系统生成的局部地图(稀疏3D点云)定位到几何数字孪生体上。我们的方法使用局部VIO/VSLAM点云与数字孪生体的网格表示进行点到平面的匹配,提供了一个紧密融合到VIO/VSLAM系统中的新的全局测量。

我们的实验在我们在该项目背景下开发的高保真GPS模拟器以及使用在城市中飞行的无人机进行的真实世界测试中,均证明了所提出方法优于当前最先进的VIO-GPS方法。结果表明,与基于特征描述符匹配的传统视觉定位技术相比,我们的方法不仅能更有效地减少漂移,而且在视点变化时具有更强的鲁棒性。

02 主要贡献

本工作的主要贡献为:

• 一种新颖的算法,其通过点到平面匹配将局部且稀疏的VSLAM3D点云定位到数字孪生体,因而独立于视觉匹配。

• 在VSLAM系统中紧密融合此类定位测量,以在城市环境中达成全球一致、低漂移的位姿估计。

• 在使用新型高保真GPS模拟器和在城市中飞行的无人机所采集的真实世界数据的模拟实验中,我们展示了我们的方法相对于最先进的VIO-GPS系统的优势。

•我们表明,所提出的局部-全局地图定位比基于图像特征描述符匹配的最先进视觉定位技术更稳健。

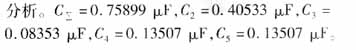

03 方法架构

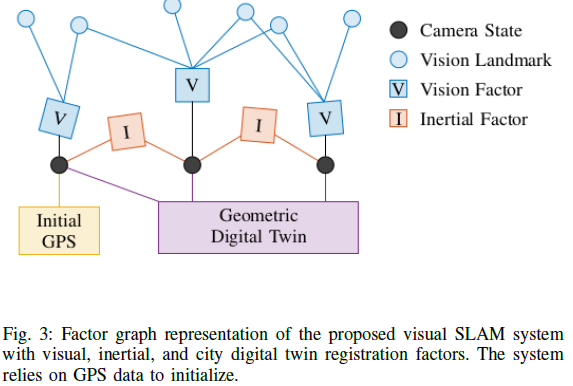

我们提出了一种VSLAM系统,其借助场景几何结构将自身定位于数字孪生体,从而在城市环境中达成低漂移且全局一致的姿态估计。此定位问题被构建为点云配准问题,可通过点到平面的ICP算法高效解决。具体而言,我们通过将VSLAM系统生成的局部稀疏3D点云与城市数字孪生体进行配准,获取全局测量值。接着,在VSLAM姿态估计过程中,此全局测量值与当前相机和IMU测量值紧密耦合。另外,我们提出一种算法,能自适应地找出用于在VSLAM中融合全局测量值的权重。这种自适应加权解决方案使我们能够考虑到配准问题的不确定解,这些解源自退化情况且取决于场景几何结构。

04 实验

为了评估我们方法的有效性,我们在模拟环境和真实世界环境中均开展了实验。我们将我们的方法与四个基准方法进行了对比。为了将我们的方法与整合GPS数据的VIO系统作比较,我们选取VINS-Fusion和SVO-GPS作为基准。VINS-Fusion将VIO与GPS测量值松散耦合。相反,SVO-GPS在VIO滑动窗口优化中紧密耦合GPS测量值。为了将我们的方法与基于视觉特征匹配来实现闭环的SLAM系统进行对比,我们选择SVO-LoopClosure和ORB-SLAM3。SVO-LoopClosure与我们的系统采用相同的VIO管道。ORB-SLAM3是一个通过匹配ORB特征来执行闭环的视觉SLAM系统。

A.模拟结果

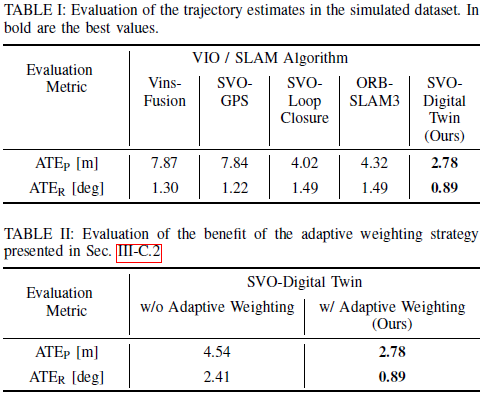

我们的系统SVO-DigitalTwin以及基线所实现的绝对轨迹误差在表I中报告。估计的轨迹与真实轨迹一起绘制在图4中。SVO-DigitalTwin在位置和旋转方面实现了最佳的绝对轨迹误差,优势显著。具体而言,相对于表现最佳的基线,ATEp和ATER分别提高了31%和27%。

我们在表II中纳入了一项消融研究,以验证我们的自适应加权策略。改进后的ATE误差验证了所提出的自适应加权策略的益处。

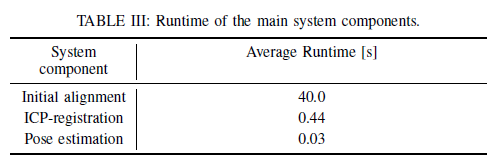

我们在表III中列出了主要系统组件的运行时间。我们为初始对齐步骤设定了一个时间长度。在这段时间过后,我们检查是否满足收敛标准(见第III-D节)。如果满足,则认为对齐成功。如果不满足,我们会积累更多的GPS测量值,直到满足该标准。姿态估计的运行时间是从图像捕获到估计出该图像的相机姿态所经过的时间。

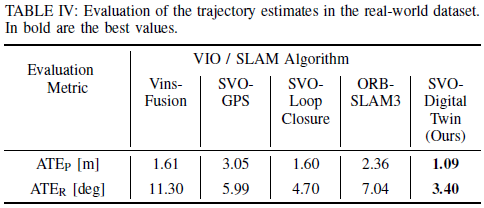

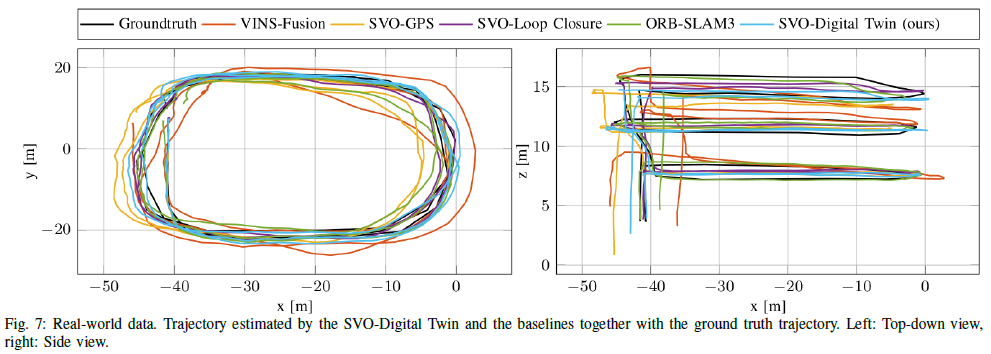

B.真实世界实验

我们的系统SVO-DigitalTwin以及基线所产生的绝对轨迹误差在表IV中报告。估计轨迹与真实轨迹一同绘制在图7中。SVO-DigitalTwin在位置和旋转方面大幅实现了最佳的绝对轨迹误差。具体而言,相对于表现最佳的基线,ATEp和ATER分别提高了32%和28%。由于SVO-GPS将GPS与视觉和惯性数据紧密耦合,GPS测量的高度不确定性,其性能有所下降。

此外,我们针对提出的帧对齐策略,评估了其与将VSLAM姿态估计与基于世界坐标系的参考地面真值姿态进行对齐的效果。我们的对齐策略实现了0.50米的平移误差和0.79度的航向误差。否则,在我们的对齐策略中仅使用GPS测量将导致8.11米的平移误差和6.77度的航向误差。

05 总结

综上所述,本文提出了一种通过利用数字孪生体的几何信息来降低VIO/VSLAM系统漂移的新方法。通过引入一种通过点到平面匹配将VIO/VSLAM生成的点云定位到城市数字孪生体的方法,我们解决了依赖GPS或视觉定位技术的方法所存在的局限性。我们在高保真GPS模拟器和真实世界的无人机飞行进行的实验中,均展示了该方法相较于现有系统的优越性,特别是在减少漂移和处理视点变化方面。(想要了解更多文章细节的读者,可以阅读一下论文原文~)

-

SLAM

+关注

关注

23文章

423浏览量

31813 -

自动驾驶

+关注

关注

784文章

13774浏览量

166339 -

数字孪生

+关注

关注

4文章

1318浏览量

12237

原文标题:超越VIO–GPS!应对复杂环境的Digital Twins无漂移视觉SLAM

文章出处:【微信号:gh_c87a2bc99401,微信公众号:INDEMIND】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

相关推荐

矢量混频器表征和混频器测试系统矢量误差修正的新方法 白皮书

一种求解非线性约束优化全局最优的新方法

一种复制和粘贴URL的新方法

一种产生激光脉冲新方法

一种无透镜成像的新方法

一种降低VIO/VSLAM系统漂移的新方法

一种降低VIO/VSLAM系统漂移的新方法

评论