前言:

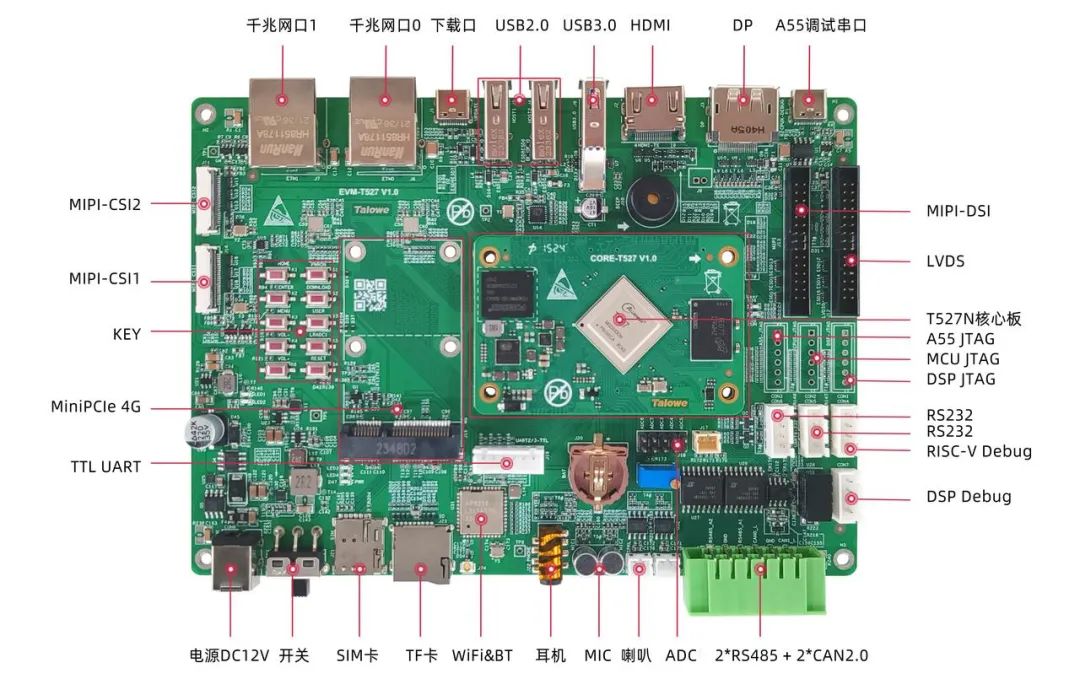

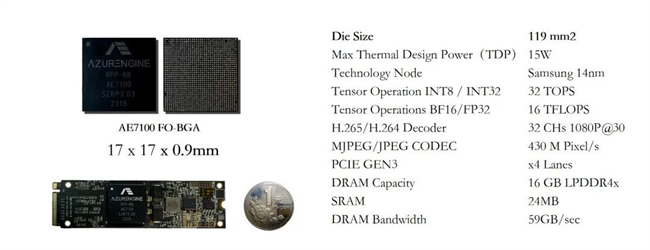

在AIoT领域,搭载Ubuntu系统的眺望T527开发板,仅凭2GB内存便成功运行15亿参数的DeepSeek-R1轻量级大模型!在边缘端上演一场算力革命,这一突破性进展不仅刷新了边缘AI设备的性能天花板,更昭示着低成本、低功耗的AI普惠时代加速到来。

一、DeepSeek-R1 x Ollama简介

1.1DeepSeek-R1模型

DeepSeek-R1 1.5B作为一款轻量级语言模型,拥有 15 亿参数。该模型不仅在文本生成、对话交互和代码补全领域表现优异,更通过精简参数规模实现了显著效率提升——其优化的推理速度、较低的计算需求以及灵活的部署特性,使得在资源受限的嵌入式设备上也能实现流畅运行,有效降低硬件门槛。该模型具备跨平台兼容性,全面支持 Linux/Windows/macOS 操作系统及 ARM 架构设备,使开发者无需依赖云端服务即可在本地环境中高效部署 AI 应用。

1.2Ollama开源框架

Ollama 是一个开源的大型语言模型(LLM)平台,旨在让用户能够轻松地在本地运行、管理和与大型语言模型进行交互。提供了一个简单的方式来加载和使用各种预训练的语言模型,支持文本生成、翻译、代码编写、问答等多种自然语言处理任务。不仅仅提供了现成的模型和工具集,还提供了方便的界面和 API,使得从文本生成、对话系统到语义分析等任务都能快速实现。

二、部署实战:Ollama环境下的三步极速部署

2.1Step1 环境搭建

#ollama安装推荐两种方式#官网提供Linux脚本安装curl -fsSL https://ollama.com/install.sh | sh

#手动安装https://github.com/ollama/ollama/releases

2.2Step2 模型加载

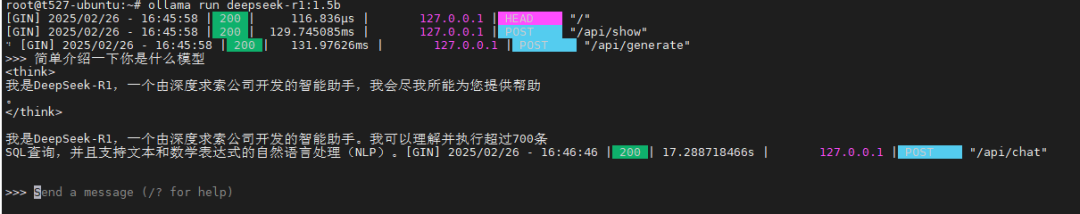

ollama run deepseek-r1:1.5b

2.3Step3 实时推理验证

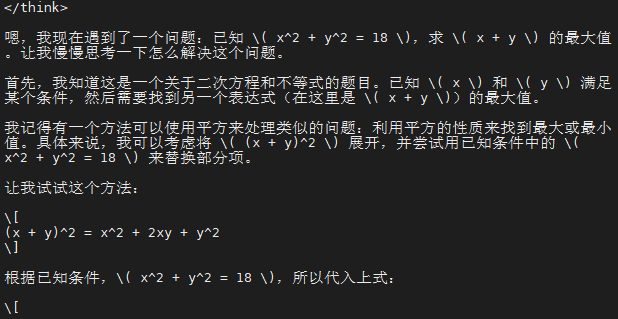

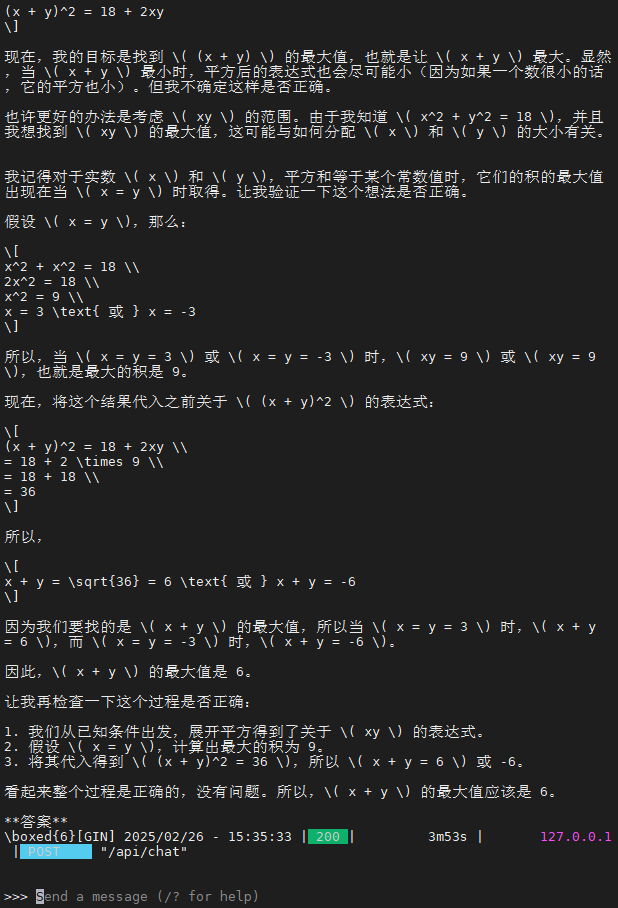

已知x²+y²=18,求x+y的最大值

三、T527评估板测试效果

3.1环境说明

使用眺望电子EVM-T527N开发套件,搭载2GB内存配置,板载运行Ubuntu20.04系统。通过SSH登入主板运行模型,Debug调试口用于监测运行器件资源消耗。

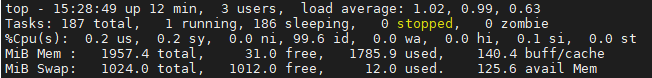

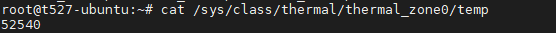

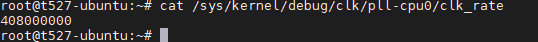

3.1资源监控

Ollama 是一个开源的大模型服务工具,调用的是CPU进行的运算,内存资源和CPU使用消耗较大,在无风扇环境下,温升约30℃。

结语

当主流AI芯片还在比拼NPU算力时,全志T527用实际表现证明,真正的边缘智能不在于参数堆砌,而在于在严苛资源限制下实现可用、易用、好用的AI赋能。2GB内存跑通Ubuntu系统下15亿参数DeepSeek大模型验证了眺望电子对T527系列处理器的深度优化与强大可靠。这背后是眺望电子在低功耗、低成本AI解决方案领域的技术实力体现。如果您对部署过程感兴趣,欢迎随时与我们联系,我们可以为您提供专业的技术支持,期待与您合作!

-

AI

+关注

关注

87文章

32590浏览量

271905 -

核心板

+关注

关注

5文章

1055浏览量

30220 -

AIoT

+关注

关注

8文章

1439浏览量

31371 -

DeepSeek

+关注

关注

1文章

641浏览量

442

发布评论请先 登录

相关推荐

了解DeepSeek-V3 和 DeepSeek-R1两个大模型的不同定位和应用选择

添越智创基于 RK3588 开发板部署测试 DeepSeek 模型全攻略

RK3588开发板上部署DeepSeek-R1大模型的完整指南

100%国产化FPGA核心板!骨折价——限时仅售299元!

芯动力神速适配DeepSeek-R1大模型,AI芯片设计迈入“快车道”!

deepin UOS AI接入DeepSeek-R1模型

DeepSeek-R1本地部署指南,开启你的AI探索之旅

AIBOX 全系产品已适配 DeepSeek-R1

广和通支持DeepSeek-R1蒸馏模型

Deepseek R1大模型离线部署教程

Infinix AI接入DeepSeek-R1满血版

行芯完成DeepSeek-R1大模型本地化部署

在英特尔哪吒开发套件上部署DeepSeek-R1的实现方式

实战案例 | 299元国产工业级AI核心板部署DeepSeek-R1

实战案例 | 299元国产工业级AI核心板部署DeepSeek-R1

评论