都说最难读懂的是人心,这种复杂高等动物互相理解都有难度。然而,科技却可能轻而易举地做到了。在我们还没搞清楚自己脑子想什么,情绪是快乐还是愤怒时,人工智能就准确冷静不带感情色彩地指了出来,通过简单的“读脑”“握手”“看脸”,就能轻松看透你,简直是比你自己都更了解你。

读脑绘图像

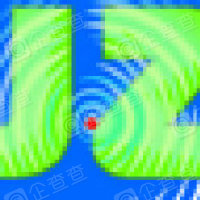

拷贝别人记忆不是梦

多伦多斯卡伯勒大学的神经科学家团队开发出了一种“读心术”方法,通过扫描你的大脑,来展现你脑海中想象的图像,按照实验,这种读心术方法几乎万无一失。完成这项“读心”任务的是科学家制造出的一种“读心机器人”,简单来说就是一种人工智能程序,这种程序通过识别大脑中的电子信号,来复制描绘大脑中的图形形状。该团队一边让受试者观看电脑屏幕上的人脸图片,一边用脑电图系统记录他们的脑电波,通过机器人学习算法运行脑电波数据,以数字方式重现受试者刚刚看到的人脸图像。

这项技术依赖于电脑程序“神经网络系统”,也就是由人工智能来模拟大脑工作时的脑电波数据,然后将其数字化并呈现出来。理论来说,这种程序不仅可以学习捕捉大脑中看到人脸图像时所形成的数据信号,对于一些演讲内容、文字数据、动态图像等都可以进行识别。所以,虽然目前实验仅完成了对人脑看到的人脸图像的识别和描绘,未来对于人脑中形成的关于文字、数据、动态图像都可以实现复制和重现。

研究人员在培训这种“读心机器人”时,首先让其通过大量的人像数据库掌握人脸的基本形状和标志特征。当机器人可以识别面部特征之后,再将这些特征与相对应的脑电图信号相关联。这样,在受测人员观察人脸图像时,机器人就可以根据他们当时的脑电图反馈准确描绘出人脑中所反射出的图像。

实验参与人、神经科学家阿德里安·内斯特对于结果非常兴奋,“机器人最终描绘出的可不是简单的四边形或是三角形轮廓,而是由细微笔触构成的人脸模拟图。这样不仅可以重建人们看到的东西,而且还可以用来表达他们想象出来的,或者记忆中的内容。”内斯特说,“这就出现了另外一种价值,执法部门可以通过这个方法,从目击者那里收集到潜在嫌疑人的信息。”

或许有一天,人们的记忆将呈现另一种可能性,就像英剧《黑镜》中所展现的那样,人们可以任意地拷贝或者回放一个人大脑中的记忆。同时,这种技术的实现也可能在医学上提供参考价值,为失语者提供一种表达自己思想的手段。

看脸识情绪

真正的测谎仪要来了

通过看脸色、眉眼高低就可以识别一个人的情绪,一直是区分机器人是否真“智能”的一个标准,世界各大领域的技术大咖也都在努力让人工智能学会“察言观色”。谷歌的研究者们开发了一款网页应用,向人们展示由人工智能创作的小动物绘画,然后通过摄像头记录人们看到绘画时的反应,准确识别观众的喜好之后,网页就可以更好地“投其所好”绘画,这也应该是“察言观色”的最初级体现。

跟谷歌团队不同的是,麻省理工学院的研究者们正在针对“负面”情绪在探索,因为恐惧、恶心时的表情可能会更夸张,人工智能也就更容易上手。

另外,类似美国知名初创公司Affectiva的诸多企业都在探索有情感的人工智能,以及让机器更好地理解人类面部表情和社会行为的技术。比如说如何让无人驾驶汽车识别司机情绪,在司机分心时接管驾车任务等。

人工智能理解人类情绪的方法其实和人类一样,无非就是通过面部表情变化判断情绪波动。即使人会故意控制面部表情和声音不产生变化或者展现出与内心世界不一样的表情和声音,也总会露出一些破绽,只不过可能会很微小或一闪而过,让人不易察觉。但对于人工智能来说,发现细微的现象或捕捉稍纵即逝的变化正是他们的长项,他们可以借助高速摄像机和高性能处理器来完成这项工作,从这个方面来说,人工智能对人类情绪的理解可能会比人还优秀。

人工智能情绪识别的能力用处极大,在医疗业、服务业甚至审讯领域都会发挥不小的作用,就像美剧《Lie to me》能透过辨别微表情指认犯罪者一样,也许会在不久后实现。

握手辨性格

自闭儿童将有新伙伴

机器人的可怕之处不仅在于可以洞察你的大脑,还能够从一次简单的握手中,瞬间挖掘到你的性格。据英国《每日邮报》报道,研究人员正在研发类人的情感机器人,它们对于触觉相当敏感,所以仅从简单的肢体接触就可以判断对方的性别、情绪和性格,从而回应以相对的感情安慰。这样的机器人就不仅仅看起来像人,还拥有和人类相似的社交能力,通过感情慰藉来融入到人类环境中。

“给机器人赋予情感是唯一可以拉近它们和人类之间情感距离的方法。”巴黎萨克雷大学的教授阿德里亚娜表示,“我们此后的研究方向就是让机器人能够拥有一个‘玻璃心’,敏感到可以感知人类情绪,并学会礼貌、同情或者幽默地回应人类的情绪。”研究人员在初期的实验中已经完成了机器人通过握手的简单肢体接触就能判断对方性别的能力,且正确率达到75%。

阿德里亚娜解释:“我们首先设定了男女不同性别在握手这个动作中的不同表现模式,比如男女在握手时的力度、幅度上和时间都不一样,外向的人和内向的人表现出的握手姿势和频率也不一样,通过给机器人‘灌输’这些握手模式,让它们能够在实际操作中识别对方身份。”

为了能够更全面准确地进行模式设定,研究人员对大量男女握手姿势进行了观察研究,除了握手力度、摆动幅度、时间长度、放松程度的区别外,研究人员还发现,男士主动握女士手时普遍习惯手臂更向下伸,推测是因为一般女士都更矮小,造成男士握手的习惯动作。如果这种敏感的感知能力可以推行,那么未来机器人可能扮演的角色将有很多,比如成为自闭症孩子最好的朋友,或者孤寡老人的贴心“老伴儿”。

此前的一份调查显示,5岁至18岁之间的青少年中,有20%表示更愿意与机器人交朋友。而对于有自闭症的孩子来说,机器人的敏感和贴心也更会成为打动这些孩子并换以真心的特质。

相关知识

人工智能怎么学习

以上所有的人工智能“读心术”归根结底都还是基于其“深度学习能力”才能达成的。人工智能之所以具备学习能力,是因为它也有类似人类的大脑——人工神经网络(ANN),它的本质就在于试图模仿大脑神经元之间的传递处理信息的模式。

人工神经网络的创造理念受到生物学的启发,是生物神经网络的一种模拟和近似,它从结构、实现机理和功能上模拟生物神经网络。一般认为,人工神经元网络是由大量神经元通过极其丰富和完善的连接而构成的自适应非线性动态系统。因为生物的学习系统是由相互连接的神经元组成的异常复杂的网络,其中每一个神经元单元有一定数量的实值输入,并产生单一的实数值输出。这种输入和输出模式基于数学统计学类型的学习方法得以优化,所以人工神经网络也是数学统计学方法的一种实际应用。

这种神经网络依靠系统的复杂程度,通过调整内部大量节点之间相互连接的关系,达到处理信息的目的,自身也就具备了学习和自适应的能力。

-

机器人

+关注

关注

211文章

28466浏览量

207315 -

人工智能

+关注

关注

1791文章

47350浏览量

238759 -

深度学习

+关注

关注

73文章

5504浏览量

121224

原文标题:未来机器人能有多懂你:读脑绘图像 看脸认嫌犯 握手辨性格

文章出处:【微信号:jingzhenglizixun,微信公众号:机器人博览】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

相关推荐

未来机器人:读脑绘图像 看脸认嫌犯 握手辨性格

未来机器人:读脑绘图像 看脸认嫌犯 握手辨性格

评论