为研究夜间追尾事故中本车智能防撞预警方法,本文提出了一种基于毫米波雷达和机器视觉的前方车辆检测方法。利用多传感器融合数据,检测前方车辆的距离、速度等。建立传感器之间转换关系,转换雷达目标的世界坐标到图像坐标。

在图像上形成感兴趣区域,利用图像处理方法减少干扰点,运用 Dempster-Shafer(D-S)证据理论,融合特征信息,得到总的信任度值检验感兴趣区域内的车辆。实验采集多段夜间道路行车视频数据,统计实现尾灯识别的帧数,与主观判断进行比较。结果表明:该方法能够实现对夜间前方车辆的检测和定位。

本文来自 2016 年 6 月 15 日出版的《 汽车安全与节能学报 》,作者是吉林大学交通学院的金立生教授和程蕾以及清华大学汽车安全与节能国家重点实验室的成波教授。

道路交通事故中由追尾相撞导致的事故占很大比例,而夜间交通事故尤为严重,约占交通事故总数的 40%。夜间车辆检测技术已成为智能车辆安全辅助驾驶系统的重要组成部分,用于准确地识别夜间前方车辆,为驾驶员及时提供前方车辆信息及路况,降低夜间交通事故的发生 [1]。

夜间由于光线强度不够,大部分白天的车辆特征信息已经不可用,因此用于白天的车辆检测算法基本失效。车辆尾灯是夜间车辆的明显特征,目前,对于夜间前方车辆检测识别的研究主要是利用单目视觉传感器,获取车辆前方的视觉感知信息,基于图像信息提取尾灯特征进行前方车辆识别。

刘尊洋等人结合车辆尾灯的颜色与亮度检测尾灯 [2];吴海涛等人对前车灯对配对进行车辆的跟踪 [3];唐佳林等人采用帧差法提取感兴趣区域 [4];王孝兰选择基于模糊理论的分割方法对图像进行分割,提取车牌、尾灯的特征 [5];祁秋红等人通过色调(hue)-饱和度(saturation)-明度(value)的颜色模型(HSV)对尾灯的颜色信息进行分割,辨出车辆位置[6];周俊杰采用基于R通道直方图的红(red)-绿(green)-蓝(blue)彩色(RGB)空间自适应阈值分割图像,自适应效果不是很理想 [7]。

机器视觉是一种用于车辆检测的有效传感器,但其有一定的局限性,因此有文献提出综合考虑激光雷达和机器视觉的信息,进行前方目标车辆检测 [8-9]。虽然激光雷达和机器视觉在一定程度可以互补,但激光雷达对天气、灯光、障碍物表面光滑度等干扰非常敏感,不适合复杂道路环境。

由于毫米波雷达不易受外界干扰而且测量的距离精度高,可以准确获得前方车辆的速度、角度等深度信息。因此,本文提出利用毫米波雷达和机器视觉进行多传感器数据融合,通过先验知识筛选毫米波雷达探测到的障碍物数据,融合雷达数据和图像信息初步确立动态感兴趣区域(Region of Interest,ROI),在缩小的范围内基于视觉传感器提取表征车辆的特征,运用 D-S 证据理论(Dempster-Shafer Evidential Theory)融合信息,减少了计算量和主观阈值对检测精确度的影响,提高了执行速度和车辆定位的准确性。

1. 夜间车辆检测算法实现

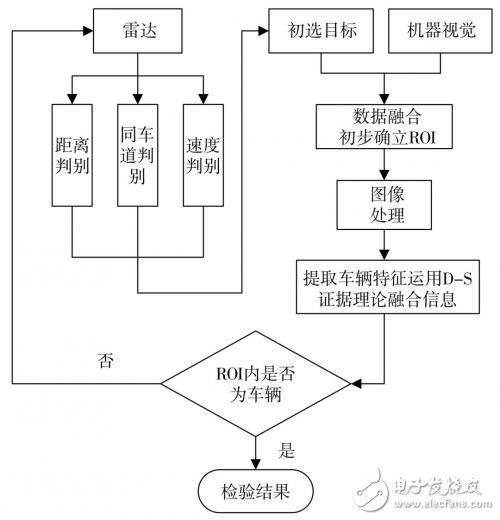

整个过程分为假设产生(Hypothesis Generation,HG)和假设检验(Hypothesis Verifcation,HV)两部分:

假设产生过程利用雷达获取候选目标的的距离、角度、速度等信息,进而得到候选目标的世界坐标,逆用摄像机标定原理得到世界坐标与图像像素坐标的转换关系,初步确定候选目标在图像上的区域,即感兴趣区域 ROI;

假设验证过程是通过改进的自适应阈值确定方法(大津法,OTSU 法)进行图像分割处理,进而利用图像处理方法、先验知识和 D-S 证据理论对感兴趣区域检测是否存在车辆特征。

图 1 夜间前方车辆检测方法流程图

算法流程图如图 1 所示。

2. 假设产生(HG)

2.1 雷达数据处理及初选目标的确定

毫米波雷达接收到的是十六进制数据,根据雷达协议解算数据,并提取可以用于车辆检测的有效信息包括:前方车辆相对于本车的角度、距离、速度、反射强度。在实际测量中,毫米波雷达获取的信号有一部分是空目标信号、无效目标信号、静止目标信号,首先要去除这 3 种目标信号的干扰。

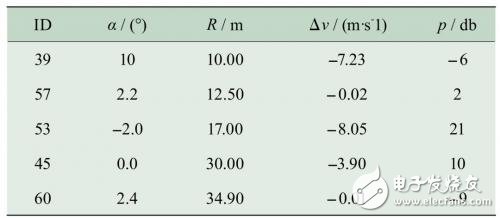

根据国家规定车道宽度设置横向宽度阈值,进行目标与自车的同车道判断,保留行驶方向距离阈值和相对速度阈值内的目标,对筛选出的前方目标由近及远的原则重新排序,使用同车道近距离原则初选有效目标,如表 1 所示。

表 1 初选有效目标信号

表 1 中:ID 表示雷达检测得到的目标信号的标准帧号;α、R、Δv 分别为本车与目标信号的相对角度、相对距离、相对速度(∆v = v1 - v0,v1 为目标速度,v0 为本车速度);p 从目标返回信号的强度,即反射率。

长距离的毫米波雷达扫描范围是 1~175 m,中距离是 1~60 m。距离小于 1 m 时雷达就不能识别物体。以避免车辆行驶过程中与前方车辆发生追尾碰撞为出发点,在有效目标选择过程中最关注的是与本车位于同一车道的前方最近车辆。当 Δv<0,有出现追尾事故的可能。因此,把雷达扫描近距离 1~60 m 内、离本车最近且 Δv<0 的车辆作为初选目标。

2.2 雷达数据和机器视觉的融合

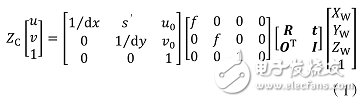

雷达和机器视觉是不同坐标系的传感器,因此要实现雷达和机器视觉的空间融合,必须建立两传感器所在坐标系的转换模型,即雷达坐标与图像像素坐标之间的转换。雷达坐标系与图像像素坐标系之间有着密切的联系 [10],按照右手系原则建立坐标系,由式 (1)-(2) 确定坐标系之间的空间位置关系。

将世界坐标系中的点 ( XW, YW, ZW ) 变换到图像像素坐标 ( u, v ),转换公式为:

式中:( XW, YW, ZW, 1 )^T 是点的世界坐标,与其对应的摄像机齐次坐标是 ( XC, YC, ZC, 1 )^T,dx 与 dy 分别表示每个像素在横、纵轴上的物理单位下的大小,f 是摄像机的焦距,s' 表示因摄像机成像平面坐标轴相互不正交引出的倾斜因子(Skew Factor),R 代表旋转矩阵(为一个 3×3 的正交单位矩阵),t 代表平移向量,I 是元素全为 1 的对角矩阵,O=(0, 0, 0)^T。

毫米波雷达获取的前方障碍物信息是在极坐标下的二维信息,将障碍物 P 的极坐标下的二维信息转换到直角坐标系中,雷达坐标系的 X0O0Z0 平面与世界坐标系的 XOZ 平面平行,两平面之间的距离为 Y0,通过雷达可以得到前方车辆中心点投影到雷达扫射平面内的点 P 相对雷达的距离 R 和角度 α,确定点 P 在世界坐标系下的坐标,转换关系如下:

由雷达获得前方车辆形心点的输入,综合以上建立雷达坐标系和图像像素坐标系之间的相对关系,即可获得前方车辆在像素平面的投影,基于车辆的常用外形(宽高比)投影在像素平面上,建立可以根据距离变化的动态感兴趣区域,缩小在图像上的搜索时间,减少计算量。通过统计发现一般车辆的宽高比在 0.7~2.0 范围内,常见轿车、运动型多功能车(Sport Utility Vehicle,SUV)、面包车、商用车辆等车型的宽高比在 0.7~1.3 范围内 [11],为了避免后续尾灯检测时会遗漏尾灯目标,本文选取常见几种车型的最大宽高比 W/H=1.3。

动态感兴趣区域的确定如下:

式中:( x_lt, y_lt ),( x_rb, y_rb )分别为动态感兴趣矩形区域的左上角点和右下角点的像素坐标,( x, y )为车辆形心点的像素坐标。

图 2 雷达扫描图

图 3 雷达目标在图像上的的 ROI

雷达扫描图如图 2 所示。雷达坐标系中的目标经坐标转换关系在图像上形成的感兴趣区域如图 3 中的 (a) 列所示。动态感兴趣区域的大小会随目标的距离发生变化,以更适合的尺寸截取感兴趣区域图像进行下一步检测验证,缩小了检测范围,从而减少计算量提高检测实时性。获取的感兴趣区域图像如图 3b 列所示。

3. 假设验证(HV)

3.1 图像分割

前方车辆尾灯对的灰度级与路面及背景的灰度级有明显区别,采用阈值分割的方法可以快速准确地将尾灯对分割出来。

本文采用改进的 OTSU 算法分割图像,凸显出表征车辆特征的尾灯部分。改进的 OTSU 算法是以传统 OTSU 为基础,从最小灰度值到最大灰度值遍历,当灰度 T 使得方差 σ^2 = w_0*w_1*(μ_0-μ_1)^2 最大时,再次利用传统 OTSU 对图像中大于 T 的部分从灰度 T 到最大灰度值遍历,得到阈值 T0 使大于灰度值 T 的部分的方差最大,提取阈值 T0,用 T0 对感兴趣区域图像进行二值化分割,目标灰度为 1,背景灰度为 0。

图 4 分割后图像

分割后的图像如图 4 所示。

-

机器视觉

+关注

关注

162文章

4370浏览量

120307 -

雷达

+关注

关注

50文章

2934浏览量

117504

发布评论请先 登录

相关推荐

毫米波雷达信号的传输特性

毫米波雷达的基频和调制技术 毫米波雷达在机器人导航中的应用

毫米波雷达与超声波雷达的区别

毫米波雷达与多普勒雷达区别是什么

简述毫米波雷达的结构、原理和特点

基于毫米波雷达的手势识别算法

《道路车辆毫米波雷达协同式干扰抑制方法》国标成功立项

巍泰技术毫米波雷达如何助力道路车辆预警?静态目标检测是关键

基于毫米波雷达和机器视觉的夜间前方车辆检测方案

基于毫米波雷达和机器视觉的夜间前方车辆检测方案

评论