对城市自动驾驶语义分割的开源数据集的理解可能会对工程师如何训练自动驾驶模型有所帮助。

最近10年我们在语义分割数据集的创建和算法提升方面付出了很多努力。最近得益于深度学习理论的发展,我们在视觉场景理解的子领域中获得了不少进步。深度学习的缺点是需要大量的标注数据,这里我们整理了一些广泛应用的城市语义分割的数据集,希望可以为自动驾驶领域提供借鉴。

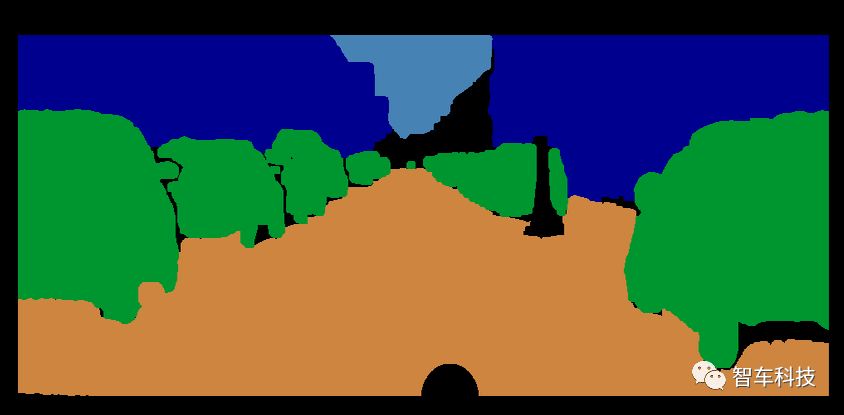

这是我们关于如果为自动驾驶提供语义分割数据集系列文章中的第一篇。语义分割标注任务主要是指在像素级水平上,把图片中的物体按照类分别标注。这些类可能是行人,车辆,建筑物,天空,植被等等。例如,语义分割可以帮助SDCs(自动驾驶车辆)识别一个图片中的可行驶区域。

数据集

| 名字 | 时间 | 类别 | 图片数量 | 地点 | 环境 |

|---|---|---|---|---|---|

| CamVid | 2007 | 32 | 700 | Cambridge | 白天 |

| KITTI | 2012 | N/A | N/A | Kalsruhe | 白天 |

| DUS | 2013 | 5 | 500 | Heidelberg | 白天 |

| CityScapes | 2016 | 30 | 5000 (+20000) | 德国,瑞士,法国 | 气候 (春/夏/秋) |

| Vistas | 2017 | 66 | 25000 | 美国,欧洲,非洲,亚洲大洋洲 | 晴天、下雨、下雪、雾黄昏、白天,晚上 |

CAMVID

CamVid(960x720px)

这是最早用于自动驾驶领域的语义分割数据集,发布于2007年末。他们应用自己的图像标注软件在一段10分钟的视频中连续标注了700张图片,这些视频是由安装在汽车仪表盘的摄像机拍摄的,拍摄视角和司机的视角基本一致。

KITTI

KITTI Dataset(1242*375px)

KITTI数据集发布于2012年,但是他们起初不标注好的语义分割图像,而是后来由另外的团队标注而成。然而这个数据集没有包括对道路的标注。这个小数据集是由安装在车顶部的一系列传感器包括灰度传感器,彩色相机,雷达扫描仪和GPS/IMU单元拍摄而成。

DUS

DUS Dataset(1024*440px)

这个数据集包括5000灰度图像,其中只有500张标注过的语义分割图片。与其他数据集不同的是,它不包括“自然”这一分类。因为尺寸小,所以它比较适合用来测试语义分割模型的表现效果。

CityScapes

Cityscapes Dataset(2048*1024px)

它是DUS数据集的扩展版本,在更多的地形和气候条件下录制来获取更多变的城市景观。这个数据集也包括了很多粗糙的图片来提升大量弱标注的数据的表现效果。和DUS类似,相机是安装在挡风玻璃后面。图片中的30个类别也被分成了8个大类。这个数据集的一个特征就是它提供了20000多张粗分割的图片。很多深度学习技术应用这个传统的数据集来提升他们IoU评分。

最近的模型一般IoU都在80%以上,一下链接包含了他们的打分系统还有实施准则。

Mapillary

Mapillary Vistas Dataset

是一个街景图片平台,平台注册用户可以共同合作参与去制作更好的地图。他们开放了部分图片数据集并且以像素级精度标注了这些图片。在写这篇文章时,它是世界上最大的做多样化的开源数据集,地理范围跨越了大陆。

由于这个平台上的图片使大众一起收集的,所以图片角度有很多种类。

-

数据集

+关注

关注

4文章

1212浏览量

24900 -

自动驾驶

+关注

关注

785文章

13966浏览量

167322 -

深度学习

+关注

关注

73文章

5522浏览量

121693

原文标题:自动驾驶领域的语义分割数据集有哪些

文章出处:【微信号:IV_Technology,微信公众号:智车科技】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

相关推荐

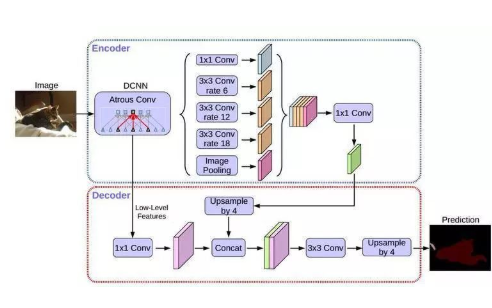

聚焦语义分割任务,如何用卷积神经网络处理语义图像分割?

DeepLab进行语义分割的研究分析

语义分割算法系统介绍

大华股份AI刷新了Cityscapes数据集中语义分割任务的全球最好成绩

基于深度学习的三维点云语义分割研究分析

基于深度神经网络的图像语义分割方法

广泛应用的城市语义分割的数据集整理

广泛应用的城市语义分割的数据集整理

评论