现有的计算机视觉算法并不完美。在2018年7月,谷歌的研究人员证明了一种流行的物体检测应用程序接口(API)可能会被欺骗,以至于将猫识别为“疯狂的被子(由各色布料拼制成的被面)”和“玻璃纸”。不幸的是,这还不是最糟糕的:它们也可能被迫对图像中的方块进行计数,对数字进行分类,并执行预定任务之外的其他任务。

谷歌的研究人员在Arxiv.org发表了一篇题为“神经网络的对抗性重编程”的论文,描述了一种能够对机器学习系统进行重新编程的对抗性方法。转移学习(transfer learning)的新形式甚至不需要攻击者指定输出。

研究人员写道:“我们的结果首次证明 ......可能会发生对神经网络进行重新编程的对抗性攻击......。这些结果证明了深度神经网络存在令人惊讶的灵活性和脆弱性。”它的工作原理如下:恶意行为者获得了正在执行任务的敌手神经网络的参数,然后以转换的形式引入扰动或对抗数据,并借以输入图像。随着对抗性输入被馈送到网络中,它们会将网络学习到的特征应用于执行新的任务。

科学家在六种模型中测试了该方法。通过嵌入来自MNIST计算机视觉数据集的操纵输入图像(大小在1到10之间的黑色帧和白色方块),他们成功使得所有六种算法将计算目标改为计算图像中的方块数,而不是识别像“白鲨”和“鸵鸟”这样的对象。在第二个实验中,他们强迫上述算法对数字进行分类。在第三次也是最后一次测试中,他们让模型识别来自CIFAR-10(一个物体识别数据库)的图像,而不是当初训练它们的ImageNet语料库。

恶意行为者可以通过攻击来窃取计算资源,例如,通过重新编程云托管照片服务中的计算机视觉分类器来解决图像验证码或挖掘加密货币。尽管该论文的作者没有在反馈神经网络(一种常用于语音识别的神经网络)中测试该方法,但据他们设想,成功的攻击可能会导致这类算法执行“一系列非常大的任务”。

研究人员写道:“对抗性程序也可以被用做一种新方法,以实施更传统的计算机黑客行为。例如,随着手机被越来越多地用做人工智能驱动的数字助理,对某些人的手机进行重新编程的可能性将会增加,方式是用对抗性图像或音频文件对这些手机进行攻击。由于这些数字助理可以访问用户的电子邮件、日历、社交媒体帐户和信用卡,因而此类攻击的后果也会变得更大。”

幸运的是,并不只有坏消息。研究人员指出,随机神经网络似乎比其他神经网络更不容易受到攻击,并且对抗性攻击可以使机器学习系统更易于调整用途、更灵活、更高效。尽管如此,研究人员写道,“未来应该调查如何解决对抗性编程的性质和局限性,以及防范的可能方法。”

-

谷歌

+关注

关注

27文章

6142浏览量

105110 -

神经网络

+关注

关注

42文章

4764浏览量

100546

原文标题:研究人员找到“绑架”神经网络的方法

文章出处:【微信号:AI_News,微信公众号:人工智能快报】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

相关推荐

卷积神经网络与传统神经网络的比较

不同类型神经网络在回归任务中的应用

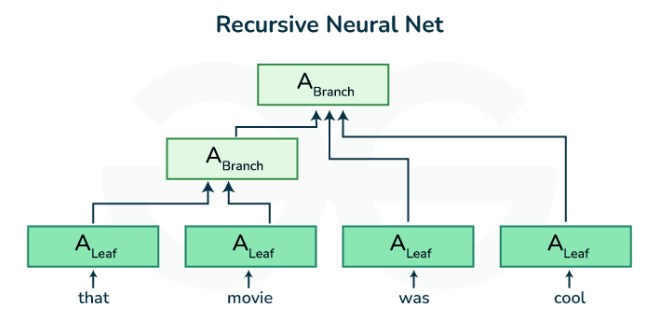

递归神经网络和循环神经网络的模型结构

迫使神经网络完成计划之外的任务

迫使神经网络完成计划之外的任务

评论