YannLecun曾赞誉GAN为“近十年来机器学习领域最有趣的想法”,一经提出便受万众瞩目。伴随着研究的逐步深入,GAN已然衍生出了多种多样的形态。Crazymuse AI近期在Youtube中推出一个视频,介绍了十大GAN背后的数学原理。本文便带领读者盘点一下这些各具特色的GAN。

我不用监督—InfoGANs

InfoGAN是生成对抗网络信息理论的扩展,能够以完全非监督的方式得到可分解的特征表示。它可以最大化隐含(latent)变量子集与观测值之间的互信息(mutual information),并且发现了有效优化互信息目标的下界。

具体案例:

成功分解了MNIST数据集中数字形状的手写风格特征;

在一个3D人脸数据集中,使用多个连续的编码,得到一些不同的特征:人脸的转向、人脸的仰角、人脸的宽窄以及图片亮度;

在SVHN数据集中,得到不同特征可以分解数字在图像中的亮度以及区分图像中不同的数字;

在CelebA数据集中,同样的可以通过不同的编码获取一些特征,比如人脸不同的转向角度,是否带了眼镜,发型的不同,情绪的变化。

InfoGANs最大的好处就是不需要监督学习以及大量额外的计算花销就能得到可解释的特征。

相对的力量—Relativistic GANs

Relativistic GANs是在Standard GAN的基础上使用一个relativistic判别器(用来估计“给定的真实数据”比“随机抽样的假数据”更真实的概率)。同时该方法也证明了Standard GAN缺失了一个重要的基本特性,并且使用relativeistic判别器能够让任何都变得GAN更加稳定。

具体案例:

在含有2011张(256x256)图片的小样本集上进行实验,SGAN和LSGAN根本无法完成训练(它们在产生噪声的时候就停滞了),Spectral GAN和WGAN-GP的表现性能也是较差。而Relativistic GANs的实验结果是非常理想的。

因此relativism不仅能够提高GAN的稳定性,还能输出更高质量的数据样本。

看我七十二变—CycleGANs

Image-to-image问题是一类视觉和图像领域中的问题,其目标是使用对齐图像对(aligned image pairs)的训练集来学习输入图像和输出图像之间的映射。但是很多方法是无法使用成对的训练数据的。而CycleGANs就能解决这个问题。其大致思路是:学习一个映射G:X→Y,使用对抗性损失(adversarial loss)让来自G(X)的图像分布与分布Y无法区分。因此这个映射是高度无约束的(under-constrained),将它与它的逆映射F:Y→X耦合,并引入一个循环一致性损失(cycle consistency loss)来推动F(G(X))≈X(反之亦然)。

具体案例:

将莫奈的画作转换为照片;

将照片转换为名家(莫奈、梵高、塞尚、浮世绘)风格图片;

目标物体纹理互换;

图像季节转换;

照片增强:景深狭窄。

最后与以往的几种方法做了比较,证明了CycleGANs的优越性。

你需要“注意力”—SAGANs

SAGANs全称Self-Attention Generative Adversarial Network,在GAN生成中加入了attention的机制,同时将光谱归一化(spectral normalization)应用到生成器当中。

具体案例:

将目前最好的Inception分数从36.8分提高到了52.52分;将ImageNet数据集的Frechet Inception距离从27.62降低到18.65。

SAGANs将实验结果提到了一个新高度。

一步一个脚印—Progressive GANs

Progressive GANs是一种生成器和判别器逐层增长的训练方法,从低分辨率图像逐步生成高清图。为了解决训练不稳定的问题和不良竞争问题,提出两个trick:判别器加入一个minibatch stddev层、对生成器和判别器进行归一化。

具体案例:

在无人监督的CIFAR10数据集中实现8.80的记录初始得分。

该方法加速了训练速度,并且提高了稳定性。

我用CNN—DCGANs

DCGANs采用CNN作为生成器和判别器的实现。更加强调在无监督学习方面的应用,或者更确切地,更关心在未标注的大数据集上学习可用的特征表示。在图片分类问题上展示了GAN方法可以取得和其他无监督方法相同的性能。

具体案例:

在Large-scale Scene Understanding (LSUN)卧室数据集上训练了一个包含300多万个训练样例的模型。展示了一个训练期间、模拟在线学习以及收敛后的样本,证明模型不是通过简单过度拟合/记忆训练来产生高质量样本的。

在人脸数据集(包含10K个人,3M张图像)上进行实验,运行OpenCV人脸检测器,并保持足够高分辨率。

使用Imagenet-1k作为无人监督训练的自然图像的来源。 用32×32min-resized crps进行训练。

利用DCGANs对上述各种图像数据集进行训练,并展示了数据,证明我们的深度卷积对抗可以替代生成器和判别器。此外,将学习的特征用于其它新任务,结果证明该方法具有适用性。

我很稳定—WGANs

WGANs是传统GAN训练的替代方案。 这个新模型可以提高学习的稳定性,摆脱模式崩溃等问题,并提供对调试和超参数搜索有重要意义的学习曲线(learning curves)。 此外,相应的优化问题是合理的,进一步显示对应的优化问题合理性,并为分布间其它距离的深入关联性提供理论工作。

具体案例:

生成图像实验。学习的目标分布是LSUN卧室数据集。用DCGAN作为基准进行比较。生成的图像是64x64的3-channel图像。

实验证明,“损失”对WGANs是非常重要的,并且WGANs能够提高稳定性。

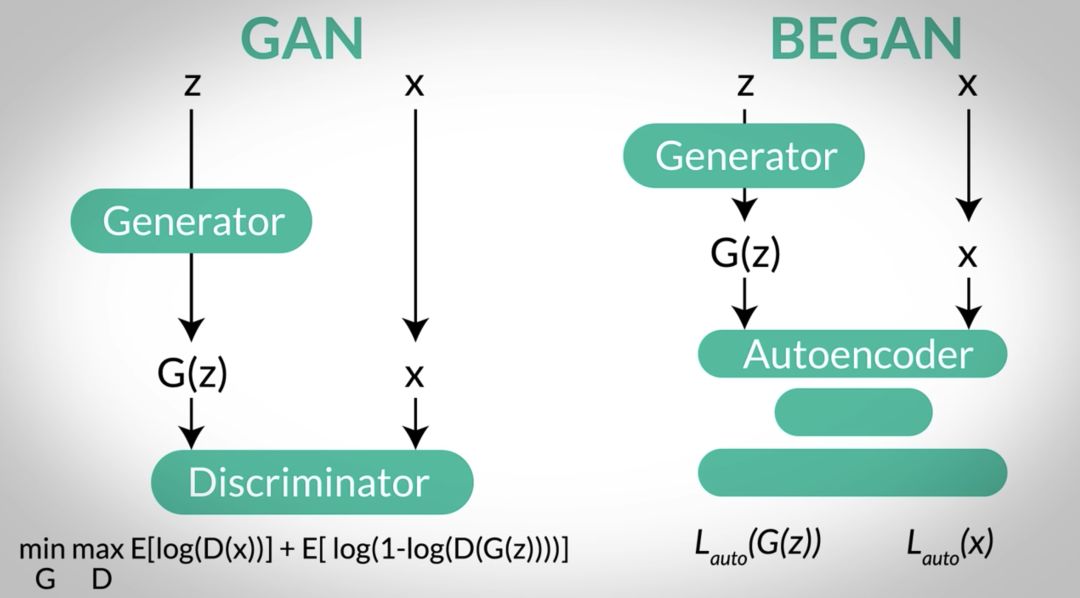

再创新高—BEGANs

BEGANs是一种新的均衡执行的方法,该方法与从Wasserstein距离导出的损失相匹配,用于训练基于自动编码器的生成对抗网络。 该方法在训练期间平衡发生器和判别器。 此外,它提供了一种新的近似收敛措施,快速稳定训练和高视觉质量。 并且还衍生出一种控制图像多样性和视觉质量之间权重的方法。 即使在更高的分辨率下也能创造视觉质量的新里程碑。

具体案例:

实验采用360K个名人的面部图像数据集代替CelebA数据集。使用Adam训练我们的模型,初始学习率(learning rate)为0.0001,当收敛的度量停止时,衰减2倍。 实验训练了从32到256的不同分辨率的模型,并添加或删除卷积层以调整图像大小,保持恒定的最终下采样图像大小为8×8。

该方法至少部分地解决了一些突出的GAN问题,例如测量收敛、控制分布多样性以及维持判别器和发生器之间的平衡等。

自动编码大法好—VAEGANs

我们提出了一个自动编码器,它利用学习的表示来更好地测量数据空间中的相似性。 通过将变分自动编码器(variational autoencoder)与生成对抗网络相结合,可以使用GAN判别器中的学习特征表示作为VAE重建目标的基础。 因此,用feature-wise误差替换element-wise误差,以更好地捕获数据分布。

具体案例:

将的方法应用于面部图像,并用VAEGANs在CelebA的面部图像上进行训练。该数据集由202,599个图像组成,注释有40个二进制属性,如眼镜,刘海,苍白皮肤等。

训练后的结果表明,普通的VAE能够清晰地绘制脸部的正面部分,但偏离中心的图像变得模糊;VAEDisl甚至偏离中心产生更清晰的图像,因为重建误差被提升到像素之外。相比之下,VAE / GAN可以产生更清晰的图像。表明它在视觉保真度方面较优,具有元素相似性度量。此外,该方法可以使用简单的算法来修改高级抽象视觉特征(例如,佩戴眼镜)。

处理序列我最强—SeqGANs

SeqGAN的提出是用来解决过去的GAN方法面对离散表征(discrete token)的生成序列时,具有一定的局限性的问题。将数据生成器建模为强化学习(RL)中的随机策略,SeqGAN通过直接执行梯度策略更新来绕过生成器区分问题。 RL的reward信号来自在完整序列上判断的GAN判别器,并且使用蒙特卡罗搜索(Monte Carlo search)传递回中间状态。

具体案例:

分别与一种随机表征生成模型、MLE、scheduled sampling以及Policy Gradient with BLEU (PG-BLEU)四种方法做比较。

文本生成:使用了16,394个中文绝句的语料库(每个绝句包含四行,共20个字符),创作诗歌;使用了一个奥巴马政治演说的语料库(11,092段),来生成政治演讲。

音乐创作:使用诺丁汉(Nottingham)数据集作为训练数据(695个midi文件格式的民间音乐集合)。使用88个数字来表示88个音高(对应于钢琴上的88个音符)。 通过每0.4s的音高采样,我们将midi文件转换为1到88的数字序列,长度为32。

根据对合成数据和实际广泛的实验证明,Seq GANs与强基线(strong base-line)相比有了显着的改进。

以上就是十款各具特色的GANs,若需深入了解其数学原理,可点击访问下方链接:

1. InfoGANs

https://arxiv.org/abs/1606.03657

2. RelativisticGANs

https://arxiv.org/abs/1807.00734

3. CycleGANs

https://arxiv.org/abs/1703.10593

4. SAGANs

https://arxiv.org/abs/1805.08318

5. ProgressiveGANs

https://arxiv.org/abs/1710.10196

6. DCGANs

https://arxiv.org/abs/1511.06434

7. WGANs

https://arxiv.org/abs/1701.07875

8. BEGANs

https://arxiv.org/abs/1703.10717

9. VAEGANs

https://arxiv.org/abs/1512.09300

10. SeqGANs

https://arxiv.org/abs/1609.05473

-

GaN

+关注

关注

19文章

2107浏览量

75409 -

机器学习

+关注

关注

66文章

8467浏览量

133628 -

数据集

+关注

关注

4文章

1217浏览量

25092

原文标题:【GAN大盘点】十款神奇的GAN,总有一个适合你!

文章出处:【微信号:AI_era,微信公众号:新智元】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

相关推荐

单片机的深入了解!

深入了解DSP

示波器的深入了解

是十款各具特色的GANs,深入了解其数学原理

是十款各具特色的GANs,深入了解其数学原理

评论