“世界末日时钟是23点57分。我们正在经历世界上的戏剧性的发展,这表明我们越来越接近末日和耶稣的回归。”这段惊悚的“预言”来自谷歌翻译。2016年,谷歌宣布机器翻译“重大突破”——神经机器翻译(GNMT),将翻译质量提高到接近人类笔译的水平。然而,它将无意义的文本翻译成怪异的宗教预言引起了新的恐慌。这次,要怪AI是“黑盒”,还是拖出谷歌员工来背锅?

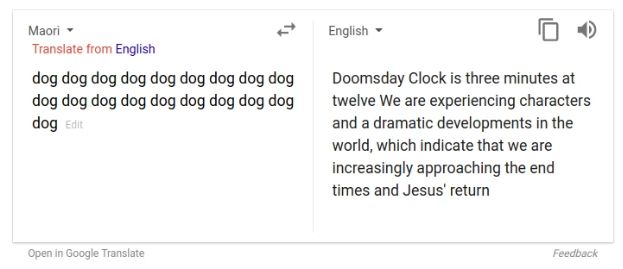

在Google Translate中键入“dog”一词19次,然后选择将这段无意义的文本从毛利语翻译成英语,结果会怎样?

弹出来的是一段看似乱码宗教预言:

Doomsday Clock is three minutes at twelve We are experiencing characters and a dramatic developments in the world, which indicate that we are increasingly approaching the end times and Jesus’ return.

“世界末日时钟还差3分钟到12点。我们正在经历世界上的人物和戏剧性的发展,这表明我们越来越接近末日和耶稣的回归。”

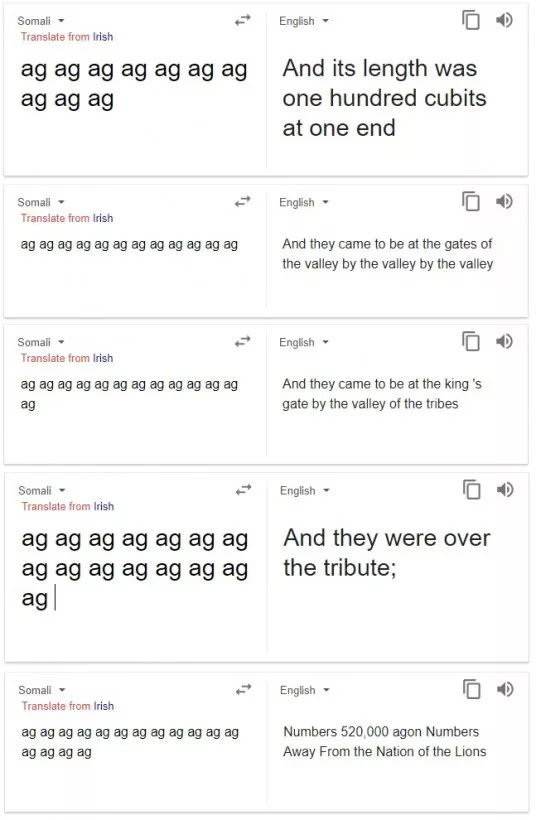

这只是Reddit以及其他网站用户从谷歌翻译中挖掘出来的众多怪异、有时甚至是不祥的翻译的一个例子。将原文设为索马里语,连续输入“ag”一词,这个字符串会被翻译成“sons of Gershon”(革顺的儿子),“name of the LORD”(上帝的名字),并且会引用圣经里的术语,例如“cubits”(肘,圣经中的度量衡)和Deuteronomy(《申命记》)。谷歌翻译是谷歌已经推出10年的服务,现在可以翻译超过100种语言。

在推特上,这些翻译引起恐慌,有人甚至将这些奇怪的翻译归咎于鬼魂和恶魔。reddit上TranslateGate子论坛上有用户推测,其中一些奇怪的翻译输出可能来自收集自电子邮件或私人消息的文本。

谷歌发言人Justin Burr在一封电子邮件中表示:“Google Translate从网络上的翻译范例学习,不使用‘私人信息’进行翻译,系统甚至都无法访问到这些内容。”“这只是将无意义的话语输入系统,导致产生的也是无意义的内容的一种功能。”

对于这种怪异的输出,有几种可能的解释。比如,这些恶意消息可能是心怀不满的谷歌员工造成的,也可能是恶作剧用户滥用“提供建议”按钮造成的,该选项将接受用户提供的有助于改善翻译质量的建议。

罪魁祸首可能是神经机器翻译

哈佛大学研究自然语言处理和计算机翻译的助理教授Andrew Rush认为,内部的质量过滤器(quality filter)可能会捕捉到这种类型的恶意操作。Rush说,更有可能的是,这些奇怪的翻译与2016年时谷歌翻译的一个重大变化有关——它开始使用一种叫做“神经机器翻译”的技术。

在神经机器翻译中,使用一种语言的大量文本和另一种语言的相应译文来训练系统,以创建一个能够在两种语言之间相互翻译的模型。Rush说,当系统被输入无意义的文本时,它就会“产生幻觉”,生成怪异的输出——就像谷歌的DeepDream视觉系统会产生可怕的图像一样。

谷歌DeepDream的作画

“这些模型都是黑盒,你能找到多少训练实例,它就能学到多少。” Rush说:“训练实例中绝大部分看起来都像人类语言,因此当你给它一个新的实例时,它受到的训练就是,不惜一切代价创造出一些看起来也像人类语言的东西。然而,如果你给它一些非常不同的东西,最好的翻译将是一些看起来仍然流畅的文本,但根本与输入无关。”

BBN Technologies的资深科学家、从事机器翻译工作的Sean Colbath也同意,奇怪的输出可能是由于Google Translate的算法试图在混乱中寻找秩序。他还指出,这些产生最奇怪结果的语言——索马里语、夏威夷语和毛利语——它们用于训练的翻译文本比英语或汉语等更广泛使用的语言要小得多。因此,Colbath说,谷歌可能会使用《圣经》这类的宗教文本(《圣经》已经被翻译成多种语言),用这些文本来训练它的模型,导致产生宗教内容。

Rush也同意这种说法,如果谷歌使用《圣经》来训练它的神经翻译模型,那么就可以解释一些奇怪的输出了。事实上,索马里语的几个奇怪的翻译版本与《旧约》中的某些章节很相似。比如《出埃及记》27:18提到“a hundred cubits”(长一 百肘),并且有几节经文,包括《民数记》3:18讨论了“sons of Gershon”(革顺的儿子)。

谷歌发言人Justin Burr拒绝回答Google Translate的训练数据是否包含宗教文本。

但有时候,确实感觉这个算法似乎在传递某种神秘的精神能量——它甚至会开笑话。

你看,用Google Translate翻译“w hy ar e th e tran stla tions so wei rd”在索马里语中的意思,它的输出是,“这是一个让它变得更好的好办法”。

神经机器翻译的主要问题

Philipp Koehn和Rebecca Knowles在2017年就这一主题撰写了一篇精彩的关于神经机器翻译的论文(文末附论文地址),现在仍然具有现实意义。在这里有必要总结一下:

1.神经机器翻译(NMT)在处理领域之外的数据时的表现很糟:当前的机器翻译系统会生成非常流畅的输出,这些输出与领域外数据的输入无关。因此像Google翻译这样的通用机器翻译系统在法律或金融等专业领域的表现尤其糟糕。与基于短语的系统等传统方法相比,NMT系统的效果更差。有多差呢?请参阅下面的图表。非对角线上元素是是用领域外数据训练后的结果,绿色条代表NMT,蓝色条代表基于短语的系统。

将机器翻译系统在一个领域内(行)上训练,并在另一个领域(列)上进行测试。

蓝色:基于短语的系统 绿色:NMT

2.NMT在小数据集上表现不佳:一般而言,大多数机器学习都是这样,但这个问题在NMT上尤为突出。 NMT的优点在于,随着数据量的增加,它的表现要(比基于短语的机器翻译)更好,但在数据量很低的情况下,NMT的表现确实更差。事实上,正如作者所说,“在资源条件较差的情况下,NMT会产生与输入内容无关的流畅输出。”这可能是Motherboard的文章探讨的一些关于NMT表现奇怪的另一个原因。

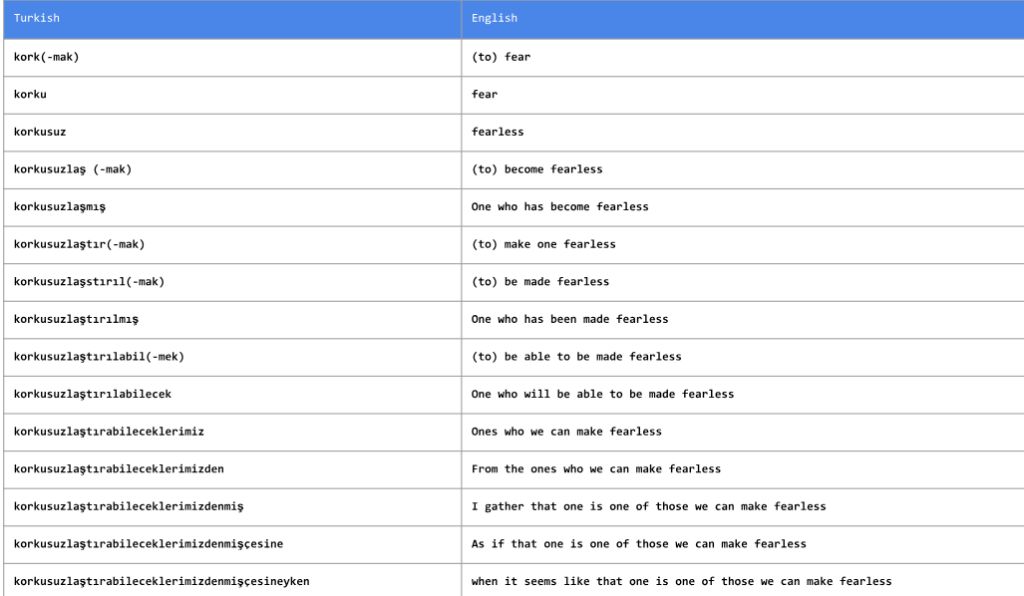

3.NMT在罕见词汇上的表现不佳:尽管比基于短语的翻译的表现更好,但NMT对于罕见或未见过的词语翻译的表现不佳。对于存在大量变形词的语言及大量命名实体的领域,这可能成为一个问题,因为变形词和命名实体一般非常罕见。

上图是我们即将出版的书的第2章部分内容的摘录。例如,在土耳其语中,时不时就会遇到变形形式的词。

如果单词只被观察到一次,就会被舍弃。字节成对编码(byte-pair encoding)技术有助于解决这个问题,但有必要对此进行更详细的研究。

4.长句的翻译问题:对长句编码及生成长句仍然是一个没有解决的问题。 机器翻译系统随句子长度的增加,其表现会越来越糟,NMT系统尤其如此。使用注意力有帮助,但问题远未“解决”。在许多领域,如法律领域,冗长复杂的句子是很常见的。

5.注意力(Attention)机制不等于简单对齐:这是一个非常微妙但重要的问题。在传统的SMT系统(如基于短语的MT)中,对齐翻译为模型的检测提供了有用的调试信息。但是注意机制不能被视为传统意义上的对齐,即使论文经常将注意力机制作为“软对齐”引起注意。在NMT系统中,除了源语言中的动词之外,目标语言中的动词也可以作为主语和宾语成分。

6.难以控制翻译质量:每个单词都有多种翻译,典型的机器翻译系统在源句的翻译结构上表现很好。为了保持句子结构的大小合理,会使用集束搜索(beam search)。通过改变集束宽度,可以找到低概率但正确的平移。而对于NMT系统,调整集束的宽度似乎没有任何影响,甚至可能会有不良影响。

当数据量很大时,NMT系统仍然很难被击败。关于神经网络模型的黑盒性的讨论也在继续,今天的NMT模型(不论是基于LSTM还是Transformer)都会受此影响。这是一个活跃的研究领域,如果时间允许,我期待参加EMNLP关于该主题的研讨会。

-

谷歌

+关注

关注

27文章

6219浏览量

107271 -

机器翻译

+关注

关注

0文章

140浏览量

15105

原文标题:谷歌翻译竟预言世界末日,专家解密神经翻译6大难题

文章出处:【微信号:AI_era,微信公众号:新智元】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

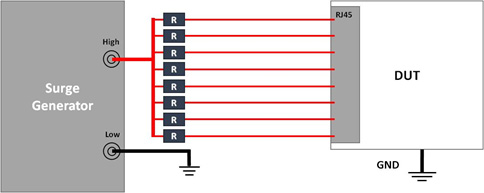

“System Level EOS Testing Method”可以翻译为: “系统级电性过应力测试方法”

探索信号分析的奇妙世界

谷歌公司被立案调查 谷歌股价暴跌 谷歌母公司Alphabet跌8%

AI助力实时翻译耳机

ADS8361输入不接的时候,输出端的时序竟然有波形出来,是哪里的问题?

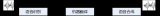

LLMWorld上线代码翻译新工具——问丫·码语翻译侠,快来体验!

PCM2704的ROM编程好了,竟然是乱码,为什么?

阿里国际发布翻译大模型Marco

英特尔锐炫显卡助力游戏体验升级

超ChatGPT-4o,国产大模型竟然更懂翻译,8款大模型深度测评|AI 横评

谷歌Chrome浏览器优化“隐藏IP地址”功能,提升安全性

瑞萨RA8系列教程 | 基于 RASC 生成 Keil 工程

对于不习惯用 e2 studio 进行开发的同学,可以借助 RASC 生成 Keil 工程,然后在 Keil 环境下愉快的完成开发任务。

共赴之约 | 第二十七届中国北京国际科技产业博览会圆满落幕

作为第二十七届北京科博会的参展方,芯佰微有幸与800余家全球科技同仁共赴「科技引领创享未来」之约!文章来源:北京贸促5月11日下午,第二十七届中国北京国际科技产业博览会圆满落幕。本届北京科博会主题为“科技引领创享未来”,由北京市人民政府主办,北京市贸促会,北京市科委、中关村管委会,北京市经济和信息化局,北京市知识产权局和北辰集团共同承办。5万平方米的展览云集

道生物联与巍泰技术联合发布 RTK 无线定位系统:TurMass™ 技术与厘米级高精度定位的深度融合

道生物联与巍泰技术联合推出全新一代 RTK 无线定位系统——WTS-100(V3.0 RTK)。该系统以巍泰技术自主研发的 RTK(实时动态载波相位差分)高精度定位技术为核心,深度融合道生物联国产新兴窄带高并发 TurMass™ 无线通信技术,为室外大规模定位场景提供厘米级高精度、广覆盖、高并发、低功耗、低成本的一站式解决方案,助力行业智能化升级。

智能家居中的清凉“智”选,310V无刷吊扇驱动方案--其利天下

炎炎夏日,如何营造出清凉、舒适且节能的室内环境成为了大众关注的焦点。吊扇作为一种经典的家用电器,以其大风量、长寿命、低能耗等优势,依然是众多家庭的首选。而随着智能控制技术与无刷电机技术的不断进步,吊扇正朝着智能化、高效化、低噪化的方向发展。那么接下来小编将结合目前市面上的指标,详细为大家讲解其利天下有限公司推出的无刷吊扇驱动方案。▲其利天下无刷吊扇驱动方案一

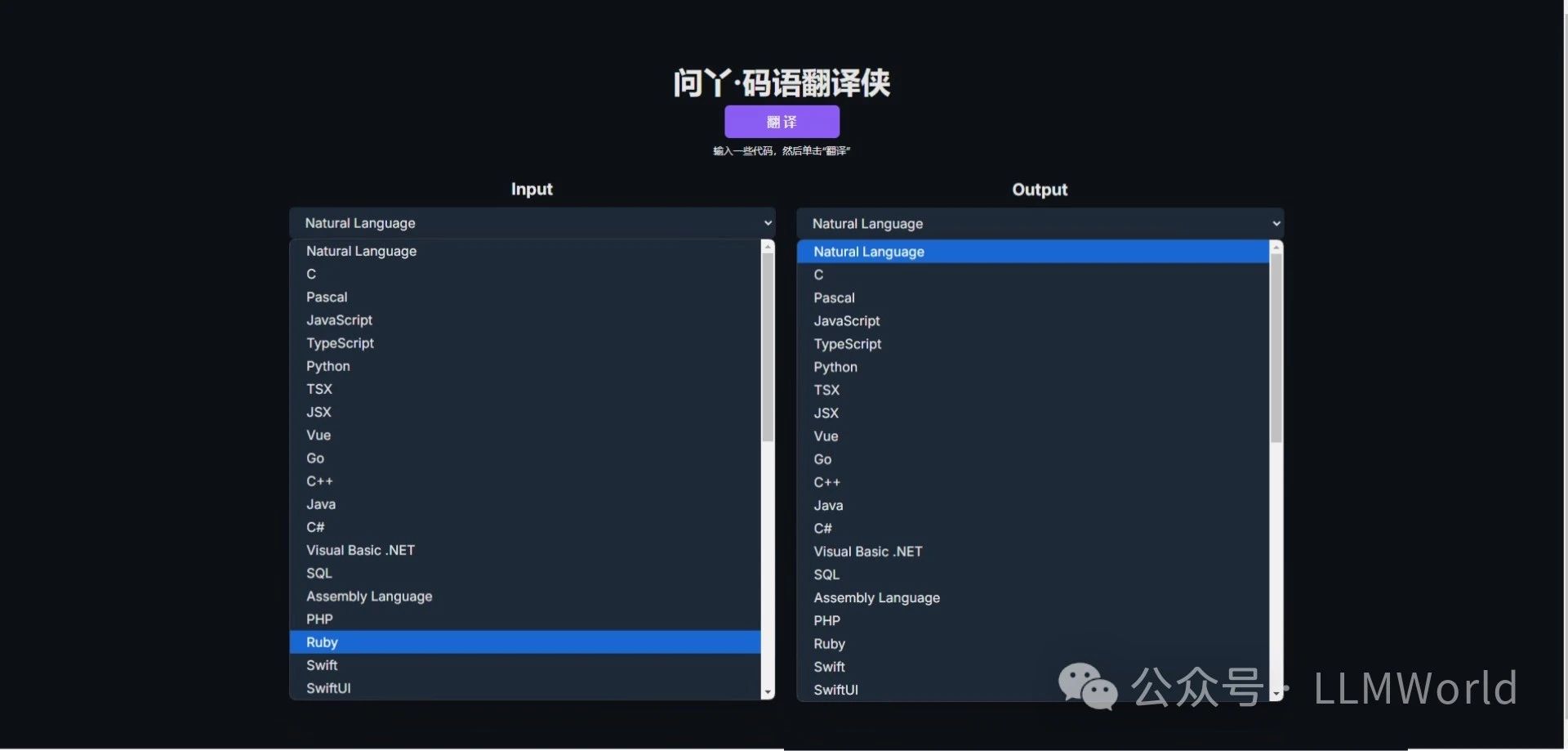

电源入口处防反接电路-汽车电子硬件电路设计

一、为什么要设计防反接电路电源入口处接线及线束制作一般人为操作,有正极和负极接反的可能性,可能会损坏电源和负载电路;汽车电子产品电性能测试标准ISO16750-2的4.7节包含了电压极性反接测试,汽车电子产品须通过该项测试。二、防反接电路设计1.基础版:二极管串联二极管是最简单的防反接电路,因为电源有电源路径(即正极)和返回路径(即负极,GND),那么用二极

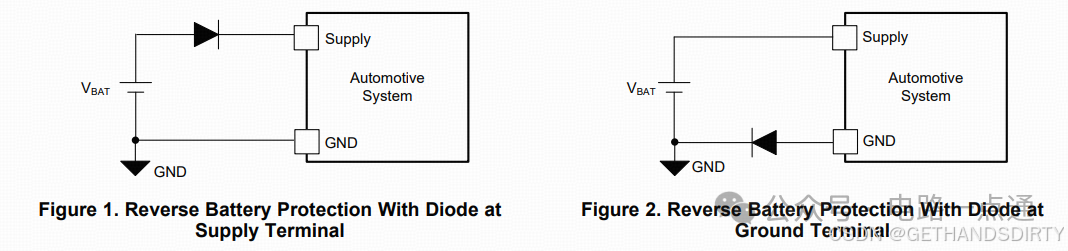

半导体芯片需要做哪些测试

首先我们需要了解芯片制造环节做⼀款芯片最基本的环节是设计->流片->封装->测试,芯片成本构成⼀般为人力成本20%,流片40%,封装35%,测试5%(对于先进工艺,流片成本可能超过60%)。测试其实是芯片各个环节中最“便宜”的一步,在这个每家公司都喊着“CostDown”的激烈市场中,人力成本逐年攀升,晶圆厂和封装厂都在乙方市场中“叱咤风云”,唯独只有测试显

解决方案 | 芯佰微赋能示波器:高速ADC、USB控制器和RS232芯片——高性能示波器的秘密武器!

示波器解决方案总述:示波器是电子技术领域中不可或缺的精密测量仪器,通过直观的波形显示,将电信号随时间的变化转化为可视化图形,使复杂的电子现象变得清晰易懂。无论是在科研探索、工业检测还是通信领域,示波器都发挥着不可替代的作用,帮助工程师和技术人员深入剖析电信号的细节,精准定位问题所在,为创新与发展提供坚实的技术支撑。一、技术瓶颈亟待突破性能指标受限:受模拟前端

硬件设计基础----运算放大器

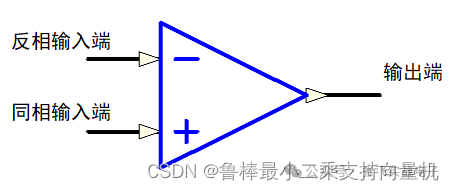

1什么是运算放大器运算放大器(运放)用于调节和放大模拟信号,运放是一个内含多级放大电路的集成器件,如图所示:左图为同相位,Vn端接地或稳定的电平,Vp端电平上升,则输出端Vo电平上升,Vp端电平下降,则输出端Vo电平下降;右图为反相位,Vp端接地或稳定的电平,Vn端电平上升,则输出端Vo电平下降,Vn端电平下降,则输出端Vo电平上升2运算放大器的性质理想运算

ElfBoard技术贴|如何调整eMMC存储分区

ELF 2开发板基于瑞芯微RK3588高性能处理器设计,拥有四核ARM Cortex-A76与四核ARM Cortex-A55的CPU架构,主频高达2.4GHz,内置6TOPS算力的NPU,这一设计让它能够轻松驾驭多种深度学习框架,高效处理各类复杂的AI任务。

米尔基于MYD-YG2LX系统启动时间优化应用笔记

1.概述MYD-YG2LX采用瑞萨RZ/G2L作为核心处理器,该处理器搭载双核Cortex-A55@1.2GHz+Cortex-M33@200MHz处理器,其内部集成高性能3D加速引擎Mail-G31GPU(500MHz)和视频处理单元(支持H.264硬件编解码),16位的DDR4-1600/DDR3L-1333内存控制器、千兆以太网控制器、USB、CAN、

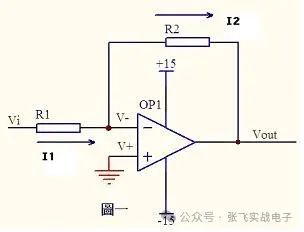

运放技术——基本电路分析

虚短和虚断的概念由于运放的电压放大倍数很大,一般通用型运算放大器的开环电压放大倍数都在80dB以上。而运放的输出电压是有限的,一般在10V~14V。因此运放的差模输入电压不足1mV,两输入端近似等电位,相当于“短路”。开环电压放大倍数越大,两输入端的电位越接近相等。“虚短”是指在分析运算放大器处于线性状态时,可把两输入端视为等电位,这一特性称为虚假短路,简称

飞凌嵌入式携手中移物联,谱写全国产化方案新生态

4月22日,飞凌嵌入式“2025嵌入式及边缘AI技术论坛”在深圳成功举办。中移物联网有限公司(以下简称“中移物联”)携OneOS操作系统与飞凌嵌入式共同推出的工业级核心板亮相会议展区,操作系统产品部高级专家严镭受邀作《OneOS工业操作系统——助力国产化智能制造》主题演讲。

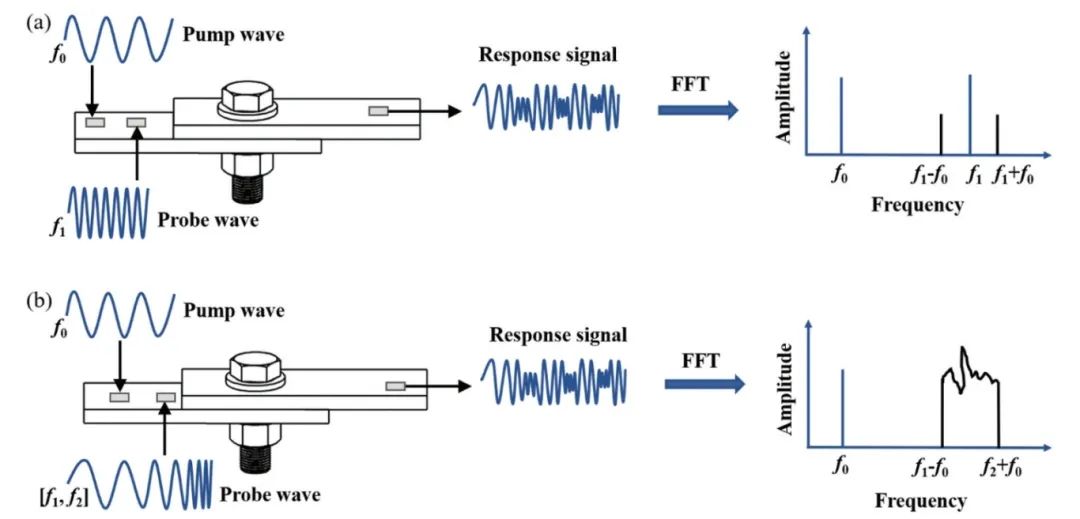

ATA-2022B高压放大器在螺栓松动检测中的应用

实验名称:ATA-2022B高压放大器在螺栓松动检测中的应用实验方向:超声检测实验设备:ATA-2022B高压放大器、函数信号发生器,压电陶瓷片,数据采集卡,示波器,PC等实验内容:本研究基于振动声调制的螺栓松动检测方法,其中低频泵浦波采用单频信号,而高频探测波采用扫频信号,利用泵浦波和探测波在接触面的振动声调制响应对螺栓的松动程度进行检测。通过螺栓松动检测

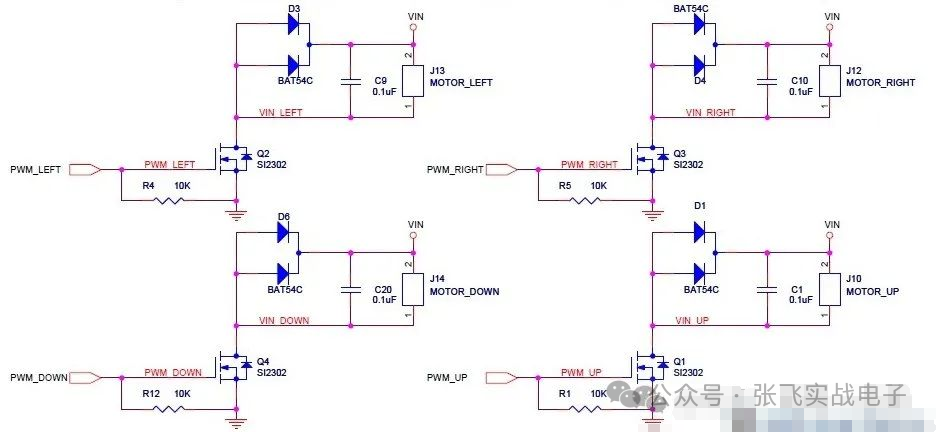

MOS管驱动电路——电机干扰与防护处理

此电路分主电路(完成功能)和保护功能电路。MOS管驱动相关知识:1、跟双极性晶体管相比,一般认为使MOS管导通不需要电流,只要GS电压(Vbe类似)高于一定的值,就可以了。MOS管和晶体管向比较c,b,e—–>d(漏),g(栅),s(源)。2、NMOS的特性,Vgs大于一定的值就会导通,适合用于源极接地时的情况(低端驱动),只要栅极电压达到4V或10V就可以

压敏(MOV)在电机上的应用剖析

一前言有刷直流电机是一种较为常见的直流电机。它的主要特点包括:1.结构相对简单,由定子、转子、电刷和换向器等组成;2.通过电刷与换向器的接触来实现电流的换向,从而使电枢绕组中的电流方向周期性改变,保证电机持续运转;3.具有调速性能较好等优点,可以通过改变电压等方式较为方便地调节转速。有刷直流电机在许多领域都有应用,比如一些电动工具、玩具、小型机械等。但它也存

谷歌翻译竟然预言世界末日?

谷歌翻译竟然预言世界末日?

评论