摘要:自定位是智能车辆的关键技术之一,本文通过对路面车道线的简单编码,给出了一种实用、简便的车辆自定位解决方案。尤其是路面车道线的编码使得在一定范围内区分不同的路面标志成为可能,这对于车辆定位至关重要。我们基于编码的路面车道线,提出了一种多尺度精确定位车辆的策略,该定位方法包括实时定位系统的粗定位、标记匹配的标记级定位和标记区域周围特征点匹配的度量定位。利用现场采集的实际数据对该方法进行了测试,对两种不同颜色<白色和黄色>的路面车道线进行了编码。结果表明,该方法通过参考编码的路面车道线,可以达到亚米定位的精度。研究结果还表明,先进的道路基础设施可以为智能汽车提供低成本、可靠的解决方案。。

作者:Qianwen Tao, Zhaozheng Hu*, Hao Cai, GangHuang and Jie Wu

原文题目:Coding Pavement Lanes for AccurateSelf-localization of Intelligent

Ⅰ介绍

典型的智能车辆通常由感知模块、决策模块、路径规划模块和控制模块组成。车辆自定位是确定车辆的位置和姿态的过程,对上述所有模块都是至关重要的。

从文献来看,现有的车辆自定位方法一般可分为三类。第一类是全球定位系统(GPS)相关方法,由于原始GPS接收机只能提供较低的定位精度(如精度低至10米或以下),无法直接应用于智能汽车。通常,GPS与其他传感器(例如,惯性测量单元(IMU),实时动态差分法(RTK)等,以获得更准确的精度。例如,GPS和IMU的集成可以产生小于10厘米的定位误差[1]。差分GPS (D-GPS)方法也可以达到较高的定位精度( 5cm以下),以基站为基础,另外一种流行的方法是RTK方法[2]。

然而,这些方法在实践中通常是非常昂贵的。他们都患有gps盲症,尤其是在城市环境中。因此,许多研究人员提出利用实时定位系统(RTLS)来实时识别和跟踪车辆的位置。这些方法可以利用WiFi[3]、超宽带(UWB)[4]、蓝牙[5]等进行实时定位。第二类是基于低成本相机的视觉定位方法[6-10]。

一种常用的方法是使用单目摄像机进行车道检测,从而计算出摄像机与车道之间的相对位置[6,7]。然而,对于车辆自定位,只计算了导线位置,一些方法试图将路面标记和高清晰度(HD)地图用于车辆定位[8,9]。然而,由于天然路面标志分布均匀、重复性高,在实际应用中还不够实用。视觉里程测量、同步定位和建图(SLAM)方法也被应用于车辆自我定位[10]。

然而,视觉测距仪存在着严重的漂移误差问题,这对于开放式道路场景是至关重要的。而视觉SLAM方法的前端闭环检测鲁棒性差,后期优化比较复杂。近年来,一些基于预先存储的视觉地图的定位方法被发展起来。最后一类是基于LiDAR的定位方法。Apollo团队利用VelodyneHDL-64E提出了一种最先进的方法。他们将LiDAR数据用于地图生成,并将LiDAR数据以5-10厘米的精度匹配在单元格网中,从而使车辆定位[11]。然而,这种方法依赖于高成本的激光硬件。

从文献综述来看,现有的方法大多依赖于传感器数据(如GPS、图像、LiDAR等)。对于车辆定位,在实际应用中往往存在成本高、精度低、鲁棒性差等问题。

本文提出了一种通过对路面车道进行编码来实现车辆自定位的新方法。结果表明,如果路面车道线采用不同颜色编码,可以大大简化车辆定位问题。此外,还可以根据编码后的路面车道,开发出一种更可靠、更准确的车辆定位方法。

本文的贡献有两方面,首先,提出了一种支持智能车辆定位的道路车道编码方法。因此,我们可以通过不同颜色的路面车道线编码来准确定位,从而在一定范围内区分独特的路面标记。其次,在编码车道的基础上,提出了一种基于RTLS的车辆精确定位的多尺度定位策略,包括基于RTLS的粗定位、标记级定位,最后通过匹配标记区域周围的视觉点进行度量定位。

Ⅱ方法

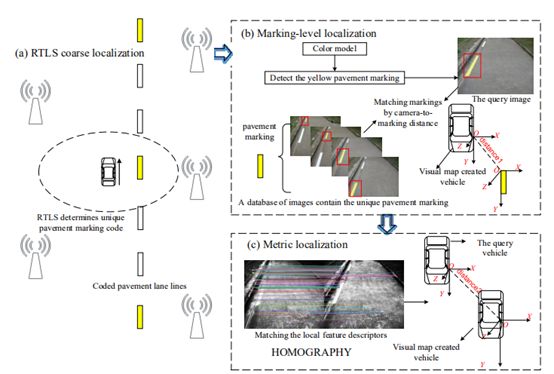

所提出的车辆定位方法如图1所示。该方法基于建立的车辆视觉地图采集的所有道路的WiFi指纹、图像和地面真相数据库,由三个步骤组成。

首先,通过粗定位得到一定范围的路面区域,从而确定路面的独特标志。

其次,利用颜色模型对查询图像中的黄色路面标记进行检测后,通过标记级定位,从包含唯一路面标记的地图图像中选择最近的地图图像。

第三,提取最近地图图像和查询图像的局部特征描述子,通过度量定位进一步细化定位结果。

图1.车辆定位是指编码的路面行车线:(A)使用RTLS进行粗定位;(B)通过匹配标记来定位标记级;(C)通过匹配标记区域周围的独特视觉特征点来进行度量定位。

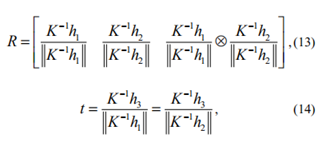

A.用于定位的路面车道编码

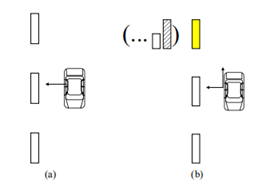

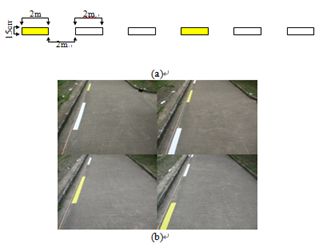

对路面车道进行编码是为了实现车辆的定位。如图2(a)所示,典型的虚线车道由一系列白色方块组成。由于这些方块具有相同的形状和颜色,因此不可能为了定位的目的而区分它们。然而,如果我们用不同的颜色(即黄色)对部分正方形进行编码,如图2(b )所示,则可以在一定距离内导出唯一的标记,例如编码的黄色正方形(参见图1 )。

在实际应用中,可以采用不同的编码策略,如颜色编码、纹理编码、尺寸编码等。(见图2(b))。在本文中,我们编码两种不同的颜色,即白色和黄色,使这两种不同的颜色依次出现。我们尝试从一些E方格中编码一个黄色的正方形。根据这些标准,在图4(A)中显示了一条典型公路的几何参数。

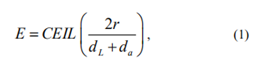

r表示粗局部化的不确定性。因此,我们可以用上面这个方程计算E,其中CEIL(.)是天花板函数,dL和da分别是车道线距离和两车道线之间的分离距离。这样的颜色编码使我们能够区分出一个独特的黄色正方形和粗糙的定位,因此对于车辆定位。显然,适当的r可以解决查询图像与图像数据库匹配的模糊性问题。

B.RTLS粗定位

图2.用于车辆定位的两种颜色的路面车道编码:(A)常规车道;(B)彩色编码车道。

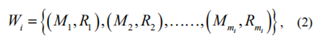

针对城市中GPS盲区较多的问题,提出了一种基于WiFi指纹的车辆粗定位策略。WiFi接入点(AP)可以均匀分布在路边。在定位之前,应该建立一个WiFi指纹图谱,图谱是一个查找表,它描述位置和相应的WiFi指纹。WiFi指纹由所有可访问AP的MAC地址以及相应的RSSI值组成,如下所示:

其中M代表AP MAC地址,R代表RSSI,Mi代表从ith站点收集的WiFi数量。在定位步骤中,每个步骤采集到的WiFi指纹与地图中的指纹进行匹配,以获取车辆位置。在本文中,我们提出了一种新的匹配方法,它将MAC地址匹配和RSSI匹配输入到帐户中,如下所示:

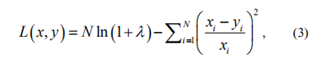

其中N是MAC地址的个数,xi和yi表示当前WiFi的RSSI和地图中的WiFi的RSSI,它们对应于匹配的ithMAC地址,而λ≥0是一个经验值。使用(3),我们可以在地图中找到一些L(x,y)最小的指纹,从而得到粗定位。

C.通过标记匹配实现标记级定位

从粗略的定位结果,我们可以得到一个特定的范围,在此范围内,所有的图像在地图上选择为候选。标记级定位步骤试图从离查询图像最近的候选对象中检索一个地图图像。为了达到这一目的,我们需要实现两个步骤:(A)建立一个统计颜色模型(SCM)来提取和检测黄色路面标记,即路面标记检测;(B)将查询图像中编码的黄色方格与候选图像匹配,本文称之为路面标记匹配。

(a)路面标记检测

我们提出了一种利用单片机从图像中提取和检测黄色路面标志的方法。由于不同的照明条件和道路环境,黄色标记具有不同的颜色值,因此我们需要对这种颜色分布进行建模以进行颜色分析。

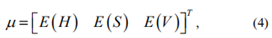

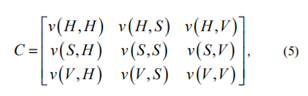

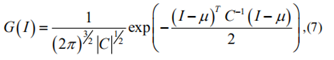

其中H、S、V是所有训练颜色样本的色调、饱和度和值分量,E(H)、E(S)和E(V)分别是它们的均值。计算了3×3协方差矩阵C

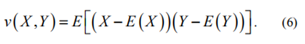

其中,函数v(X,Y)采用如下形式:

从G-SCM中,我们可以计算输入颜色为黄色的概率或可能性,如下所示

其中我是图像中每个点的像素值,一个3×1矩阵。在实践中,为了便于计算,我们可以修改上述方程如下:

利用所提出的G-SCM模型,我们可以对图像中的所有黄颜色进行分割和高亮化。结果表明,颜色分割结果可以与传统的直线提取和跟踪方法结合起来进行黄色路面标志检测。

(b)标记匹配

因此,通过对黄色路面材料的检测,我们可以缩小候选范围,只有那些带有黄色标记的候选人才能被选中。此外,从检测到的车道线和顶点,我们可以通过一些传统的方法[12,13]计算摄像机与路面标志之间的距离。计算出的相机到标记距离可以作为线索,改进标记匹配。从地图上,我们可以计算相机到标记的距离,从所有从检测步骤得到的候选图像。因此,我们可以得到一个唯一的地图图像,从查询图像计算出的距离与从地图获得的候选图像之间的距离相差最小。

D.度量定位

由于我们使用标记级定位来通过标记匹配获得唯一的地图图像,最终采用度量定位来进一步细化定位结果,通过匹配标记区域周围独特的视觉特征点来进一步细化定位结果。针对实时定位的要求,本文提出了一种利用ORB(面向快速旋转简报)[14]中已知的局部特征描述子来快速匹配查询图像和唯一地图图像的方法。

首先,从查询图像中提取足够数量的ORB特征点。注意,所有特征点都是预先提取出来的,并存储在地图中的所有图像中。因此,我们可以直接匹配查询和候选图像之间的本地特征。在实际应用中,我们还采用了随机样本一致性(RANSAC)[15]方法去除异常值,以增强匹配的鲁棒性。最后,如果两幅图像之间有足够数量的特征点匹配,则可以认为路面标志匹配是正确的。

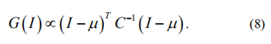

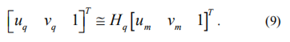

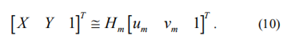

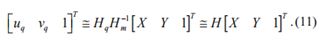

根据匹配的特征点(也称为点对应),我们可以通过如下[12]的单调法将这两幅图像联系起来。

从映射过程中,由校准步骤计算物理平面(即路面平面)与地图图像之间的同调HM,具体步骤如下:

通过梳理(9)和(10),我们可以得到物理平面和查询图像之间的同源性,如下所示

从射影几何出发,同形可以用相机校准矩阵K、旋转R和平移t来表示,如下[12]

因此,当ri是R的第ith列向量时,车载摄像机相对于编码的路面车道的姿态计算如下[12]:

当hi是H的第ith列矢量时,通过坐标变换,最终确定车辆的位置。

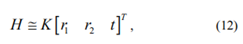

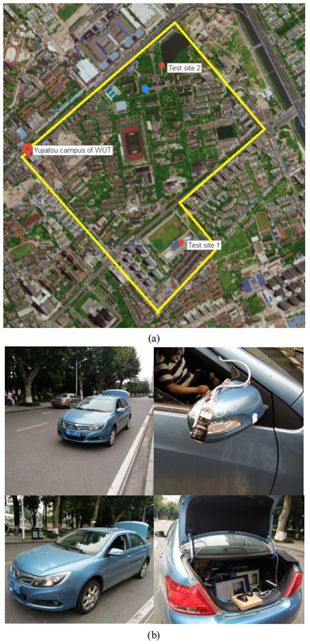

III实验

通过在大学校园的实际现场测试,验证了该方法的有效性。如图3(a)所示,我们选择了两个测试地点,其中人行道车道线编码用于车辆定位。并使用车载单目摄像机捕捉路面图像进行定位(见图3(b))。摄像机的角度被配置成至少可以观察到场景中的两个方块。对摄像机的外部参数和内在参数都进行了精确的标定。为了克服GPS的盲目性问题,我们提出了一种基于WIFI指纹的粗定位方法。为了达到这一目的,我们干扰了试验场附近的AP基站。

图3.(a)WUT于家头校园内的两个测试地点;(b)原型车作定位用途。

在路面编码阶段,参考了我国路面几何设计国家标准[16]。根据标准,路面破折线由一系列白色方格组成。每个车道线方格有2米长,15厘米宽。两个相邻的车道线方格相距2米。利用这种几何构型,用(1)计算出E值为3。因此,我们从三个方格中编码了一个黄色方格,如图4(a)所示。

图4.(a)由几何结构编码的行车线;(b)编码路面标记的图像。

为了实现所提出的多尺度定位方法,我们需要预先存储一些信息以供参考,一个步骤也称为映射。对于粗定位,我们将道路区域划分成若干个单元,并收集所有小区的WiFi指纹。由于我们还匹配了编码的路面标记周围的局部特征,我们存储所有提取的特征点和它们的特征描述符。从摄像机标定结果中,还可以计算出编码路面标志与摄像机在测绘过程中的相对位置。

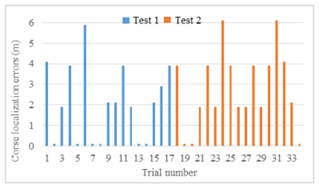

首先利用(3)对WiFi指纹匹配得到粗定位结果。然后,将车辆采集的实时WiFi数据与不同小区的数据进行比较,达到粗定位的目的。两个测试点的定位结果如图5所示。观测到粗定位的定位误差均小于6.1米。从两个地点的粗定位结果来看,平均偏差为2.4米,标准差为1.8米。因此,我们可以将定位不确定度定义为4.2米(均值加标准差)。因此,编码值E在(1)可以计算为E=3。因此,这种粗略的定位结果使我们能够从摄像机拍摄的图像中得到一个独特的编码路面标记(即黄色)。从粗定位结果可以得到一组范围内的候选图像。

图5.粗定位结果从WiFi指纹。

图6.用黄色编码的路面标记的检测结果。

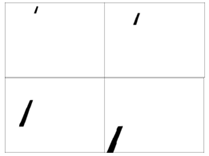

在标识层定位阶段,我们使用所提出的G-SCM模型对路面标志进行了检测。在G-SCM中,查询图像中的所有像素都被划分为黄色或非黄色像素(如图6所示)。因此,我们可以过滤掉图像中的所有黄色区域,包括编码的黄色标记。此外,我们还提出使用线检测和跟踪来去除编码黄色标记以外的所有其他黄色区域。根据检测结果,从摄像机标定和路面车道几何形状两个方面计算出候选图像中摄像机与编码路面标记之间的距离。因此,我们在地图中选择了一幅距离差最小的唯一图像作为标记级的定位结果。

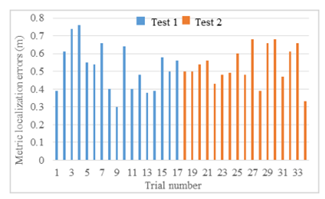

从标记级定位结果中,最终执行度量定位,通过匹配标记区域周围的不同视觉特征点来计算车载摄像机与编码标记的相对姿态,如图7所示。请注意,此步骤还可以强制执行查询图像与根据标记级定位计算的图像之间的匹配。通过坐标系变换,将相对位姿进一步转化为全局坐标系。测量定位的地面真相是在现场人工获得的。在每一次试验中,我们使用计算的坐标和地面真实值之间的差异来评价定位结果的性能。

结果如图8所示,不同测试的结果用不同的颜色标记。可以观察到,测量定位的定位误差均小于0.76米。从两个试验点的定位结果来看,平均偏差和标准差分别为0.5米和0.1米。结果表明,该方法能够在多尺度定位的基础上提高车辆定位精度,具有较强的鲁棒性。

图7.查询图像与候选图像之间匹配的图像特征点。

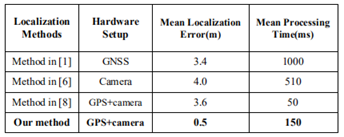

最后,我们将所提出的方法与一些低成本的视觉方法进行了比较,并在相同的条件下进行了验证。实验结果如表一所示,与其它方法相比,该方法实时实现了亚表定位精度,具有最佳的定位精度和较快的处理速度。虽然文[8]中的方法处理速度最快,但只适用于有突出标记而不需要对现有基础设施进行修改的情况下,其精度比我们所提出的方法差一下,这意味着我们所提出的方法比其他方法更先进。

图8.度量标准化定位结果。

Ⅳ.结论

本文提出了一种新的、精确的车辆定位方法——简单编码路面车道线。相对于传统的基于车道线的车辆定位方法,可以计算车辆的纵向和横向位置以实现车辆的自定位。因此,该方法克服了现有基于车道检测的车辆定位方法的局限性。

此外,本文还提出了一种多尺度定位策略,用于从粗到精的定位计算,有助于实现精确的车辆定位。该方法已在两个不同颜色的路面车道编码现场进行了验证。实验结果表明,该方法只需对路面车道进行编码,就可以实现亚米级定位。在此基础上,可以利用其它基于视觉的定位方法来提高车辆的实时定位精度。

表一.不同车辆定位方法的比较结果

-

单片机

+关注

关注

6052文章

44768浏览量

642796 -

WIFI

+关注

关注

81文章

5340浏览量

206384

原文标题:一种新的智能车辆精确定位方法——路面车道线编码

文章出处:【微信号:IV_Technology,微信公众号:智车科技】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

相关推荐

如何停止windows的自动更新方法

分享毕业设计之基于GPS(北斗GPS二合一)的智能车辆定位系统

使用电感式传感的篡改攻击低功耗检测新方法

怎么实现移动智能车辆稽查系统的设计?

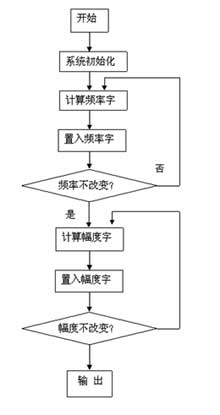

精确控制DDS输出信号幅度的新方法

基于视觉的道路区域和车道线识别技术在智能车辆导航中的应用研究

智能车辆精确定位新方法:对路面车道进行编码

智能车辆精确定位新方法:对路面车道进行编码

评论