人工智能从神经科学领域吸收了大量养分,并由此催生了深度学习和强化学习等智能处理方法。以色列魏茨曼科学研究学院计算机科学系教授 Shimon Ullman 相信神经科学还能为人工智能发展提供进一步的助力,比如先天结构的采用也许能为人工智能带来高效且灵活的学习能力。Ullman 教授这篇观点文章发表在最新一期 Science 杂志上,机器之心进行了编译介绍。

数学家阿兰·图灵 1950 年的开创性论文引领了人类对人工智能(AI)的探索,他在这篇论文中提出了一个问题:「机器能否思考?」,那时候唯一已知的能够进行复杂计算的系统是生物神经系统。因此,毫不奇怪那时候这个新兴的 AI 领域的科学家都将大脑回路作为引导。

其中一条道路是通过类脑回路执行智能计算,这个方向的早期尝试近来已经创造出了巨大的成功,并可被描述成一种用于建模皮层回路的高度还原论(reductionist)的方法。

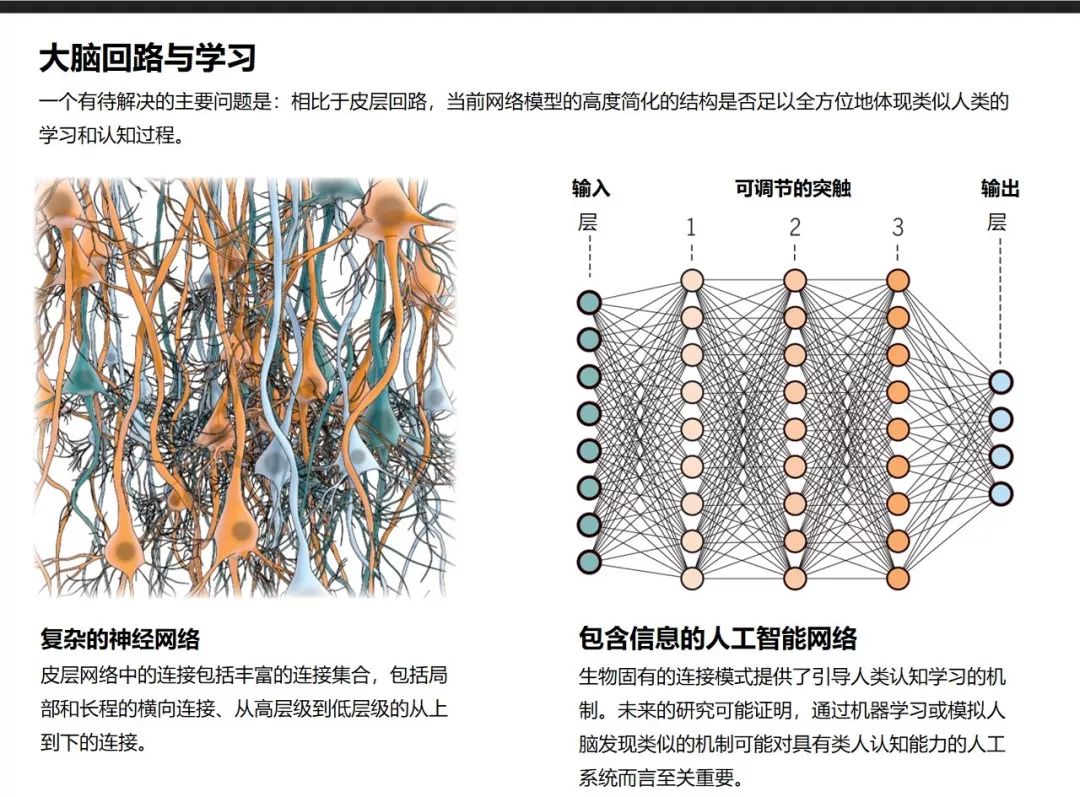

其当前的基本形式被称为「深度网络」架构,这种脑启发模型是通过类神经元件组成的连续层构成的;这些元件按照生物学中类似作用的组件而被称为「突触」,它们通过可调节的权重相连。

深度网络和相关方法在 AI 系统中的应用已经带来了变革。研究证明它们在 AI 研究的核心领域优于之前已知的方法,包括计算机视觉、语音识别和生成、玩复杂的游戏。它们也已经取得了广泛的实际应用,涉及很多领域,包括计算机视觉、语音和文本翻译,其它还有很多领域也存在大规模的努力。

我将在这里讨论大脑回路中的其它方面将可能如何引导网络模型的发展,从而让我们了解认知和通用人工智能的更多方面。

差 异

深度网络的核心问题是学习(learning),这是对突触的调整,从而得到针对其输入模式的期望输出。这样的调整是基于训练样本集自动执行的,而训练样本集中包含输入模式以及配套的期望输出。然后,学习过程通过调整权重得到训练输入模式的期望输出。成功的学习会让网络超越记忆训练样本的情况,而且使其能够泛化,为学习过程中从没见过的新输入模式提供正确的输出。

研究者将深度网络模型与实际得到的生理学、功能性磁共振成像和行为数据进行了比较,结果表明大脑与这类新模型之间存在一些有趣的相似性,但同时也存在一些不相似的地方(见图)。对比灵长类动物的视觉系统,生理学响应与模型响应在神经元响应过程的早期阶段比后期阶段更为近似,这说明深度网络模型也许能更好地体现早期的处理过程,而不是后期的更涉及认知的过程。

大脑回路与学习,来自 C. BICKEL/SCIENCE

除了深度网络,AI 模型近来还融合了类脑计算的另一个重要方面:强化学习(RL),其中使用了大脑中的奖励信号来修改行为。

这种形式的学习中涉及的大脑机制已经得到了广泛的研究,而且其计算模型也已经在 AI 领域得到了使用,尤其是在机器人应用中。强化学习可用于在世界中运作的智能体(人、动物或机器人)中,通过接收的奖励信号作为回报。强化学习的目标是学习一个最优「策略」,这是从状态到动作的一个映射,以便最大化随时间获得的一个整体度量的奖励。

在近期的一些 AI 算法中,强化学习方法已经与深度网络方法结合到了一起,并且在游戏领域的应用尤其突出,涵盖的范围包括流行的视频游戏到高度复杂的游戏,比如国际象棋、围棋和将棋。深度网络与强化学习的结合在玩游戏方面取得了惊人的成果,包括令人信服地击败了世界顶级的围棋棋手、在大约 4 小时的训练之后达到了国际象棋世界冠军的水平;这些都是仅从游戏规则开始,通过内部自我对抗进行学习而达成的。

从使用神经科学引导 AI 发展的角度看,因为相比于皮层回路,这些网络的形式是经过高度简化的,所以这样的成功很让人惊讶。一些其它的脑启发方面(比如跨神经元组归一化或使用空间注意)也已经被整合进了深度网络模型中。但一般而言,我们所知的有关神经元的几乎一切(它们的结构、类型、互连性等等)都被排除在了深度网络模型的当前形式之外。

我们目前仍不清楚生物回路的哪些方面在计算上是关键的,并且也可用于基于网络的 AI 系统,但结构中的差异很显著。比如,生物神经元在它们的形态学、生理学和神经化学方面都非常复杂和多样。

典型的受到激励的锥体神经元的输入分布在复杂的、高度分支的底和顶树突树上。抑制型皮层神经元具有多种不同的形态,它们很可能执行着不同的功能。典型的深度网络模型都没有包含这种异质性和其它复杂性,而是使用了有限种类的高度简化的同质的人工神经元。在网络中单元之间的连接性上面,大脑中皮层回路也比当前的深度网络模型更复杂,并且在同一层的神经元之间具有丰富的横向连接,其中既有局部连接,也有长程连接,而且还有从皮层区域的高层区域到低层区域的从上到下的连接,而且可能会组织在典型的局部「规范回路(canonical circuits)」中。

基于深度网络的学习方法主要在与现实世界的感知数据(比如视觉和语音)相关的问题上取得了显著的成功,近来研究者已经将越来越多努力投入到了自然界中更涉及认知的问题上。比如在视觉领域,网络模型最早是为处理目标分类和分割等感知问题而开发的。类似的方法经过某些扩展后现在已经被用在了图像描述(任务目标是生成一张图像的简短语言描述)和视觉问答(任务目标是为以自然语言提出的有关图像内容的查询提供恰当的答案)等更高层面的问题上。其它还有一些非视觉任务,比如评价幽默程度、检测讽刺、获取直观的物理知识或社会理解的一些方面。研究者们也为一些高难度的真实世界应用开发出了类似的方法,包括在线翻译、灵活的个人助理、医疗诊断、先进机器人学、自动驾驶。

有了这些重大的研究努力以及投入到未来 AI 应用中的大量资金,需要解决的重要问题是:当前的方法能在何种程度上生成「真实」和类似人类的理解,或者是否还需要其它的(也许非常不同的)方向来处理认知和通用人工智能(AGI)的众多不同方面。我们还不知道这个问题的答案,但不管是科学上还是商业上,这都非常重要。

先天结构

如果事实证明当前深度网络模型在产生类人认知能力方面的成功是有限的,那么我们很自然又会向神经科学寻求指引。

当前 AI 模型忽视的大脑回路的那些方面是否会是 AGI 的关键?大脑的哪些方面可能是尤其重要的?

目前我们还没有显而易见的答案,因为我们对皮层回路的理解仍然还很有限,但我会简要讨论一下大脑和深度网络模型看起来根本上不同的一个一般性方面,而且这个方面很可能在我们追寻类人 AGI 之路上发挥重要的功用。

这一差异的核心是一个老生常谈的问题,关乎认知中经验主义(empiricism)与先天主义(nativism)之间的平衡,即先天的认知结构与通用的学习机制之间的相对重要程度。

当前的 AI 建模方法严重倾向于经验主义一方,会使用大型的训练数据集。相对而言,生物系统往往仅需少量训练就能完成复杂的行为任务,它们基于特定的预先存在的网络结构,而且该结构在学习之前就已被编码在了回路之中。

比如,针对复杂的导航任务,包括昆虫、鱼类和鸟类在内的不同动物物种都能部分地依靠一套先天固有的特定用途的复杂精细的机制外加精妙的计算能力来完成。

对于人类,婴儿会在生命的最初几个月开始发展出复杂的感知和认知技能,且仅需很少或无需明确的训练。比如,他们能够自发地识别出人手等复杂的目标、跟随其他人的注视方向、通过视觉分辨动画角色是在帮助其他角色还是妨碍其他角色,还能完成其它很多不同的任务,能表现出他们对物理交互和社会交互的初级理解。

大量发展中的研究都表明这种快速的无监督学习之所以是可能的,原因是人类的认知系统通过进化而配备了先天的基础结构,这些结构能够促进对意义概念和认知技能的习得。

与已有的深度网络模型相比,人类认知学习和理解的优越性可能很大程度上源自人类认知系统具备的丰富且复杂很多的先天结构。近来对婴儿期视觉学习的建模研究已经表明学习与先天机制的结合是有用的,其中有意义的复杂概念既非先天固有,也不是靠自己学习得到。

从这个居中的角度看,先天的那部分不是已经发展好的概念,而是更简单的「原型概念」,这能提供内部的教学信号,引导学习系统,从而仅需少量或无需明确的训练就能逐渐习得和组织复杂概念。

比如,研究已经表明一种特定的图像运动模式可以为人手识别提供可靠的内部教学信号。对人手以及它们在操作物体中的参与情况的检测可以引导学习系统学习检测注视方向,而检测注视目标又在学习推理人的目标中发挥着重要作用。这样的先天结构可以通过在局部皮层区域中布置特定的初始连接,再将输入和误差信号提供给特定的目标来实现。

人工网络模型也可以采用有用的预设结构来使其学习和理解更接近人类。发现有用的预设结构这一难题的解决方法可以是理解和模仿相关的大脑机制,或开发从头开始的计算学习方法来发现支持智能体、人类或人工智能的结构,使其能以高效且灵活的方式学习理解自己的环境。

这一方向上已有一些尝试,但一般而言,「学习先天结构」这一计算问题不同于当前的学习过程,而且我们的了解还很少。长期来看,将经验主义方法与计算方法结合起来处理这一问题很可能对神经科学和 AGI 都有利,并最终可能会成为可应用于这两个领域的智能处理理论的一部分。

-

人工智能

+关注

关注

1791文章

47259浏览量

238427 -

强化学习

+关注

关注

4文章

266浏览量

11253

原文标题:Science:人工智能的发展离不开神经科学,先天结构或是下一个方向

文章出处:【微信号:AItists,微信公众号:人工智能学家】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

相关推荐

卡诺模型为人工智能领域提供了一种全新的视角

嵌入式和人工智能究竟是什么关系?

人工智能云计算大数据三者关系

《AI for Science:人工智能驱动科学创新》第6章人AI与能源科学读后感

AI for Science:人工智能驱动科学创新》第4章-AI与生命科学读后感

《AI for Science:人工智能驱动科学创新》第二章AI for Science的技术支撑学习心得

《AI for Science:人工智能驱动科学创新》第一章人工智能驱动的科学创新学习心得

名单公布!【书籍评测活动NO.44】AI for Science:人工智能驱动科学创新

进一步解读英伟达 Blackwell 架构、NVlink及GB200 超级芯片

卓驭科技与高通合作宣布进一步推动汽车行业智能驾驶技术的发展

神经科学为人工智能发展提供进一步助力

神经科学为人工智能发展提供进一步助力

评论