生成对抗网络 (GAN) 是深度学习中最有趣、最受欢迎的应用之一。本文列出了 10 篇关于 GAN 的论文,这些论文将为你提供一个很好的对 GAN 的介绍,帮助你理解最先进技术的基础。

本文选择的10篇GAN论文包括:

DCGANs

Improved Techniques for Training GANs

Conditional GANs

Progressively Growing GANs

BigGAN

StyleGAN

CycleGAN

Pix2Pix

StackGAN

Generative Adversarial Networks

DCGANs — Radford et al.(2015)

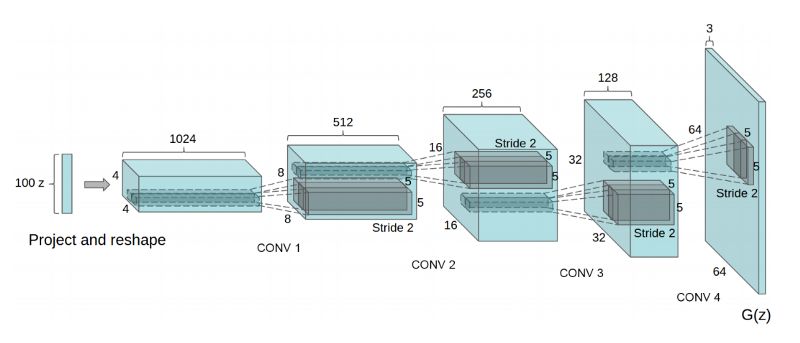

我建议你以DCGAN这篇论文来开启你的GAN之旅。这篇论文展示了卷积层如何与GAN一起使用,并为此提供了一系列架构指南。这篇论文还讨论了GAN特征的可视化、潜在空间插值、利用判别器特征来训练分类器、评估结果等问题。所有这些问题都必然会出现在你的GAN研究中。

总之,DCGAN论文是一篇必读的GAN论文,因为它以一种非常清晰的方式定义架构,因此很容易从一些代码开始,并开始形成开发GAN的直觉。

DCGAN模型:具有上采样卷积层的生成器架构

论文:

Unsupervised Representation Learning with Deep Convolutional Generative Adversarial Networks

Alec Radford, Luke Metz, Soumith Chintala

https://arxiv.org/abs/1511.06434

改进GAN训练的技术—— Salimans et al.(2016)

这篇论文(作者包括Ian Goodfellow)根据上述DCGAN论文中列出的架构指南,提供了一系列建议。这篇论文将帮助你了解GAN不稳定性的最佳假设。此外,本文还提供了许多用于稳定DCGAN训练的其他机器,包括特征匹配、minibatch识别、历史平均、单边标签平滑和虚拟批标准化。使用这些技巧来构建一个简单的DCGAN实现是一个很好的练习,有助于更深入地了解GAN。

论文:

Improved Techniques for Training GANs

Tim Salimans, Ian Goodfellow, Wojciech Zaremba, Vicki Cheung, Alec Radford, Xi Chen

https://arxiv.org/abs/1606.03498

Conditional GANs — Mirza and Osindero(2014)

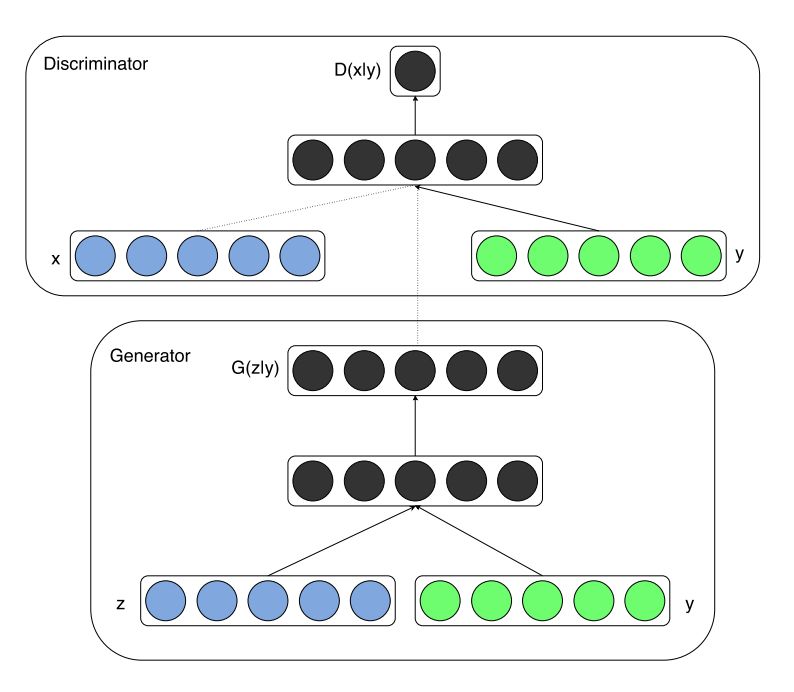

这是一篇很好的论文,读起来很顺畅。条件GAN(Conditional GAN)是最先进的GAN之一。论文展示了如何整合数据的类标签,从而使GAN训练更加稳定。利用先验信息对GAN进行调节这样的概念,在此后的GAN研究中是一个反复出现的主题,对于侧重于image-to-image或text-to-image的论文尤其重要。

Conditional GAN架构:除了随机噪声向量z之外,类标签y被连接在一起作为网络的输入

论文:

Conditional Generative Adversarial Nets

Mehdi Mirza, Simon Osindero

https://arxiv.org/abs/1411.1784

Progressively Growing GANs— Karras et al.(2017)

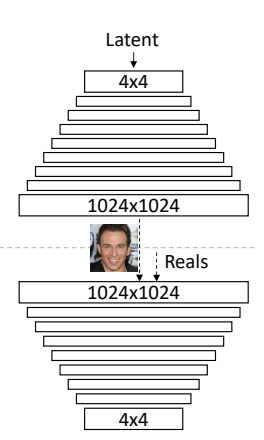

Progressively Growing GAN (PG-GAN)有着惊人的结果,以及对GAN问题的创造性方法,因此也是一篇必读论文。

这篇GAN论文来自NVIDIA Research,提出以一种渐进增大(progressive growing)的方式训练GAN,通过使用逐渐增大的GAN网络(称为PG-GAN)和精心处理的CelebA-HQ数据集,实现了效果令人惊叹的生成图像。作者表示,这种方式不仅稳定了训练,GAN生成的图像也是迄今为止质量最好的。

它的关键想法是渐进地增大生成器和鉴别器:从低分辨率开始,随着训练的进展,添加新的层对越来越精细的细节进行建模。“Progressive Growing”指的是先训练4x4的网络,然后训练8x8,不断增大,最终达到1024x1024。这既加快了训练速度,又大大稳定了训练速度,并且生成的图像质量非常高。

Progressively Growing GAN的多尺度架构,模型从4×4 逐步增大到1024×1024

论文:

Progressive Growing of GANs for Improved Quality, Stability, and Variation

Tero Karras, Timo Aila, Samuli Laine, Jaakko Lehtinen

https://arxiv.org/abs/1710.10196

BigGAN — Brock et al.(2019)

BigGAN模型是基于ImageNet生成图像质量最高的模型之一。该模型很难在本地机器上实现,而且BigGAN有许多组件,如Self-Attention、Spectral Normalization和带有投影鉴别器的cGAN,这些组件在各自的论文中都有更好的解释。不过,这篇论文对构成当前最先进技术水平的基础论文的思想提供了很好的概述,因此非常值得阅读。

BigGAN生成的图像

论文:

Large Scale GAN Training for High Fidelity Natural Image Synthesis

Andrew Brock, Jeff Donahue, Karen Simonyan

https://arxiv.org/abs/1809.11096

StyleGAN — Karras et al.(2019)

StyleGAN模型可以说是最先进的,特别是利用了潜在空间控制。该模型借鉴了神经风格迁移中一种称为自适应实例标准化(AdaIN)的机制来控制潜在空间向量z。映射网络和AdaIN条件在整个生成器模型中的分布的结合使得很难自己实现一个StyleGAN,但它仍是一篇很好的论文,包含了许多有趣的想法。

StyleGAN架构,允许潜在空间控制

论文:

A Style-Based Generator Architecture for Generative Adversarial Networks

Tero Karras, Samuli Laine, Timo Aila

https://arxiv.org/abs/1812.04948

CycleGAN — Zhu et al.(2017)

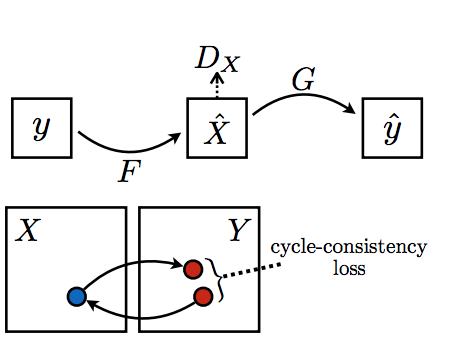

CycleGAN的论文不同于前面列举的6篇论文,因为它讨论的是image-to-image的转换问题,而不是随机向量的图像合成问题。CycleGAN更具体地处理了没有成对训练样本的image-to-image转换的情况。然而,由于Cycle-Consistency loss公式的优雅性,以及如何稳定GAN训练的启发性,这是一篇很好的论文。CycleGAN有很多很酷的应用,比如超分辨率,风格转换,例如将马的图像变成斑马。

Cycle Consistency Loss背后的主要想法,一个句子从法语翻译成英语,再翻译回法语,应该跟原来的是同一个句子

论文:

Unpaired Image-to-Image Translation using Cycle-Consistent Adversarial Networks

Jun-Yan Zhu, Taesung Park, Phillip Isola, Alexei A. Efros

https://arxiv.org/abs/1703.10593

Pix2Pix — Isola et al.(2016)

Pix2Pix是另一种图像到图像转换的GAN模型。该框架使用成对的训练样本,并在GAN模型中使用多种不同的配置。读这篇论文时,我觉得最有趣部分是关于PatchGAN的讨论。PatchGAN通过观察图像的70×70的区域来判断它们是真的还是假的,而不是查看整个图像。该模型还展示了一个有趣的U-Net风格的生成器架构,以及在生成器模型中使用ResNet风格的skip connections。Pix2Pix有很多很酷的应用,比如将草图转换成逼真的照片。

使用成对的训练样本进行Image-to-Image转换

论文:

Image-to-Image Translation with Conditional Adversarial Networks

Phillip Isola, Jun-Yan Zhu, Tinghui Zhou, Alexei A. Efros

https://arxiv.org/abs/1611.07004

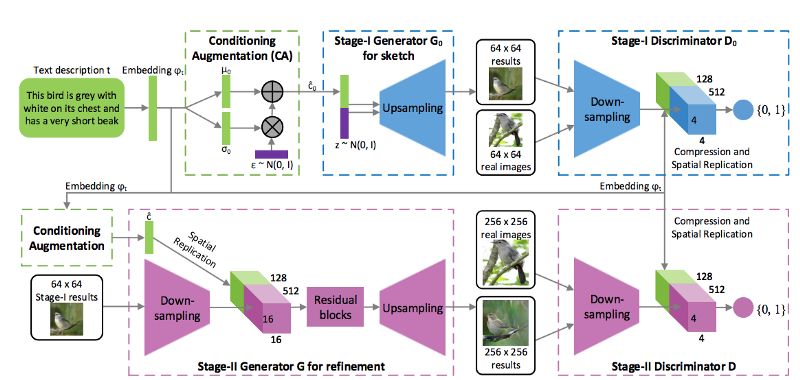

StackGAN — Zhang et al.(2017)

StackGAN的论文与本列表中的前几篇论文相比非常不同。它与Conditional GAN和Progressively Growing GANs最为相似。StackGAN模型的工作原理与Progressively Growing GANs相似,因为它可以在多个尺度上工作。StackGAN首先输出分辨率为64×64的图像,然后将其作为先验信息生成一个256×256分辨率的图像。

StackGAN是从自然语言文本生成图像。这是通过改变文本嵌入来实现的,以便捕获视觉特征。这是一篇非常有趣的文章,如果StyleGAN中显示的潜在空间控制与StackGAN中定义的自然语言接口相结合,想必会非常令人惊讶。

基于文本嵌入的StackGAN多尺度架构背后的想法

论文:

StackGAN: Text to Photo-realistic Image Synthesis with Stacked Generative Adversarial Networks

Han Zhang, Tao Xu, Hongsheng Li, Shaoting Zhang, Xiaogang Wang, Xiaolei Huang, Dimitris Metaxas

https://arxiv.org/abs/1612.03242

Generative Adversarial Networks — Goodfellow et al.(2014)

Ian Goodfellow的原始GAN论文对任何研究GAN的人来说都是必读的。这篇论文定义了GAN框架,并讨论了“非饱和”损失函数。论文还给出了最优判别器的推导,这是近年来GAN论文中经常出现的一个证明。论文还在MNIST、TFD和CIFAR-10图像数据集上对GAN的有效性进行了实验验证。

论文:

Generative Adversarial Networks

Ian J. Goodfellow, Jean Pouget-Abadie, Mehdi Mirza, Bing Xu, David Warde-Farley, Sherjil Ozair, Aaron Courville, Yoshua Bengio

https://arxiv.org/abs/1406.2661

-

GaN

+关注

关注

19文章

2051浏览量

74951 -

生成器

+关注

关注

7文章

321浏览量

21292 -

数据集

+关注

关注

4文章

1212浏览量

24964

原文标题:必读!生成对抗网络GAN论文TOP 10

文章出处:【微信号:aicapital,微信公众号:全球人工智能】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

相关推荐

敏捷合成器的技术原理和应用场景

RF3932D宽带放大器现货库存RF-LAMBDA

#新年新气象,大家新年快乐!#AIGC入门及鸿蒙入门

Google两款先进生成式AI模型登陆Vertex AI平台

直流变频焊接控制器:先进技术在焊接领域的革新应用探索

库克称iPhone16是最先进的iPhone

NVIDIA Nemotron-4 340B模型帮助开发者生成合成训练数据

忆联以完善的产品矩阵与先进技术为AI PC助力

首届人工智能先进技术成果供需对接大会硬核又新潮!

生成对抗网络(GANs)的原理与应用案例

格芯收购 Tagore Technology 的 GaN 技术

TÜV莱茵举办光储充先进技术研讨会,携手行业伙伴共创绿色未来

思科完成对Isovalent的收购

深度学习生成对抗网络(GAN)全解析

生成对抗网络GAN论文TOP 10,帮助你理解最先进技术的基础

生成对抗网络GAN论文TOP 10,帮助你理解最先进技术的基础

评论