当前,人工智能技术已经被应用于监控摄像头中,出现在交通、安防、零售、社区等多个场景。而对抗性样本有可能欺骗神经网络,导致其产生错误的输出。

近日,来自比利时鲁汶大学的研究人员,在预印本平台(arXiv.org)上分享的一篇论文中,研究人员展示了简单的印刷图案如何能够欺骗一个用来识别图像中人物的人工智能系统。

研究人员打印出特别设计的彩色图片并挂在脖子上,从人工智能的角度来看,这可能相当于“隐形斗篷”,也就是说,人工智能检测不出右边的人。

正如研究人员写道:“我们相信,如果我们将这项技术与复杂的服装模拟技术相结合,就可以设计出一种T恤印花,它可以让一个人在自动监控摄像头下几乎隐形。”

这可能看起来很奇怪,但实际上是人工智能世界中一个众所周知的现象。这些类型的模式被称为对抗性样本,它们利用计算机视觉系统的缺陷来诱骗它们看到不存在的东西。

在过去,对抗性样本被用来欺骗面部识别系统。许多研究人员警告说,对抗性的例子具有潜在的危险性。例如,它们可以用来欺骗自动驾驶汽车,将停车标志当成路灯柱,或者它们可以欺骗旨在识别疾病的医学人工智能视觉系统,这可能是为了医疗欺诈,甚至是故意造成伤害。

如何对对抗性样本进行有效的防御是很多学者的重要研究课题。不过,到目前为止,研究人员尚未找到针对对抗样本的最佳防御策略,希望在不久之后,该研究领域会出现突破性的进展。

-

人工智能

+关注

关注

1819文章

50289浏览量

266826

发布评论请先 登录

NMSIS神经网络库使用介绍

在Ubuntu20.04系统中训练神经网络模型的一些经验

CICC2033神经网络部署相关操作

人工智能工程师高频面试题汇总:循环神经网络篇(题目+答案)

液态神经网络(LNN):时间连续性与动态适应性的神经网络

神经网络的并行计算与加速技术

利用超微型 Neuton ML 模型解锁 SoC 边缘人工智能

无刷电机小波神经网络转子位置检测方法的研究

神经网络专家系统在电机故障诊断中的应用

AI神经网络降噪算法在语音通话产品中的应用优势与前景分析

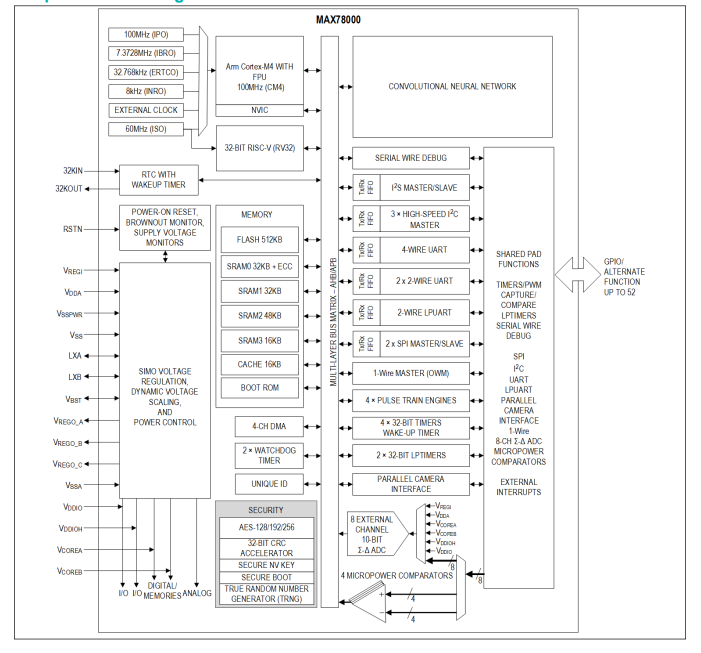

MAX78000采用超低功耗卷积神经网络加速度计的人工智能微控制器技术手册

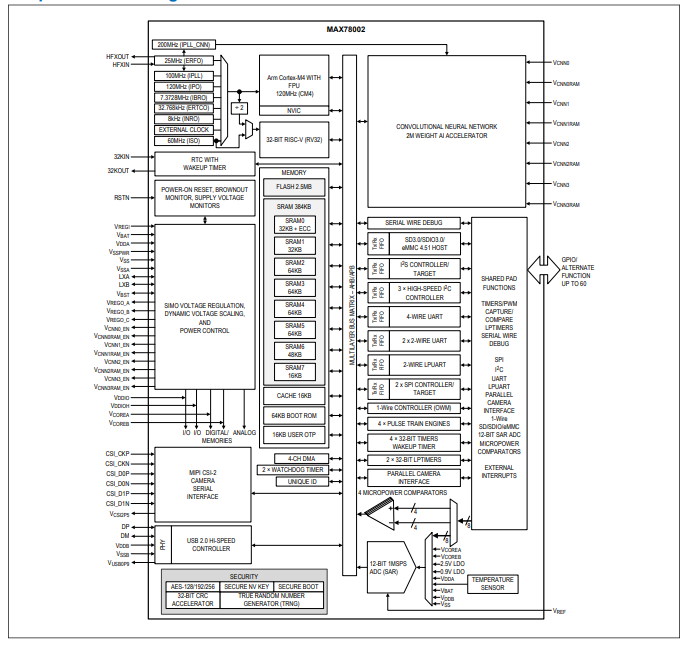

MAX78002带有低功耗卷积神经网络加速器的人工智能微控制器技术手册

人工智能有可能欺骗神经网络 导致其产生错误输出

人工智能有可能欺骗神经网络 导致其产生错误输出

评论