霍金弟子Alan Yuille在前不久发表言论称,至少在计算机视觉领域,深度学习的瓶颈已至。然而,人工智能与大数据的发展是相辅相成的,数据将会推动人工智能的发展,促进更多技术应用落地,将人工智能带入一个新台阶——数据红利悄然将至。

深度学习已至“瓶颈”?数据处理或许是一剂良药。

前不久,霍金弟子、约翰霍普金斯大学教授Alan Yuille发表言论称,至少在计算机视觉领域,深度学习的瓶颈已至。

在此问题上,Alan Yuille认为该领域最严峻的挑战是开发能够应对组合爆炸的算法,如果研究人员追求更多样性的方法和技术,而不仅是追逐当前的流行趋势,这一领域将会得到更快的发展。

而现在,对于深度学习发展已经到了天花板的问题,似乎有了另外的解决方案——数据。

6月18-21日,以“打破理论与现实的壁垒”为主题的O’Reilly和英特尔人工智能大会在京举行。

大会期间,英特尔公司架构图形与软件集团副总裁和数据分析技术总监马子雅在被问到如何看待“深度学习到达瓶颈”的问题时表示,人工智能、数据分析界在此问题上长期以来有两派意见:

一派意见认为人工智能的发展一定要通过对其算法的不断提升才能真正把AI推到一个新台阶;

另一派意见认为人工智能只做算法是不行的,若是不能更好地利用、分析数据,人工智能很快就会达到它的瓶颈。

而马子雅认为,二者是相辅相成的,如同事物发展规律曲折回复,其最终结果会呈上升趋势。

人工智能一直有所精进,但其应用方面并不是非常理想。自从有了大数据,对图像分析领域产生了突破性推进作用。

数据会推动人工智能的发展,会将人工智能带入一个新台阶,部署行业应用,推进人工智能落地:

“人工智能业务的需求牢牢地根植于数据,要充分利用以数据为中心的基础架构,充分利用将数据分析与人工智能无缝衔接起来的软件创新技术。”

而围绕数据为核心,英特尔在AI时代的战略图景也可通过此次大会有所了解:

在软件方面,提供一系列通用工具集,帮助用户最大化利用硬件, 以及通过BigDL和Analytics Zoo构建统一的大数据分析与人工智能平台,帮助用户开发部署行业应用,推进人工智能落地;

在硬件方面,提供完整的硬件产品组合和计算平台,满足用户从设备到边缘再到云端的不同工作负载需求 。

在产、学、研生态打造方面,英特尔宣布在中国成立大数据分析和人工智能创新院,进一步加快集成数据分析和AI的大规模创新与部署。

英特尔人工智能战略的核心在于,致力于给客户带来领先的人工智能硬件和软件产品组合,帮助用户搭建所需要的AI应用,帮助客户解决所面临的个性化问题。除了技术本身,英特尔还致力于与广泛的行业伙伴合作,一起面向共同服务的客户,开发全套、全面、完整的AI解决方案。

在AI时代,英特尔正在完成一次转型——从“芯片航母”到以数据为中心,深挖数据红利,释放数据价值,通过软硬件协同加速人工智能的行业应用。

低门槛开源工具BigDL、Analytics Zoo,数据红利悄然将至

人类处于一个数据变革的时代——历史上90%的数据都是在过去几年产生的,而50%的数据却是在短短两年所生成。

在过去的一段时间数据分析和人工智能得到了空前的发展。

但事实上到目前为止,只有2%的数据被真正的分析用来帮助人类的生产生活。人工智能是时候走出实验室了,走向落地应用了。

而这一过程需要一条完整的数据分析流水线:

第一步,通常需要从生产线上收集大量的原始数据;

第二步,要对这些原始数据进行大量的清理和预处理;

第三步,利用数据分析、机器学习、深度学习对于清理过的数据进行归纳总结;

第四步,可视化。

这条流水线有着较高的门槛:20%的任务是深度学习,但80%都是在做数据收集、数据存储、数据管理、数据清理、数据预处理。

这也正是英特尔开源BigDL、Analytics Zoo的重要原因——降低门槛,让人工智能走出实验室。

目前,BigDL和Analytics Zoo都已开源,大大降低了普通大数据用户和数据科学家在使用深度学习进行数据分析和构建人工智能应用时的门槛。

GitHub开源地址:

https://github.com/intel-analytics/BigDL

先来看看BigDL,BigDL是一个建立在大数据平台(Hadoop/Spark)之上原生的分布式深度学习库,它提供了在Apache Spark上丰富的深度学习功能,以帮助 Hadoop/Spark成为一个统一的数据分析平台,为整个数据分析和机器学习过程提供比现有框架更加统一和集成化的支持。

GitHub开源地址:

https://github.com/intel-analytics/analytics-zoo

同时,在Apache Spark、BigDL以及TensorFLow、Keras的基础上又构建了一个大数据分析+AI的平台Analytics Zoo,方便用户开发基于大数据、端到端的深度学习应用。

不止降低了开发者学习深度学习的门槛,在建立AI生态上,“释放数据红利”已经逐渐变成现实。

人工智能如果不能真正地效力于生产实践,其实是没有任何价值的。看未来的趋势,必须先看到人工智能对于未来哪几个方面能产生比较大的影响。

英特尔通过Analytics Zoo构建统一的大数据分析和人工智能平台,帮助用户开发部署深度学习、人工智能和大数据分析的应用,携手众多合作伙伴和用户,共同推动人工智能部署,加速落地。

美的,韵达,欧洲核子研究组织(CERN)都在利用英特尔Analytics Zoo进行人工智能的落地。英特尔借助BigDL和Analytics Zoo几乎与各行各业的厂商展开了合作,实施部署了各种各样的人工智能的解决方案。

这其中就包括智慧医疗、智慧银行、智慧交通、智慧生产、智慧电信等等。英特尔也与大型云服务提供商、原型设备制造商、软件开发商进行合作,将技术整合产品当中,包括阿里巴巴、百度、腾讯、京东等等。

同时,英特尔还推动与产、学、研的深度合作,打造AI生态。

在大会上,英特尔宣布启动英特尔数据分析和人工智能研究院创新院。创新院的主要负责人是英特尔高级首席工程师、大数据技术全球CTO戴金权。

这个创新院的主要工作集中在以下几点:

第一,加速人工智能在中国市场的落地,尤其是通过将它与数据分析进行整合来加速落地。

第二,解决中国市场的最新需求,引领创新,创新用法、创新算法。第三,帮助中国市场更好地使用英特尔最新的软件和硬件技术。

AI芯片,绝不能输的战场:不局限于CPU,需要研发多种硬件形式

如今AI芯片已经成为一个“绝不能输的战场”。

在O’Reilly大会期间,有着“芯片航母”之称的英特尔在接受媒体采访时透露了在硬件方面的布局图景。

马子雅表示:英特尔的硬件图景不只集中在计算,我们希望英特尔的硬件能够比较全面,例如针对存储方面,英特尔开发了“傲腾”技术,另外英特尔也已经做了很久的网络架构技术。

而作为整个产业的根基,AI芯片如今成为各大巨头纷纷争先想要占领的高地。收购Nervana Systems,成为英特尔全面拥抱人工智能的一个重要节点。

在去年接受新智元采访时,英特尔全球副总裁兼人工智能产品事业部总经理 Naveen Rao 表示AI 已是英特尔“绝不能输的战场”。在2019年1月,英特尔推出了Nervana神经网络推理处理器。本次马子雅也透露对于Nervana的未来规划公司已有路线图,会在更合适的机会和大家分享。

马子雅强调未来的计算力不能局限于CPU一种,尤其是在AI时代,需要通过研发多种多样的硬件形式,保证计算力能够在固定每几年翻一番的速度继续下去,可能都不是集中在通用芯片上,有时候是专用和通用的结合。

事实上,尽管CPU不再是“唯一”,但仍然是计算结构里不可或缺的重要组成部分。就如同Naveen Rao此前说得一样,只要是冯·诺依曼架构,“你必须要有一个CPU”。

英特尔一大优势在于,市面上已经安装并且投入使用的CPU,而硬件基础设施的更新则是逐步进行,“把旧的全扔掉然后换新的”并不现实。如今,全球有3500万公司使用英特尔的CPU,眼下最火热的人工智能推理,也有近 90% 是在英特尔的芯片上完成。

英特尔在制程与封装上仍处于领先位置。制程工艺不断向更高的晶体管密度发展,为芯片带来更强的性能和更低的功耗。拥有领先的制程技术,是构建领先硬件产品的关键。

制程的领先仍然是英特尔继续发挥产品优势的关键因素,在10纳米领域英特尔继续推动产品的发展。在Foveros的制程中,英特尔的3D封装技术可实现在逻辑晶圆上堆叠逻辑处理单元,能够把逻辑芯片和逻辑芯片连在一起,更好地发挥异构功效。

另外,在CPU的周围,你可以放上GPU、DSP、ISP,以及NNP,或者各种新的架构。

英特尔认为,未来十年架构创新会是创新的主要驱动力,将继续带来指数级的扩展效应。除了常见的标量、矢量、矩阵和空间这四种计算架构外,英特尔在架构创新上还做了更多的工作,例如:

Loihi神经拟态计算。它可以用超低的功耗去完成一个GPU用很高功耗才能完成的任务,并能通过学习得到一个新的网络。

量子计算。量子计算是在架构上的另外一个全新的超大并行规模计算。英特尔在量子计算有两个不同的探索模式,一个是和业界类似的通过超导方式做量子位和量子芯片;另外一种是基于英特尔比较擅长的硅处理工艺,用自旋的方式,目前也有了(自旋)量子位芯片,并且为了能够规模化的生产和测试,专门和产业界、学术界合作。

保持CPU王者的领先优势,同时开发适合AI时代的多种硬件形式,AI化是英特发展硬件的未来方向。

AI并非“一策万能”:软硬件协同创新,实现超异构时代的技术愿景

事实上,过去几年间计算力正在以惊人的速率增长。计算力指数级上升的实现,正是基于硬件与软件的结合。如果想实现指数级的增长,必须要硬件和软件共同创新。

在讲述硬件未来图景时,马子雅提到需要研发多种多样的硬件形式。然而,AI并非“一策万能”。

没有一种方案能解决所有问题(one size doesn’t fit all),需要多样化的产品组合满足不同人工智能应用的需求。

从某种程度上,在人工智能这一领域,英特尔更像是AI解决方案提供者,针对不同的案例提供不同的软硬件组合:

从软件层面,英特尔主要集中在开源方面,例如开源BigDL和Analytics Zoo。

未来十年的计算创新由架构驱动。英特尔具备独具一格的优势,可以将标量(CPU)、矢量(GPU)、矩阵(AI)和空间(FPGA)等不同架构整合到系统级平台和系统级封装,同时也在进行架构创新的新探索,比如Loihi神经拟态计算芯片、量子计算。

而怎样进行组合则是由客户的工作负载来决定,决定适的软件和合适的硬件。

马子雅透露到,最有效的办法、为客户提供最好的解决方案,就是先知道他的工作负载是什么,然后找到相应的软件硬件结合来解决那个工作负载,这是最行之有效的。

英特尔强调在硬件上每得到一个指数级的性能提升,如果加上软件的话可能有两个指数级的性能提升。对于此,英特尔从操作系统再到上层整合成一个完整的全栈软件技术(Vertical Stack),然后在硬件架构的优化全部打通。

通过这种技术能够把各种性能,架构上所有软件的性能整合起来然后提供给用户,大大提高其在这些架构上得到的性能和算力。值得一提的是,英特尔“One API”项目将为开发者带来一套能提供一个统一编程模型的工具。针对跨多种架构的工作负载,这个模型简化了相关的开发工作。

对英特尔而言,就是要提供多样化的标量、矢量、矩阵和空间架构组合,以先进制程技术进行设计,由颠覆性内存层次结构提供支持,通过先进封装集成到系统中,使用光速互连进行超大规模部署,提供统一的软件开发接口以及安全功能,从而实现超异构计算的技术愿景。

AI计算如今已经迈入超异构时代,硬件基础只是AI超级生态中的一个环节,但是以数据为中心的未来还需要更完整的系统思考,单一因素已经不足以满足多元化的未来计算需求,必须实现软硬件协同创新。

-

英特尔

+关注

关注

60文章

9880浏览量

171470 -

计算机视觉

+关注

关注

8文章

1696浏览量

45927 -

深度学习

+关注

关注

73文章

5492浏览量

120975

原文标题:深度学习已至“瓶颈”?英特尔:数据处理是一剂良药

文章出处:【微信号:AI_era,微信公众号:新智元】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

相关推荐

海量数据处理需要多少RAM内存

GPU深度学习应用案例

FPGA在数据处理中的应用实例

深度学习算法在集成电路测试中的应用

深度学习与nlp的区别在哪

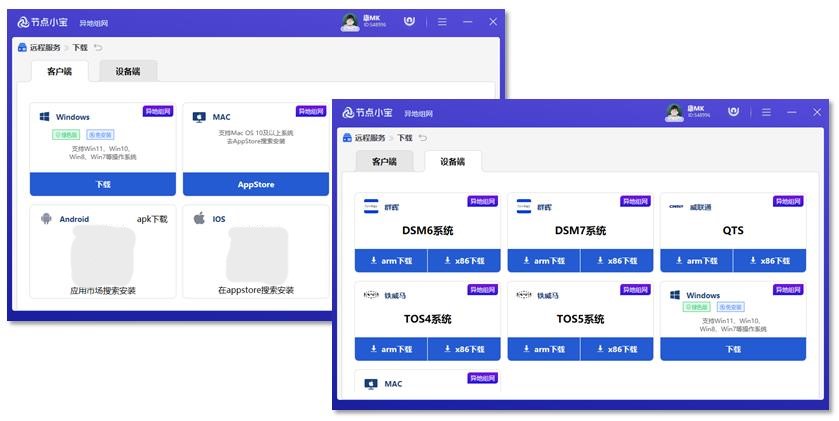

这或许是我用过最快的远程管理软件

在8D魔幻城市,感受“信号升格”和5G-A的独特魅力

工程监测领域振弦采集仪的数据处理与分析方法探讨

工程监测中振弦采集仪的数据处理方法研究

深度学习已至“瓶颈”?数据处理或许是一剂良药

深度学习已至“瓶颈”?数据处理或许是一剂良药

评论