纳米光子介质在人工神经干涉中的应用

本文中,学者们介绍了一种纳米光子神经介质,可以执行相当于人工神经计算的复杂和非线性模式映射。具体而言,他们的工作证明了通过纳米光子介质的光波能够执行人工神经计算,测试集的精度约为84%。

许多现有的光学神经计算技术通过利用分层前馈网络遵循数字ANN的架构。但是对于新的纳米光子神经介质(NNM),研究人员表明,通过利用光学反射,可以超越分层前馈网络的范例,以连续和无层的方式实现人工神经计算。

复杂信息是输入光的波前编码。该介质转换波前可以实现复杂的计算任务,例如图像识别。在输出端,光能集中在明确定义的位置,例如,可以将其解释为图像中物体的身份。这些计算媒体可以小到几十个波长,并提供超高的计算密度。他们利用亚波长散射体实现复杂的输入/输出映射,超越了传统纳米光子器件的功能。

一段时间以来,AI社区一直在寻找减少神经网络训练和推理所需的内存和功耗的方法。与传统方法不同,NNM非常具有前景,因为它的能耗最低。

该方法的固有并行性可以显著提高计算速度。结合超高计算密度,NNM方法可用作各种信息设备中的模拟预处理单元。

原文:shorturl.at/sJPS4

无监督数据增强(UDA),实现更高效,更连续的半监督学习

在最近的一篇论文中,Google AI研究人员证明,数据增强也可以应用于未标记的数据,用来推进半监督学习。他们的方法,即所谓的无监督数据增强或UDA,能够促进模型预测在未标记的样本和增强的未标记样本之间保持一致。

在评估方面,UDA取得了出色的成果。例如,在IMDb文本分类数据集中,UDA仅使用20个标记样本实现了4.20的错误率,超过了在25,000个标记样本上训练的传统模型。

在标准的半监督学习基准CIFAR-10和SVHN上,UDA优于所有前述方法,CIFAR-10的错误率为2.7%,仅有4,000个样本,SVHN的错误率为2.85%,只有250个样本。

UDA也适用于像ImageNet这样的大型数据集。当使用标记组的10%进行训练时,UDA将前1/前5精度从55.1/77.3%提高到68.7/88.5%。对于具有130万额外未标记数据的完整ImageNet,UDA进一步将性能从78.3/94.4%提升至79.0/94.5%。

这项工作表明,可以应用数据增强来增强半监督学习。对于半监督学习方法的数据稀缺,这一方法非常有效。此外,即使有大规模数据,UDA也能提供强劲的收益。

为了避免UDA过度拟合,研究人员提出了一种称为TSA的技术,用于存在大量未标记数据的情况。这种学习已被证明与数据提升相匹配并且令人惊讶地超越了监督学习。

增强神经网络的泛化

Google AI的研究人员建议在网络层使用标准化的边际分配作为推广差距的预测因子。在对边际分布与概括之间的关系进行实证研究后,他们证明了距离的正确归一化和边际分布的一些基本统计可以准确地预测广义差距。

研究人员还介绍了深度模型推广(DEMOGEN)数据集,包括756个训练深度模型,以及他们在CIFAR-10和CIFAR-100数据集上的训练和测试性能。这些模型是CNN和ResNet-32的变体,具有不同的流行正则化技术和超参数设置,从而引发了广泛的泛化行为。例如,在CIFAR-10上训练的CNN模型的测试精度范围为60%至90.5%,一般化差距为1%至35%。

这项工作为AI社区提供了一个用于研究泛化的工具。它还鼓励进一步研究隐藏层中的泛化间隙预测器和边缘分布。

多语言语音合成和跨语言语音克隆

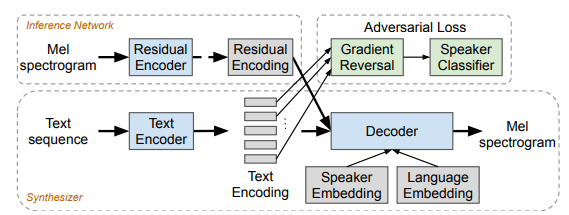

学者们提出了一种基于Tacotron(中文语音合成)的多人多种语言文本到语音(TTS)的合成算法,能够在多种语言中生成高质量的语音。模型结构采用基于注意力机制的序列到序列模型,根据输入文本序列生成倒谱梅频(log-mel,来自MFCC梅尔频率倒谱系数)图帧序列。

该模型是通过使用音位输入表示来设计的,以激励跨语言的模型容量共享。它还包含了一个对抗性的损失,以帮助理清它的说话者表示。通过对每种语言的多名使用者进行训练,加入自动编码输入,并在训练期间来帮助稳定注意力,从而进一步扩大了训练规模。

该模型对三种语言的高质量语音合成和语音训练的跨语言传输具有重要的应用潜力。例如,不需要任何双语或并行语言的训练,它就能够使用英语使用者的声音合成流利的西班牙语。此外,该模型在学习说外语的同时还会适量调节口音。

它可以扩展并利用大量低质的训练数据,来支持更多的使用者和语言。

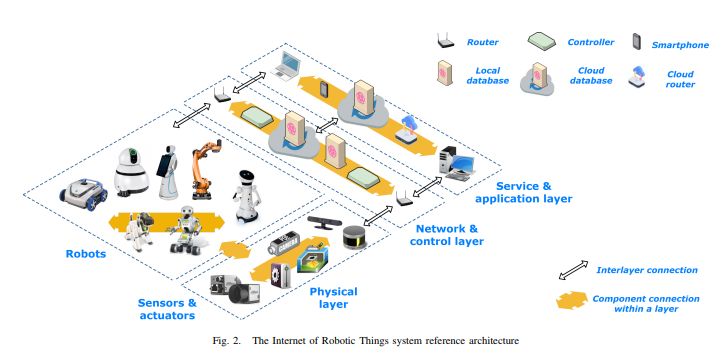

机器人物联网(IoRT)是一种新引入的理论,旨在定义机器人在物联网场景中的综合运用。物联网和机器人研究领域的研究现在已经紧密地联系在一起了,不能再分别看待。

它们的紧密联系使两个研究领域走到了一起,研究人员只有合作才能推动这两个领域的进步。本文试图将这两个领域结合在一起,提供了关于互联网机器人的一个概述,分析和挑战,可能的解决方案。该研究探讨了IoRT架构、智能空间集成以及机器人应用等问题。

当两个或两个以上的领域紧密联系在一起时,将它们的研究和开发结合起来,并快速推进它们就变得至关重要。机器人和物联网结合的时代已经到来,目的是帮助研究人员共同努力,推动相关理论、模型和应用的发展。

它们的综合运用将有助于促进研究,这些研究可用于帮助开发更多更好的应用,例如家庭自动化、卫生健康、交通、物流等。

-

机器人

+关注

关注

211文章

28476浏览量

207413 -

语音合成

+关注

关注

2文章

90浏览量

16175

原文标题:合成特朗普的西班牙语演讲,新研究实现跨语言语音克隆 | 一周AI最火论文

文章出处:【微信号:BigDataDigest,微信公众号:大数据文摘】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

相关推荐

纳米光子介质能够执行人工神经计算 因为它的能耗最低

纳米光子介质能够执行人工神经计算 因为它的能耗最低

评论