NVIDIA 推出的CUDA(计算统一设备架构)是基于GPU 进行通用计算的开发平台,非常适合大规模的并行数据计算。在GPU 流处理器架构下用CUDA 技术实现编码并行化,并针对流处理器架构特点进行

2018-01-18 07:30:00 5394

5394

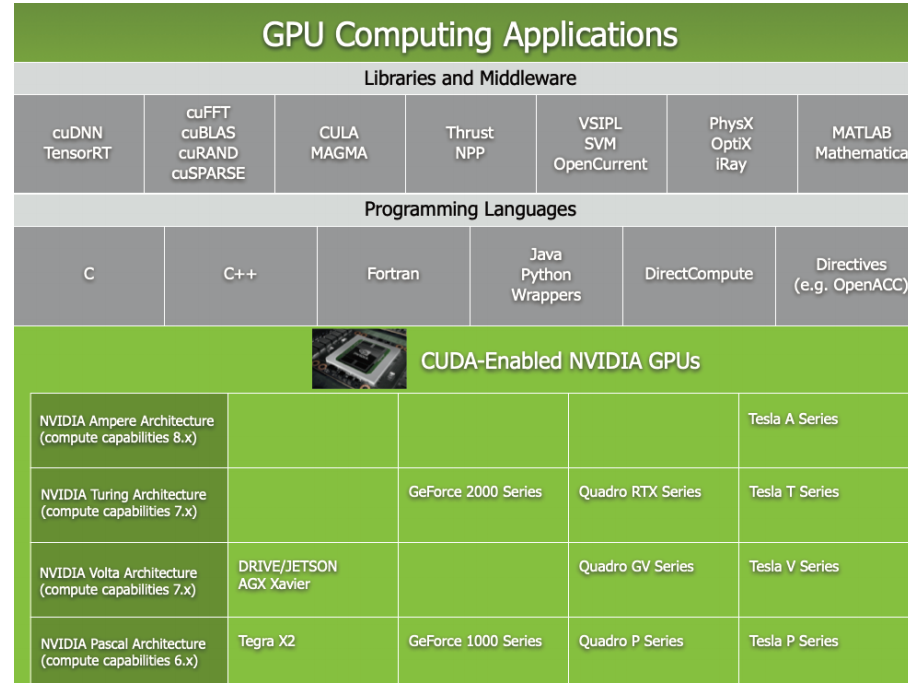

NVIDIA CUDA 深度神经网络库(cuDNN)是一个 GPU 加速的深度神经网络基元库,能够以高度优化的方式实现标准例程(如前向和反向卷积、池化层、归一化和激活层)。

2022-07-23 11:04:34 1292

1292 OpenCV4支持通过GPU实现CUDA加速执行,实现对OpenCV图像处理程序的加速运行,当前支持加速的模块包括如下。

2023-12-05 09:56:35 364

364

电子发烧友网报道(文/黄晶晶)当业界更多的将英伟达定义成一家软件公司的时候,其建立在GPU+CUDA生态上的商业模式也成为其领先的关键。而如今,国产GPU这几年发展得非常快,具有一批面向图形和计算

2022-01-27 12:15:54 6557

6557 是否有关于GRID vGPU的CUDA / OpenCL支持的更新信息?以上来自于谷歌翻译以下为原文Is there any updated information about CUDA/OpenCL support for GRID vGPU ?

2018-09-07 16:42:47

CUDA教程之1:Linux系统下CUDA安装教程

2020-06-02 16:53:31

Nvidia CUDA 2.0编程教程

2019-03-05 07:30:00

,GPU已经不再局限于3D图形处理了,GPU通用计算技术发展已经引起业界不少的关注,事实也证明在浮点运算、并行计算等部分计算方面,GPU可以提供数十倍乃至于上百倍于CPU的性能。GPU通用计算方面

2016-01-16 08:59:11

最近遇到了一个加速matlab程序的问题,不知道如何利用GPU,以及使用GPU的先决条件,是不是GPU加速必须要用cuda,最重要的是只用GPUArray和gather函数,加速效果不知道如何,主要是有多个函数调用关系?哪位前辈能指导一下?

2019-03-30 11:21:12

GPU 加速的 L0 范数图像平滑(L0 Smooth)【CUDA】

2020-07-08 12:10:13

/m60-can-it-be-used-for-deep-learning-/我遇到了类似的问题,但它是关于M10的。我用GRID M10-8Q创建了一个虚拟机,我想在进行深度学习时使用cuda加速计算。但是,我在这里找不到特斯拉M10

2018-09-26 15:30:23

浅谈三层架构原理

2022-01-16 09:14:46

浅谈大数据视频图像处理系统技术近年来,随着计算机、网络以及图像处理、传输技术的飞速发展,视频监控系统正向着高清化、智能化和网络化方向发展。视频监控系统的高清化、智能化和网络化为视频监控图像处理技术

2013-09-24 15:22:25

浅谈认知无线电关键技术及其在煤矿通信中的应用

2013-03-16 16:06:45

我们有一个使用Grid K2机器的系统。我试图在一个vm的侧面设置cuda。当我使用驱动程序下载页面时,它指向NVIDIA-Linux-x86_64-367.57版本的驱动程序似乎工作(它们安装

2018-10-10 17:02:15

PowerVR 6系列GPU与竞争对手Mali-T600系列GPU的规格对比PowerVR的看家本领——TBDR渲染技术

2021-02-26 07:39:38

1.安装toolkit(1)cd /home/CUDA_train/software/cuda4.1(2)./cudatoolkit_4.1.28_linux_64_rhel6.x.run

2019-07-24 06:11:31

NVIDIA CUDA参考文件

2019-03-05 08:00:00

你好我有一个裸机Windows 2002 RC 2 x64bit服务器,带有物理NVIDIA Grid SERIES K2卡(不是vGPU vGRID)。这张卡与CUDA兼容吗?我使用的软件没有将其

2018-09-10 17:18:51

GPU 的数量和类型:2 Kepler GK104s CUDA核心数量:3072(每颗 GPU 1536 个)双精度浮点性能:190 Gigaflops(每颗 GPU 95 Gflops)单精度浮点性能

2014-08-21 11:18:27

``提供个人超级计算机解决方案 高性能GPU运算服务器解决方案/集群解决方案 Nvidia Tesla C2050 CUDA核心频率:1.15 GHz CUDA核心数量:448 双精度浮点性能

2014-08-03 18:09:13

``提供个人超级计算机解决方案 高性能GPU运算服务器解决方案/集群解决方案 Nvidia Tesla C2050 CUDA核心频率:1.15 GHz CUDA核心数量:448 双精度浮点性能

2014-08-26 16:36:28

质保工业包装现货Nvidia GRID K1GPU 的数量和类型:4*Kepler CUDA核心数量:768 专用存储器总容量:16GB DDR3用于虚拟化功耗:139W热设计功耗 被动散热14000

2014-09-15 16:15:00

质保工业包装现货Nvidia GRID K1GPU 的数量和类型:4*Kepler CUDA核心数量:768 专用存储器总容量:16GB DDR3用于虚拟化功耗:139W热设计功耗 被动散热14000

2014-09-11 12:48:26

GRID K1GPU 的数量和类型:4*Kepler CUDA核心数量:768 专用存储器总容量:16GB DDR3用于虚拟化功耗:139W热设计功耗 被动散热15000三年质保工业包装现货

2015-02-05 16:14:28

"GPU 的数量和类型:1 Kepler GK110CUDA核心数量:2496 双精度浮点性能:1.17 Tflops 单精度浮点性能:3.52 Tflops 专用存储器总容量

2014-09-02 21:17:41

GRID K1GPU 的数量和类型:4*Kepler CUDA核心数量:768 专用存储器总容量:16GB DDR3用于虚拟化功耗:139W热设计功耗 被动散热15000三年质保工业包装现货Nvidia

2015-01-19 16:53:59

GRID K1GPU 的数量和类型:4*Kepler CUDA核心数量:768 专用存储器总容量:16GB DDR3用于虚拟化功耗:139W热设计功耗 被动散热15000三年质保工业包装现货Nvidia

2015-01-19 16:54:53

GRID K1GPU 的数量和类型:4*Kepler CUDA核心数量:768 专用存储器总容量:16GB DDR3用于虚拟化功耗:139W热设计功耗 被动散热15000三年质保工业包装现货Nvidia

2015-01-19 16:59:48

/nvidia-system-management-interface请参阅此链接以获取手册页以及要使用的各种开关/工具:http://developer.download.nvidia.com/compute/cuda/5_5/rel/nvml

2018-09-04 15:18:02

GPU架构设计者提供反馈,以改善和推进未来GPU的架构设计基本要求(其一即可): * 严谨的逻辑思维和分析能力* 有CUDA代码调优经验(或者SIMD等架构的调优经验)* 熟悉矩阵计算的优化和加速* 较强C++编程能力、算法分析和实现* 熟悉计算机体系结构*了解GPU架构与基于GPU的高性能计算

2017-09-01 17:22:28

/deviceQuery若看到类似以下信息则说明 cuda 已安装成功:

7、安装cuDNN

cuDNN是GPU加速计算深层神经网络的库。首先去官网 https://developer.nvidia.com

2019-07-09 07:45:08

AR350。在这样的大佬带领下,Think Silicon或许有机会更进一步,把RISC-V GPU往光追这样的先进图形技术上发展。开源GPU生态RISC-V作为一个开源指令集,自然也少不了开源

2022-03-24 15:53:12

摘要: GPU深度好文系列,阿里云技术专家分享第一章GPU虚拟化发展史GPU的虚拟化发展历程事实上与公有云市场和云计算应用场景的普及息息相关。如果在10年前谈起云计算,大部分人的反应是“不知所云

2018-04-16 10:51:32

什么是CUDA?

2021-09-28 07:37:20

在大家开始深度学习时,几乎所有的入门教程都会提到CUDA这个词。那么什么是CUDA?她和我们进行深度学习的环境部署等有什么关系?通过查阅资料,我整理了这份简洁版CUDA入门文档,希望能帮助大家用最快

2021-07-26 06:28:15

什么是数码功放?浅谈数码功放

2021-06-07 06:06:15

工作。对于Premiere Pro的使用,我们需要CUDA强制渲染GPU而不是使用CPU来渲染视频。是否支持使用NVIDIA GRID K2卡?以上来自于谷歌翻译以下为原文We have

2018-09-10 17:18:49

华为GPU Turbo揭秘,吓人的技术,原来只是神经网络

2019-11-11 06:24:43

如果没有其他用户共享K520,您是否可以抓取两个GPU进行CUDA计算作业?我们的应用程序使用GPU进行显示和计算。当我们在AWS K520实例上运行时,CUDA只能看到K520上的一个GPU。我们

2018-09-26 15:23:49

[cuda] Linux系统多版本cuda环境下的cuda-90安装

2019-06-19 17:04:45

企业培训公司面向单位员工培训,长期招CUDA兼职老师,一般三天左右的短周期培训,周末为主,有2人左右的小辅导,也有30人左右的培训大班,待遇优,北京,上海,成都,广州,深圳等,如您想挣点外块,积累

2017-09-22 10:31:38

发挥到最高点。现招GPU研发相关专业讲师短周期的培训,可周末,如您想挣点外块,积累资源,充实生活,请联系我。要求有二年以上实际项目经历,具有CUDA或OpenCL实际项目开发经验者优先,表达能力较好

2016-07-29 13:14:23

现招GPU研发相关专业讲师短周期的培训,可周末,如您想挣点外块,积累资源,充实生活,请联系我。要求有二年以上实际项目经历,具有CUDA或OpenCL实际项目开发经验者优先,表达能力较好

2020-01-13 14:50:39

1、探求 NVIDIA GPU 极限性能的利器 在通常的 CUDA 编程中,用户主要通过 CUDA C/C++ 或 python 语言实现 CUDA 功能的调用。在 NVIDIA 对 CUDA C

2022-10-11 14:35:28

和Horizon 7.1。我能够在C ++中编译示例CUDA代码(Windows 10. Visual Studio 2015),但在运行时,我得到了一个

2018-09-11 16:33:56

本文重点研究了Voronoi图的栅格生成方法,首先比较了常见的栅格方法生成Voronoi图的优缺点,然后结合CUDA的出现,提出一种基于GPU的Voronoi图并行栅格生成算法。

2021-06-01 06:44:08

该删除“在一个物理gpu中一个类型的所有vgpu(例如k120q)”的限制! - 如果共享的分层可编程性比CUDA可用,则所有vGPU类型都应该可用! - 如果调度程序具有固定/绑定功能(对SMX

2018-09-11 16:37:04

描述光线追踪性能),每秒 500T OPs 深度学习,支持 NVLink,每秒 100GB,支持每秒 500 万亿张量的操作。黄仁勋表示,图灵架构是自 2006 年 CUDA GPU 发明以来最大的飞跃

2018-08-15 10:59:45

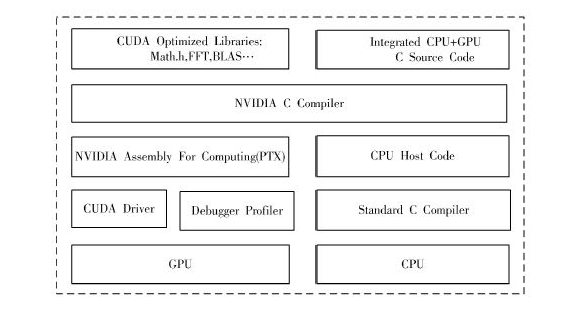

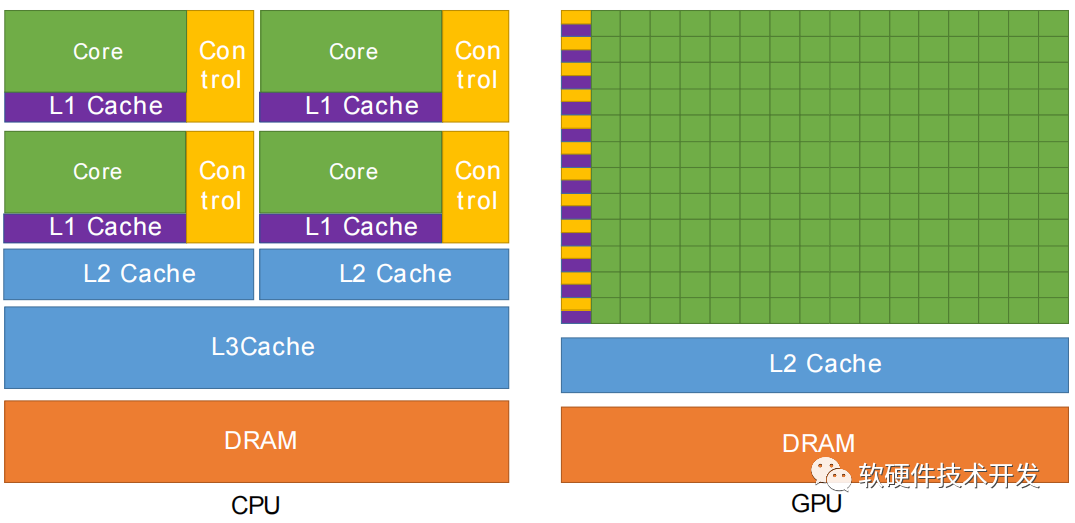

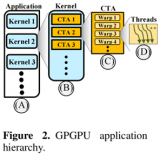

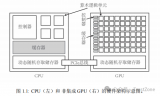

目录文章目录目录显卡GPUCPU 与 GPU 的区别GPU 的架构CUDA 编程模式CUDA 的架构利用 CUDA 进行多并发编程的原理虚拟机显卡的实现方式虚拟显卡显卡直通物理显卡虚拟化KVM

2021-07-23 08:56:19

什么是显卡?什么是GPU?什么是CUDA?CPU和GPU的关系是什么?

2021-09-27 08:22:16

l强大的处理能力 GPU接近1Tflops/s

l高带宽 140GB/s

l低成本 Gflop/$和Gflops/w高于CPU

l当前世界超级计算机五百强的入门门槛为12Tflops/s

l一个

2010-08-16 16:12:21 0

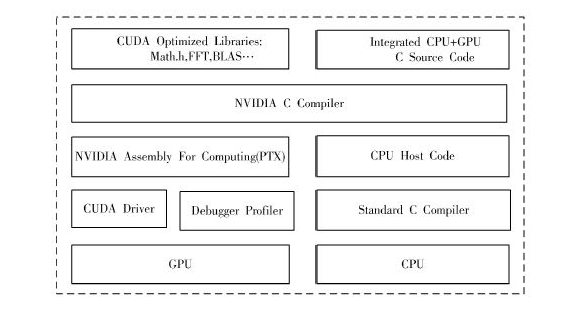

0 全面介绍使用CUDA进行通用计算所需

要的语法、硬件架构、程序优化技巧等知识,是进行GPU通用计算程序开发的入门教材和参考书。

本书共分5章。第1章

2010-08-16 16:21:32 0

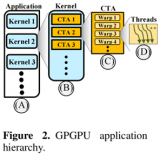

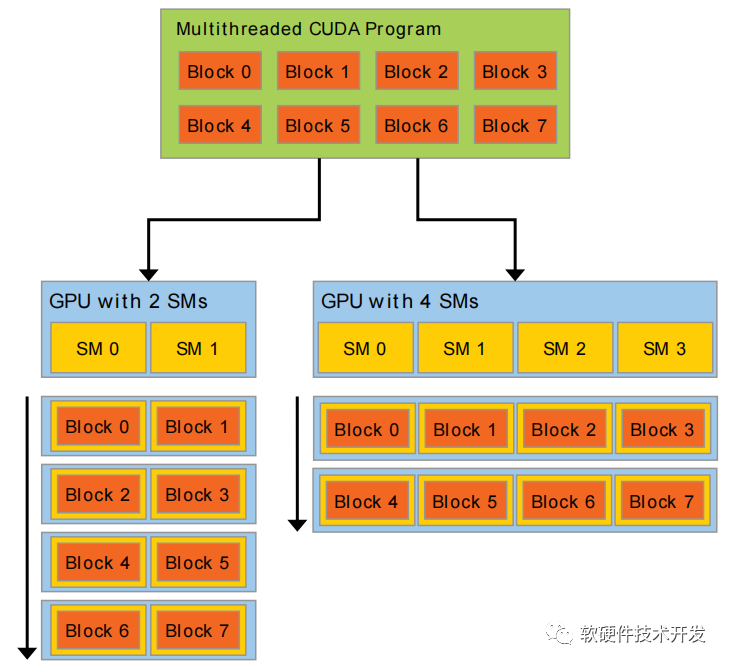

0 •GPGPU及CUDA介绍

•CUDA编程模型

•多线程及存储器硬件

2010-11-12 16:12:10 0

0 NVIDIA采用了两项关键技术——G80统一图形与计算架构(最先采用于GeForce 8800、Quadro FX 5600与Tesla C870 GPU)和CUDA。CUDA作为一种软硬件架构,可采用多种高级编程语言对GPU进行编程

2011-08-09 09:56:27 2593

2593 CUDA是NVIDIA创造的一个并行计算平台和编程模型。它利用图形处理器(GPU)能力,实现计算性能的显著提高。NVIDIA是在2006年推出的CUDA,自那以后,股价从最初的7美元一路攀升到现在的260多美元。

2018-09-04 17:27:23 4122

4122 据介绍,英伟达已经售出15亿块GPU,如今在使用的每块GPU都兼容CUDA。而英伟达CUDA平台具有丰富的库、工具和应用程序。仅在去年,英伟达就发布了500多个SDK和库,其中既有全新内容,也有更新版本。

2019-12-18 14:26:35 2380

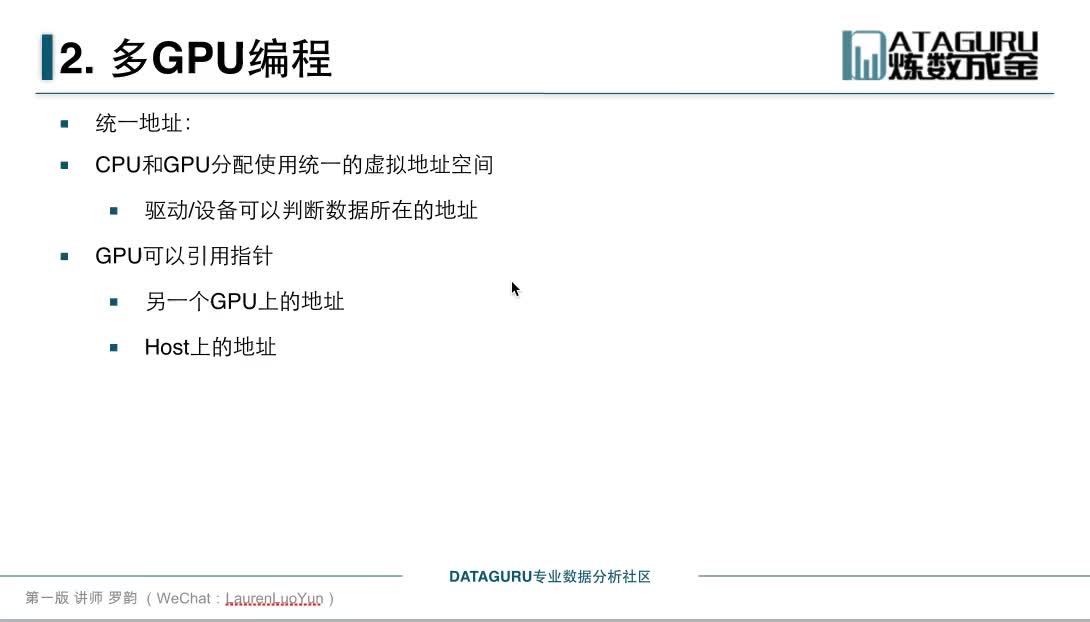

2380 NVIDIA在CUDA 6中引入了统一内存模型 ( Unified Memory ),这是CUDA历史上最重要的编程模型改进之一。在当今典型的PC或群集节点中,CPU和GPU的内存在物理上是独立

2020-07-02 14:08:23 2384

2384 1、CUDA的简介 2、GPU架构和CUDA介绍3、CUDA架构4、开发环境说明和配置5、开始第一个Hello CUDA程序 5.1、VS2017创建NVIDIA CUDA项目...

2020-12-14 23:40:27 659

659 浅谈AC-LED照明技术(村田电源技术有限公司)-浅谈AC-LED照明技术

2021-09-27 10:26:28 10

10 通过 CUDA Toolkit,您可以在 GPU 加速的嵌入式系统、桌面工作站、企业数据中心、基于云的平台和 HPC 超级计算机上开发、优化和部署应用程序。

2022-03-10 10:15:44 2018

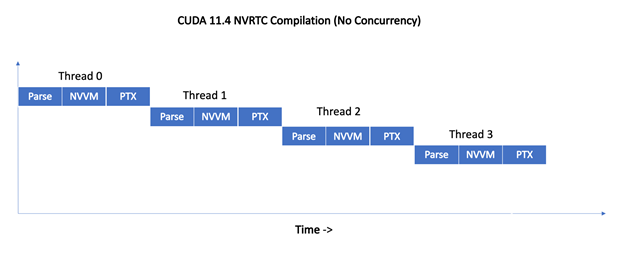

2018 NVIDIA 发布的 CUDA 开发环境 CUDA 11.6 的最新版本。本版本的重点是增强 CUDA 应用程序的编程模型和性能。 CUDA 继续推动 GPU 加速度的边界,并为 HPC 、可视化、 AI 、 ML 和 DL 和数据科学中的新应用奠定基础。

2022-04-02 16:43:34 3996

3996 NVIDIA 宣布 CUDA 开发环境的最新版本 CUDA 11 . 5 。 CUDA 11 . 5 专注于增强您的 CUDA 应用程序的编程模型和性能。 CUDA 继续推动 GPU 加速的边界,并为 HPC 、可视化、 AI 、 ML 和 DL 中的新应用打下基础,和数据科学。

2022-04-02 16:48:47 2603

2603

CUDA 11.4 配备 R470 驱动程序。该驱动程序现在包括 GPU 直接 RDMA ,以及 GPU 直接存储包,它们简化并使您能够利用这些技术,而无需单独安装其他包。该驱动程序还为最近推出

2022-04-02 16:59:56 2966

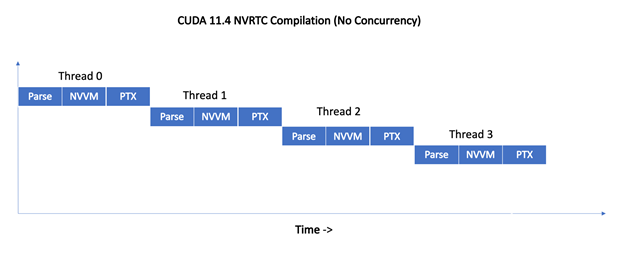

2966 CUDA 11 . 5 C ++编译器解决了不断增长的客户请求。具体来说,如何减少 CUDA 应用程序构建时间。除了消除未使用的内核外, NVRTC 和 PTX 并发编译有助于解决这个关键问题 CUDA C ++应用程序开发的关注点。

2022-04-06 11:59:23 1889

1889

Numba 为 Python 开发人员提供了一个进入 GPU 加速计算的简单入口,并为使用日益复杂的 CUDA 代码提供了一条路径,只需使用最少的新语法和行话。

2022-04-11 09:58:38 1331

1331 共享内存是编写优化良好的 CUDA 代码的一个强大功能。共享内存的访问比全局内存访问快得多,因为它位于芯片上。

2022-04-11 10:03:45 6774

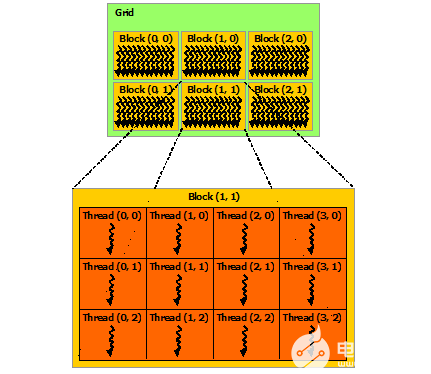

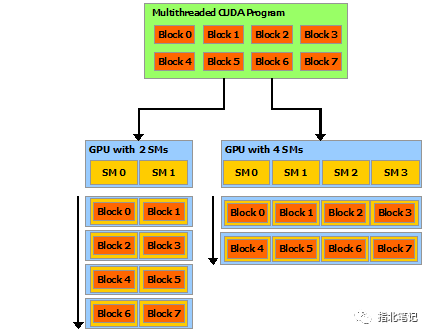

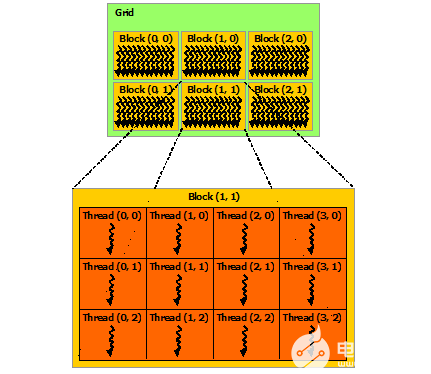

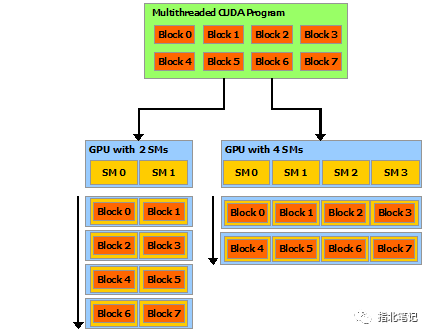

6774 CUDA 编程模型是一个异构模型,其中使用了 CPU 和 GPU 。在 CUDA 中, host 指的是 CPU 及其存储器, device 是指 GPU 及其存储器。在主机上运行的代码可以管理主机和设备上的内存,还可以启动在设备上执行的函数 kernels 。这些内核由许多 GPU 线程并行执行。

2022-04-11 10:13:12 1192

1192 在 CUDA 编程模型中,线程是进行计算或内存操作的最低抽象级别。 从基于 NVIDIA Ampere GPU 架构的设备开始,CUDA 编程模型通过异步编程模型为内存操作提供加速。 异步编程模型定义了与 CUDA 线程相关的异步操作的行为。

2022-04-20 17:16:03 2410

2410

NVIDIA CUDA 工具包提供了开发环境,可供开发、优化和部署经 GPU 加速的高性能应用。

2022-06-10 12:03:42 2964

2964 单精度矩阵乘法(SGEMM)几乎是每一位学习 CUDA 的同学绕不开的案例,这个经典的计算密集型案例可以很好地展示 GPU 编程中常用的优化技巧。本文将详细介绍 CUDA SGEMM 的优化手段

2022-09-28 09:46:54 1511

1511 CUDA(Compute Unified Device Architecture,统一计算架构)是由英伟达所推出的一种集成技术,是该公司对于GPGPU的正式名称。通过这个技术,用户可利用NVIDIA的GPU进行图像处理之外的运算,CUDA也是首次可以利用GPU作为C-编译器的开发环境。

2022-11-29 09:36:55 2464

2464 。 用户可在 GitHub: https://github.com/CVCUDA/CV-CUDA 下载和试用。 CV-CUDA 是一个开源项目,可在 AI 成像和计算机视觉 (CV) 流程中通过 GPU

2022-12-21 20:45:02 732

732 CUDA是NVIDIA的一种用于GPU编程的技术,CUDA核心是GPU上的一组小型计算单元,它们可以同时执行大量的计算任务。

2023-01-08 09:20:14 1874

1874 并不完整。作者在实际操作中也是踩坑无数,同时借此整理一篇关于OpenCV配置CUDA支持GPU加速的教程,供大家参考。

2023-01-09 10:16:01 2912

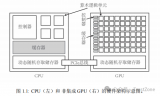

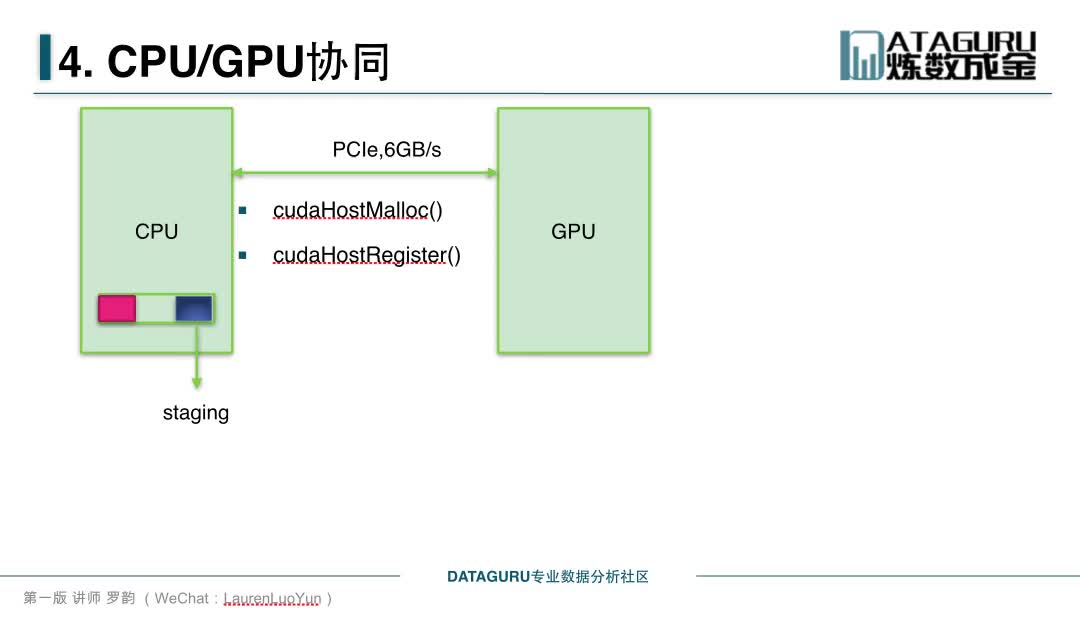

2912 在异构计算架构中,GPU与CPU通过PCIe总线连接在一起来协同工作,CPU所在位置称为为主机端(host),而GPU所在位置称为设备端(device),两者优势互补。

2023-01-10 09:54:51 2426

2426 CUDA 除了是并行计算架构外,还是 CPU 和 GPU 协调工作的通用语言。在CUDA 编程模型中,主要有 Host(主机)和 Device(设备)两个概念,Host 包含 CPU 和主机内存,Device 包含 GPU 和显存

2023-05-18 09:57:54 1576

1576

CUDA 编程模型主要有三个关键抽象:层级的线程组,共享内存和栅同步(barrier synchronization)。

2023-05-19 11:32:54 1017

1017

成熟且完善的平台生态是 GPU 厂商的护城河。相较于持续迭代的微架构带来的技术壁垒硬实力,成熟的软件生态形成的强大用户粘性将在长时间内塑造 GPU厂商的软实力。以英伟达 CUDA 为例的软硬件

2023-06-06 14:36:23 1063

1063

随着科技的不断发展,计算机视觉已成为当今最炙手可热的技术领域之一,被广泛应用于图像处理、视频分析、自动驾驶等多个场景。GPU 高性能的计算能力对于计算机视觉任务的成功实现至关重要。NVIDIA 推出

2023-06-13 20:55:03 259

259

GPU的线程从thread grid 到thread block,一个thread block在CUDA Core上执行时,会分成warp执行,warp的颗粒度是32个线程。

2023-08-14 14:39:51 539

539

CUDA核心(Compute Unified Device Architecture Core)是NVIDIA图形处理器(GPU)上的计算单元,用于执行并行计算任务。每个CUDA核心可以执行单个线程的指令,包括算术运算、逻辑操作和内存访问等。

2023-09-27 09:38:48 3969

3969

对比AMD从2013年开始建设GPU生态,近10年时间后用于通用计算的ROCm开放式软件平台才逐步有影响力,且还是在兼容CUDA的基础上。因此我们认为国内厂商在软件和生态层面与英伟达CUDA生态的差距较计算性能更为明显。

2024-01-14 10:06:24 502

502

神经网络能加速的有很多,当然使用硬件加速是最可观的了,而目前除了专用的NPU(神经网络加速单元),就属于GPU对神经网络加速效果最好了

2024-03-05 10:26:54 183

183

CPU 和 GPU 的显著区别是:一个典型的 CPU 拥有少数几个快速的计算核心,而一个典型的 GPU 拥有几百到几千个不那么快速的计算核心。

2024-03-21 10:15:53 97

97

电子发烧友App

电子发烧友App

评论