4 集群机器学习

4.1 弱可学习定理

1990 年, Schapire 证明了一个有趣的定理: 如果一个概念是弱可学习的, 充要条件是它是强可学习的。这个定理的证明是构造性的, 证明过程暗示了弱分类器的思想。所谓弱分类器就是比随机猜想稍好的分类器, 这意味着, 如果我们可以设计这样一组弱分类器, 并将它们集群起来, 就可以成为一个强分类器, 这就是集群机器学习。由于弱分类器包含“比随机猜想稍好”的条件, 从而, 避免了对Madaline 平凡解的批评。另外, 由于Schapire 定理的证明基于PAC的弱可学习理论, 因此, 这种方法又具有泛化理论的支持。这样, 自Widrow 提出Madaline近30 年之后, 人们终于获得了基于Hebb 路线下的机器学习算法设计的理论基础。这个学习理念立即获得人们的广泛关注, 其原因不言自明,弱分类器的设计总比强分类器设计容易, 特别是对线性不可分问题更是如此。由此,Madaline 与感知机一样, 成为机器学习最重要的经典。

4.2 经典算法

Boosting 是一种用来提高学习算法准确度的方法, 这种方法通过构造一个预测函数系列, 然后以一定的方式将它们组合成一个预测函数, 达到把一弱学习算法提升为强学习算法的目的。1989 年Schapire 提出了第一个可证明的多项式时间Boosting 算法, 对这个问题作出了肯定的回答。一年后,Freund 设计了一个高效得多的通过重取样或过滤运作的Boosting- by-Majority 算法。这个算法尽管在某种意义上是优化的, 但却有一些实践上的缺陷。1995 年Freund 和Schapire介绍了通过调整权重而运作的AdaBoost 算法解决了早期Boosting算法很多实践上的困难。

AdaBoost 是Boosting 家族中的基础算法。Boosting家族中的大部分扩展( 算法) 都由它得来,对AdaBoost 的分析结论也适用于其它的Boosting。下面简要地介绍一下它的思想。

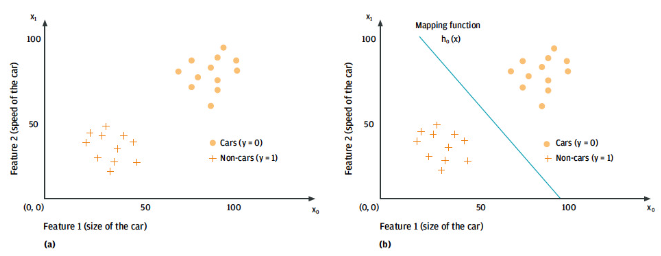

AdaBoost 算法的主要思想是给定一弱学习算法和训练集( x1, y1) , , , ( xn, yn ) 。这里xi 为一向量, yi 对于分类问题为一类别标志, 对于回归问题为一数值。初始化时对每一个训练例赋相等的权重1/ n , 然后用该学习算法对训练集训练t 轮, 每次训练后, 对训练失败的训练例赋以较大的权重, 也就是让学习算法在后续的学习中集中对比较难的训练例进行学习, 从而得到一个预测函数序列h1, , , ht ,其中hj 也有一定的权重, 预测效果好的预测函数权重较大, 反之较小。最终的预测函数H 对分类问题采用有权重的投票方式, 对回归问题采用加权平均的方法对新示例进行判别。

Boosting 算法是一种基于其他机器学习算法之上的用来提高算法精度和性能的方法。当用于回归分析时, 不需要构造一个拟合精度高、预测能力好的回归算法, 只要一个效果只比随机猜测略好的粗糙算法即可, 称之为基础算法。通过不断地调用这个基础算法就可以获得一个拟合和预测误差都相当好的组合回归模型。Boosting 算法可以应用于任何的基础回归算法, 无论是线性回归、神经网络、还是SVM 方法, 都可以有效地提高精度。因此, Boosting可以被视为一种通用的增强基础算法性能的回归分析算法。

Bagging(Bootstrap Aggregating) 又被称为自举聚合, 是Breiman 提出的与Boosting 相似的技术。[ 11]Bagging 技术的主要思想是给定一弱学习算法和一训练集( x 1, y1), , ( xn , yn ) 。让该学习算法训练多轮, 每轮的训练集由从初始的训练集中随机取出的n 个训练例组成, 初始训练例在某轮训练集中可以出现多次或根本不出现。训练之后可得到一个预测函数序列: h1, , , ht , 最终的预测函数H 对分类问题采用投票方式, 对回归问题采用简单平均。

Bagging 与Boosting 的区别在于Bagging 的训练集的选择是随机的, 各轮训练集之间相互独立, 而Boosting的训练集的选择不是独立的, 各轮训练集的选择与前面各轮的学习结果有关; Bagging 的各个预测函数没有权重, 可以并行生成, 而Boosting 是有权重的, 只能依次顺序生成; Boosting 往往从一些弱的学习器开始, 组合形成一个集成学习器, 从而给出一个好的学习结果, 而Bagging学习效果的好坏往往取决于集成学习器中每个学习器的相关性和各个学习器的学习效果。对于神经网络这类极为耗时的学习方法, Bagging 可通过并行训练节省大量时间开销。

5 符号机器学习

自1969 年Minsky 出版Perceptron(《感知机》)一书以后, 感知机的研究方向被终止,到1986 年Rumelhart 等发表BP 算法, 近20 年间, 机器学习研究者在做什么事情呢? 这段时间正是基于符号处理的人工智能的黄金时期, 由于专家系统研究的推动, 符号机器学习得到发展, 事实上, 这类研究方法除了建立在符号的基础上之外, 从学习的机理来看, 如果将学习结果考虑为规则, 每个规则将是一个分类器, 尽管这些分类器中有些不一定满足弱分类器的条件, 但是, 它应该是Hebb 路线的延续。

符号机器学习的最大优点是归纳的解答与归纳的过程是可解释的, 换句话说, 数据集合中的每个观测(样本或对象)对用户都是透明的, 它在解答以及计算过程中所扮演的角色, 用户都是可以显现了解的。然而, 它的缺陷同样突出, 就是泛化能力。由于学习结果是符号表述, 因此, 只可能取“真”与“假”, 这样大大减低了对具有一定噪音数据的分析能力, 需要其他技术来补充: 其一, 观测世界的数据到符号域的映射, 其二, 不确定推理机制。但是, 这两种方法与符号机器学习方法本身并没有必然的关系。

近几年, 由于数据挖掘的提出, 符号机器学习原理有了新的用途, 这就是符号数据分析, 在数据挖掘中称为数据描述, 以便与数据预测类型的任务相区别(从任务来说, 这类任务与机器学习是一致的)。

与机器学习的目标不同, 数据分析不是以所有用户具有相同需求为假设, 相反, 强调不同用户具有不同的需求。另外, 数据分析强调, 分析结果是为用户提供可阅读的参考文本, 决策将依赖人的洞察。如何根据用户的特定需求将观测数据集合变换为简洁的、可为用户理解的表示成为关键。这是符号机器学习的另一个可以考虑的应用领域。由于符号机器学习在泛化能力上的欠缺, 这也是它在与基于统计的机器学习方法竞争中避免遭到淘汰的出路。

6 增强机器学习方法

增强机器学习( reinfo rcementlearning )的本质是对变化的环境的适应。应该说,这是一种“古老”的机器学习思想.在1948年, Wiener的著作“控制论”中,就讨论了这个问题,而在以后的控制理论的研究中,这发展成为重要的研究课题—— 自适应控制。由于控制理论研究这个问题的焦点在于控制品质,且其使用的数学工具是微分方程,因此,对非线性问题,使用计算机进行数值求解存在着本质性的困难。这是这类机器学习长期未得到计算机科学家注意的原因。

直到20世纪70年代, Holland在讨论进化计算时,需要考虑控制物种群体的染色体数量,以便淘汰对变化环境不适应的个体,为此,提出使用桶队算法解决这个问题。桶队算法在Holland提出的分类器系统中扮演着对变换环境适应的角色。

以后,在20世纪90年代初, Sutton提出将这类机器学习建立在Markov 过程上,并称其为增强机器学习方法。这个方法是根据环境变化对系统的刺激,并作为系统输入,然后,利用基于统计的方法优化转移概率,并使系统适应新的环境。

一般地说,增强机器学习应该属于无教师学习,但是,如果考虑环境就是教师,这类机器学习也可以认为是一类特殊有教师的机器学习,与一般有教师机器学习的区别在于: 教师是环境,且是变化的环境。这意味着,不像传统意义下的有教师学习,教师教授的知识不是事先给定的,而是采用更灵活方法,在问题求解的过程中获得的。

7 总结

本文从机器学习的起源,发展依据,历史上的重要事件角度讨论了机器学习发展脉络。通过“对神经细胞模型假设的差别”将机器学习领域划分为两大支系——强调模型的整体性,基于Barlow“表征客体的单一细胞论”的Barlow路线;强调对世界的表征需要多个神经细胞集群,基于Hebb“表征客体的多细胞论”的Hebb路线。这一划分可以清晰地将机器学习发展历程总结为:以感知机、BP与SVM等为一类的Barlow路线;以样条理论、k-紧邻、Madaline、符号机器学习,集群机器学习与流行机器学习等为一类的Hebb路线。

其中,又重点关注了目前发展良好的统计机器学习与集群学习。讨论了SVM与神经网络的关系与优缺点,以及将弱学习算法提升为强学习算法的Boosting算法。

本文提倡研究者需要重视这样一个问题:我们探讨机器学习在理念、理论、与技术上发展的各种方法所遵循的假设,是否能够适应当前任务的需要?如果问题是否定的,那么,我们是修补这些已被普遍认可的理念、理论与方法(打补丁),以适应当前的需要,还是从根本上清理原有假设,提出新的假设,从而发展新的理念、理论和方法?这是一个需要仔细分析已有理论与方法,并权衡各种利弊才能决定的事情。综上所述,讨论机器学习发展脉络,以从这个脉络发现有趣的经验和教训,对回答这个问题是重要的,这必须考虑机器学习发展的科学依据,历史上的重要事件,以及理论研究中的重要结论。这就是我们本文的讨论集中在动机和理论的原因。

电子发烧友App

电子发烧友App

评论