杨强教授认为,DeepMind把端到端的深度学习应用在强化学习上,使得强化学习能够应付大数据,因此能在围棋上把人类完全击倒,它做到这样是通过完全的自学习、自我修炼、自我改正,然后一个一个迭代。杨强还指出,搜索和学习的结合才是人工智能的发展方向。我们不能完全依靠机器去全部自动化自我学习,机器学习的弊端是自我偏差,目前仍需要人为干预。未来,迁移学习会是这个问题的解决途径。迁移学习还能让人工智能得以摆脱对大数据的严重依赖,从而让人工智能不再只是“富人的游戏”。

“2016全球人工智能技术大会(GAITC)暨人工智能60年纪念活动启动仪式”4月22日在北京国家会议中心举行,杨强教授受邀发表主旨演讲,他的演讲题目是《 自学习的人工智能》。经过主办方中国人工智能学会和杨强教授的授权,新智元带来了杨强教授此次演讲的全文实录和ppt,干货满满,推荐收藏。

首先大家都知道,在60周年之际,我们首先应该记住的是这位人工智能的先驱——图灵。在他的问题的感召下,我们才有了今天这样的一个盛会和今天人工智能的飞速发展。他的问题“机器可以思维吗?”可以从不同的维度来解释,那么首先人类对人工智能的探索也可以围绕对[这个]问题的不同解释展开。

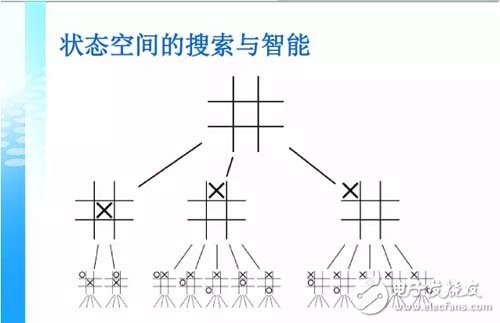

第一个探索,应该说是在逻辑层面的探索。[20世纪]60年代,人工智能的这些先驱就考虑用逻辑和搜索来研究人工智能,比如下棋、推理、去做路径规划等等。他们有一个很强的假设,这个假设从某种程度上来说是非常直观的:智能包括计算机可能赋予的智能,来自于计算物理符号的排列组合。我们只要能很聪明地把这些物理符号排列组合,人类是可以从一系列的零和一的组合来得到[智能的]。[但是]有了一些成就之后,[我们]也发现这样的假设是有瓶颈的。

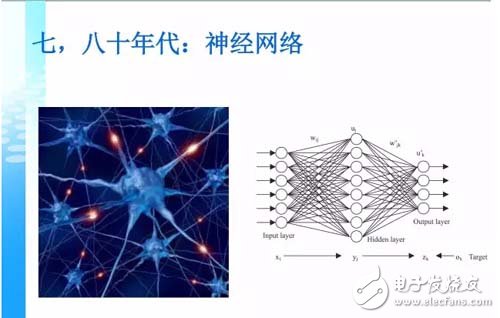

在之后又有一部分人着力于研究能够有学习功能的人工智能,就有不同的机器学习算法被研究出来。其中包括大家都熟悉的神经网络。

人工智能的几个里程碑我们现在也很熟悉,第一个大家公认的是里程碑是深蓝,这个比赛意味着几件事:一个是说在大规模的搜索状态下,在可能的状态空间的搜索实际上是一个在物理符号空间的排列组合。

也就是说,[20世纪]60年代人们的那些假设有一部分是正确的,我们确实可以从这种搜索和物理符号的排列组合获得很多的智能。

紧接着的阶段是,知识就是力量,这是随着互联网和大数据到来的一个热潮,从网上,从不同的媒体我们会获得很多数据,把这些数据经过沉淀变成知识,我们就可以赢得像这样一个电视大赛中的人机对战。

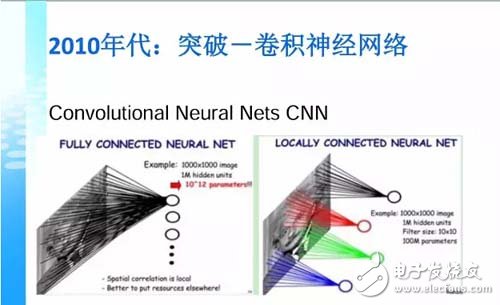

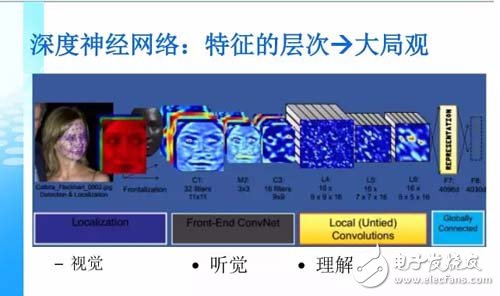

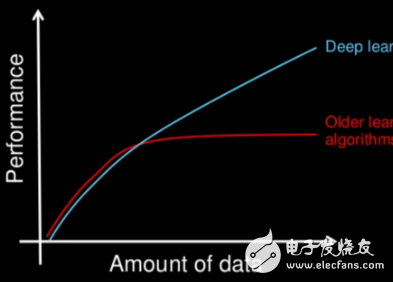

这个之后,就是深度神经网络。深度神经网络的突破从计算上来说有几个好处,其中一个好处是说它把一个全局计算的需求变成一个本地计算的需求,在做到这一点的同时,又不失掉很多的信息,这个是计算机里面无数成就的一个中心点。这样的一个成功就使得我们能够在不同的层次来观察同一个数据,同样就可以获得我们所谓的大局观。就像这个图,我们在不同的层次可以得到不同的特征。

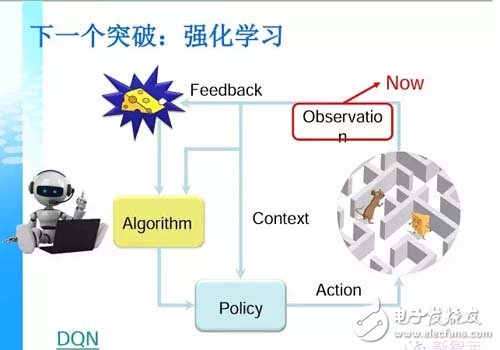

这里我们要特别强调的是人工智能也在另外一个方面默默在耕耘,这个就叫做强化学习。强化学习应该说是用来做人工智能规划的有力工具,但不是唯一的工具。这个领域相对深度学习应该说更古老,研究的力度也很多。但在很长时间处于静默状态,这个原因是因为它在计算上有很大的瓶颈,不能有很大的数据量。一个例子就是强化学习在很长时间以来只能解决一些玩具型的问题,非常小的数据。

但是,最近的一个突破是Google的DeepMind,把深度学习和强化学习合在一起,这样的一个议题使得很多强化学习所需要突破的瓶颈,就是状态的个数能隐藏起来。这种隐藏就使得强化学习能够大规模应付数据,也即应付大数据。它突出的一点叫做端到端的学习,就是说我们在这里看到一个计算机的游戏,这个游戏的影像是输入端,输出端就是你要进行的下一个动作。这个动作是正确还是不正确,到最后会获得一个反馈,这个反馈不一定是现在得到,也许是后面几步得到的。这一点和我们刚刚讲的深度学习在图像上面的应用,就大不一样。就更加复杂,更加契合人的行为,所以强化学习也是下一个突破。

我们看到这种端到端的深度学习,应用在强化学习上,使得DeepMind到今天在很古老的单人计算机游戏上已经把人类完全击倒,它做到这样是通过完全的自学习、自我修炼、自我改正,然后一个一个迭代。

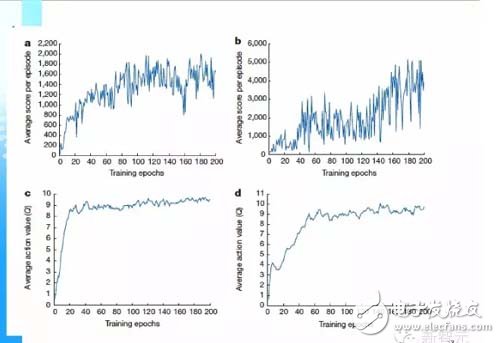

这个就是它迭代的一些结果,从左到右是一个时间轴,从下到上是它得到的效果。我们看到每一个游戏它的要求都是在不断成长的,就像我们一个学生在学习的过程当中学到的知识越来越多,这个完全是自我实现,一个自学习的过程。

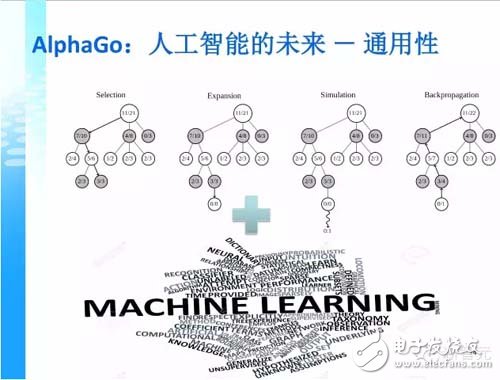

包括现在的AlphaGo也应用了很多自学习的这种效果,使得我们现在终于认清原来人工智能从[20世纪]60年代到2000年的物理符号的假设,也就是说以搜索为中心,以逻辑为中心的这种努力并没有白费,这种努力也是需要的。另外学习也是必不可少的,像我们熟知的深度学习。所以AlphaGo对我们的启示,就是我们把[搜索和学习]两者结合起来,才是一个完整的智能机器。这个我们可以叫做人工智能的通用性,也就是说我们对于这两个技术的某种结合,比方说多一点搜索,少一点机器学习,或者反之我们就可以得到用来解释不同的人类的智能行为。

这种通用型,端到端的学习,可以用这个例子来表达:鸡可以吃不同的东西,但是它下的都是蛋,是对人类有用的。

这里我要特别提到一点,我们并不是找到了最后的目标,这也是在不同的人工智能、强化学习等等之类的实验当中我们发现一个特点,就是我们不能完全依靠机器去全部自动化自我学习,至少到现在我们还没有摸索出这样一个路径。这里是CMU大学的例子,用中文来说是永动机器学习,这个机器不断在网上扒一些网页,在每个网页里面都学到一些知识,把这些知识综合起来,变成几千万条知识,这些知识又会衍生新的知识。那么我们看到从下到上是随着时间,知识量在增长。但是它到了某一个程度实际上是不能再往上走了,因为知识会自我矛盾。这个时候就需要人来进行一部分的调节,把一部分不正确的知识去掉,让它继续能成长。这个过程为什么会发生呢?

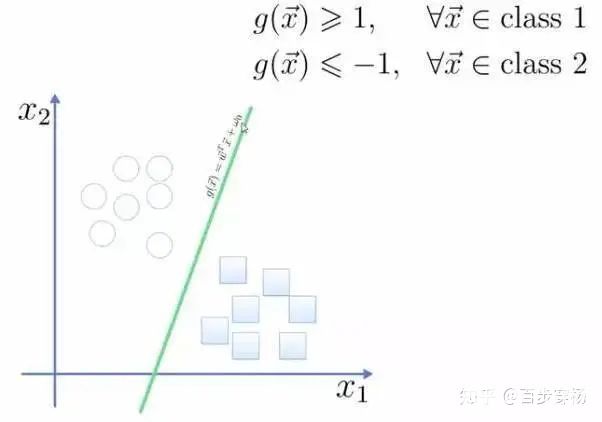

是因为机器学习有一个很严重的现象,就是自我偏差,这种偏差可以体现在统计学的一个重要概念中,就是我们获得的数据也许是一个有偏数据,我们可能建了一个模型,对大部分的数据都有用,但其中有一些特例。我们如何来处理这些特例,如何来处理我们训练数据和应用数据之间的偏差,这是我们下一步要研究的内容。

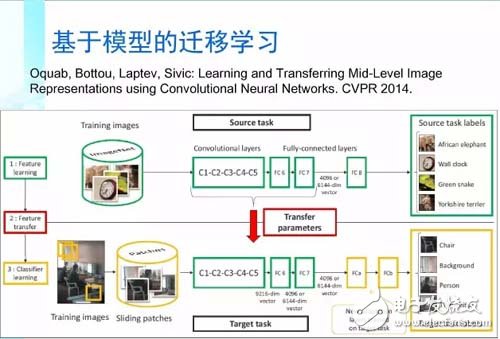

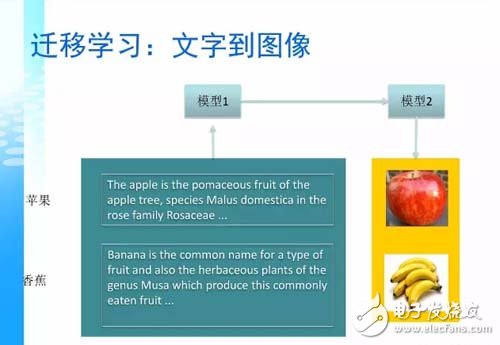

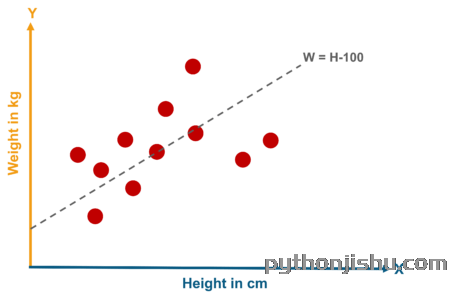

一个非常有希望的技术叫做迁移学习,比方说这个是在深度学习的模型上,在上面这一部分是一个领域已经训练好的模型。那么在一个新的领域,如果这两个领域之间有某种联系、某种相似性的话,我们就不一定在新的领域需要那么多的数据来学习,你只需要一小部分。我们之所以能做到这一点是因为我们可以把大部分的模型给迁移过来,人有这种能力,但是我们在做这种数据迁移的过程中,我们一定要牢记把这种有偏的数据偏差给消除掉。

如果能做到这点,我们就能做到不同形式的数据之间的知识迁移,比方说我们可以让一个计算机来读很多文字,这样的一个计算机去识别图像,应该比没有读这些文字,直接去学习图像的计算机要容易。这个就更像我们人类的学习。这种学习也离不开从下到上,从粗到细这样的一种特征选择。

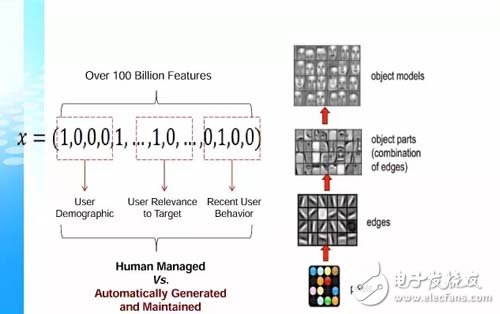

所以我们又得到另外一个概念,就是特征工程。深度学习给我们的一个有力工具是能够自动进行不同层次、大规模的新特征的抽取和制造。那么这种特征在搜索引擎、广告系统上面可以达到万亿级,这个已经完全不是人类所可以控制的级别了。智能在这样的级别上才可以产生。

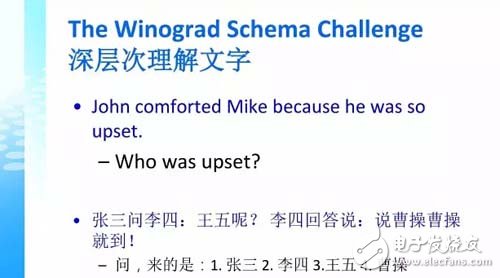

但是,现在人工智能仍然有一些困境,比方说如何能够让人工智能来深层理解文字,有一个著名的类似于图灵测试的比赛,深层次理解文字,在自然语言上问一些有歧异的问题,计算机如果要能正确的回答这个问题,那个模型就不仅仅要理解这些文字,而且要理解深层的背景文字,要理解周边的文字。有很多文化在里面,如何能达到这一点?这也是我们需要解决的。

同时深度模型还可以把它反转,成为一种生成模型。它不仅可以去对数据做一个决策,它还可以自己产生新的数据。比方说这个是Google的一些研究员把一个深层模型里面的感知最深刻的那些图像给描述出来,结果是这样非常有趣的生成模型。

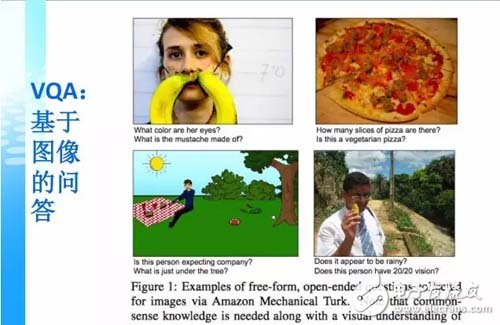

刚刚讲的不同数字格式,文字和图像,如果在深层实际上它们的区别已经消失了。那这样我们就可以对图像去问文字的问题,甚至对文字去问图像的问题。这样数据的形式也就不重要了。

如果我们达到了迁移学习的要点,我们想问下一步是不是可以把所有人类经历过的这些学习任务给沿着时间轴串起来,能够让机器像人一样,学习能力和智能随时间在不断增长。那么它所需要学习的努力程度,样本数也是逐渐减少的。这也是我们在努力的一个方向。

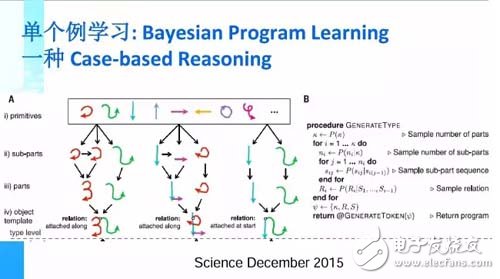

最近发表的一篇文章也说明了迁移学习的重要性。这篇文章叫做 bayesian program learning(单个例学习),这是从一个例子就能学会,我们知道深度学习是有千万个例子的。实际上它用了我们过去没有涉及到的概念,就叫做结构,如果我们了解了一个问题的结构,那么这个结构的一个具体形式只用一个例子就可以学会了。其他的部分,需要很多例子的那一部分可能是参数、统计,这一部分我们实际上可以通过迁移学习来学习。也就是说这个圆就圆满了,就是一个闭环了。

同时,人工智能的应用也不仅仅是在图像方面。这里的一个例子是亚马逊的仓储机器人。亚马逊的仓储机器人是在一个很大的空间[运行],这些机器人会移动这些货架,每个货架上面都有不同的货品,把这些货架送到工人的面前,让工人从货架上面拿所需的货品到箱子里面,然后快递给客户。为什么是这样呢?因为现在的机器人技术在选择,也就是从货架上选择物体还远远达不到人的熟练程度,但是它在路径规划、机械的启动、抬起、放下已经超过人了。所以,亚马逊就很聪明地把机器的优点和人的优点结合在一起,变成一个新的商业模式。如果过去建一个仓储支持这个城市所有的物流需要三个月时间,亚马逊把所有的传送带拆掉,变成机器人以后只用三天时间,这个收益是非常巨大的,也是我们可以借鉴,可以拓展的一个经验。

下面要讲的,不仅在机器人,在图像识别,在我们的生活当中,人工智能已经十分深入了。这里举的一个例子是我和我的学生戴文渊建的一个公司——第四范式,这个公司可以让过去在金融领域只能由人来服务的重要客户,改为由人工智能来做,把这个能力拓展到几千万人身上,让每个人都能享受到优质的金融服务。这是一个非常大的工程,它背后的技术就是机器学习,我们所熟知的深度学习、知识学习、强化学习。

最后我要说几点,看到这么多人工智能的努力,有失败的时候,有成功的时候,我们到现在能总结出什么经验呢?我觉得现在的人工智能的成功离不开高质量的大数据,但是并不是未来人工智能的成功一定需要大数据。那么我们下面要问是不是在未来有小数据也可以让人工智能成功——工业上大家还在开疆拓土,利用大数据的优势在发现新的应用——我觉得在大学里面这是应该做的一个研究。

第二个,就是要培养出更多的人工智能人才。这些人才才可以来设计算法,这个也是我们今天在大学里面需要努力的一个方向。当然这些都离不开计算能力。

所以从这几点上来看,人工智能的努力也不是像有些人说的“今天的人工智能的发展完全在工业”,人工智能的发展应该一部分依靠大学,一部分依靠工业。就像我们所说的,大数据和人才的培养以及小数据的研究。大数据开疆拓土、更多的应用和更多的计算能力确实来自于工业。人才培养、小数据研究则依靠学界。这两者结合是我们今后发展的一个方向。

最后我要说一点,我们应该说已经了解很多深度学习了,这个可以作为我们昨天的一个成就。那么今天我们在刚刚开始去获得强化学习的一个红利,这个可能还不是在很多的领域得到应用,但是我要告诉大家,强化学习比大家想象的要更有用,它不仅仅是在围棋或者是在计算机游戏上有用。在金融、在我们日常生活当中,甚至在教育上,机器人的规划都离不开强化学习。

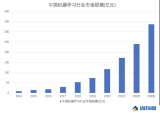

那么这些应该说都是富人的游戏,也就是说只有富人才能有这么多的大数据,有这么多的计算量去支持深度学习和强化学习这样的实际应用。那么我们明天要看到的应该是迁移学习,因为迁移学习能够让我们把大数据得到的模型迁移到小数据上面,使得千千万万的人都能够受益,人人都能享受人工智能带来的红利。

电子发烧友App

电子发烧友App

评论