1.1、 自动驾驶算法是感知、预测、规划、控制的结合体

自动驾驶算法反应了工程师们根据人的思维模式,对自动驾驶所需处理过程的 思考。通常包含感知、预测、规划模块,同时辅助一些地图、定位等模块,实现自 动驾驶功能的落地。

1.1.1、 感知:感知外部世界

感知模块主要解决四类任务:(1)检测:找出物体在环境中的位置;(2)分类: 明确对象是什么,如分辨不同类别交通标志;(3)跟踪:随着时间的推移观察移动 物体,通常采用跨帧追踪对象(将不同帧中检测到的对象进行匹配)、BEV 加入时序 信息等实现;(4)语义分割:将图像中的每个像素与语义类别匹配,如道路、天空、 汽车等,用于尽可能详细了解环境。 以 Apollo 感知算法框架为例,其算法包含预处理、神经网络模型、后处理等模 块。首先图像预处理主要是对图像进行调整、畸变校正等,使之更符合机器学习的 要求。其次分别对红绿灯、车道线、障碍物等特征进行检测,其中红绿灯通过检测 边框、颜色等进行进一步的识别;障碍物则经过 2D 到 3D 的转换,得出真实的信息 坐标,再融合车道线检测信息、外部传感器信息等得出真实世界的障碍物信息。该 部分通常采用全卷积神经网络或者 YOLO 等算法实现。

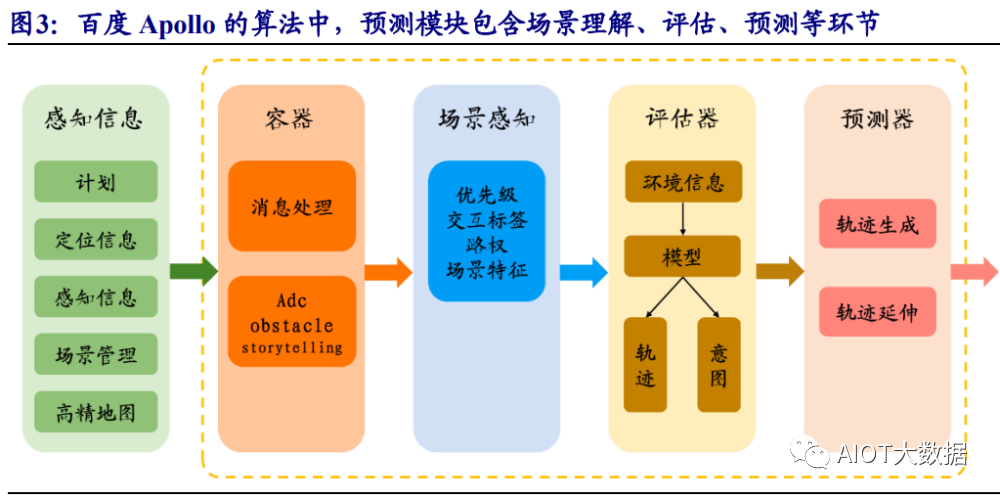

1.1.2、 预测:理解外部环境和当前状态

预测模块实际上是算法对外部环境和自车状态的理解。预测模块首先收集感知 模块输入的车道线、障碍物、红绿灯、地图、定位等信息对主车的状况进行判断。 其次场景感知模块对外部障碍物的优先级、路权等外部环境对主车的影响进行感知。 评估器则会根据场景信息和障碍物信息判断出障碍物的轨迹或意图。预测器则根据 短期的预测轨迹和意图判断障碍物等外部环境相对长期的轨迹。这将为未来汽车的 规划提供重要的参考。算法层面通常以 RNN 为主。

1.1.3、 规划:思考如何行动

规划指找到合理路径来到达目的地。规划通常分为全局路径规划、行为规划与 运动规划几个部分。其中,全局路径规划指智能汽车依靠地图规划出理想状态下到 达目的地的路径。行为规划则是主车在实际行驶的过程中,面临实时的交通环境, 做出的各类驾驶行为,如跟车、换道、避让等。运动规划生成与驾驶行为对应的驾 驶轨迹,包含路径规划和速度规划。最后再采用一些优化方式让变道加速等行为变 得平顺以满足舒适性要求。算法层面,通常采用基于规则的规划决策算法,前沿的 玩家也开始引入机器学习等方式,以提升决策效能。

1.2、 数据:算法的养料,现实与虚拟的交织

算法、算力和数据是人工智能的三大要素,数据在模型训练中拥有不可忽视的 影响。一方面,Transformer 等大模型在大体量数据集训练下才能表现更佳的特性带 来其对训练端数据的要求激增,特斯拉在 2022 年 AI DAY 上曾表示,训练其占用网 络采用了 14 亿帧图像数据。另一方面,由于自动驾驶面临的场景纷繁复杂,诸多长 尾问题需要在现实或虚拟场景中获取。因此数据闭环在自动驾驶领域弥足重要。毫 末智行将数据作为“自动驾驶能力函数”的自变量,认为是决定能力发展的关键, Momenta 也曾表示,L4 要实现规模化,至少要做到人类司机的安全水平,最好比人 类司机水平高一个数量级,因此需要至少千亿公里的测试,解决百万长尾问题。

数据挖掘和针对性的训练能显著减少 Corner Case。以特斯拉为例,在面临一个 看起来像临时停车但实际上是永久停车的场景时,最初算法会将其判定为临时停车。 当特斯拉通过数据挖掘在训练集中增加了 1.4 万个类似场景的视频并训练模型后,神 经网络便理解了这辆车里面没有司机,将其判别为永久停车。

2、 大模型横空出世,自动驾驶奇点来临

早期自动驾驶方案采用激光雷达+高精度地图为主。早期市场以传统计算机视觉 和专家系统为基础构建辅助驾驶功能,随后人工智能的蓬勃发展让深度学习在自动 驾驶领域被广泛使用,以 waymo 为代表的自动驾驶先驱玩家开创了激光雷达+高精 度地图的感知范式,Cruise、百度等巨头纷纷效仿。该方案中,对道路结构、车道线 等静态环境元素的感知强依赖高精度地图,而实时的动静态障碍物信息则强依赖激 光雷达。高精地图成为一项“基础设施”,将很多在线难以解决的问题提前存储到地 图数据中,行车时作为一项重要的感知数据来源,减轻传感器和控制器的压力。由 于该方案只能在有图地区行驶,也被一些人形象的称为“有轨电车”。

高昂的单车成本和高精度地图成为自动驾驶大规模推广瓶颈。Robotaxi 成本高 昂(Yole 统计早期 Waymo 为代表的的自动驾驶汽车改装成本约为 20 万美元),高精 度地图采集制作以及合规要求繁杂(量产落地过程中,高精度地图面临:采集成本 高;人工修图制图费时费力;地图鲜度不足;国内法规严格等困难),带来该方案的 泛化性较差。经过数十年的发展,Robotaxi 的使用范围仍被限制在特定区域,使用 对象也仅局限在商用车领域。市场亟待出现一种单车性能强大、成本低廉的自动驾 驶解决方案。

2.1、 BEV+Transformer 横空出世,大模型推动自动驾驶迈向普及

2021 年特斯拉推出 BEV+transformer、重感知轻地图的自动驾驶解决方案,开启 了自动驾驶行业新的篇章。

2.1.1、 BEV 感知助力成为感知外部世界标准范式

BEV 全称为 Bird’s Eye-View(鸟瞰图),即通过神经网络将各个摄像头和传感器 获取的信息进行融合,生成基于俯视的“上帝视角”的鸟瞰图,同时加入时序信息, 动态的对周边环境进行感知输出,便于后续预测规划模块使用。正如人类一样,驾 驶行为需要将各处观察到的信息综合到统一的空间中,来判别什么地方是可以行驶 的区域。究其原因,驾驶行为是在 3D 空间中的行为,而鸟瞰图则是将 2D 的透视空 间图像转换为 3D 空间,不存在距离尺度问题和遮挡问题,使得算法可以直观的判断 车辆在空间中的位置以及与其他障碍物之间的关系。

2.1.2、 Transformer 大模型为构建 BEV 空间提供最优解

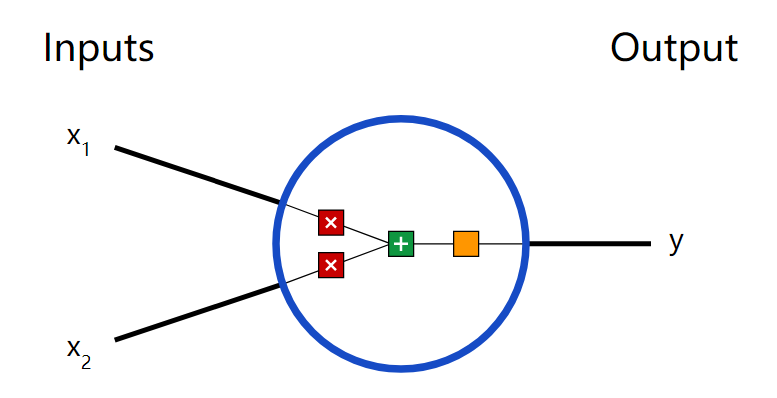

2021 年特斯拉在 AI Day 上第一次将 BEV+transformer 的算法形式引入到自动 驾驶,开启了自动驾驶的崭新时代。首先 BEV 空间的构建,实际上就是寻找一种恰 当的方式,将多个 2D 的图像和传感器信息综合转化成为一个 3D 的向量空间。经过 多次尝试,特斯拉最终引入了 Transformer 大模型来实现这一转换。 Transformer 大模型是近年人工智能领域的热门算法,其主要通过注意力机制来 分析关注元素之间的关系进而理解外部世界。早年被应用于自然语言处理领域,后 续延展到计算机视觉等多个方向。算法的优势显著:

具有更好的全局信息感知能力:Transformer 模型更关注图像特征之间的关 系,因此会跟多关注整个图像的信息,卷积神经网络更多关注固定大小区 域的局部信息,因此 Transformer 在面对图像中长程依赖性的问题拥有更好 的表现。

天花板高企适用于大规模数据训练场景:在图像识别能力方面,Transformer 拥有更高的上限,随着训练数据量的增长,传统 CNN 模型识别能力呈现饱 和态势,而 Transformer 则在数据量越大的情况下拥有更好的表现。而自动 驾驶洽洽为面向海量的数据场景,要求有足够好的精度的场景。

拥有多模态感知能力:Transformer 可实现多模态数据的处理,应对图像分 类、目标检测、图像分割功能,并实现对 3D 点云、图像等数据的融合处理。

灵活、较好的泛化性能:Transformer 可适用于不同大小的输入图像,同时 外部环境包含扰动的情况下仍能保持较好的检测性能。

但 CNN 网络在提取底层特征和视觉结构方面有比较大的优势,而在高层级的视 觉语义理解方面,需要判别这些特征和结构之间的如何关联而形成一个整体的物体, 采用 Transformer 更加自然和有效。同时 CNN 也拥有更好的效率,可以采用更低的 算力实现效果。因此业界通常会将 CNN 和 Transformer 结合来进行物体识别。

2.1.3、 特斯拉引领打开自动驾驶天花板

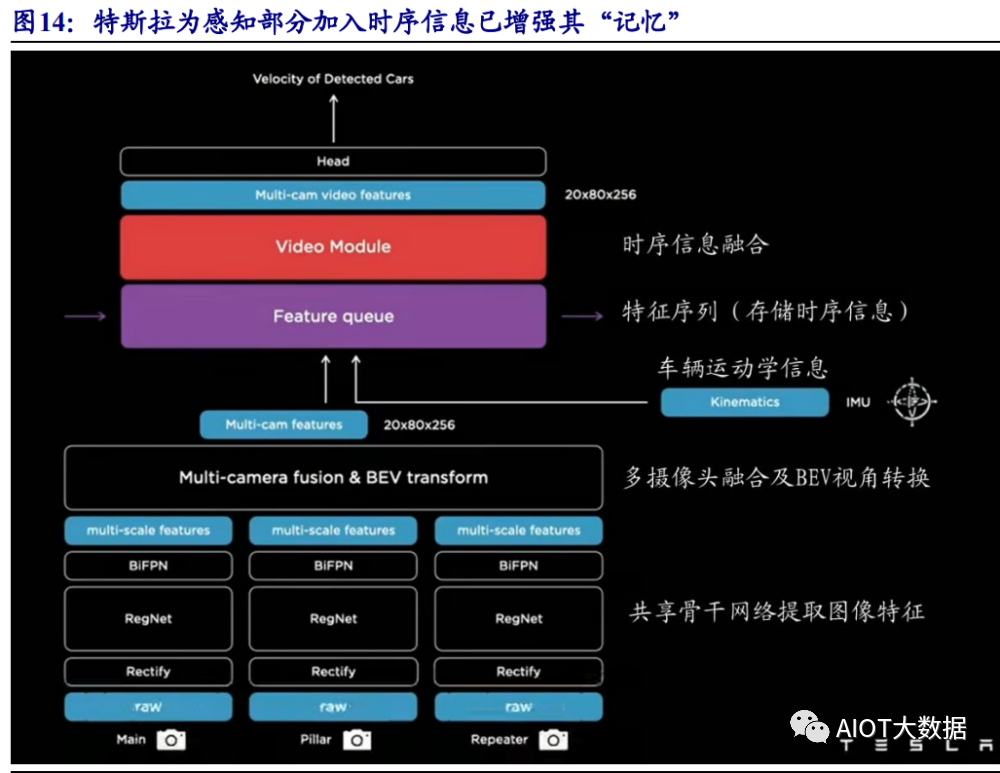

特斯拉的自动驾驶算法结构中,首先将摄像头信息无损采集,送入卷积神经网 络 Regnet 来提取不同尺度的图像特征,接着使用 BiFPN 进行特征融合,然后将这些 特征送入 Transformer 模块,利用 Transformer 中的多头注意力机制来实现 2D 图像特 征到三维向量空间的转换和多摄像头特征系信息的融合,之后接入不同的“头”如 交通标志检测、障碍物检测等,来实现不同任务的处落地,形成一套优雅的,可完 美实现数据驱动的感知算法。由于不同的“头”之间采用了共享的特征提取网络, 因此被特斯拉起名为“九头蛇”算法架构。

特斯拉的 BEV+Transformer 算法中两个环节尤为关键:

(1)2D 图像到 3D 空间的转换以及图像融合: 在 2D 图像到 3D 向量空间转换的环节,特斯拉在行业内首次引入了 Transformer。 具体而言,先构建一个想要输出的三维的栅格空间,并对其进行位置编码成为查询 向量(Query),然后将每个图像和自己的特征输出相应的查询键码(Key)和值(Value), 最终输入到注意力机制中输出想要的结果。类似于每个图像中的特征都广播自己是 什么物体的一部分,而每个输出空间的位置像素像拼图一样,寻找对应的特征,最 终构建出希望输出的向量空间。(Query、Key、Value 分别为 Transformer 算法中的参 数,通过将外部世界转化为参数而实现信息处理和任务输出)

(2)加入时序信息,让算法拥有“记忆”: 为了让自动驾驶算法拥有类似一段时间内“记忆”的能力,特斯拉在感知网络 架构中加入了时空序列特征层。通过引入惯性导航传感器获取的包含速度和加速度 等自车运动的信息,算法模型可获取时间和空间的记忆能力。具体而言,特斯拉给 算法加入特征队列模块(Feature Queue),他会缓存一些特征值(包含历史帧的 BEV 特征、惯导传感器信息等),便于了解车辆行动,这个序列包含时间和空间记忆。然 后引入视频模块(Video Module)使用空间循环神经网络(Spatial RNN)/transformer 等算法将前述缓存的特征进行融合,关联前后时刻信息,使得模型具有记忆能力, 让自动驾驶汽车将同时能够记住上一段时间和上一段位置的检测信息。

2.1.4、 BEV+Transformer 大模型提供远强于传统自动驾驶算法的感知能力

(1)改善 2D-3D 空间转换过程中深度预测难点,感知性能大幅提升

引入 BEV+Transformer 后,模型对于 2D 空间向 3D 空间转换的精度大幅提高。 构建 BEV 模型一大重要任务是实现 2D 图片到 3D 空间的转换,通常业内有四大类 方式实现 2D-3D 视角转换:早期通常以基于相机内外参数(焦距、光芯、俯仰角、 偏航角和地面高度)的几何变换的 IPM(逆透视变换)实现,由于该方式基于地面 纯平、俯仰角一定的假设,约束条件实现难度高;后续英伟达推出 BEV 行业的开山 之作LSS算法,但由于其计算量庞大以及精度仍然有限,难以支撑BEV的真正落地; 其后学界业界探索了众多方案,包含基于神经网络,通过监督学习数据驱动实现 BEV 空间构建等方式,但深度估计的精度均不尽人意。2021 年,特斯拉首次将 Transformer 应用于 BEV 空间的构建,在多摄像头视角下,相比传统感知方式,大幅提升了感知 精度,该方案推出后也迅速被业界广泛追捧。

(2)完美实现多摄像头、多传感器的信息融合,极大方便后续规控任务

BEV+Transformer 实际上引入“特征级融合”(中融合)方式。通常自动驾驶汽 车拥有 6-8 个摄像头以及其他多种传感器,在感知过程中,需要将各类传感器的信息 进行融合。传感器融合大体可分为几大类:

数据级融合(前融合):直接将传感器采集的数据如图像和点云融合。该方 案优势在于数据损失少,融合效果好,但时间同步、空间同步要求达到像 素级别,难度较高,需要对每个像素计算,对算力消耗大,目前少有使用。

目标级融合(后融合):将每个传感器采集信息并处理后的目标进行融合。 该方案是此前自动驾驶主流采用的方案,被广泛应用于摄像头之间、不同 传感器之间的信息融合。优势在于算法简单、解耦性好即插即用。但也存 在致命问题,由于融合前的处理损失了大量关键信息,影响感知精度,融 合结果容易冲突或错误。此外后融合中的融合算法仍然基于规则,无法进 行数据驱动,存在局限性。

特征级融合(中融合):则将原始传感器采集的数据经过特征提取后再将特 征向量进行融合。该方案的优势在于,数据损失少、将目标“分解”为特 征,更容易在不同相机和传感器之间关联,融合效果好。在 BEV+transformer 算法中实际上均采用中融合的方式。

以路过大型卡车场景为例,障碍物某个时刻在 5 个摄像头中同时出现,且每个 摄像头只能观察到车的某个部分。传统算法通常会分别在每个摄像头内完成检测, 再融合各摄像头的结果。通过部分信息识别出卡车整体的特征及其困难,且一旦完 成物体检测,相当于“脑补”了看不到的部分,误差较大拼接困难,经常会识别为 多个目标或漏检。而 BEV+Transformer 通过特征级融合,完美生成鸟瞰视角下的场 景,并且识别精度更高。

(3)更易融入时序信息,模型拥有“记忆”,避免遮挡等问题

感知算法中,时序融合能够大幅提升算法连续性,对障碍物的记忆可解决遮挡 问题,更好的感知速度信息,对于道路标志的记忆可提升驾驶安全和对汽车车辆行 为预测的准确度,增强算法的可靠性和精度。在 BEV+transformer 算法中,由于所有 的感知被统一到 3D 鸟瞰图空间,通过将不同时间和不同位置的特征关联可很容易的 实现时序信息的融合。如在面对遮挡场景时,带有时序信息的自动驾驶算法感知效 果远优于基于单帧图像感知的算法。同时也更便于下游的规划控制算法实现对障碍 物的追踪。

(4)汽车拥有实时建图能力,摆脱对高精度地图的依赖

BEV+Transformer 算法可在车端实时构建媲美高精地图的高精度局部地图,能够 在任意常规道路条件下,实现自动驾驶所需的静态场景深刻理解,然后以此为基础, 端到端的输出障碍物的轨迹和速度、车道线信息等,实现复杂场景下的自动驾驶应 用,而不需要依赖高精地图。使得算法的泛化性大幅提升,成本也大幅下降。

2.2、 占用网络提供 3D 世界感知,形成通用障碍物识别能力

占用网络构建通用障碍物感知体系,提升对未知物体感知效果。直接在矢量空 间产生统一的体积占用数据,对于车子周围任意的一个 3D 位置,它预测了该位置被 占用的概率,对每个位置它还会产生一定的语义信息比如路边、汽车、行人、或者路上的碎片等等,用不同的颜色标出,同时观测速度信息,形成“占用栅格”+“栅 格流(描述速度信息)”+弱语义的表达形式。对特斯拉而言,即将原有 Transformer 算法输出的 2DBEV+时序信息的向量空间增加高度信息,形成 3DBEV+时序信息的 4D 空间表达形式。网络在 FSD 上每 10ms 运行一次,即以 100FPS 的速度运行,模 型检测速度大幅提升。

占用网络优势显著:(1)其改变了神经网络算法先“认识”才能“识别”的特 性,形成了动静态物体统一的障碍物感知方式,可大幅减少 Corner case,提升安全 性。(2)摆脱检测框的约束,对不规则外形障碍物的感知能力大大增强。(3)对特 斯拉来说,通用障碍物感知能力可以复用到其他产品如机器人上,形成了统一的算 法框架。

占用网络的构建并非单独算法上得演进,而是体系能力的提升。3D 空间的距离 真值获取实际上较为困难,即使拥有激光雷达,其稀疏的点云信息仍然难以满足占 用网络的训练需求,而由于仿真环境中距离真值信息可以直接获取,因此占用网络 的构建几乎和强大的仿真场景构建相辅相成。

2.3、 规控算法由基于规则迈向基于神经网,大模型开始崭露头角

2.3.1、 人工智能逐步渗透进入规控算法

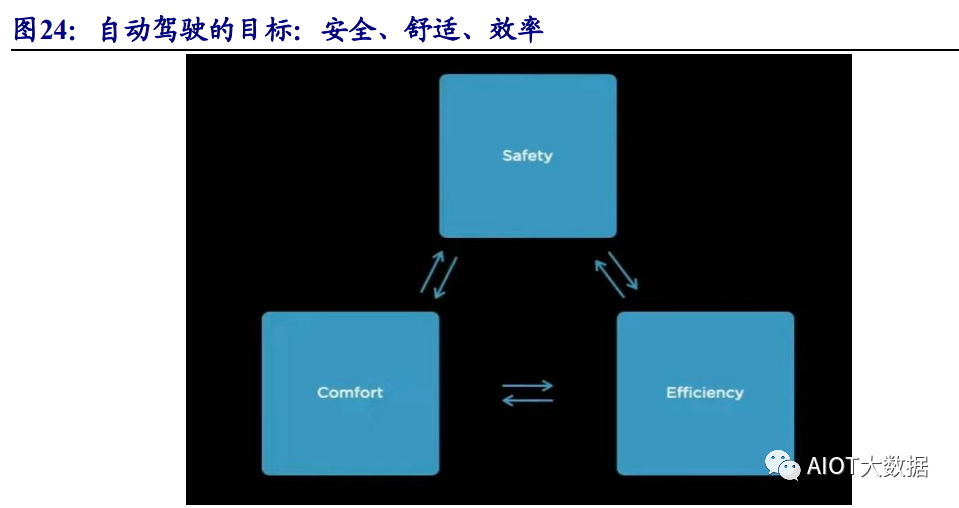

发力安全性、舒适性和效率,规控算法成为当前头部玩家主攻方向。人能够基 于非常有限的感知信息完美实现驾驶行为,很大程度因为人类拥有强大的“规控” 能力。对自动驾驶而言,采取一种让安全性、舒适性和效率都达到最大化的驾驶策 略无疑是各大厂商不懈追求的目标。而该环节也直接决定了自动驾驶功能的消费者 体验,目前头部玩家已经将主攻方向转移到规控算法领域。

“拟人化”、强泛化性,人工智能推动自动驾驶“老司机”上线。规控算法的难 度较高,存在诸多非确定(如辅路与干道没有绿化带隔离,辅路的车辆可随时进入 干道)、强交互(如多个物体在同一场环境下决策会相互影响,存在一定博弈性)、 强主观(如驾驶员的驾驶风格,很难用有限标准量化表示)的场景。同时涉及交通 法规等一系列问题。早年的算法通常采用基于专家知识和规则的模式为主,由于基 于规则的系统需要不断补充新的规则以实现对各类环境的良好应付,日积月累代码 量庞大,占用算力资源,且不易维护。因此依靠数据驱动的基于人工智能的规控算 法日益走向台前。面对复杂的外部环境,人工智能模型能够更加平滑的以“类人”的 方式对驾驶行为进行处理,泛化能力强、舒适性好,应对复杂场景的能力大幅提升。

兼顾“安全”和“性能”,神经网络和基于规则结合有望成为一段时期内规控算 法的主流。小鹏汽车自动驾驶负责人吴新宙曾表示,基于大数据和深度学习的算法 在规控领域的渗透会越来越深,预计未来整个框架都将基于深度学习为基础,但基 于规则的算法也会长期存在,因为规控算法的可解释性很重要。基于神经网络的规控算法有诸多优势,但目前如训练过程中数据的清洗、一致性;面向一些小场景特 定的算法调整;可解释性差等问题仍客观存在。因此诸多玩家目前仍采用以人工智 能和基于规则结合的方式来部署规控算法,制定一些规则来对人工智能产生的行为 进行兜底,实现较好的规控效果,未来随着人工智能能力的提升,规控算法人工智 能化已经成为大势所趋。 交互搜索+评估模型,特斯拉规控算法行止有效。在规控方面,特斯拉采用交互 搜索+评估模型的方式实现舒适、有效以及传统搜索算法和人工智能的结合的算法。 具体如下:(1)决策树生成:首先根据车道线、占用网络、障碍物等得到候选目标, 生成一些候选目标;(2)轨迹规划:通过传统搜索和神经网络的方式同步构建抵达 上述目标的轨迹;(3)交互决策:预测自车以及场景中其他参与者之间的相互作用, 形成新的轨迹,经过多次评估选择最后轨迹。在轨迹生成阶段,特斯拉采用了基于 传统搜索算法和基于神经网络两种形式,之后根据碰撞检查、舒适性分析、驾驶员 接管可能性和与人的相似程度等对生成的轨迹打分,决定走哪条路线。基于这种方 式有效的将道路参与者的博弈考虑在内,同时完美将基于规则和基于人工智能结合, 呈现出强大竞争力。

2.3.2、 大模型赋能,车道线预测等复杂任务得以实现

复杂道路的车道拓普结构识别难度较高。自动驾驶车辆在行驶过程中需要明确 自车的道路情况和车道线拓扑情况,以此来决定如何规划自己的行驶轨迹。但当车 道线模糊,或者十字路口等场景下,需要算法自己计算出车道线情况,来指导自身 的自动驾驶行为。我们看到一些玩家针对这样的场景做出了优化,来完美应对各类 突发情况,产业算法不断进化和成熟。

特斯拉采用训练语言模型的形式来训练车道线网络模型。车道线网络实际上是 嫁接在感知网络上的一个 Transformer 的解码器(Decoder)。参考自然语言处理任务 中的形式,让模型用自回归(综合上个环节的结果输出下个环节的内容)的方式输 出车道线的预测结果。具体而言,将车道线包含节点位置、节点属性(起点、终点、 中间点等)、分叉点、交叉点等进行编码,形成类似语言模型中单词的属性,输入 Transformer 解码器中,将信息转化成为“车道线语言”,去生成下个阶段的结果,进 而形成整个路网的车道线的拓扑结构。

理想汽车在理想家庭日上也展示了其用于增强路口性能的算法 NPN 神经先验 网络。为了解决大模型在十字路口不稳定的问题,对复杂路口,提前进行路口的特 征提取和存储,当车辆再次行驶到路口时刻,将过去提取好的特征和 BEV 感知大模 型融合,形成更加完美的感知结果。

2.4、 端到端(感知决策一体化):大模型为自动驾驶彻底实现带来希望

2.4.1、 回归自动驾驶第一性原理,端到端自动驾驶成为市场远期共识

模块化的自动驾驶算法设计存在诸多问题。前述文章中提到的感知、预测、规 划等环节的算法称为模块化算法设计,这些方案中每个模块独立负责单独的子任务, 这种方案具备简化研发团队分工,便于问题回溯,易于调试迭代等优点。但由于将 不同任务解耦,各个模块之间容易产生信息损失问题,且多个模块间优化目标不一 致,最后模块间产生的误差会在模型中传递。 端到端自动驾驶解决方案回归自动驾驶第一性原理。因此业界也一直在探索端 到端的自动驾驶算法形式,即设计一个算法模型,直接输入传感器感知的信息,输 出控制结果。端到端的自动驾驶算法拥有非常明显的优势:(1)其遵循了自动驾驶 的第一性原理:即无论感知、规划、决策模块如何设计,最终是为了实现更好的自 动驾驶效果,因此现有的方法聚焦单独某个模块的优化,对整体的效果提升未必有 效。(2)端到端的方式可避免极联误差,去掉冗余信息,提升视觉信息的表达。(3) 传统模块化的算法中需要面临模型之间的多个编解码环节,带来的计算的冗余浪费。 (4)规则驱动彻底转变为数据驱动,理想状态下让汽车自动驾驶模型训练变得简洁。

2.4.2、 工业界已经开启探索,迈向完全自动驾驶

目前全球无论学术界还是工业界均对该方案进行了不懈探索。如英伟达 2016 年 即提出端到端的自动驾驶解决方案,而 Uber 更多次发相关的论文探索有关算法。最新的 CVPR2023 上商汤、OpenDriveLab、地平线等联合发布的端到端的自动驾驶算 法 UniAD,获得了当年的最佳论文。其采用 Transformer 将感知、决策、规划、控制 模块都融入到一个模型中,端到端的处理自动驾驶问题,能够呈现出最佳的运行效 果。

目前英国初创公司 Wayve 亦致力于开发端到端的自动驾驶系统,致力于让汽车 通过自己的计算机视觉平台“自己看世界”,同时可以根据它所看到的东西做出自己 的决定。马斯克也曾在推特上表示,其 FSD V12 版本将是一个端到端的自动驾驶模 型。

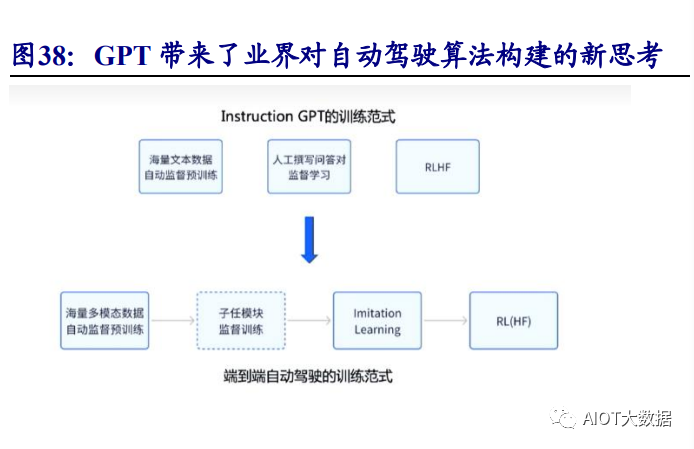

2.4.3、 大模型的思考,自动驾驶或许并非终点

通识知识和强泛化能力助力人类轻松学会驾驶。人类可以在短时间内学会驾驶, 但机器则需要海量的数据和训练。可能的原因在于人类在学习驾驶之前就已经充分 对整个世界有了全面的认知,并可以将这些认识泛化到各类场景下。如在学校附近 应该减速、遇到老人应当小心等,面对形状怪异的红绿灯人类几乎不加思考就可理 解其想表达的意思。通识知识,强泛化能力可以对自动驾驶行为产生重大帮助。 GPT 受到市场追捧,也引发了自动驾驶界对模型构建方式的思考。前文提到的 英国公司 Wayve 亦在尝试构建一个世界模型,通过使用与驾驶本身无关的数据,如 一些文本数据预训练模型进而提升模型的驾驶性能。此外,公司亦在尝试将自动驾 驶模型和自然语言结合,让自动驾驶模型能够描述自己的行为,进而增强模型的性能和可解释性。国内毫末智行等也在做出相应的尝试,建立大参数的模型,并将海 量驾驶场景编码成语料,投喂给模型进行无监督学习,接着再加入人类反馈强化学 习帮助其掌握驾驶员的行为,进而让模型拥有接近人的自动驾驶能力。大语言模型 的风靡也让市场对自动驾驶模型构建的方式有了新的想象空间,DriveGPT 未尝不是 一种可以尝试的方向。

世界模型浮上水面,面向通用场景,解决通用问题。在最新的 CVPR2023 会议 上,特斯拉提出了世界模型,即构建一个模型,可观察所有需要观察的事物,并将 其转化为向量空间,链接各类丰富的下游任务。该模型不止用于汽车,还可用于机 器人等等嵌入式人工智能场景。通过该模型可预测未来、构建仿真场景,通过语言 提示,让它生成各类场景如直行、向右变道等。

2.5、 数据端:大模型推动数据闭环和仿真落地

神经网络只决定了算法的上限,而是否能让神经网络发挥其效能,数据起到了 决定性的作用,因此如何寻找纯净且多样化的海量数据集相比算法而言同等重要。

2.5.1、 数据闭环:自动化运行,降本增效推升规模是关键

完整的数据闭环系统,通经常包含数据采集、数据挖掘、数据标注、模型训练 等环节。其对自动驾驶功能实现的重要性不言而喻,但当前自动驾驶车型传感器越 来越高端,据 dSPACE 的数据,若采用 4k800 万像素的摄像头,每秒产生的数据将 达到 3GB,叠加激光雷达毫米波雷达等传感器,整车每秒将产生的 40G 数据,每小 时产生 19Tb 数据,对整车厂的数据处理能力提出考验。

数据采集:通常自动驾驶算法会采取一定的触发(Trigger)机制来开启数据上 传。如出现人类驾驶和自动驾驶不一致的情况,或不同传感器之间一致性不同的情 况,或者不同算法出现冲突,以及某些指定的特殊场景如近距离跟车、加塞、光照 急剧变化、阴影车道线等等。特斯拉在 2022AI DAY 上表示其拥有 221 种触发器。 数据清洗/挖掘:数据清洗和挖掘实际上是数据处理的过程,通常采集的数据包 含大量的无用数据,这里需要算法将训练模型所需要的数据提取出来,以实现有效 的数据收集,同时修正部分错误数据。这其中对于数据处理的“内功”要求深厚。 数据标注:挖掘到有价值的数据后,需要采用人工标注或自动标注的方式,叠 加部分仿真数据,形成数据集来实现对算法的训练和迭代。这其中涉及 2D 标注、3D 标注、车道线标注、语义分割等,工作量大,同时影响着车企自动驾驶算法的迭代, 是数据闭环中的重中之重。

数据闭环收益显著但成本不可忽视,降本增效是关键。数据标注方面,据特斯 拉 AI DAY 描述公司曾经组建了超过千人的团队,早期通过人工在 2D 图片上进行精 细标注,但效率低下;后改进为在向量空间完成标注,再通过投影投射到 8 个摄像 机里面,效率大幅提升;再之后特斯拉即建立了自动标注系统,通过离线大模型实 现自动标注,大幅提升标注效率。此外特斯拉通过多车辆联合优化等方式来提升标 注的精确度,起到了良好的效果。行业其他玩家亦开发自动标注工具以降本增效, 据小鹏汽车描述,采用自动化标注工具后,公司能够在 17 天内完成原本需要 200 个 人年才能完成的标注任务。数据闭环方面,特斯拉、小鹏、理想汽车均提到了各自 的自动化数据闭环体系,能够全自动完成数据的采集、挖掘、标注、存储等环节, 大大提升模型的训练和迭代效率。

2.5.2、 仿真:从提升效率到不可或缺

仿真是自动驾驶系统构建不可或缺的环节。将数据采集过程中的实车数据经过 聚类、场景提取、泛化与筛选,构筑用于测试的虚拟世界,自动驾驶算法控制车辆, 与虚拟世界产生交互,并将交互结果输出,在自动驾驶领域优势明显: (1)当数据极端难以获取的时候,仿真可以生成大量的场景供模型训练; (2)天然带有标注信息。当数据难以标注的时候,如几百万人过马路,标注成 本极高且效率低下容易产生错误,但仿真场景下不存在上述难点; (3)仿真可以给规控算法以安全的实验环境; (4)仿真的价格低廉,效率高。 理论上完美的仿真能够取代实车测试,进而以较低成本达到安全测试效果,缩 短自动驾驶算法研发周期,是自动驾驶开发迭代的重要环节。

不同的算法对仿真环境的构建提出不同要求。通常自动驾驶核心算法包括感知 算法、决策规划算法、控制算法三大环节,其中感知算法仿真需要高还原度的三维 重建场景和精准的传感器模型;决策规划算法仿真需要大量的场景库为支撑;控制 算法需要引入精准的车辆动力学模型。虚拟场景构建方面,通常需要模拟出与真实 世界一致的静态、动态交通运行场景。静态场景通常包含道路、车道线、减速带、 交通标志、路灯、车站、周围建筑等等,通常使用高精度地图和三维重建技术构建 (通常需要回执高精度地图并进行三维建模);动态场景包含动态指示设施、机动车 行为、非机动车行为、行人行为、通信环境、气象变化、时间变化等。感知系统仿 真方面,包含摄像头仿真(生成逼真的图像并添加色彩和光学属性等通常采用游戏 引擎来构建,如百度阿波罗采用 Unity3D、腾讯 TADSim 引入了虚幻引擎)、毫米波 雷达仿真、激光雷达仿真。车辆动力学仿真方面,通常基于多体动力学搭建模型, 其中包含车体、悬架系统、转向系统、制动系统、动力系统、传动系统等多个真实 部件的车辆模型。

对仿真工具而言,其能够覆盖的场景范围越大,自动驾驶可行驶边界就越广泛。 因此评价自动驾驶算法最重要的标准就是测试其是否能够处理足够多的场景库。通 常仿真模型会以真实采集的数据、模拟数据、以及根据真实场景合成的仿真数据为 数据源,对场景的几何形状、物理运动规律、以及场景中各个元素如车流、行人等符合逻辑规律,以实现更好的仿真效果。

自动驾驶仿真平台市场竞争激烈,促使平台仿真性能提升。自驾仿真平台布局 主体众多,可以划分为科技公司、自驾解决方案商、仿真软件企业、车企、高校及 科研机构五大类。科技公司拥有大数据优势,软件开发经验丰富;自驾解决方案商 多针对自研发需要,较少对外提供仿真服务;不同仿真软件企业经验积累程度不同, 传统企业积累深厚,初创企业积累薄弱;车企能够将路测和仿真测试同步结合,但 限于自身软件开发能力,多与外部仿真平台提供商合作进行自动驾驶汽车开发;高 校及科研机构主要对自驾仿真软件进行前瞻、基础性研究。自驾仿真平台参与者众, 市场竞争激烈,具备更快迭代速度、更强仿真能力、更完善服务支持的仿真平台将 快速成长。

DRIVE Sim:Nvidia 自动驾驶研发生态体系重要一环。DRIVE Sim 是由英伟达 开发的端到端仿真平台,能够进行大规模多传感器仿真。DRIVE Sim 功能强大,能 够提供核心模拟和渲染引擎,生成逼真的数据流,创建各种测试环境,模拟暴雨和 暴雪等各种天气条件,以及不同的路面和地形,还可以模拟白天不同时间的眩目强 光以及晚上有限的视野,达到“照片级逼真且物理精确”的传感器仿真。

DRIVE Sim 具有完善的工具链支持,融入英伟达自动驾驶开发生态。DRIVE Sim 可以在 Omniverse 云平台上运行,也可以在 OVX 服务器组成的本地数据中心甚至单 颗 RTX3090 上运行。DRIVE Sim 具有开放式、模组化分特点,拥有良好的可拓展性: (1)支持神经重建引擎(NER),该 AI 工具可以将真实世界的数据直接带入仿真中, 开发者可在仿真环境中修改场景、添加合成对象,并应用随机化技术,大大增加真 实感并加快生产速度。(2)使用 NVIDIA Omniverse Kit SDK,DRIVE Sim 允许开发 人员构建自定义模型、3D 内容和验证工具,或与其他模拟进行交互。(3)支持 DRIVE Replicator 生成与合成传感器数据对应的真值数据,用于训练自动驾驶汽车 DNN。 DRIVE Sim 已融入英伟达完整的软硬协同生态,支持从概念到部署的自动驾驶汽车 开发及验证。

51 Sim-One:本土仿真系统助力中国自动驾驶量产落地。Sim-One 是 51 World 全栈自研的云原生仿真平台。(1)场景方面,Sim-One 具有丰富的场景生成方式, 特别是能基于语义泛化工具链能够实现场景的快速定义;与第三方场景库达成合作, 扩充场景数量,提高仿真测试质量。(2)平台方面,Sim-One 具有丰富的功能,包 括静态和动态数据导入、测试场景案例编辑、各类仿真、测试与回放、虚拟数据集 生成以及各类在环测试;Sim-One 基于原生云架构仿真平台,支持大规模并发仿真 技术,日测试里程可达十万公里。(3)评价方面,Sim-One 具备丰富的指标库可供 用户自行选择进行评价,涵盖安全性、违规性、舒适性、高效性、经济能耗性、控 制准确性等多个维度,并且支持多场景并发评价。

AI 应用于仿真系统,能够有效辅助自动驾驶系统升级。(1)在场景库构建方面, 从传感器数据中利用 AI 进行自动化、大规模三维重建,构建现实世界对象和背景的 几何形状、外观和材料属性;使用大量路采数据训练 Agent AI,使之模仿道路场景 中的主体,赋予虚拟场景强交互性;利用已有场景库与生成式 AI,自动生成无需标 注的各种交通场景数据。(2)在车辆仿真测试过程中,使用 AI 识别自动驾驶系统的 弱点,并自动创建对抗性场景,同时自驾系统使用 AI 算法自动从错误中学习,自动 迭代更新,无需密集手动调整算法,适应更快节奏、更大规模的训练。AI 能使仿真 系统更有针对性,使自动驾驶算法调整自动化,加速自驾技术在现实世界落地。

3、 自动驾驶算法变革引领产业链变化

3.1、 兵马未动粮草先行,云端算力军备竞赛开启

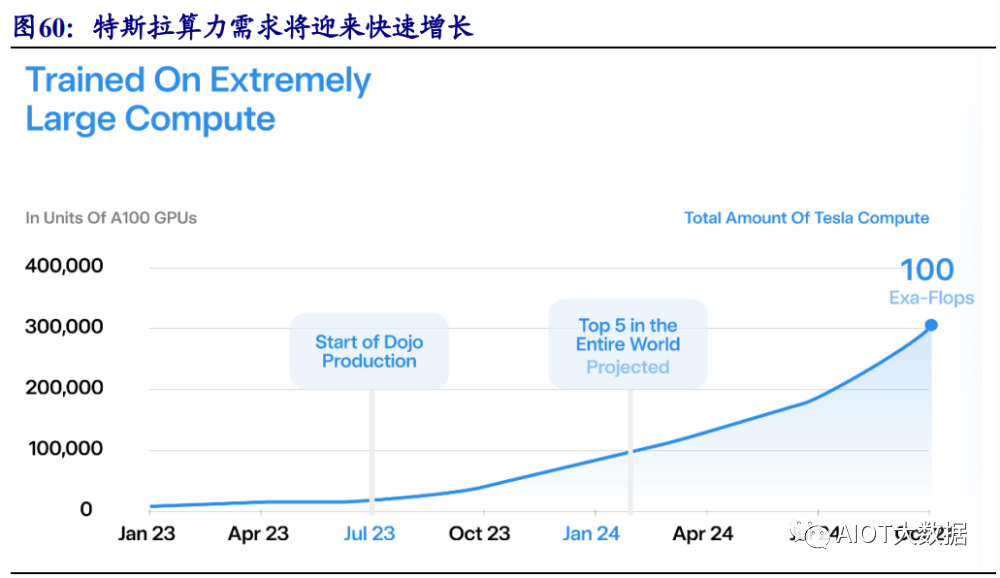

对自动驾驶而言,大量的数据处理、训练、自动标注、仿真等工作需要完成, 算力成为车企打造自动驾驶能力的核心,决定着车企的算法迭代效率和上限。特斯 拉表示其总算力在 2024 年将冲刺 100EFlops,而国内领先玩家亦不遑多让,纷纷构 建自有的数据中心,自动驾驶的算力军备竞赛从车端蔓延到云端。

3.1.1、 特斯拉自研算力平台 Dojo,2024 年冲刺 100EFlops 算力

特斯拉在应对海量训练和仿真需求时构建了庞大的算力体系。据特斯拉在 2021 年 AI DAY 介绍,特斯拉为了移除自动驾驶系统对毫米波雷达的依赖,从 250 万个 视频剪辑中生成了超过 100 亿个标签,需要庞大的离线神经网络和引擎。而硬件方 面,特斯拉在 2021 年 AI DAY 期间就拥有接近 1 万块 GPU,2022 年 AI DAY 上这一 数字提升到 1.4 万片,其中约 50%的负载用来实现云端自动标注和车载占用网络的训 练。

自研 D1 芯片和 Dojo 超级计算机布局算力。为了进一步提升算力水平,2021 年 起特斯拉开始自研 D1 人工智能芯片和 Dojo 超级计算机。将 25 颗自研的 D1 芯片封 装成 Dojo 训练模块,再将 120 个训练模块结合 Dojo 接口处理器等组件融合形成 Dojo 主机,目前 10 机柜的 Dojo ExaPOD 超级计算机将拥有 1.1EFlops 算力,并且拥有强 扩展能力,借助特斯拉强大的软件能力,将有效提升其在算法领域的迭代速率。

而据特斯拉 AI 官方账号显示,特斯拉将在 2024 年 1 月将拥有等效 10 万片英伟 达 A100GPU 的算力,在 2024 年的 10 月拥有 100EFlops 算力,等效 30 万片英伟达 A100GPU 算力。

3.1.2、 国内自动驾驶领先玩家亦积极布局,算力成为自驾竞争“入场券”

国内玩家亦快速布局算力领域,为自身算法和数据的迭代和积累铺平道路。2022 年 8 月,小鹏汽车与阿里云共同宣布在内蒙古乌兰察布建成自动驾驶智算中心“扶 摇”,用于自动驾驶。“扶摇”的算力可达到 600PFLOPS,据何小鹏在小鹏科技日上 描述,智算中心将小鹏汽车的自动驾驶模型训练效率提升百倍以上。毫末智行则联 合火山引擎推出雪湖·绿洲智算中心,拥有 670PFLOPS 算力。此外 2023 年 1 月吉 利汽车也联合阿里云推出吉利星睿智算中心,理想汽车在 2023 年同样与火山引擎合 作在山西布局智算中心,蔚来等诸多车厂亦积极推动自有或云端算力的构建。

3.2、 自动驾驶芯片格局有望被重塑

3.2.1、 Transformer 大模型对芯片架构提出新的要求

Transformer 大模型对芯片架构提出新的要求。芯片架构决定着算法运行效率, 近年随着 Transformer 算法风靡 AI 界,特斯拉引领下,Transformer 在自动自动驾驶 行业行业被广泛使用,芯片对 Transformer 适配性将影响未来芯片的竞争格局。与传 统卷积神经网络(CNN)架构相比,Transformer 算法拥有显著的不同: (1)算法对算力要求较高。Transformer 通常计算量较大,且在大参数和大数据 量的基础上才能展现出更优异的模型性能,这对芯片的算力提出新的要求。 (2)对芯片的运算精度存在一定要求。考虑到算力的限制,目前的推理侧芯片 通常采用 int8(整型)精度算力(int8 为运算数精度单位,Int8 指 8 位整型数,即用 8bit 来表示一个整数数字;相应的 FP16 为半精度浮点数,即用 16bit 表示一个小数, 精度更高),而对 Transformer 来说,由于其内部算子较为复杂,更适合于在采用浮 点运算的平台运行。 (3)算子复杂度高,和卷积神经网络显著不同。相比传统卷积神经网络算法中 更多以较为规则的卷积矩阵乘法运算而言,Transformer 中算子复杂度高,有较多访 存密集型算子,对访存带宽和存储容量要求较高。而传统 AI 芯片多基于卷积神经网 络等算法优化,难以实现和 Transformer 的良好适配。

3.2.2、 芯片玩家开始着力加大产品对 Transformer 的适配度

鉴于上述特点,不少芯片厂商推出了可针对 Transformer 加速的芯片产品。未来, 能够良好适配 Transformer 算法并帮助其在车载平台落地的公司有望占得先机。

3.3、 自动驾驶产业加速成熟,配套公司全面受益

3.3.1、 BEV+Transformer 大模型的自动驾驶算法构建形式被市场广为接受

特斯拉发布 BEV+Transformer 的算法以来,行业广泛认可,我们看到诸多玩家 积极跟进,推出自己的大模型算法。理想汽车在最新的理想家庭科技日上宣布自动 驾驶已经进入大模型时代,而通勤NOA和城市NOA将成为未来消费者的刚需配置。

模型算法的落地代表着功能逐步走向成熟。2023 年以来,我们将陆续看到各大 车企纷纷落地自己的城市辅助驾驶相关车型,行业呈现百花齐放的状态。这无疑将 助力整个自动驾驶产业链走向繁荣。

编辑:黄飞

电子发烧友App

电子发烧友App

评论