CNN模型的输出信息进行负荷预测,最终得到预测结果。选取西班牙公开的电力数据为实验数据,运用Python语言搭建预测模型,分别与CNN和LSTM单一模型进行对比,验证了所提组合预测模型的可靠性,其在电力短期负荷预测领域应用效果较好,可为供电部门电力规划提供理论依据。

2023-11-09 14:13:59 3252

3252

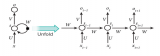

循环神经网络 (RNN) 是一种深度学习结构,它使用过去的信息来提高网络处理当前和将来输入的性能。RNN 的独特之处在于该网络包含隐藏状态和循环。

2024-02-29 14:56:10 5450

5450

RNN中支持的一些基本算子,如何对序列数据进行组织

2022-08-31 10:01:30

DL之RNN:RNN算法相关论文、相关思路、关键步骤、配图集合+TF代码定义

2018-12-28 14:20:33

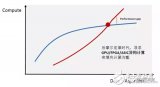

作者:琥珀导言:循环神经网络(RNNs)具有保留记忆和学习数据序列的能力。由于RNN的循环性质,难以将其所有计算在传统硬件上实现并行化。当前CPU不具有大规模并行性,而由于RNN模型的顺序组件

2018-07-31 10:11:00

GMR7590-9P2CNN - Right Angle Micro-D Connectors - Glenair, Inc.

2022-11-04 17:22:44

GMR7590-9P3CNN - Right Angle Micro-D Connectors - Glenair, Inc.

2022-11-04 17:22:44

GMR7590-9S1CNN - Right Angle Micro-D Connectors - Glenair, Inc.

2022-11-04 17:22:44

GMR7590-9S2CNN - Right Angle Micro-D Connectors - Glenair, Inc.

2022-11-04 17:22:44

TF之CNN:CNN实现mnist数据集预测 96%采用placeholder用法+2层C及其max_pool法+隐藏层dropout法+输出层softmax法+目标函数cross_entropy法+

2018-12-19 17:02:40

TF之CNN:Tensorflow构建卷积神经网络CNN的嘻嘻哈哈事之详细攻略

2018-12-19 17:03:10

在TensorFlow中实现CNN进行文本分类(译)

2019-10-31 09:27:55

原文链接:http://tecdat.cn/?p=6585本文介绍了用于涡轮桨距角控制的永磁同步发电机(PMSG)和高性能在线训练递归神经网络(RNN)的混合模糊滑模损失最小化控制的设计。反向传播学

2021-07-12 07:55:17

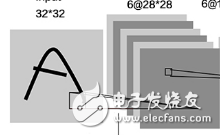

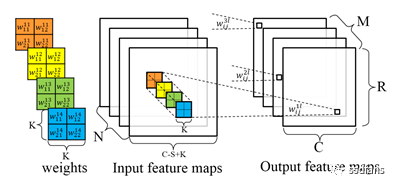

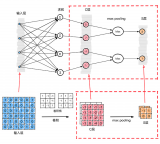

1 CNN简介

CNN即卷积神经网络(Convolutional Neural Networks),是一类包含卷积计算的神经网络,是深度学习(deep learning)的代表算法之一,在图像识别

2023-08-18 06:56:34

利用RNN进行文章生成

2019-05-24 08:35:12

【深度学习】卷积神经网络CNN

2020-06-14 18:55:37

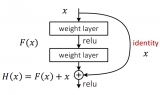

”机制来捕捉长时依赖关系。● 卷积循环神经网络 (CRNN)卷积循环神经网络是 CNN 和 RNN 的混合,可发现局部时间/空间关联性。CRNN 模型从卷积层开始,然后是 RNN,对信号进行编码

2021-07-26 09:46:37

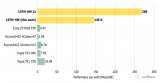

1、基于SARIMA、XGBoost和CNN-LSTM的时间序列预测对比 时间序列预测是一个经常被研究的话题,我们这里使用使用两个太阳能电站的数据,研究其规律进行建模。首先将它们归纳为两个问题来

2022-12-20 16:34:57

采用数字CNN电路。所谓数字CNN电路即以数字架构来仿效实现CNN功能的芯片,该设计方式使用数字的方法来仿效实现CNN的微分方程式,计算结果是比较容易用电路实现的,且电路功能也是可测试的[14-15

2009-09-19 09:35:15

【技术综述】为了压榨CNN模型,这几年大家都干了什么

2019-05-29 14:49:27

?方式有哪些?今天本文将以一个简单的指南,将帮助您构建和了解构建简单的CNN的概念。通过阅读本文之后,将能够基于PyTorch API构建一个简单的CNN,并使用FashionMNIST日期集对服装

2020-07-16 18:13:11

单片机(Cortex-M内核,无操作系统)可以跑深度学习吗? ——Read Air 2019.8.20Xu_CNN框架待处理:1.需要设计一个可读写的消息栈 ()2.函数的类型参数使用结构体传入 (已实现)3.动态...

2021-12-09 08:02:27

MIMRTX1064(SDK2.13.0)的KWS demo中放置了ds_cnn_s.tflite文件,提供demo中使用的模型示例。在 read.me 中,声明我可以找到脚本,但是,该文档中的脚本

2023-04-19 06:11:51

。更多细节,请大家参看知乎何之源的文章,文末会给出文章链接。4、CNN的seq2seq现在大多数场景下使用的Seq2Seq模型是基于RNN构成的,虽然取得了不错的效果,但也有一些学者发现使用CNN来替换

2019-07-20 04:00:00

连接层等基本结构的组合使用,CNN 能够有效地捕捉语音信号的局部特征。

3.循环神经网络(RNN)

RNN 是专门为处理时间序列数据而设计的神经网络。在语音识别领域,RNN 主要用于处理语音

2023-11-07 18:01:32

本文介绍了用于涡轮桨距角控制的永磁同步发电机(PMSG)和高性能在线训练递归神经网络(RNN)的混合模糊滑模损失最小化控制的设计。反向传播学习算法用于调节RNN控制器。PMSG速度使用低于额定速度

2021-07-12 06:46:57

英文句子,用同样的单词,但只有考虑单词的顺序时,它们才意味着不同的含义。人类通过从左到右阅读词序列来理解文本,并构建了可以理解文本数据中所有不同内容的强大模型。RNN的工作方式有些许类似,每次只查看

2022-07-20 09:27:59

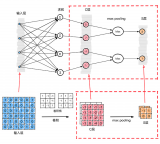

基于FPGA的通用CNN加速器整体框架如下,通过Caffe/Tensorflow/Mxnet等框架训练出来的CNN模型,通过编译器的一系列优化生成模型对应的指令;同时,图片数据和模型权重数据按照优化规则进行预处理以及压缩后通过PCIe下发到FPGA加速器中

2017-10-27 14:09:58 10619

10619

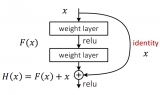

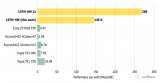

演化脉络下图所示CNN结构演化的历史,起点是神经认知机模型,已经出现了卷积结构,但是第一个CNN模型诞生于1989年,1998年诞生了LeNet。随着ReLU和dropout的提出,以及GPU和大数

2017-11-15 11:10:09 3064

3064

循环神经网络(RNNs)具有保留记忆和学习数据序列的能力。由于RNN的循环性质,难以将其所有计算在传统硬件上实现并行化。当前CPU不具有大规模并行性,而由于RNN模型的顺序组件,GPU只能提供有

2017-11-15 13:30:06 2523

2523

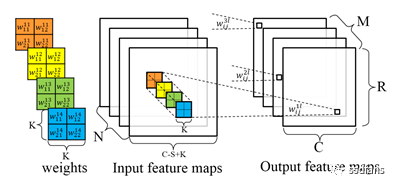

CNN是目前自然语言处理中和RNN并驾齐驱的两种最常见的深度学习模型。图1展示了在NLP任务中使用CNN模型的典型网络结构。一般而言,输入的字或者词用Word Embedding的方式表达,这样

2017-11-15 17:59:19 17395

17395

之前在网上搜索了好多好多关于CNN的文章,由于网络上的文章很多断章取义或者描述不清晰,看了很多youtobe上面的教学视频还是没有弄懂,最后经过痛苦漫长的煎熬之后对于神经网络和卷积有了粗浅的了解

2017-11-16 13:18:40 59204

59204

对于神经网络和卷积有了粗浅的了解,关于CNN 卷积神经网络,需要总结深入的知识有很多:人工神经网络 ANN卷积神经网络CNN 卷积神经网络CNN-BP算法卷积神经网络CNN-caffe应用卷积神经网络CNN-LetNet分析 LetNet网络.

2017-11-16 13:28:01 3088

3088

将神经网络模型训练好之后,在输入层给定一个x,通过网络之后就能够在输出层得到特定的y,那么既然有了这么强大的模型,为什么还需要RNN(循环神经网络)呢?

2018-05-05 10:51:00 5433

5433

2014 年 RNN/LSTM 起死回生。自此,RNN/LSTM 及其变种逐渐被广大用户接受和认可。起初,LSTM 和 RNN 只是一种解决序列学习和序列翻译问题的方法(seq2seq),随后被用于语音识别并有很好的效果。

2018-04-25 09:43:56 21021

21021 在循环神经网络可以用于文本生成、机器翻译还有看图描述等,在这些场景中很多都出现了RNN的身影。

2018-05-11 14:58:41 14676

14676

由 mengqiqi 于 星期三, 2018-09-05 09:58 发表 一、前述 CNN和RNN几乎占据着深度学习的半壁江山,所以本文将着重讲解CNN+RNN的各种组合方式,以及CNN和RNN

2018-09-06 22:32:01 1029

1029 运用迁移学习,CNN特征,语句特征应用已有模型2. 最终的输出模型是LSTM,训练过程的参数设定:梯度上限(gradient clipping), 学习率调整(adaptivelearning)3. 训练时间很长。

2018-09-13 15:22:42 53438

53438 之前在网上搜索了好多好多关于CNN的文章,由于网络上的文章很多断章取义或者描述不清晰,看了很多youtobe上面的教学视频还是没有弄懂,最后经过痛苦漫长的煎熬之后对于神经网络和卷积有了粗浅的了解

2018-10-02 07:41:01 930

930 Kortiq提供易于使用,可扩展且小巧的CNN加速器。

该设备支持所有类型的CNN,并动态加速网络中的不同层类型。

2018-11-23 06:28:00 3804

3804 卷积神经网络( CNN)和循环神经网络(RNN)在自然语言处理,上得到广泛应用,但由于自然语言在结构上存在着前后依赖关系,仅依靠卷积神经网络实现文本分类将忽略词的上下文含义,且传统的循环神经网络存在梯度消失或梯度爆炸问题,限制了文本分类的准确率。

2018-11-22 16:01:45 10

10 最近,有一篇入门文章引发了不少关注。文章中详细介绍了循环神经网络(RNN),及其变体长短期记忆(LSTM)背后的原理。

2019-02-05 13:43:00 1317

1317 很多“长相相似”的专有名词,比如我们今天要说的“三胞胎”DNN(深度神经网络)、CNN(卷积神经网络)、RNN(递归神经网络),就让许许多多的AI初学者们傻傻分不清楚。而今天,就让我们一起擦亮眼睛,好好

2019-03-13 14:32:34 5369

5369 Mask R-CNN是承继于Faster R-CNN,Mask R-CNN只是在Faster R-CNN上面增加了一个Mask Prediction Branch(Mask预测分支),并且在ROI

2019-04-04 16:32:07 13838

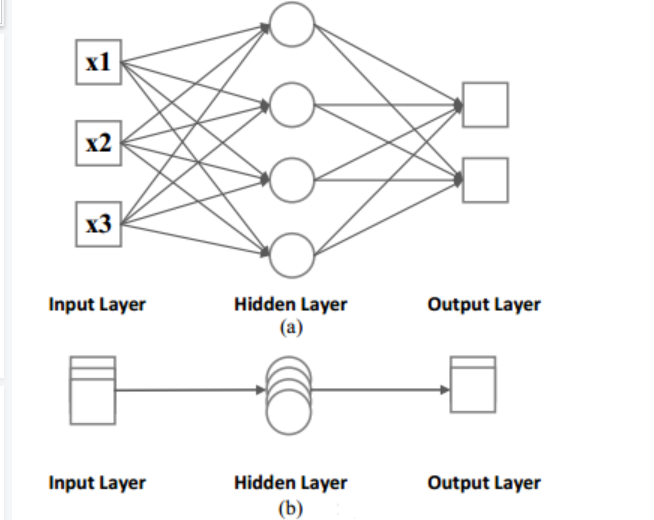

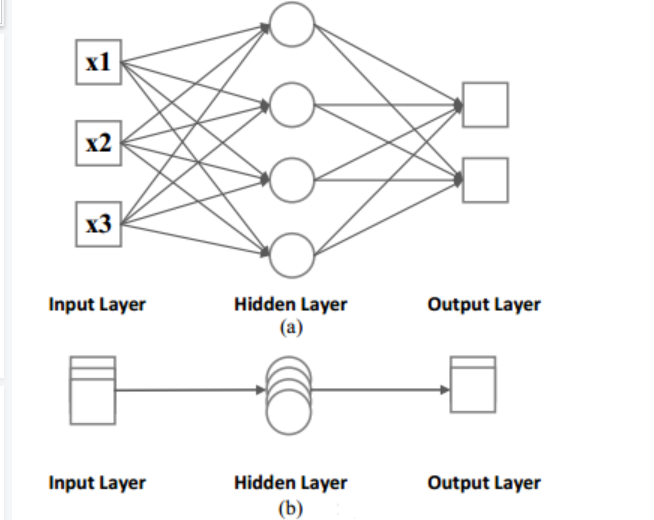

13838 包含有输入层、输出层和一个隐藏层。输入的特征向量通过隐藏层变换到达输出层,由输出层得到分类结果。

2020-03-13 16:49:20 5584

5584 递归神经网络(RNN)被提出用来处理80年代的输入序列时间信息。1993年,神经历史压缩器系统解决了“非常深度学习”任务,该任务需要及时展开RNN中的1000多个后续层。

2020-03-22 10:23:00 7266

7266

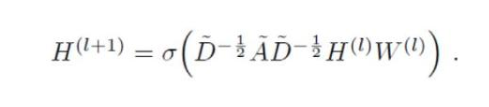

深度学习一直都是被几大经典模型给统治着,如CNN、RNN等等,它们无论再CV还是NLP领域都取得了优异的效果,那这个GCN是怎么跑出来的?是因为我们发现了很多CNN、RNN无法解决或者效果不好的问题——图结构的数据。

2020-04-17 10:14:13 3600

3600

尽管许多研究人员已经开发了用于FER的CNN方法,但到目前为止,他们中很少有人试图确定哪种类型的网络最适合这一特定任务。意识到文献中的这种差距,永胜和他的同事邵杰为FER开发了三种不同的CNN,并进行了一系列的评估,以确定他们的优势和劣势。

2020-04-17 10:55:01 15498

15498 使用的是 CNN 而不是 RNN(常用来处理时序数据),是因为每次的重复运动练习(如举哑铃)是花费的时间是非常短的少于 4 秒,训练时不需要长时间的记忆。

2020-12-25 03:39:00 15

15 抽取的能力,构建基于循环神经网络(RNN)的样本分类模型,以对 Linux远控木马进行检测。为避免陷入局部最优,采用随机搜索参数的方法进行模型超参数选择。对基于RNN的分类模型及其他基于传统机器学习算法的模型分别进行实验

2021-03-30 09:21:44 15

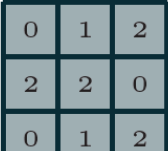

15 概述 深度学习中CNN网络是核心,对CNN网络来说卷积层与池化层的计算至关重要,不同的步长、填充方式、卷积核大小、

2021-04-06 15:13:25 3356

3356

神经网络是深度学习的载体,而神经网络模型中,最经典非RNN模型所属,尽管它不完美,但它具有学习历史信息的能力。后面不管是encode-decode 框架,还是注意力模型,以及自注意力模型,以及更加

2021-05-10 10:22:45 13077

13077

神经网络是深度学习的载体,而神经网络模型中,最经典非RNN模型所属,尽管它不完美,但它具有学习历史信息的能力。后面不管是encode-decode 框架,还是注意力模型,以及自注意力模型,以及更加

2021-05-13 10:47:46 25963

25963

连接层,使得网络结构简单且可移植性强。在改进CNN网络的基础上,利用基于投票法的集成学习策略将所有个体学习器结果凸组合为最终结果,实现更准确的人脸识别。实验结果表明,该算法在 Color Feret、AR和ORL人脸数据库上的识别准确率分别达到

2021-05-27 14:36:12 6

6 基于CNN和LSTM的蛋白质亚细胞定位研究对比

2021-06-11 14:16:11 15

15 基于CNN与约束概率矩阵分解的推荐算法

2021-06-17 16:36:19 7

7 基于RNN的GIS故障预测算法及系统设计

2021-07-01 15:38:37 30

30 循环神经网络(Recurrent Neural Network,RNN)是一种用于处理序列数据的神经网络。相比一般的神经网络来说,他能够处理序列变化的数据。比如某个单词的意思会因为上文提到的内容不同而有不同的含义,RNN就能够很好地解决这类问题。

2022-03-15 10:44:42 2428

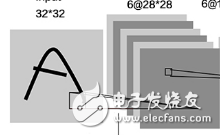

2428 LeNet 卷积神经网络是由深度学习三巨头之一的 Yan Le Cun于 1994 年提出来的。其对构建的 MNIST手写字符数据集进行分类。LeNet 的提出确立了 CNN 的基本网络架构。

2022-07-05 11:50:09 2994

2994 神经网络一般可以分为以下常用的三大类:CNN(卷积神经网络)、RNN(循环神经网络)、Transformer(注意力机制)。

2022-12-12 14:48:43 7044

7044 卷积神经网络(CNN)是解决图像分类、分割、目标检测等任务的流行模型。本文将CNN应用于解决简单的二维路径规划问题。主要使用Python, PyTorch, NumPy和OpenCV。

2023-02-13 14:30:54 1418

1418 电子发烧友网站提供《PyTorch教程14.8之基于区域的CNN(R-CNN).pdf》资料免费下载

2023-06-05 11:09:06 0

0 14.8。基于区域的 CNN (R-CNN)¶ Colab [火炬]在 Colab 中打开笔记本 Colab [mxnet] Open the notebook in Colab

2023-06-05 15:44:37 1318

1318

因为CNN的特有计算模式,通用处理器对于CNN实现效率并不高,不能满足性能要求。 因此,近来已经提出了基于FPGA,GPU甚至ASIC设计的各种加速器来提高CNN设计的性能。

2023-06-14 16:03:43 3135

3135

作者:AhzamEjaz来源:DeepHubIMBA卷积神经网络(cnn)是一种神经网络,通常用于图像分类、目标检测和其他计算机视觉任务。CNN的关键组件之一是特征图,它是通过对图像应用卷积滤波器

2023-04-19 10:33:09 1749

1749

它用TensorFlow.js加载了一个10层的预训练模型,相当于在你的浏览器上跑一个CNN模型,只需要打开电脑,就能了解CNN究竟是怎么回事。

2023-06-28 14:47:09 5240

5240

python卷积神经网络cnn的训练算法 卷积神经网络(Convolutional Neural Network,CNN)一直是深度学习领域重要的应用之一,被广泛应用于图像、视频、语音等领域

2023-08-21 16:41:37 2376

2376 和高效的处理方式,CNN已经成为图像识别、语音识别和自然语言处理等领域中的优选技术。CNN对于处理基于网格结构的数据具有天然的优势,因此在处理图像和视频等视觉数据时,具有独特的优越性能。 CNN的特点 1. 卷积操作:CNN最重要的操作是卷积操作,这也是CNN得名的来源。CNN的卷积操

2023-08-21 16:41:48 4333

4333 cnn卷积神经网络原理 cnn卷积神经网络的特点是什么 卷积神经网络(Convolutional Neural Network,CNN)是一种特殊的神经网络结构,主要应用于图像处理和计算机视觉领域

2023-08-21 17:15:25 2510

2510 cnn卷积神经网络算法 cnn卷积神经网络模型 卷积神经网络(CNN)是一种特殊的神经网络,具有很强的图像识别和数据分类能力。它通过学习权重和过滤器,自动提取图像和其他类型数据的特征。在过去的几年

2023-08-21 17:15:57 2993

2993 cnn卷积神经网络matlab代码 卷积神经网络(Convolutional Neural Network, CNN)是深度学习中一种常用的神经网络结构,它是通过卷积层、池化层和全连接层等组合

2023-08-21 17:15:59 2120

2120 cnn卷积神经网络简介 cnn卷积神经网络代码 卷积神经网络(Convolutional Neural Network,简称CNN)是目前深度学习领域中应用广泛的一种神经网络模型。CNN的出现

2023-08-21 17:16:13 3817

3817 Vitis AI 递归神经网络 (RNN) 工具是 Vitis™ AI 开发环境的一个子模块,专注于在 Xilinx® 硬件平台(包括 Alveo™ 加速器卡)上实现 RNN。这些工具由优化的 IP

2023-09-13 17:32:53 0

0 卷积神经网络(CNN 或 ConvNet)是一种直接从数据中学习的深度学习网络架构。

CNN 特别适合在图像中寻找模式以识别对象、类和类别。它们也能很好地对音频、时间序列和信号数据进行分类。

2023-10-12 12:41:49 2398

2398

,非常适合RNN。与其他神经网络不同,RNN具有内部存储器,允许它们保留来自先前输入的信息,并根据整个序列的上下文做出预测或决策。在本文中,我们将探讨RNN的架构、它

2023-12-15 08:28:11 1291

1291

DNN中应用最广泛的是CNN和RNN,CNN是一种卷积网络,在图片识别分类中用的较多,RNN可以处理时间序列的信息,比如视频识别和语音识别。

2024-04-07 10:23:04 1148

1148

卷积神经网络(Convolutional Neural Networks,简称CNN)是一种深度学习模型,广泛应用于图像识别、视频分析、自然语言处理等领域。 CNN的基本概念 1.1 卷积层

2024-07-02 15:24:42 1732

1732 卷积神经网络(CNN)是一种深度学习模型,广泛应用于图像分类、目标检测、语义分割等领域。本文将详细介绍CNN在分类任务中的应用,包括基本结构、关键技术、常见网络架构以及实际应用案例。 引言 1.1

2024-07-03 09:28:41 2079

2079 在自然语言处理(NLP)领域,循环神经网络(RNN)与卷积神经网络(CNN)是两种极为重要且广泛应用的网络结构。它们各自具有独特的优势,适用于处理不同类型的NLP任务。本文旨在深入探讨RNN与CNN

2024-07-03 15:59:04 1504

1504 卷积神经网络(CNN)是深度学习领域中一种特别适用于图像识别任务的神经网络结构。它通过模拟人类视觉系统的处理方式,利用卷积、池化等操作,自动提取图像中的特征,进而实现高效的图像识别。本文将从CNN的基本原理、构建过程、训练策略以及应用场景等方面,详细阐述如何利用CNN实现图像识别。

2024-07-03 16:16:16 3458

3458 RNN(Recurrent Neural Network,循环神经网络)是一种专门用于处理序列数据的神经网络结构,它能够在序列的演进方向上进行递归,并通过所有节点(循环单元)的链式连接来捕捉序列中

2024-07-04 11:48:51 8616

8616 RNN(Recurrent Neural Network,循环神经网络)是一种具有循环结构的神经网络,它能够处理序列数据,并且能够捕捉时间序列数据中的动态特征。RNN在自然语言处理、语音识别、时间

2024-07-04 15:02:01 1856

1856 RNN(Recurrent Neural Network,循环神经网络)是一种具有循环结构的神经网络,它可以处理序列数据,具有记忆功能。RNN在许多领域都有广泛的应用,以下是一些RNN神经网络的适用

2024-07-04 15:04:15 2061

2061 RNN(Recurrent Neural Network,循环神经网络)是一种具有循环结构的神经网络,它能够处理序列数据,具有记忆功能。RNN在自然语言处理、语音识别、时间序列预测等领域有着广泛

2024-07-04 15:40:15 1616

1616 RNN(Recurrent Neural Network,循环神经网络)是一种具有循环连接的神经网络,它能够处理序列数据,并且具有记忆能力。与传统的前馈神经网络(Feedforward Neural

2024-07-05 09:49:02 2122

2122 RNN(Recurrent Neural Network,循环神经网络)是一种具有循环结构的神经网络模型,它能够处理序列数据,并对序列中的元素进行建模。RNN在自然语言处理、语音识别、时间序列预测等

2024-07-05 09:50:35 1813

1813 卷积神经网络(Convolutional Neural Networks, CNN)作为深度学习领域的核心成员,不仅在学术界引起了广泛关注,更在工业界尤其是计算机视觉领域展现出了巨大的应用价值。关于

2024-07-05 17:37:17 7478

7478 在深度学习的广阔领域中,卷积神经网络(CNN)和循环神经网络(RNN)是两种极为重要且各具特色的神经网络模型。它们各自在图像处理、自然语言处理等领域展现出卓越的性能。本文将从概念、原理、应用场景及代码示例等方面详细探讨CNN与RNN的关系,旨在深入理解这两种网络模型及其在解决实际问题中的互补性。

2024-07-08 16:56:10 2368

2368 在深度学习领域,循环神经网络(RNN)因其能够处理序列数据而受到广泛关注。然而,传统RNN在处理长序列时存在梯度消失或梯度爆炸的问题。为了解决这一问题,LSTM(长短期记忆)神经网络应运而生。 循环

2024-11-13 09:58:35 1800

1800 时间序列预测在金融、气象、销售预测等领域有着广泛的应用。传统的时间序列分析方法,如ARIMA和指数平滑,虽然在某些情况下表现良好,但在处理非线性和复杂模式时可能不够灵活。递归神经网络(RNN)提供了

2024-11-15 09:45:25 1423

1423 RNN,即循环神经网络(Recurrent Neural Network),是一种特殊类型的人工神经网络,专门设计用于处理序列数据,如文本、语音、视频等。以下是对RNN基本原理与实现的介绍: 一

2024-11-15 09:49:33 2289

2289 循环神经网络(RNN)是深度学习领域中处理序列数据的基石。它们通过在每个时间步长上循环传递信息,使得网络能够捕捉时间序列数据中的长期依赖关系。然而,尽管RNN在某些任务上表现出色,它们也面临着一些

2024-11-15 09:55:29 1987

1987 输入图像的内容。 RNN的基本原理 RNN是一种用于处理序列数据的神经网络,它通过循环结构来处理序列中的每个元素,并保持前一个元素的信息。RNN的主要特点是它能够处理任意长度的序列,并且能够捕捉序列中的时间依赖关系。RNN的基本单元是循环单元(

2024-11-15 09:58:13 1479

1479 RNN(循环神经网络)与LSTM(长短期记忆网络)模型在深度学习领域都具有处理序列数据的能力,但它们在结构、功能和应用上存在显著的差异。以下是对RNN与LSTM模型的比较分析: 一、基本原理与结构

2024-11-15 10:05:21 3037

3037 循环神经网络(Recurrent Neural Network, RNN)是一种适合于处理序列数据的深度学习模型。由于其独特的循环结构,RNN能够处理时间序列数据,捕捉时间序列中的动态特征,因此在

2024-11-15 10:10:12 2188

2188 随着大数据时代的到来,实时数据分析变得越来越重要。在众多的机器学习模型中,递归神经网络(Recurrent Neural Networks,简称RNN)因其在处理序列数据方面的优势,被广泛应用于实时

2024-11-15 10:11:47 1249

1249 RNN的损失函数 RNN(循环神经网络)在处理序列数据的过程中,损失函数(Loss Function)扮演着重要的角色,它可以测量模型在训练中的表现,并推动模型朝着正确的方向学习。RNN中常见的损失

2024-11-15 10:16:23 1922

1922 在AI领域,文本翻译、语音识别、股价预测等场景都离不开序列数据处理。循环神经网络(RNN)作为最早的序列建模工具,开创了“记忆历史信息”的先河;而长短期记忆网络(LSTM)则通过创新设计,突破

2025-12-09 13:56:34 945

945

电子发烧友App

电子发烧友App

评论