在开始编程之前,先让我们准备一份基本的路线图。我们的目标是创建一个特定架构(层数、层大小、激活函数)的密集连接神经网络。然后训练这一神经网络并做出预测。

2018-10-18 09:02:43 3187

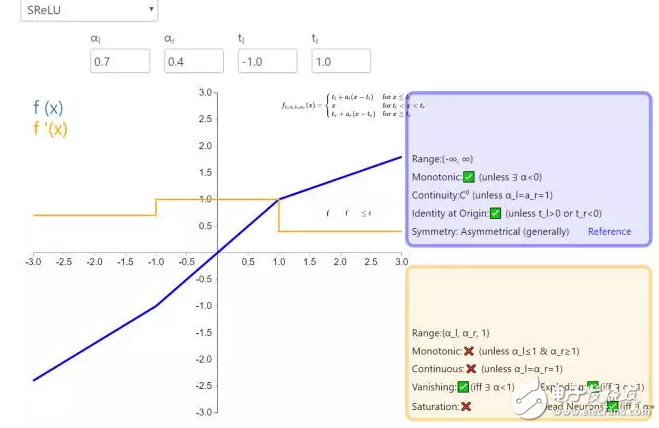

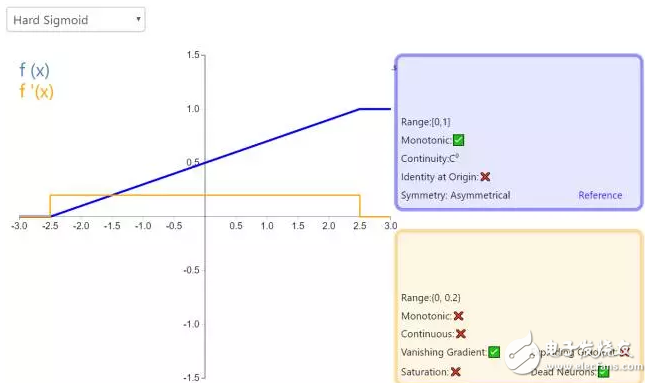

3187 在两层神经网络之间,必须有激活函数连接,从而加入非线性因素,提高神经网络的能力。所以,我们先从激活函数学起,一类是挤压型的激活函数,常用于简单网络的学习;另一类是半线性的激活函数,常用于深度网络的学习。

2023-08-07 10:02:29 441

441

神经网络Matlab程序

2009-09-15 12:52:24

神经网络基本介绍

2018-01-04 13:41:23

第1章 概述 1.1 人工神经网络研究与发展 1.2 生物神经元 1.3 人工神经网络的构成 第2章人工神经网络基本模型 2.1 MP模型 2.2 感知器模型 2.3 自适应线性

2012-03-20 11:32:43

将神经网络移植到STM32最近在做的一个项目需要用到网络进行拟合,并且将拟合得到的结果用作控制,就在想能不能直接在单片机上做神经网络计算,这样就可以实时计算,不依赖于上位机。所以要解决的主要是两个

2022-01-11 06:20:53

神经网络简介

2012-08-05 21:01:08

基于深度学习的神经网络算法

2019-05-16 17:25:05

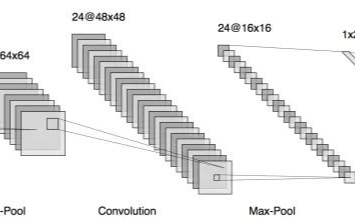

,不断地进行学习训练,一直到网络输出的误差减少到可以接受的程度。 B、卷积神经网络卷积神经网络是一种前馈神经网络,它的人工神经元可以响应一部分覆盖范围内的周围单元。换个角度思考,卷积神经网络就是多层

2018-06-05 10:11:50

解模型结构、激活函数、模型参数形状(神经元数量)等keras 中有一些现成的包可以创建我们的神经网络模型的可视化表示。前三个包可以在模型训练之前使用(只需要定义和编译模型);但是Tensor

2022-11-02 14:55:04

MATLAB神经网络

2013-07-08 15:17:13

递归网络newelm 创建一Elman递归网络2. 网络应用函数sim 仿真一个神经网络init 初始化一个神经网络adapt 神经网络的自适应化train 训练一个神经网络3. 权函数dotprod

2009-09-22 16:10:08

TF:TF之Tensorboard实践:将神经网络Tensorboard形式得到eventsouttfevents文件+dos内运行该文件本地服务器输出到网页可视化

2018-12-21 10:43:41

TensorFlow 使用 TensorBoard 来提供计算图形的图形图像。这使得理解、调试和优化复杂的神经网络程序变得很方便。TensorBoard 也可以提供有关网络执行的量化指标。它读取

2020-07-22 21:26:55

请问:我在用labview做BP神经网络实现故障诊断,在NI官网找到了机器学习工具包(MLT),但是里面没有关于这部分VI的帮助文档,对于”BP神经网络分类“这个范例有很多不懂的地方,比如

2017-02-22 16:08:08

习神经神经网络,对于神经网络的实现是如何一直没有具体实现一下:现看到一个简单的神经网络模型用于训练的输入数据:对应的输出数据:我们这里设置:1:节点个数设置:输入层、隐层、输出层的节点

2021-08-18 07:25:21

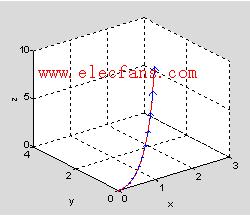

TF之NN:matplotlib动态演示深度学习之tensorflow将神经网络系统自动学习散点(二次函数+noise)并优化修正并且将输出结果可视化

2018-12-21 10:48:26

盘点与展望

正文

神经网络的结构

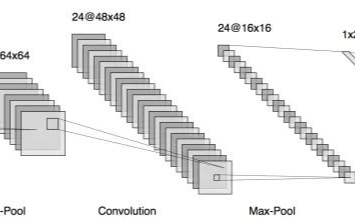

典型的经典神经网络的结构:CNN(卷积神经网络),CNN以阵列的方式输入数据,经过多层网络的卷积、链接、激活等过程,最终输出结果,是一种经典的结构,但存在以下

2023-09-16 11:11:01

的卷积进行升维和降维(如图4),还可以调整直连的位置来对其做出调整,介绍图形结合,比较利于理解。对于初端块,举例了不同初端块结构(如图5),了解到神经网络中的\"跳跃连接块\"

2023-09-11 20:34:01

`本篇主要介绍:人工神经网络的起源、简单神经网络模型、更多神经网络模型、机器学习的步骤:训练与预测、训练的两阶段:正向推演与反向传播、以TensorFlow + Excel表达训练流程以及AI普及化教育之路。`

2020-11-05 17:48:39

,得到训练参数2、利用开发板arm与FPGA联合的特性,在arm端实现图像预处理已经卷积核神经网络的池化、激活函数和全连接,在FPGA端实现卷积运算3、对整个系统进行调试。4、在基本实现系统的基础上

2018-12-19 11:37:22

学习和认知科学领域,是一种模仿生物神经网络(动物的中枢神经系统,特别是大脑)的结构和功能的数学模型或计算模型,用于对函数进行估计或近似。神经网络由大量的人工神经元联结进行计算。大多数情况下人工神经网络

2019-03-03 22:10:19

。可以看到文件列表中多了一个我们刚刚克隆的项目。如下图: 图3神经网络源码分析在运行代码之前,我们先来了解一下神经网络代码的构成。代码至少包含三个函数。初始化函数--设定输入层节点、隐藏层 节点和输出层

2019-03-18 21:51:33

是一种常用的无监督学习策略,在使用改策略时,网络的输出神经元相互竞争,每一时刻只有一个竞争获胜的神经元激活。ART神经网络由比较层、识别层、识别阈值、重置模块构成。其中比较层负责接收输入样本,并将其传递

2019-07-21 04:30:00

传播的,不会回流),区别于循环神经网络RNN。BP算法(Back Propagation):误差反向传播算法,用于更新网络中的权重。BP神经网络思想:表面上:1. 数据信息的前向传播,从输入层到隐含层

2019-07-21 04:00:00

可视化过程如下图所示(图来源于网络):

为什么要引入激活层?

以下回答引用自参考6:

引入激活函数是为了增加神经网络的非线性,如果不用激活函数,每一层都是上一层的线性输入,这样一来,无论神经网络有

2023-08-18 06:56:34

人工神经网络是根据人的认识过程而开发出的一种算法。假如我们现在只有一些输入和相应的输出,而对如何由输入得到输出的机理并不清楚,那么我们可以把输入与输出之间的未知过程看成是一个“网络”,通过不断地给

2008-06-19 14:40:42

人工神经网络(Artificial Neural Network,ANN)是一种类似生物神经网络的信息处理结构,它的提出是为了解决一些非线性,非平稳,复杂的实际问题。那有哪些办法能实现人工神经网络呢?

2019-08-01 08:06:21

人工神经网络课件

2016-06-19 10:15:48

简单理解LSTM神经网络

2021-01-28 07:16:57

图卷积神经网络

2019-08-20 12:05:29

思维导图如下:发展历程DNN-定义和概念在卷积神经网络中,卷积操作和池化操作有机的堆叠在一起,一起组成了CNN的主干。同样是受到猕猴视网膜与视觉皮层之间多层网络的启发,深度神经网络架构架构应运而生,且

2018-05-08 15:57:47

全连接神经网络和卷积神经网络的区别

2019-06-06 14:21:42

Keras实现卷积神经网络(CNN)可视化

2019-07-12 11:01:52

以前的神经网络几乎都是部署在云端(服务器上),设备端采集到数据通过网络发送给服务器做inference(推理),结果再通过网络返回给设备端。如今越来越多的神经网络部署在嵌入式设备端上,即

2021-12-23 06:16:40

卷积神经网络为什么适合图像处理?

2022-09-08 10:23:10

卷积神经网络(CNN)究竟是什么,鉴于神经网络在工程上经历了曲折的历史,您为什么还会在意它呢? 对于这些非常中肯的问题,我们似乎可以给出相对简明的答案。

2019-07-17 07:21:50

为 三个过程:输入信号线性加权、求和、非线性激活。1958 年到 1969 年为神经网络模型发展的第一阶段, 称为第一代神经网络模型。在 1958 年 Rosenblatt 第 一次在 MCP 模型上

2022-08-02 10:39:39

卷积神经网络的层级结构 卷积神经网络的常用框架

2020-12-29 06:16:44

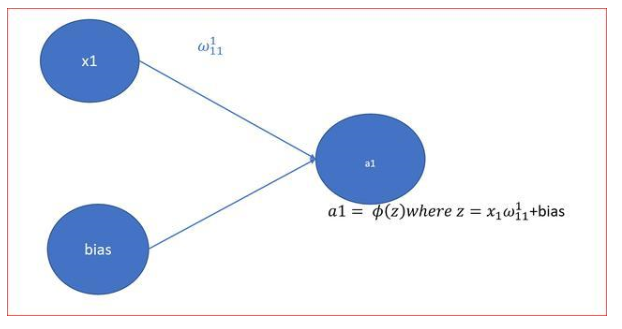

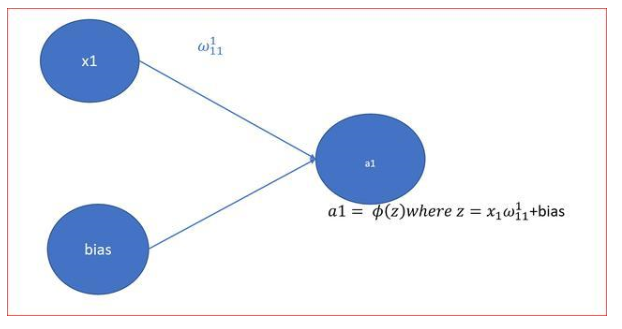

可以用数学来描述为其中 f = 激活函数,w = 权重,x = 输入数据,b = 偏差。数据可以作为单个标量、向量或矩阵形式出现。图1显示了一个具有三个输入和一个ReLU的神经元^2^激活功能。网络中

2023-02-23 20:11:10

什么是卷积神经网络?ImageNet-2010网络结构是如何构成的?有哪些基本参数?

2021-06-17 11:48:22

最近在学习电机的智能控制,上周学习了基于单神经元的PID控制,这周研究基于BP神经网络的PID控制。神经网络具有任意非线性表达能力,可以通过对系统性能的学习来实现具有最佳组合的PID控制。利用BP

2021-09-07 07:43:47

FPGA实现神经网络关键问题分析基于FPGA的ANN实现方法基于FPGA的神经网络的性能评估及局限性

2021-04-30 06:58:13

如何使用STM32F4+MPU9150去实现一种神经网络识别手势呢?其过程是怎样的?

2021-11-19 06:38:58

如何用stm32cube.ai简化人工神经网络映射?如何使用stm32cube.ai部署神经网络?

2021-10-11 08:05:42

AD中非可视化区域物件怎么移到可视化区域???

2019-09-10 05:36:41

原文链接:http://tecdat.cn/?p=5725 神经网络是一种基于现有数据创建预测的计算系统。如何构建神经网络?神经网络包括:输入层:根据现有数据获取输入的层隐藏层:使用反向传播优化输入变量权重的层,以提高模型的预测能力输出层:基于输入和隐藏层的数据输出预测

2021-07-12 08:02:11

训练一个神经网络并移植到Lattice FPGA上,通常需要开发人员既要懂软件又要懂数字电路设计,是个不容易的事。好在FPGA厂商为我们提供了许多工具和IP,我们可以在这些工具和IP的基础上做

2020-11-26 07:46:03

神经网络(Neural Networks)是人工神经网络(Ar-tificial Neural Networks)的简称,是当前的研究热点之一。人脑在接受视觉感官传来的大量图像信息后,能迅速做出反应

2019-08-08 06:11:30

能力是无法解决的。而量子神经网络被认为是一种具有固有模糊性的网络,它的隐层单元采用多量子能级变换函数,每个多能级变换函数是一系列具有量子间隔偏移的S型函数之和,能将决策的不确定性数据合理地分配到各类故障

2019-07-05 08:06:02

概述:ZISC78是由IBM和Sillicon联合研发的一种具有自学习功能的径向基函数神经网络芯片,它内含78个神经元;并且采用并行结构,运行速度与神经元数量无关;支持RBF/KNN算法;内部可分为若干独立子网...

2021-04-07 06:48:33

本文提出了一个基于FPGA 的信息处理的实例:一个简单的人工神经网络应用Verilog 语言描述,该数据流采用模块化的程序设计,并考虑了模块间数据传输信号同 步的问题,有效地解决了人工神经网络并行数据处理的问题。

2021-05-06 07:22:07

数字化可视化的Web组态软件有哪些?都有何优缺点?

2021-09-26 08:19:39

求助地震波神经网络程序,共同交流!!

2013-05-11 08:14:19

小女子做基于labview的蒸发过程中液位的控制,想使用神经网络pid控制,请问这个控制方法可以吗?有谁会神经网络pid控制么。。。叩谢

2016-09-23 13:43:16

求助大神 小的现在有个难题: 一组车重实时数据 对应一个车重的最终数值(一个一维数组输入对应输出一个数值) 这其中可能经过均值、方差、去掉N个最大值、、、等等的计算 我的目的就是弄清楚这个中间计算过程 最近实在想不出什么好办法就打算试试神经网络 请教大神用什么神经网络好求神经网络程序

2016-07-14 13:35:44

一些可视化的手段以理解深度卷积神经网络。直接可视化第一层滤波器由于第一层卷积层的滤波器直接在输入图像中滑动,我们可以直接对第一层滤波器进行可视化。可以看出,第一层权重关注于特定朝向的边缘以及特定色彩组合

2019-07-21 13:00:00

深度学习中的类别激活热图可视化

2021-02-03 07:02:53

最简单的神经网络

2019-09-11 11:57:36

一种基于嵌入式Linux的可视化安全倒车系统设计

2021-05-12 06:39:42

通过excel构筑字模可视化的教程分享

2022-01-21 06:14:56

人工神经网络具有高计算能力、泛化能力和非线性映射等特点,被成功应用于众多领域,但缺乏用于确定其网络拓扑结构、激活函数和训练方法的规则。该文提出利用遗传算法优化

2009-04-13 08:42:32 18

18 提出一种前馈神经网络盲多用户检测算法,利用前馈神经网络替代原有检测器中的滤波器,通过惩罚函数对约束恒模代价函数进行求解,获得前馈神经网络权值和参数的迭代公式,

2009-04-22 08:41:47 29

29 RBF 径向基神经网络在工程中,尤其是各种智能控制中的应用十分广泛。其隐含层的非线性激活函数经常采用高斯径向基函数,这一函数为一指数函数。指数函数用硬件实现起来比

2009-09-02 18:06:46 24

24 函数的可视化与Matlab作2.1 实验与观察:函数的可视化2.1.1 Matlab二维绘图命令1.周期函数与线性p-周期函数 ◆

2008-10-17 00:30:30 1992

1992

Fjodor Van Veen 写了一篇名为《The Neural Network Zoo》的文章(详见图文并茂的神经网络架构大盘点:从基本原理到衍生关系 ),全面盘点了神经网络的大量框架,并绘制

2018-07-03 09:46:00 2492

2492

为了克服现有语音可视化方法的局限性,该文提出了一种基于神经网络的汉语声韵母可视化方法,通过集成不同的语音特征进入一幅图像中为聋哑人创造了语音信号的可读模式。采用小波神经网络来进行位置信息映射和颜色

2017-10-31 09:56:55 12

12 希望你理解了激活函数背后的思想,为什么要使用激活函数,以及如何选用激活函数。

2018-01-10 11:53:11 6018

6018

我们将纯粹用SQL实现含有一个隐藏层(以及带 ReLU 和 softmax 激活函数)的神经网络。这些神经网络训练的步骤包含前向传播和反向传播,将在 BigQuery 的单个SQL查询语句中实现

2018-05-15 17:48:00 978

978

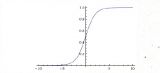

ReLU(Rectified Linear Unit,修正线性单元)训练速度比tanh快6倍。当输入值小于零时,输出值为零。当输入值大于等于零时,输出值等于输入值。当输入值为正数时,导数为1,因此不会出现sigmoid函数反向传播时的挤压效应。

2018-05-16 11:18:08 31420

31420

超参数是必须初始化到网络的值,这些值是神经网络在训练时无法学习到的。例如:在卷积神经网络中,一些超参数是内核大小、神经网络中的层数、激活函数、丢失函数、使用的优化器(梯度下降、RMSprop)、批处理大小、要训练的周期数等。

2018-06-11 11:47:02 2891

2891

非线性:当激活函数是线性的时候,一个两层的神经网络就可以基本逼近所有的函数,但是,如果激活函数是恒等激活函数的时候,就不满足这个性质了,而且如果MLP使用的是恒等激活函数,那么其实整个网络跟单层神经网络是等价的

2018-08-02 14:52:48 11034

11034

的 Logistic regression 就可以认为是一个不含隐含层的输出层激活函数用 sigmoid(logistic) 的神经网络,显然 Logistic regression 就不是 deep 的。不过,现在

2018-09-06 20:48:01 557

557 怎样理解非线性变换和多层网络后的线性可分,神经网络的学习就是学习如何利用矩阵的线性变换加激活函数的非线性变换。

2018-10-23 14:44:21 3741

3741 今天要为大家推荐一套超酷炫的,用于构建神经网络3D可视化应用的框架——TensorSpace。TensorSpace 可以使您更直观地观察神经网络模型,并了解该模型是如何通过中间层tensor的运算来得出最终结果的。

2018-11-16 08:43:02 3832

3832 降低了网络需要训练的数量级。本文以MINST手写体数据库为训练样本,讨论卷积神经网络的权值反向传播机制和MATLAB的实现方法;对激活函数tanh和relu梯度消失问题进行分析和优化,对改进后的激活函数进行训练,得出最优的修正参数

2018-12-06 15:29:48 14

14 神经网络到底是如何运作的?

2019-03-11 09:34:37 3660

3660 如果说节点是神经网络的核心,那么激活函数和感知器就是神经网络核心的核心,几乎在所有的神经网络中都可以看到他俩,这一小节我就来讲解一下激活函数和感知器。

2020-03-20 19:21:43 1126

1126 OpenAI今天发布了Microscope,这是一个神经元可视化库,从九个流行的或大量的神经网络开始。总而言之,该集合包含数百万张图像。

2020-04-15 21:10:14 2790

2790 什么是神经网络激活函数?激活函数有助于决定我们是否需要激活神经元。如果我们需要发射一个神经元那么信号的强度是多少。激活函数是神经元通过神经网络处理和传递信息的机制

2020-07-05 11:21:21 3352

3352

责任编辑:xj 原文标题:盘点 23 款神经网络的设计和可视化工具 文章出处:【微信公众号:中科院长春光机所】欢迎添加关注!文章转载请注明出处。

2020-10-12 14:04:38 1970

1970

导读 对神经网络进行可视化分析不管是在学习上还是实际应用上都有很重要的意义,基于此,本文介绍了3种CNN的可视化方法:可视化中间特征图,可视化卷积核,可视化图像中类激活的热力图。每种方法均附有相关

2020-12-29 11:49:59 2095

2095 激活函数(Activation Function)是一种添加到人工神经网络中的函数,旨在帮助网络学习数据中的复杂模式。类似于人类大脑中基于神经元的模型,激活函数最终决定了要发射给下一个神经元的内容。

2021-03-05 16:15:48 12822

12822

通过对传统BP神经网络缺点的分析,从参数选取、BP算法、激活函数、网络结构4个方面综述了其改进方法。介绍了各种方法的原理、应用背景及其在BP神经网络中的应用,同时分析了各种方法的优缺点。指出不断提高网络的训练速度、收敛性和泛化能力仍是今后的研究方向,并展望了BP神经网络的研究重点。

2021-06-01 11:28:43 5

5 minibatch 的大小, 输出神经元的编码方式, 代价函数的选择, 权重初始化的方法, 神经元激活函数的种类, 参加训练模型数据的规模 这些都是可以影响神经网络学习速度和最后分类结果,其中神经网络的学习速度主要根据训练集上代价函数下降的快慢有关,而最后的分类的结果主要

2021-06-19 14:49:14 3122

3122

PyTorch已为我们实现了大多数常用的非线性激活函数,我们可以像使用任何其他的层那样使用它们。让我们快速看一个在PyTorch中使用ReLU激活函数的例子:

2022-07-06 15:27:37 2146

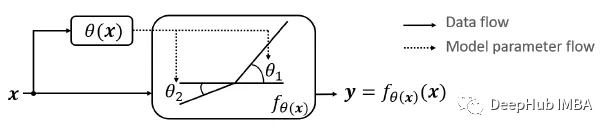

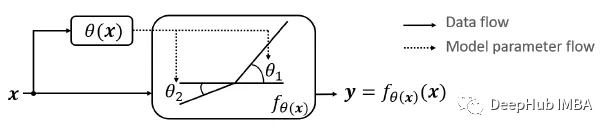

2146 作者:Mouâad B. 来源:DeepHub IMBA 如果你刚刚开始学习神经网络,激活函数的原理一开始可能很难理解。但是如果你想开发强大的神经网络,理解它们是很重要的。 但在我们深入研究激活函数

2023-04-18 11:20:04 322

322

作者:MouâadB.来源:DeepHubIMBA如果你刚刚开始学习神经网络,激活函数的原理一开始可能很难理解。但是如果你想开发强大的神经网络,理解它们是很重要的。但在我们深入研究激活函数之前

2023-04-21 09:28:42 382

382

只要你用了ReLU,我们就是好朋就是“浅度学习”。 最近有研究证明,所有基于ReLU的深度神经网络都可以重写为功能相同的3层神经网络。 基于这个证明,伦敦国王学院的研究团队还提出一种为任意

2023-07-03 14:13:34 314

314

这是我最近才看到的一篇论文,它提出了动态ReLU (Dynamic ReLU, DY-ReLU),可以将全局上下文编码为超函数,并相应地调整分段线性激活函数。

2023-09-01 17:28:18 412

412

电子发烧友App

电子发烧友App

评论