在苹果宣布停止公布手机销量,以富士康和和硕为代表的供应商下调新款iPhone销售预期,市场一致看衰的背景下,苹果用什么来提振投资人的信心呢?

无人驾驶被苹果拿出来说事了。也是在上周,有媒体报道,库克证实苹果正在研发用于无人驾驶汽车的自主系统,这也是库克为数不多的第二次公开披露苹果关于无人驾驶方面的计划和进展。或许苹果要为它的无人驾驶项目提速了。

苹果无人驾驶研发成果秘而不宣

相比Google、特斯拉这类竞争者,苹果进入无人驾驶的赛道稍晚,2014年才开始组建团队,以“Project Titan”作为内部代号。进入的时间晚,并不意味着苹果对无人驾驶项目不重视,当库克在2017年6月首次对外公开其无人车战略的时候,将无人驾驶技术拔到“所有AI项目之母”的高度。

于是苹果挖来了特斯拉负责整车研发和制造的高级副总裁DougField、大众汽车集团的首席数字官JohannJungwirth、福特车身结构和冲压专家AindreaCampbell、保时捷919技术总监AlexanderHitzinger、特斯拉负责工程研发的副总裁ChrisPorritt……

今年7月,美国联邦调查局指控苹果前员工窃取商业机密的诉讼文件曝光了苹果“Titan”项目的团队规模——5000人。

一开始,苹果就把“盘子”铺的很大。可是苹果除了逐渐扩大自己的测试车队外(截止今年9月已达70辆,这个规模仅次于通用汽车的Cruise和Waymo),向外公布的研究成果对于无人驾驶技术并没有突破性的指引。

比如类似于飞机的空中加油机一样,让汽车在行驶时通过“连接臂”共享电池系统;让无人驾驶汽车与iPhone、iPad或MacBook等苹果设备同步,当汽车遇到紧急情况需要人类接管时,发送警报提醒正在使用这些设备的用户及时接管汽车。

根据自动驾驶初创公司Voyage联合创始人MacCallister Higgins在网络上放出一段苹果第三代自动驾驶测试车的视频来看,相比前两代测试车,苹果也只是对毫米波雷达数量进行调整,对传感器列阵进行优化。

此外还有一些天马行空的想法:怎么搞一个静音车门,没有方向盘和油门的情况内饰怎么设计,怎么把AR/VR设备放到车里,怎么应用球形轮胎、甚至还准备重新设计一款更美观的激光雷达……

迄今,苹果无人驾驶技术展现给大众的印象是,它的研发更多停留在硬件和设计层面,苹果最为擅长的软件开发、生态构建等还没有任何风声透出。值得玩味的是,苹果在2015年买下了3个与车相关的顶级域名:apple.car,apple.cars和apple.auto,但是至今还未启用。

用CarPlay接管无人车?苹果没那么天真

相信以苹果公司的高度,它不会没有认识到一套充满智慧的车载系统对于无人驾驶汽车的重要性。

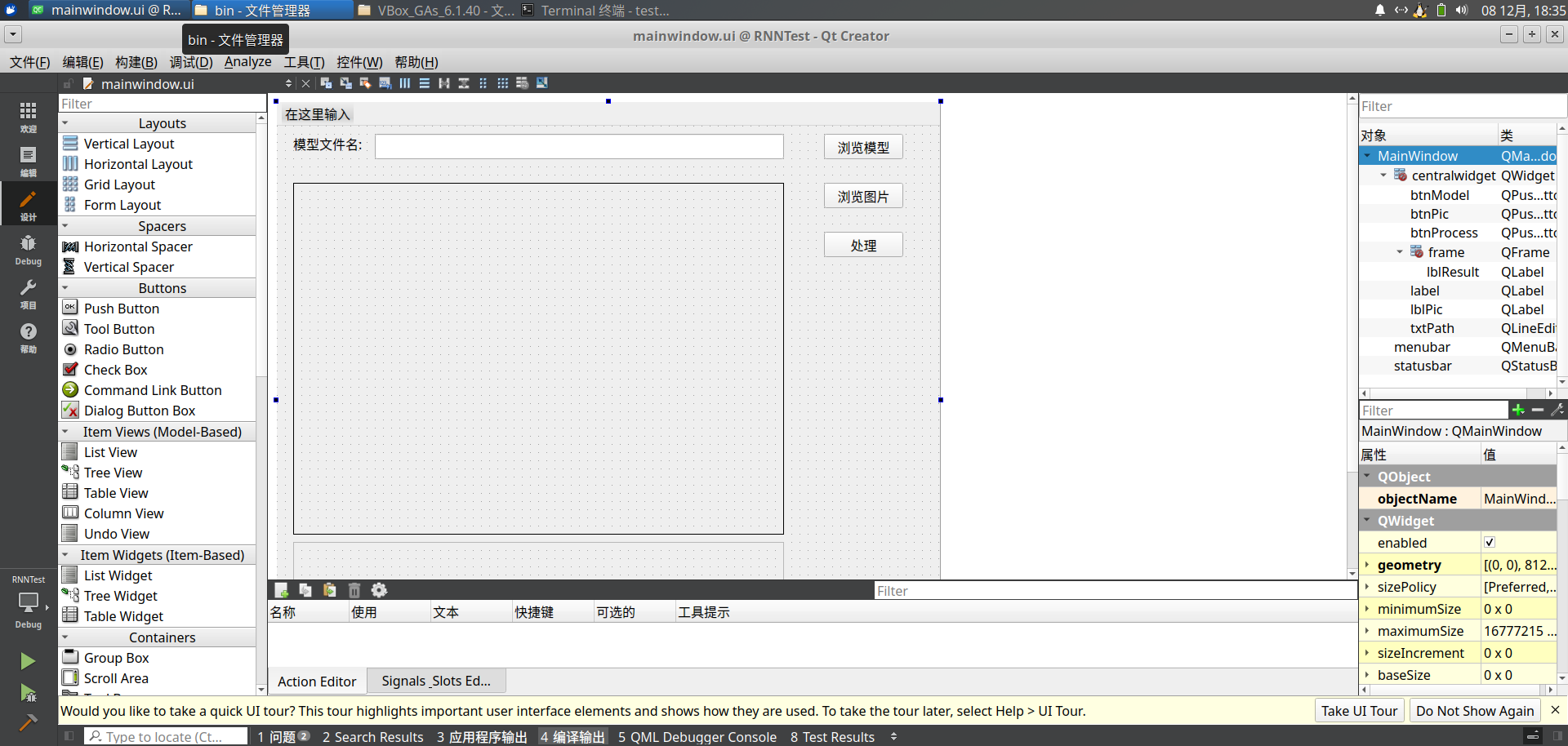

2013年苹果确定进军汽车领域时就制定了“iOS in the Car”计划,并在次年的日内瓦车展上展出了合作伙伴搭载的CarPlay——一套可以将用户的iOS设备、iOS使用体验与汽车仪表盘进行结合的车载系统。苹果能用CarPlay来接管未来的无人车吗?从目前来看,CarPlay还不具备这样的能力。

用户对CarPlay的槽点实在太多。

“支持的APP太少了,最基础的专业导航都不支持。每当我被迫用起苹果坑爹的自带导航时,就无比怀念百度和高德。”

“CarPlay与汽车连接使用时,经常受手机信号的影响。手机信号不好或者行车抖动会导致链接断开,断开后正在使用的导航、音乐之类的应用也马上关闭,好几次差点出事!”

“苹果系统一升级,CarPlay系统就变得卡一点,反应也越来越迟钝,点个图标也要等几秒。”

“升级iOS 12后,数据线连接使用CarPlay时,另外USB接口的U盘音乐不能播放,只能播放收音机与苹果手机自带的或手机app的音乐。”

“一连CarPlay,车载蓝牙就失效,这个Bug好久了也没见苹果修复。”

……

当然最让人无法接受的是,大量用户反映连接CarPlay后Siri无法使用,而在苹果的规划中,Siri是CarPlay的核心——让司机在眼睛不离开道路的情况下通过语音完成操作。

CarPlay这么难用,Google的Android Auto,福特与微软合作开发的SYNC也好不哪去。系统崩溃、触屏难用、反应速度慢这些问题也都在它们身上出现过,有些至今也没解决。至于那些基于Android系统开发出来的车载系统,其稳定性和人机交互逻辑的槽点就更多了。

“小艾你好、小度你好、斑马你好、Nomi你好……谁家的车多了,开车还得记清那些开门暗号。”无人驾驶赛道玩家太多,车载系统的研发,究其源头同质化严重,对于普通用户来说,要想分清这些语言交互助手和它们所匹配的车型还很有些难度。

很显然,无论是iOS还是Android都是基于手机的使用场景设计开发而来的,而汽车的使用场景和人机交互逻辑与手机完全不同,将iOS和Android稍稍修改就搬进车内注定是不会成功的。从库克的这次表态来看,CarPlay可能成为苹果无人车自主系统的一个过渡产品。

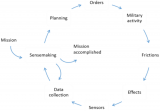

自主系统是苹果布局无人驾驶的第一步

对于无人驾驶自主系统的研发,苹果无疑是有优势的,在苹果庞大的商业帝国中,苹果为它的Mac电脑开发了Mac OS系统;为iPhone开发了iOS系统;甚至连Apple Watch都有属于自己的Watch OS系统。那么对于无人车,苹果为什么不从底层开始,设计一套完全针对汽车驾驶场景的“Car OS”呢?

正如十年前手机行业面临的变革一样,无人驾驶技术也将对汽车行业产生翻天覆地的变化。在变化来临之前,是先做车(硬件)还是先做系统(软件)呢?

类似于“先有鸡?还是先有蛋?”这个经典的哲学问题,苹果用iPhone的经验进行作答——用软件定义硬件、用新技术定义旧行业。

自主系统是苹果布局无人驾驶的第一步,然后就像用iPhone重新定义手机一样,用AI重新定义汽车。未来,汽车除了被用于出行之外,还将会是移动的空间,移动的计算终端,移动的能源终端,移动的摄像机,移动的温度计,移动的机器人……借鉴着当前消费电子领域的成功,用一套烂熟于心的流程,建立一个“软件+硬件+服务”的全新汽车消费生态。

就像iOS(软件)之于iPhone(硬件),在自动驾驶无人车上,苹果在自主系统(软件)之后,它的无人车(硬件)在哪?

其实苹果一直都在寻找制造无人车的合适机会。由于苹果在汽车研发上缺乏经验,在保证现有业务体系不受影响的前提下,不可能像特斯拉那样的初创公司一开始就“赤膊上阵”,苹果走的是一条委婉的“合作造车”路线。

合作伙伴的选择一度让苹果头痛。早期苹果选择的是加拿大的麦格纳公司,之后则是宝马和奔驰,甚至还与日本日产、中国比亚迪和英国的迈凯轮有过接触,但都没有达成具体的合作计划,其中的主要原因就是苹果太过强势,它想要主导权,但车厂不愿将自己赖以安身立命的造车数据交给苹果。

直到今年5月,苹果才与大众达成合作协议,共同开发自动驾驶的无人车。不过项目是以对大众T6厢式车的改造开始,苹果重点对仪表盘和座椅等部分进行改造,还计划会加入各种传感器和电子设备,底盘、车轮等动力机械部分基本没动。

这或许只是苹果与大众进行深度合作,开发具有前瞻性质的自动驾驶无人车之前的一次试探与磨合。根据苹果的商业模式,它无论如何都不会放弃对硬件领域的渗透,无人车也是如此。

只凭一个摄像头 3D目标检测成绩也能媲美激光雷达

靠一个摄像头拍下的图像做3D目标检测,究竟有多难?目前最先进系统的成绩也不及用激光雷达做出来的1/10。

一份来自剑桥的研究,用单摄像头的数据做出了媲美激光雷达的成绩。

还有好事网友在Twitter上惊呼:

这个能不能解决特斯拉不用激光雷达的问题?马斯克你看见了没?

靠“直觉”判断

为何人单眼能做到3D识别,而相机却做不到?

因为直觉。

人能够根据远小近大的透视关系,得出物体的大小和相对位置关系。

而机器识别拍摄的2D照片,是3D图形在平面上的投影,已经失去了景深信息。

为了识别物体远近,无人车需要安装激光雷达,通过回波获得物体的距离信息。这一点是只能获得2D信息的摄像头难以做到的。

为了让摄像头也有3D世界的推理能力,这篇论文提出了一种“正投影特征转换”(OFT)算法。

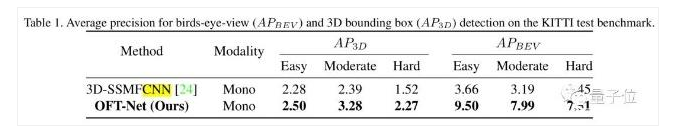

作者把这种算法和端到端的深度学习架构结合起来,在KITTI 3D目标检测任务上实现了领先的成绩。

这套算法包括5个部分:

前端ResNet特征提取器,用于从输入图像中提取多尺度特征图。

正交特征变换,将每个尺度的基于图像的特征图变换为正投影鸟瞰图表示。

自上而下的网络,由一系列ResNet残余单元组成,以一种对图像中观察到的观察效果不变的方式处理鸟瞰图特征图。

一组输出头,为每个物体类和地平面上的每个位置生成置信分数、位置偏移、维度偏移和方向向量等数据。

5. 非最大抑制和解码阶段,识别置信图中的峰值并生成离散边界框预测。

这种方法通过将基于图像的特征映射到一个正交3D空间中,打破了图像的束缚。在这个3D空间里,各个物体比例一致、距离也是有意义的。

效果远超Mono3D

作者用自动驾驶数据集KITTI中3712张训练图像,3769张图像对训练后的神经网络进行检测。并使用裁剪、缩放和水平翻转等操作,来增加图像数据集的样本数量。

作者提出了根据KITTI 3D物体检测基准评估两个任务的方法:最终要求每个预测的3D边界框应与相应实际物体边框相交,在汽车情况下至少为70%,对于行人和骑自行车者应为50%。

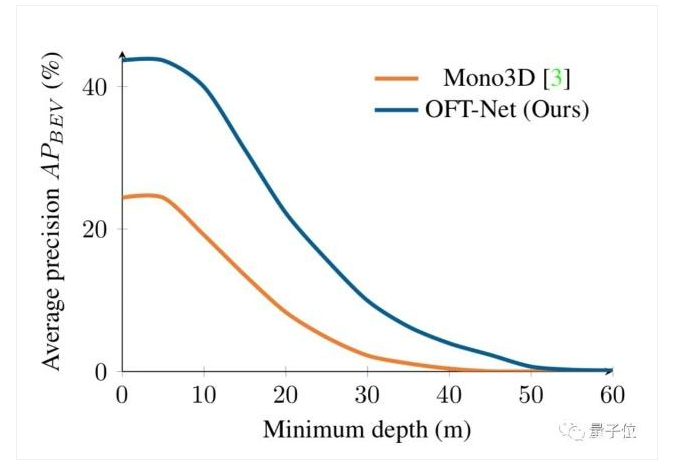

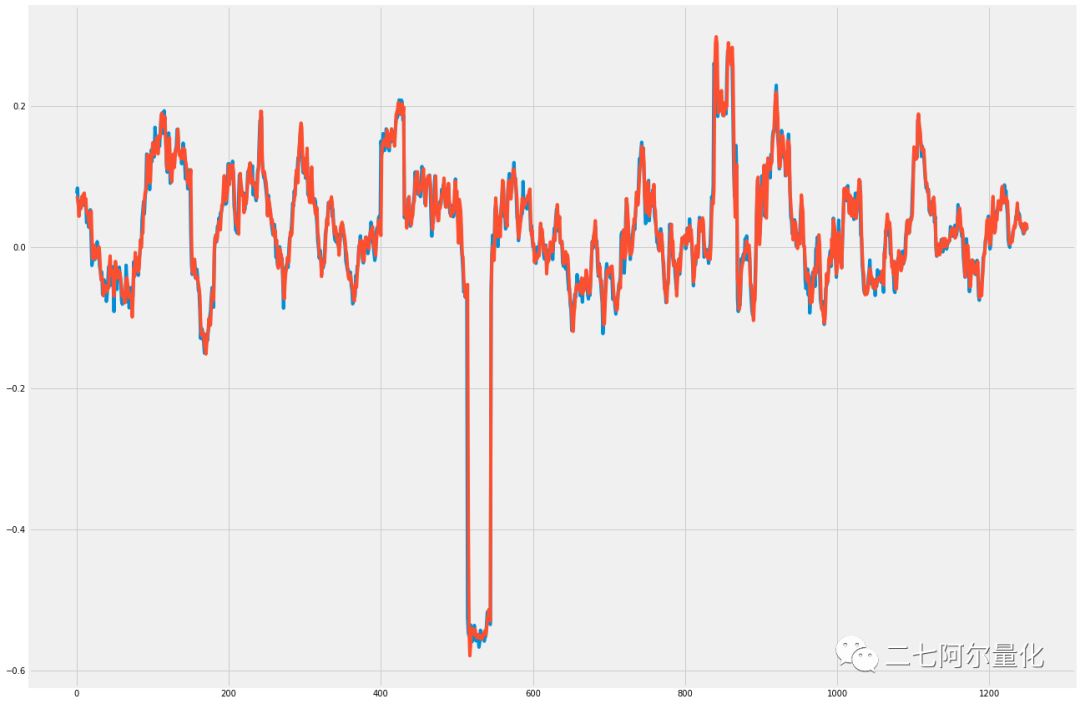

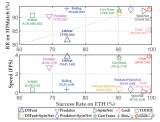

与前人的Mono3D方法对比,OFT在鸟瞰图平均精确度、3D物体边界识别上各项测试成绩上均优于对手。

尤其在探测远处物体时要远超Mono3D,远处可识别出的汽车数量更多。甚至在严重遮挡、截断的情况下仍能正确识别出物体。在某些场景下甚至达到了3DOP系统的水平。

不仅在远距离上,正投影特征转换(OFT-Net)在对不同距离物体进行评估时都都优于Mono3D。

但是与Mono3D相比,这套系统性能也明显降低得更慢,作者认为是由于系统考虑远离相机的物体造成的。

在正交鸟瞰图空间中的推理显著提高了性能。为了验证这一说法,论文中还进行了一项研究:逐步从自上而下的网络中删除图层。

下图显示了两种不同体系结构的平均精度与参数总数的关系图。

趋势很明显,在自上而下网络中删除图层会显着降低性能。

这种性能下降的一部分原因可能是,减少自上而下网络的规模会降低网络的整体深度,从而降低其代表性能力。

从图中可以看出,采用具有大型自上而下网络的浅前端(ResNet-18),可以实现比没有任何自上而下层的更深层网络(ResNet-34)更好的性能,尽管有两种架构具有大致相同数量的参数。(量子位)

资源

论文:

Orthographic Feature Transform for Monocular 3D Object Detection

https://arxiv.org/abs/1811.08188

作者表示等论文正式发表后,就放出预训练模型和完整的源代码。

无人驾驶汽车最新消息:苹果坚持自主系统 深度学习使得摄像头具备3D能力

无人驾驶汽车最新消息:苹果坚持自主系统 深度学习使得摄像头具备3D能力

评论