完善资料让更多小伙伴认识你,还能领取20积分哦,立即完善>

电子发烧友网技术文库为您提供最新技术文章,最实用的电子技术文章,是您了解电子技术动态的最佳平台。

目前工业机器视觉系统主要采用的是传统的基于规则学习的思路。以缺陷检测为例,首先需要人去总结缺陷的类型,提取出判断各类缺陷的特征,再通过大量的含特征的样本训练使得计算机能够区分这些特征从而判断是否存在缺陷。...

图像处理上,随着图像高精度的边缘信息的提取,很多原本混合在背景噪声中难以直接检测的低对比度瑕疵开始得到分辨。...

借助高通量的图案化光刻(镂空模板)、薄膜沉积及一步热退火技术,新方法可实现晶圆级PUF单元制作,体现了批量化、低成本(单个标签成本不到1美分)的生产特点。...

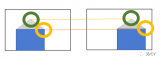

小目标检测广义是指在图像中检测和识别尺寸较小、面积较小的目标物体。通常来说,小目标的定义取决于具体的应用场景,但一般可以认为小目标是指尺寸小于 像素的物体,如下图 COCO 数据集的定义。...

这样的图表展示了网络的结构以及如何计算预测。计算从左侧的输入节点开始。输入值向右流动。它乘以权重,结果就成为我们的输出。...

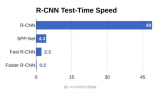

YOLO意思是You Only Look Once,创造性的将候选区和对象识别这两个阶段合二为一,看一眼图片(不用看两眼哦)就能知道有哪些对象以及它们的位置。...

TAU模型将时空注意力分解为两个部分:帧内静态注意力和帧间动态注意力。帧内静态注意力使用小核心深度卷积和扩张卷积来实现大感受野,从而捕捉帧内的长距离依赖关系。...

视差(Disparity):视差是指同一物体在两个图像中投影点之间的水平距离,它与物体到相机的距离成反比,因此可以用来估计物体的深度。视差图(Disparity Map)是指存储立体校正后单视图所有像素视差值的二维图像。...

RNN(循环神经网络)是一种强大的深度学习模型,经常被用于时间序列预测。RNN通过在时间上展开神经网络,将历史信息传递到未来,从而能够处理时间序列数据中的时序依赖性和动态变化。...

现在,机器视觉在工业检测、包装印刷、食品工业、航空航天、生物医学工程、军事科技、智能交通、文字识别等领域得到了广泛的应用。...

本文旨在让没有计算机科学背景的人对ChatGPT和类似的人工智能系统(GPT-3、GPT-4、Bing Chat、Bard等)的工作原理有一些了解。ChatGPT是一种基于*大语言模型(Large Language Model)* 的对话式AI聊天机器人。...

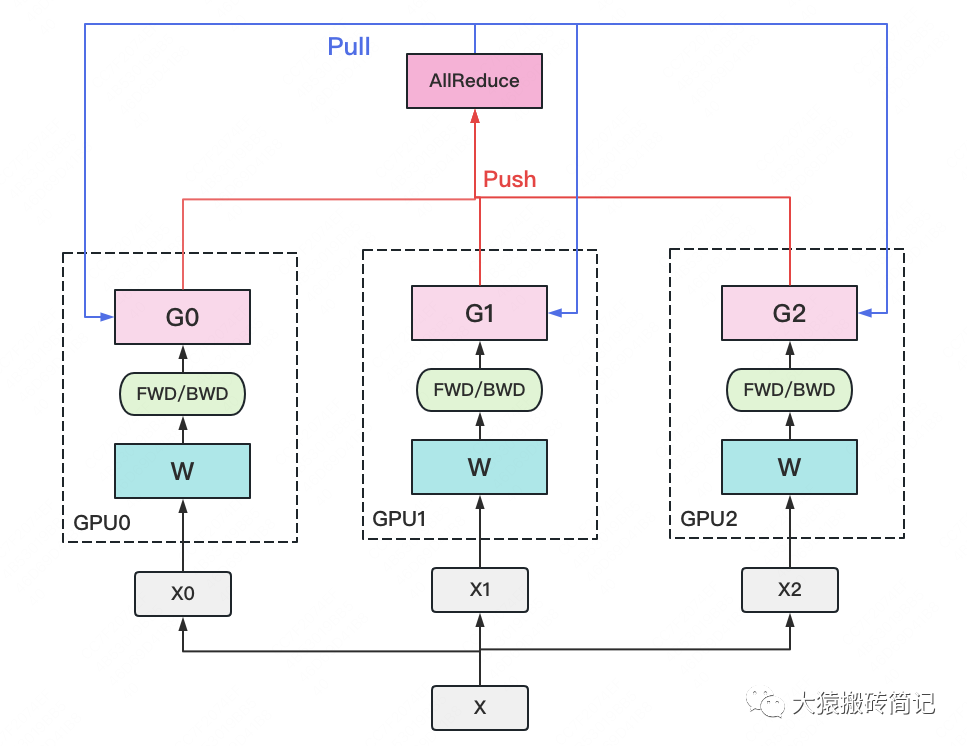

数据并行的核心思想是:在各个GPU上都拷贝一份完整模型,各自吃一份数据,算一份梯度,最后对梯度进行累加来更新整体模型。理念不复杂,但到了大模型场景,巨大的存储和GPU间的通讯量,就是系统设计要考虑的重点了。在本文中,我们将递进介绍三种主流数据并行的实现方式:...

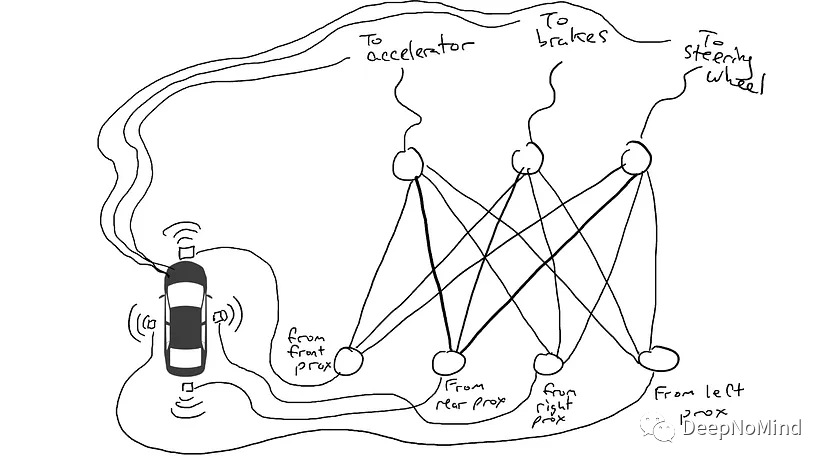

人工智能 (AI) 和机器学习 (ML) 对从医疗保健和金融到能源和运输的广泛行业产生了深远的影响。在各种人工智能技术中,强化学习(RL)——一种机器学习,代理通过与环境交互来学习做出决策——已成为解决复杂、顺序决策问题的有力工具。RL 的一个重大进步是深度 Q 学习网络 (DQN) 的出现,它将深...

随着人工智能等新技术改变我们的数字世界,网络风险正在迅速增长。然而,人工智能也可以用来发现和减少这些新的危险。使用人工智能进行网络防御的组织可以更快地识别威胁,了解黑客的方法和目标,甚至预测即将到来的攻击。网络安全专家有机会在人工智能的帮助下智胜有害行为者并建立更强大的防御。虽然未来仍然未知,但人工...

使用基于人工智能的聊天机器人的一个重大风险是拟人化,患者错误地将类似人类的品质和情感归因于聊天机器人。由于缺乏真正的人类理解和同理心,这可能会导致不切实际的期望、误解和潜在的有害情况。为了降低这种风险,透明的沟通至关重要。患者应该意识到聊天机器人是基于人工智能的程序,而不是人类,对其功能设定了切合实...

实时机器学习是指通过向机器学习模型提供实际数据来不断改进机器学习模型。数据分析师/科学家或开发人员使用先前测试集的集合脱机创建模型。所有部门和行业都尽最大努力从机器学习中获得所有可能的好处,无论是认知研究还是自动连续过程。考虑像Google Home这样的智能家居助理或智能活动跟踪设备,Alexa或...

神经网络生成的自动化测试在涵盖简单的模块化代码片段时处于最佳状态。当然,如果所有代码都以这种方式编写,那就太好了,但这可能是不可能的或不可行的。当您需要涵盖冗长而复杂的业务逻辑时,机器生成的测试的可靠性会受到很大影响。当然,它们会被生成,但很难弄清楚它们是否正确地覆盖了东西,或者它是否只是随机的东西...

如果 CNN 中的输入矩阵和滤波器矩阵可以转换为频域进行乘法运算,并且频域乘法的结果矩阵可以转换为时域矩阵,则不会对算法的准确性造成任何影响。...

在数据科学、机器学习、建模和其他生产性任务中使用 GPU 进行一般处理的作用越来越大,这反过来又促使改进硬件迎合这些应用程序,并提供更好的软件支持。NVIDIA 开发的张量核心极大地改进了训练神经网络和在现实世界、实时应用程序以及各个领域的其他机器学习任务中执行 AI 推理中的矩阵乘法。...