构造instruction data非常耗时耗力,常受限于质量,多样性,创造性,阻碍了instruc....

近年来,大规模深度神经网络的显著成就彻底改变了人工智能领域,在各种任务和领域展示了前所未有的性能。

今天我们要讲的文本生成是现在最流行的研究领域之一。文本生成的目标是让计算机像人类一样学会表达,目前看....

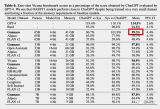

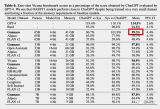

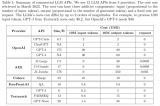

在主要评估LLM模型中文能力的 C-Eval 榜单中,截至6月25日 ChatGLM2 模型以 71....

基于 transformer 的编码器-解码器模型是 表征学习 和 模型架构 这两个领域多年研究成果....

因果推理是人类智力的标志之一。因果关系NLP领域近年来引起了人们的极大兴趣,但其主要依赖于从常识....

我们主要用一个具体的例子展示如何在两个框架下做RLHF,并且记录下训练过程中我们踩到的主要的坑。这个....

网友表示,「澄清问题」是真正使GPT-Engineer脱颖而出的原因,因为修复生成代码中的问题往往比....

Prompt Tuning 可以让预训练的语言模型快速适应下游任务。虽然有研究证明:当训练数据足够多....

baichuan-7B 主要是参考LLaMA进行的改进,且模型架构与LLaMA一致。而在开源大模型中....

除了各类开源模型外,还有GPT-4、PaLM 2等众多「闭源」模型,甚至还开设了一个「准中文」排行榜....

基于 transformer 的编码器-解码器模型是 表征学习 和 模型架构 这两个领域多年研究成果....

由于在生成长文本的数据集上,Flan-PaLM和临床医生的结果显示出一定gap。本文提出了使用Ins....

AGIEval评测基准由微软研究院发起,旨在全面评估基础模型在人类认知和问题解决相关任务上的能力,包....

相隔 20 多年的时间再回头看,我比较得意的一件事就是,1996 年我给联想的总裁办做了一次汇报,说....

今天为大家分享一篇研究,当ChatGPT穿越到口袋妖怪世界,是否会理解并应用这个虚构世界的知识呢....

为了找到NMT模型的潜在缺陷,构建更加可解释的知识库,我们提出以局部准确性这一新概念作为分析角度。其....

神经网络包含很多全连接层,其借助于矩阵乘法得以实现,然而,很多全连接层的权重矩阵都是满秩的。

句向量技术是将连续的文本转化为固定长度的稠密向量,将句子映射到同一个向量空间中

Vaswani 等人在其名作 Attention is all you need 中首创了 基于....

年初,谷歌推出了音乐生成大模型 MusicLM,效果非常不错。有人称这比大火的 ChatGPT 还重....

如何将ChatGPT的能力蒸馏到另一个大模型,是当前许多大模型研发的研发范式。当前许多模型都是采用c....

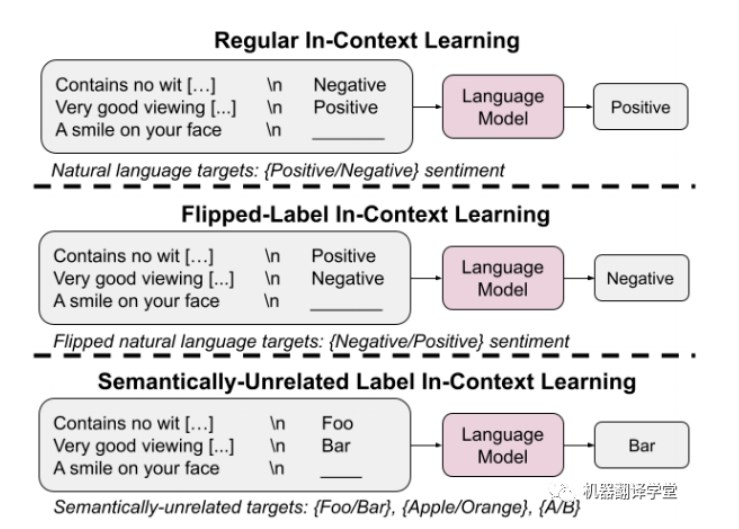

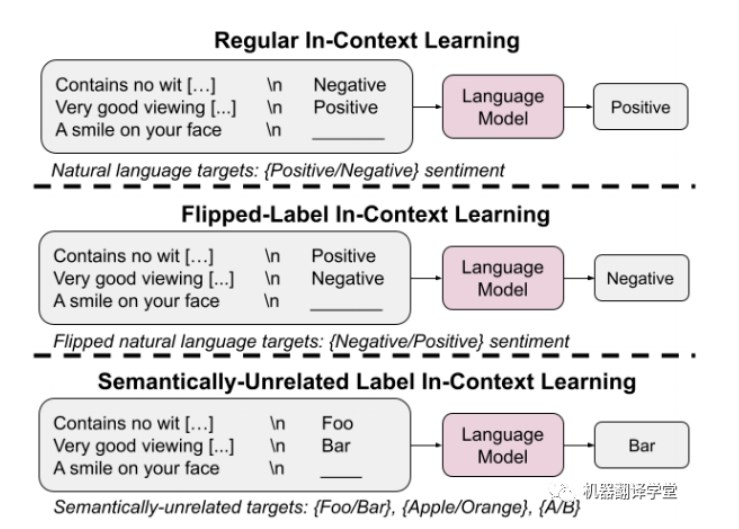

最近,在语言模型领域取得了巨大的进展,部分是因为它们可以通过In-Context- Learning....

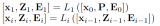

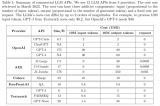

在推理阶段,计算一个矩阵,该矩阵包含表示成对比较结果的logits。给定该矩阵,可以推断给定输入x的....

在本文中我们将对QLoRA的基本原理进行介绍,并且在Firefly项目中进行实践。我们在bloom-....

这项研究提出的思想和发现为可持续高效地使用 LLM 奠定了基础。如果能够在不增加预算的情况下采用更高....

本文首先详细介绍Transformer的基本结构,然后再通过GPT、BERT、MT-DNN以及GPT....

为了实现日常目标,人们通常会根据逐步指令来计划自己的行动。这些指令被发现是目标导向的脚本,包括一组达....

在当前低资源的语言基准上(如FLORES-200)改进机器翻译性能。针对资源极低的语言,可以利用圣经....

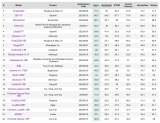

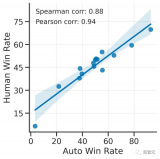

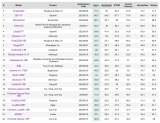

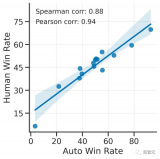

自动测试分数达到 ChatGPT的99.3%,人类难以分辨 两者的回答…… 这是开源大模型最新成果,....